Clear Sky Science · it

Analisi di equità delle previsioni di apprendimento automatico sull’aggressività nelle cure psichiatriche acute

Perché questo conta per le persone reali

Gli ospedali si rivolgono all’intelligenza artificiale per individuare i pazienti che potrebbero diventare aggressivi, nella speranza di prevenire danni senza ricorrere a contenimenti traumatici. Ma se questi strumenti di previsione sono ingiusti, possono peggiorare le stesse disuguaglianze che già influenzano chi viene percepito come “pericoloso”. Questo studio pone una domanda urgente: quando una macchina aiuta a decidere chi è ad alto rischio in un reparto psichiatrico, tratta tutti i pazienti allo stesso modo?

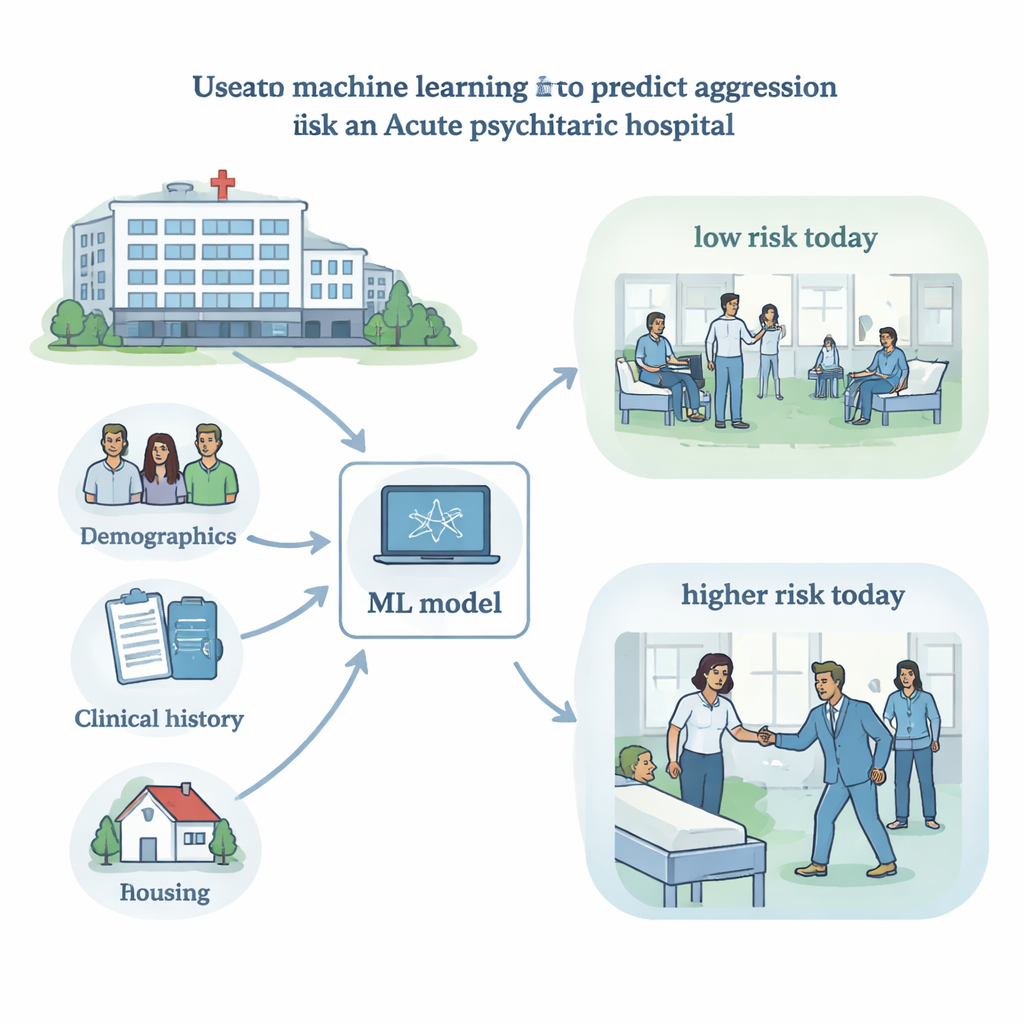

Uso dei dati ospedalieri per segnalare il rischio a breve termine

I ricercatori hanno analizzato le cartelle di oltre 17.000 pazienti trattati in unità psichiatriche acute di un grande ospedale psichiatrico canadese tra il 2016 e il 2022. Per uno o fino a tre giorni durante la degenza, il personale ha registrato un controllo standard al letto chiamato Dynamic Appraisal of Situational Aggression (DASA), che valuta comportamenti come irritabilità o minacce verbali che potrebbero segnalare aggressività imminente. Il team ha combinato questi punteggi con informazioni raccolte al ricovero, come diagnosi, età, genere, razza o etnia, situazione abitativa e come la persona è giunta in ospedale, per addestrare un modello di apprendimento automatico che prevedeva se il paziente sarebbe stato coinvolto in un episodio aggressivo (incluso l’uso di contenimenti o isolamento) nelle successive 24 ore.

Come si è comportato lo strumento di previsione nel complesso

Il sistema con le migliori prestazioni utilizzava un metodo di apprendimento automatico diffuso chiamato random forest. Su dati di test non utilizzati durante l’addestramento ha ordinato correttamente le giornate a rischio più elevato nella maggior parte dei casi, raggiungendo un’area sotto la curva di circa 0,81, comparabile a strumenti simili in psichiatria. Tuttavia, l’aggressività era rara—c’erano circa 33 giornate senza incidenti per ogni giornata con un episodio—quindi il modello ha comunque mancato molti eventi veri e generato alcuni falsi allarmi. Le misure di importanza hanno mostrato che i fattori clinici momento per momento, in particolare gli elementi del DASA come l’irritabilità e gli episodi recenti precedenti, hanno contribuito maggiormente alle previsioni, più che le sole caratteristiche demografiche. Questo significa che il modello rilevava segnali clinicamente significativi, ma le metriche di performance da sole non rivelavano se fosse ugualmente affidabile per tutti.

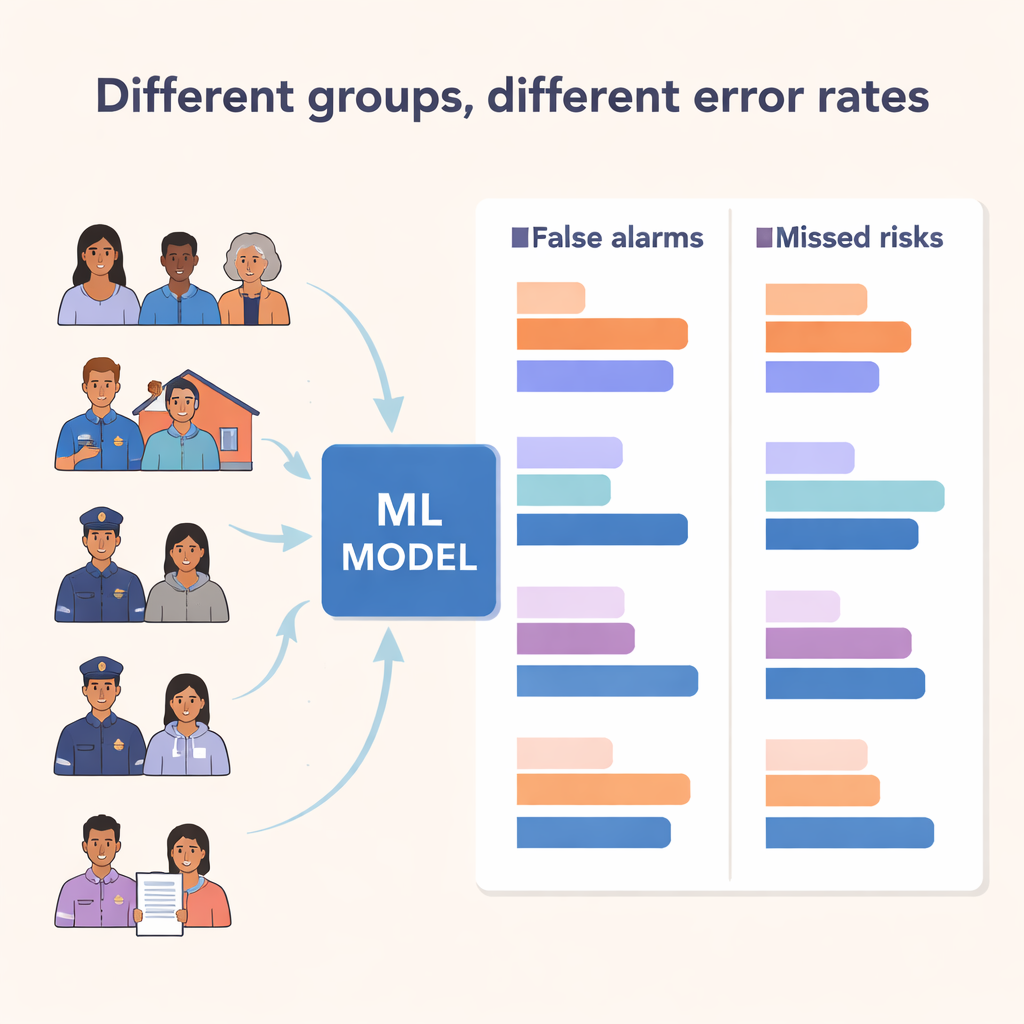

Errori diseguali tra gruppi diversi

Il cuore dello studio è stato un controllo di equità. Il team si è concentrato su due tipi di errori: falsi positivi, quando il modello segnala rischio ma non accade niente, e veri positivi, quando prevede correttamente un episodio. Un modello equo, secondo uno standard comunemente usato chiamato “equalized odds”, dovrebbe avere tassi simili di falsi positivi e veri positivi tra i gruppi. Invece, i ricercatori hanno rilevato grandi differenze. I falsi positivi erano più elevati per pazienti mediorientali e neri, per gli uomini, per le persone portate in ospedale dalla polizia e per chi era senza fissa dimora o in alloggi assistiti. Alcuni gruppi—come i pazienti ricoverati dalla polizia o con casa instabile—mostravano sia tassi di rilevamento più alti sia più falsi allarmi, suggerendo che il modello era tarato per essere particolarmente sensibile per loro. Altri, come i pazienti neri, sperimentavano una combinazione preoccupante: più falsi allarmi e una minore capacità di identificare correttamente il rischio reale.

Quando le identità si intersecano, i divari si ampliano

Poiché le esperienze delle persone sono modellate da più caratteristiche contemporaneamente, i ricercatori hanno anche esaminato le identità sovrapposte, in particolare la combinazione di razza o etnia e genere. Qui il segnale d’allarme più grande è emerso per gli uomini mediorientali, che avevano il tasso di falsi positivi più alto di qualsiasi gruppo, mentre le donne mediorientali non lo avevano. Anche gli uomini neri e indigeni affrontavano falsi positivi elevati rispetto alle donne dello stesso contesto. Questi schemi richiamano disuguaglianze ben documentate nell’assistenza sanitaria mentale, come tassi più alti di intervento della polizia, ricovero obbligatorio e diagnosi errate tra alcuni gruppi razzializzati e tra gli uomini. Il sistema di apprendimento automatico non ha creato quelle disuguaglianze, ma ha appreso da dati intrisi di esse—e rischiava di amplificarle nelle decisioni cliniche.

Cosa significa questo per il futuro dell’IA in psichiatria

Gli autori sostengono che l’analisi di equità debba essere considerata un controllo di sicurezza fondamentale, non un extra opzionale, prima che qualsiasi strumento predittivo venga messo in pratica. Notano che metodi tecnici di “debiasing”—come aggiustare i dati di addestramento o impostare soglie di allerta diverse per gruppi diversi—possono aiutare, ma sono limitati se i registri sottostanti riflettono già trattamenti ineguali e pratiche coercitive. In ultima analisi, decidere cosa costituisce un modello “equo” non è solo un problema matematico; è una questione sociale ed etica che richiede il contributo di pazienti, clinici e comunità. Questo studio mostra che, sebbene l’apprendimento automatico possa aiutare a identificare il rischio di aggressività a breve termine, può anche riprodurre silenziosamente razzismo strutturale, sessismo e disuguaglianze abitative a meno che l’equità non venga misurata, discussa e affrontata in modo rigoroso.

Citazione: Wang, Y., Sikstrom, L., Xiao, R. et al. Fairness analysis of machine learning predictions of aggression in acute psychiatric care. npj Mental Health Res 5, 16 (2026). https://doi.org/10.1038/s44184-026-00194-6

Parole chiave: equità algoritmica, aggressività psichiatrica, apprendimento automatico in sanità, inequità nella salute, modelli di previsione del rischio