Clear Sky Science · it

Tutti occhi, niente IMU: apprendere l’assetto di volo solo dalla visione

Vedere come un insetto

I piccoli robot volanti di solito si affidano a sensori di movimento minuscoli per mantenersi in equilibrio, un po’ come un orecchio interno per le macchine. Ma gli insetti volano in modo agile con hardware molto più semplice, facendo forte affidamento su ciò che vedono. Questo studio dimostra che un drone può fare qualcosa di simile: volare stabilmente usando solo un tipo speciale di telecamera e un cervello artificiale compatto, senza i consueti sensori di movimento. Questo cambiamento potrebbe rendere i futuri droni delle dimensioni di un palmo o in scala insetto più leggeri, economici e robusti.

Perché eliminare i sensori tradizionali?

Il controllo dell’assetto — mantenere il drone inclinato correttamente rispetto alla gravità — è normalmente gestito da un’unità a bordo che misura accelerazione e rotazione. Questi sensori inerziali funzionano bene, ma aggiungono peso, consumano energia e possono rappresentare un singolo punto di guasto. Al contrario, molti insetti volanti non hanno un sensore di gravità dedicato e ricavano indizi sull’inclinazione dal modo in cui il mondo si muove attraverso i loro occhi. Se i robot potessero copiare questo trucco, i velivoli molto piccoli potrebbero aver bisogno solo della visione per vedere e bilanciarsi, semplificando il progetto e facilitando la miniaturizzazione fino alla scala degli insetti.

Una telecamera che vede solo il cambiamento

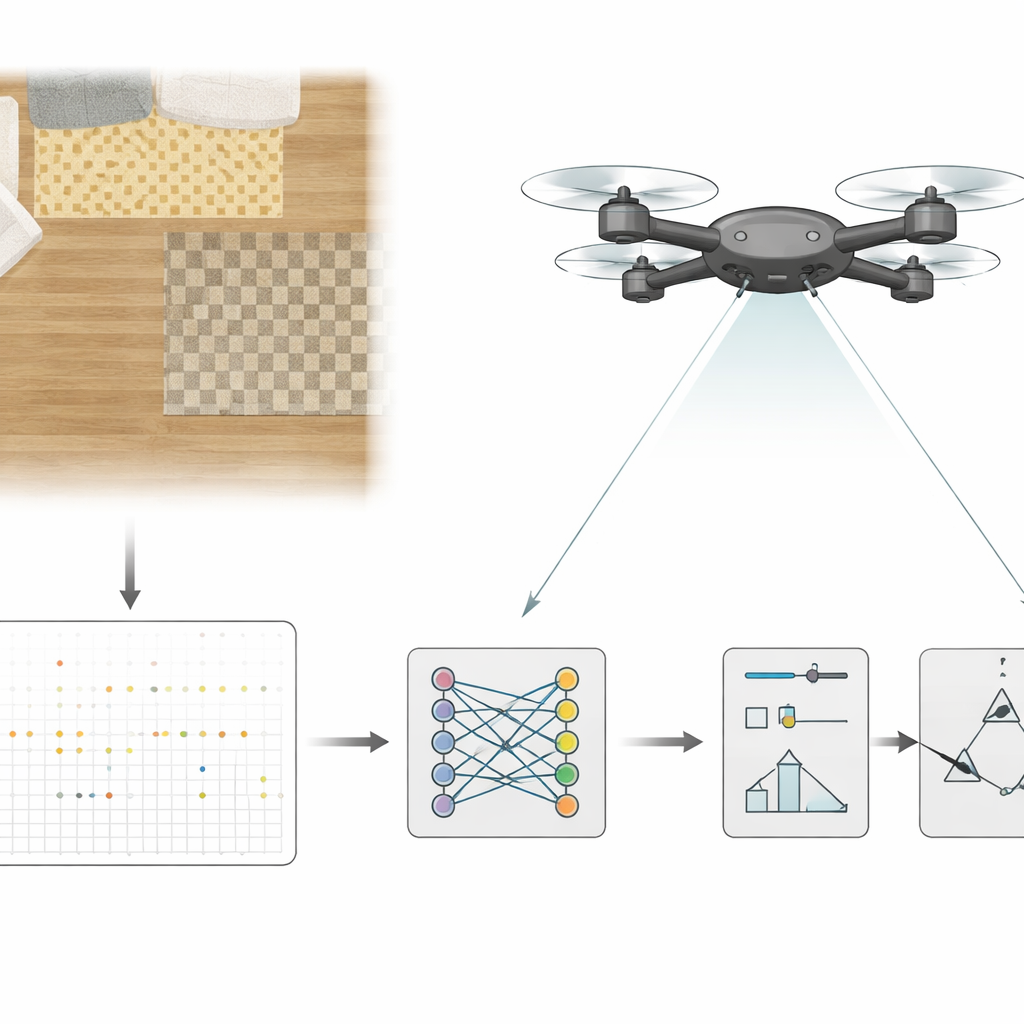

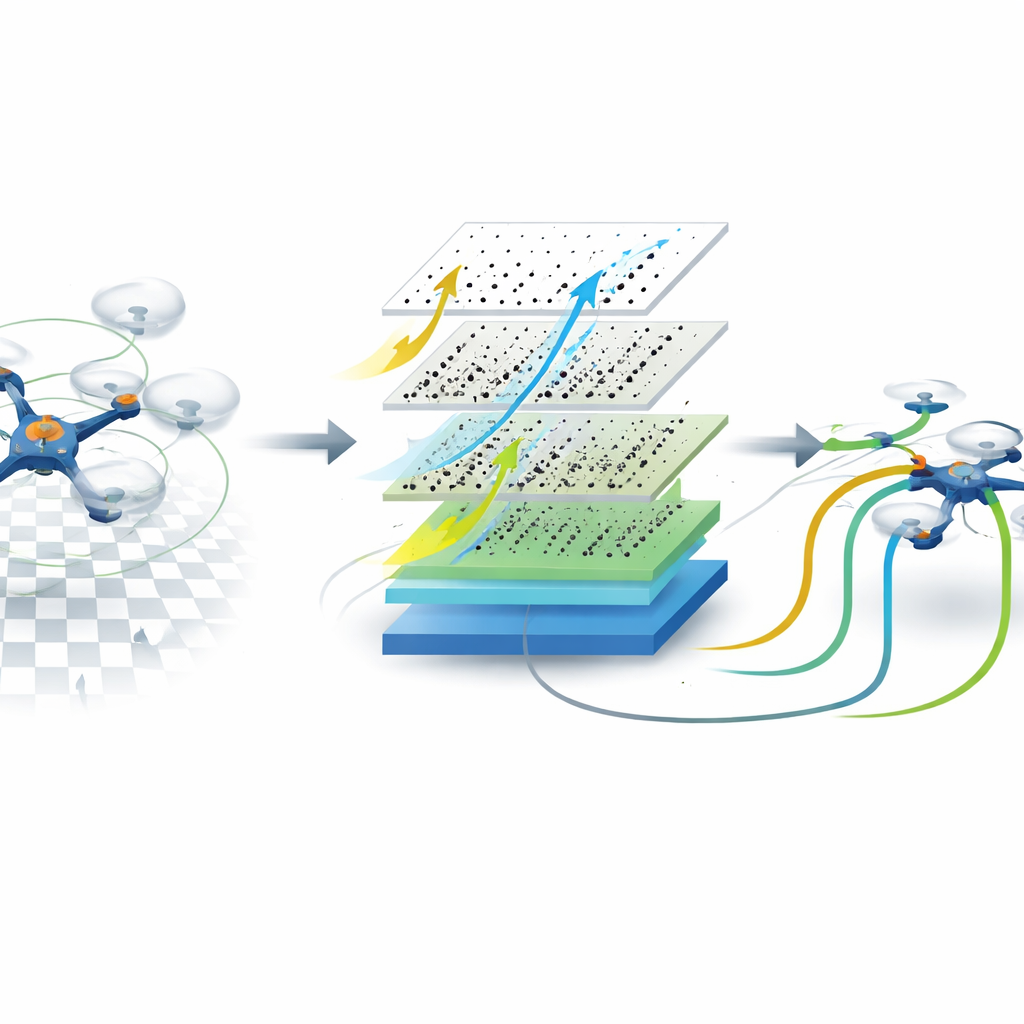

Invece di una videocamera tradizionale, i ricercatori usano una telecamera a eventi puntata verso il basso dal drone. Piuttosto che inviare immagini complete a intervalli fissi, questo sensore segnala soltanto piccole variazioni di luminosità per ogni pixel, e lo fa in modo estremamente rapido. Il flusso di eventi è raggruppato in brevi fette, ognuna della durata di solo cinque millesimi di secondo, e queste fette sono alimentate a una piccola rete neurale convoluzionale ricorrente che gira su un chip grafico a bordo. Nel tempo, la rete impara a trasformare i pattern di cambiamento visivo in stime dell’inclinazione del drone e della sua velocità angolare, sostituendo di fatto l’unità inerziale tradizionale nel ciclo di controllo.

Insegnare a un drone a equilibrarsi solo con la visione

Per addestrare questo cervello artificiale, il team ha prima fatto volare il quadrotore in un’arena interna usando ancora il pacchetto di sensori convenzionale. Durante questi voli hanno registrato il flusso di eventi dalla telecamera insieme ai valori di inclinazione e rotazione stimati dal controllore standard. Hanno quindi addestrato la rete, in supervisione, a riprodurre quei valori a partire solo dai dati visivi. Nei test successivi, i ruoli sono stati invertiti: il drone ha volato con le stime della rete a chiudere il controllo, mentre misure indipendenti di motion‑capture o letture a bordo servivano solo a valutare le prestazioni. Il sistema ha mantenuto il drone in hovering e seguendo percorsi comandati dal pilota per minuti alla volta, con la maggior parte degli errori di inclinazione entro pochi gradi e gli errori di rotazione entro limiti modesti, sufficienti per un volo stabile.

Scrutare l’abilità visiva appresa

I ricercatori hanno esaminato cosa rende questo controllo solo-visivo più efficace. Hanno confrontato diversi design di rete, aggiunto o rimosso input extra come la velocità dei motori o segnali giroscopici, e variato quanto del campo visivo della camera veniva utilizzato. Le reti con memoria — in grado di integrare informazioni visive nel tempo — si sono rivelate cruciali per seguire con accuratezza rotazioni rapide, mentre le versioni senza memoria hanno faticato. Un ampio campo visivo, che espone indizi simili all’orizzonte ai bordi dell’immagine, ha fornito gli errori grezzi più bassi in scene familiari. Sorprendentemente, però, costringere la rete a guardare solo la parte centrale dell’immagine, dove tali indizi statici mancano, l’ha portata a fare più affidamento sui pattern di movimento anziché sull’aspetto della scena. Pur riducendo la precisione assoluta, questo ha migliorato la grazia con cui il sistema si adattava quando trasferito in ambienti molto diversi, suggerendo che si stava imparando un senso interno del movimento.

Verso robot volanti minuscoli e orientati alla visione

Nel complesso, il lavoro mostra che un drone può mantenersi in posizione e controllabile usando solo ciò che vede, senza sensori inerziali nel ciclo di controllo. Abbinando una telecamera a eventi a una rete neurale compatta, il sistema raggiunge la velocità e la reattività necessarie per il controllo in tempo reale riducendo peso e complessità dell’hardware. Per il lettore comune, il messaggio principale è che future sciami di piccoli robot volanti simili a insetti potrebbero bilanciarsi e navigare usando un unico occhio intelligente, proprio come fanno gli insetti, aprendo la porta a macchine più leggere, più efficienti energeticamente e in grado di esplorare in sicurezza spazi ingombri e imprevedibili.

Citazione: Hagenaars, J.J., Stroobants, S., Bohté, S.M. et al. All eyes, no IMU: learning flight attitude from vision alone. npj Robot 4, 21 (2026). https://doi.org/10.1038/s44182-026-00081-4

Parole chiave: controllo di volo basato sulla visione, droni con telecamere a eventi, robotica ispirata alla biologia, controllori a reti neurali, UAV in scala insetto