Clear Sky Science · it

Colmare le modalità con l’IA: una rassegna dei progressi dell’intelligenza artificiale nell’imaging biomedico multimodale

Vedere oltre l’apparenza

La medicina moderna si basa fortemente sulle immagini — dalle radiografie e dalle risonanze magnetiche alle vetrini microscopici dei tessuti — per comprendere cosa accade all’interno del corpo. Questa rassegna spiega come l’intelligenza artificiale (IA) possa intrecciare insieme diversi tipi di immagini mediche in un’unica rappresentazione più ricca della malattia. Per un lettore non specialista, il vantaggio è chiaro: questi progressi potrebbero significare una diagnosi oncologica più precoce, diagnosi più precise e trattamenti adattati all’individuo anziché al paziente medio.

Perché un’unica immagine non basta più

Ogni tecnica di imaging racconta soltanto una parte della storia. Strumenti di radiologia come TC, risonanza magnetica e ecografia rivelano forma e struttura degli organi, mentre esami nucleari come la PET evidenziano quanto sia attivo un tumore. Al microscopio, i patologi osservano l’organizzazione cellulare, e metodi spettroscopici leggono le impronte chimiche dei tessuti. Metodi ottici come la tomografia a coerenza ottica possono zoomare su sottili stratificazioni di occhio o pelle. Presi singolarmente, questi scatti “a vista singola” possono perdere indizi importanti. Se combinati, però, possono collegare l’aspetto di un tumore, il suo comportamento e le molecole che lo guidano, offrendo ai medici una comprensione più completa della malattia.

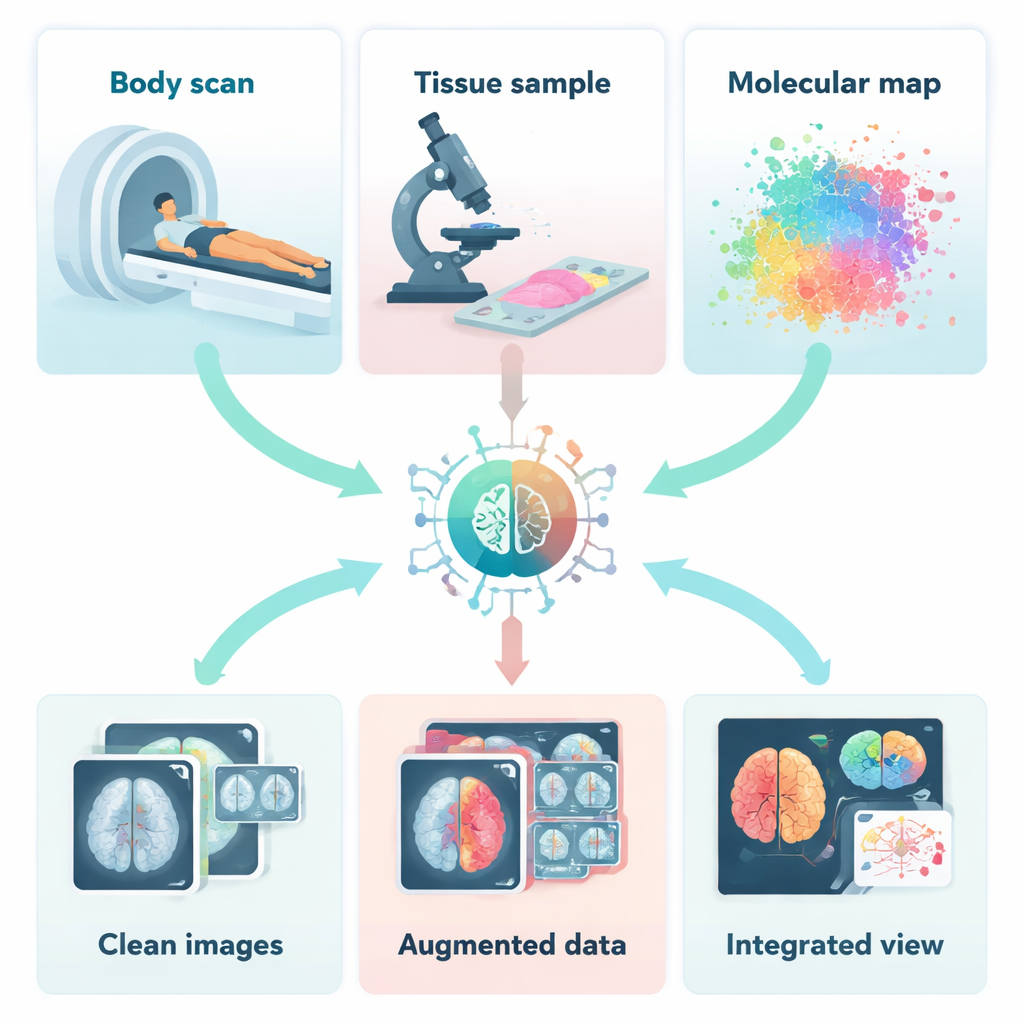

Come l’IA pulisce e completa le immagini mediche

Prima che immagini differenti possano essere combinate, devono essere pulite, allineate e talvolta perfino generate ex novo. Gli autori descrivono come l’IA aiuti a rimuovere rumore e sfocature da movimento nelle scansioni, recuperare dettagli da immagini TC o PET a basso dosaggio e correggere artefatti che altrimenti confonderebbero sia i medici sia i computer. I sistemi di deep learning possono apprendere, a partire da esempi, come dovrebbe apparire un’immagine pulita e poi ripristinare nuove scansioni di conseguenza. Altri modelli di IA generano immagini sintetiche realistiche per “ingrossare” dataset piccoli o colmare tipi di esami mancanti. Questo è particolarmente prezioso per le malattie rare, dove possono esserci pochissimi esempi reali su cui addestrare strumenti diagnostici.

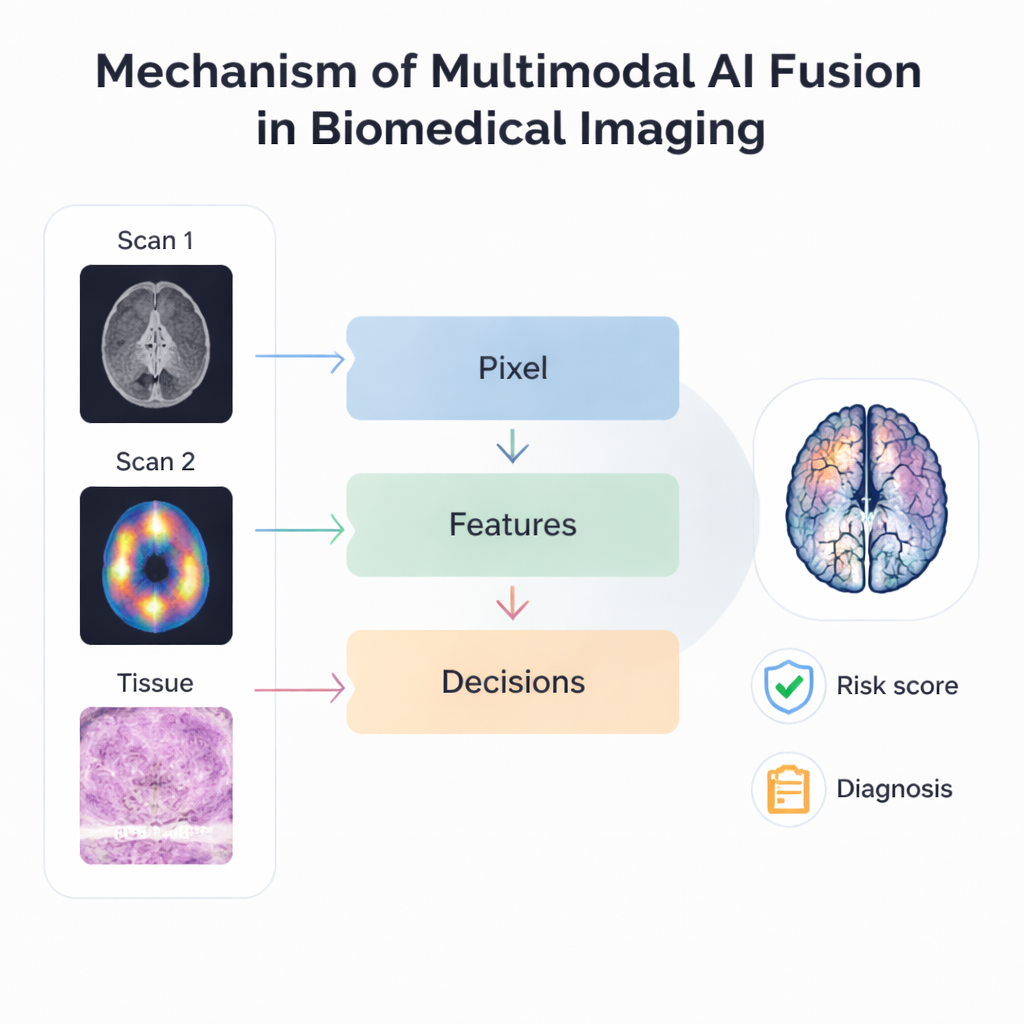

Fondere diverse visuali in un’unica narrazione

Il cuore della rassegna è come l’IA effettivamente fonde più fonti di imaging. Al livello più elementare, metodi basati sui pixel sovrappongono scansioni come MRI e PET in modo che struttura e attività appaiano in un’unica immagine più nitida. Approcci più avanzati estraggono pattern chiave o “feature” da ogni modalità e combinano tali pattern anziché le immagini grezze, rendendo il processo più robusto alle differenze di risoluzione e di allineamento. La fusione a stadio tardivo o a “livello decisionale” spinge oltre, permettendo a modelli IA separati di analizzare immagini differenti e poi votare o mediare le loro predizioni. Sistemi gerarchici mescolano diverse di queste idee, impilando fasi di fusione in modo da poter gestire tutto, dai minuscoli dettagli cellulari ai cambiamenti a livello di organo, all’interno di un unico quadro.

Dalle immagini migliori a cure migliori

Queste tecniche di fusione sono già testate in numerosi scenari clinici. Combinare diverse sequenze di risonanza migliora la segmentazione dei tumori cerebrali, mentre unire mammografie, ecografie e risonanza aumenta la rilevazione del tumore alla mammella e la previsione del rischio. Collegare vetrini di patologia digitale con immagini radiologiche aiuta a prevedere la genetica del tumore e la sopravvivenza del paziente senza necessità di test aggiuntivi. L’IA supporta anche l’“imaging guidato dai dati”, dove pattern sottili nelle scansioni vengono correlati con l’attività genica o con gli esiti clinici, promettendo prognosi più accurate e una selezione migliore delle terapie. Nuovi modelli di base e grandi modelli linguistici multimodali mirano a generalizzare attraverso compiti e tipi di imaging, e persino a collegare immagini con note cliniche scritte, avvicinandosi a strumenti universali in grado di adattarsi a molte malattie e contesti ospedalieri.

Fiducia, equità e il cammino avanti

Nonostante l’entusiasmo, gli autori sottolineano che restano sfide importanti. Le immagini mediche variano ampiamente tra ospedali, apparecchiature e gruppi di pazienti, il che può rendere l’IA fragile o distorta se non vengono affrontate con cura. Molti modelli potenti si comportano come scatole nere, rendendo difficile per i clinici comprendere perché è stata presa una decisione particolare. La rassegna discute gli sforzi per evidenziare quali regioni di ciascuna immagine influenzano maggiormente le predizioni e per progettare sistemi più equi e trasparenti. Nota anche questioni etiche relative alla privacy, alla condivisione dei dati e agli elevati requisiti computazionali dei modelli di grandi dimensioni. Guardando avanti, gli autori immaginano “agent” di IA specializzati che monitorano continuamente imaging, sensori indossabili e cartelle cliniche, assistono i clinici in tempo reale e aiutano a coordinare la cura a lungo termine. Per i pazienti, il risultato finale è che combinare molti tipi di immagini mediche con l’IA potrebbe significare risposte più rapide, terapie più personalizzate e, in ultima analisi, risultati migliori — a condizione che queste tecnologie vengano sviluppate e implementate responsabilmente.

Citazione: Doan, L.M.T., Shahhosseini, K., Verma, S. et al. Bridging modalities with AI: a review of AI advances in multimodal biomedical imaging. Commun Eng 5, 30 (2026). https://doi.org/10.1038/s44172-026-00602-x

Parole chiave: imaging biomedico multimodale, IA medica, fusione di immagini, radiologia e patologia, medicina di precisione