Clear Sky Science · it

Intrappolamento acustico in tempo reale facilitato dall’apprendimento automatico in ambienti multi-media a tempo variabile verso la manipolazione di microbolle guidata da risonanza magnetica

Guidare minuscoli vettori farmacologici con suono e immagini

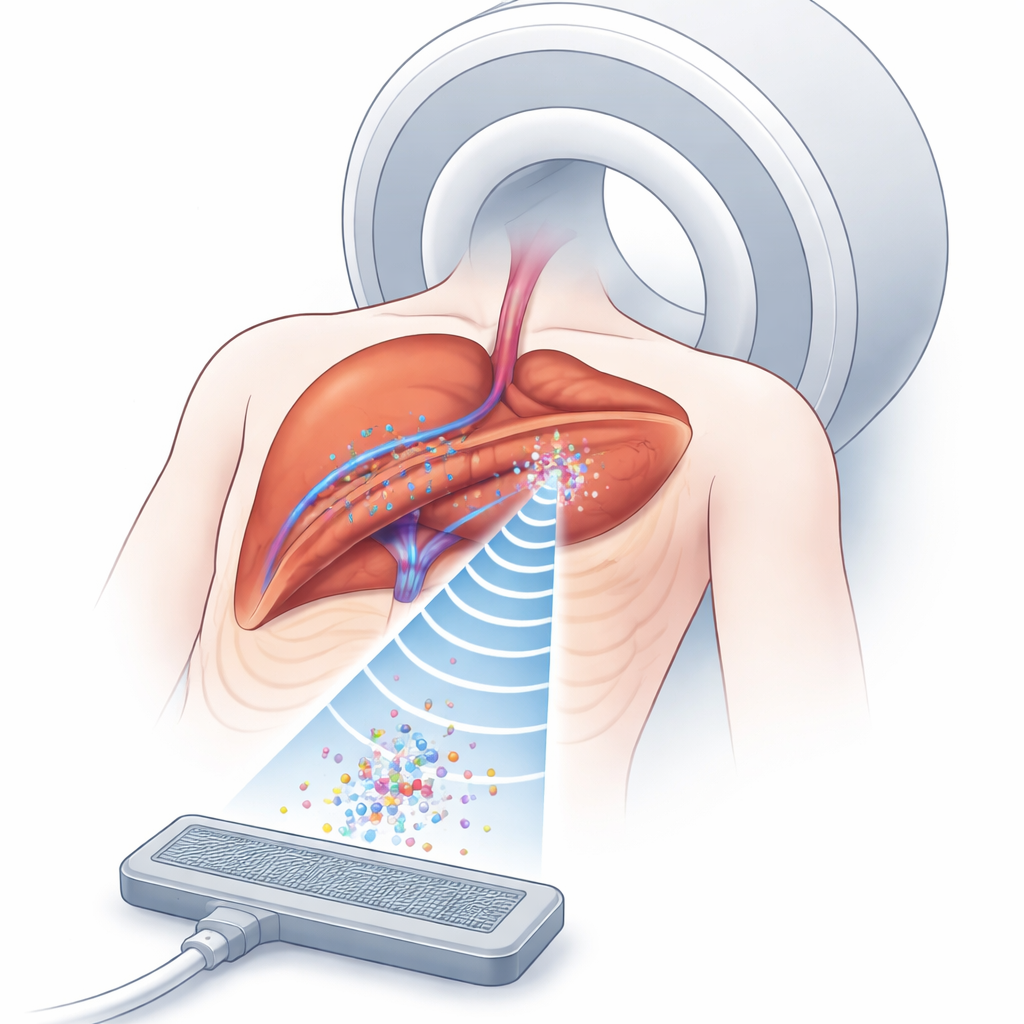

I trattamenti oncologici moderni si affidano sempre più a vettori intelligenti che possono recapitare il farmaco direttamente ai tumori risparmiando i tessuti sani. Questo studio esplora un modo futuristico per indirizzare tali vettori all’interno del corpo utilizzando “trappole” a ultrasuoni guidate dalla risonanza magnetica (MRI). Combinando onde sonore, immagini mediche e apprendimento automatico, i ricercatori mirano a mantenere microscopiche bolle portatrici di farmaco parcheggiate vicino a tumori in movimento, anche mentre il corpo si sposta ad ogni respiro.

Perché è importante intrappolare microbolle

Le microbolle vettori di farmaco viaggiano nei vasi sanguigni e possono rilasciare il loro carico quando attivate dagli ultrasuoni. La sfida è mantenere un numero sufficiente di queste bolle nel punto giusto, per il tempo necessario, in profondità nel corpo. Gli ultrasuoni possono creare tasche di forza invisibili—trappole acustiche—che tengono piccoli oggetti sospesi nel fluido senza contatto. La MRI, nel frattempo, può visualizzare sia il tessuto sia il modello degli effetti degli ultrasuoni, anche all’interno degli organi. Mettere insieme questi due strumenti offre un modo per concentrare i vettori di farmaco attorno ai tumori con maggiore precisione rispetto ai soli farmaci. Ma nei pazienti reali, tessuti di tipo diverso—grasso, muscolo, organi e polmoni in movimento—deviano e distorcono le onde sonore, rendendo molto difficile formare e mantenere una trappola stabile esattamente sulla posizione del tumore.

Il problema di un corpo stratificato e in movimento

In contesti semplici come l’aria o l’acqua, gli ingegneri sanno già come usare array phased di trasduttori a ultrasuoni per spingere, tirare e far ruotare piccoli oggetti. All’interno del corpo, però, il suono deve attraversare più strati con densità e velocità diverse, e i confini tra questi causano rifrazione e distorsione. I metodi computazionali tradizionali possono, in linea di principio, correggere questo calcolando quanto tempo impiega il suono a viaggiare da ciascun emettitore al punto bersaglio. Ma tali approcci suddividono il corpo in milioni di piccoli blocchi e simulano la propagazione delle onde attraverso ciascuno—un processo estremamente dispendioso in termini di tempo che funziona solo se i tessuti restano quasi perfettamente immobili. Il solo respiro può spostare i tessuti addominali di diversi millimetri, rendendo rapidamente obsoleta qualsiasi soluzione precomputata.

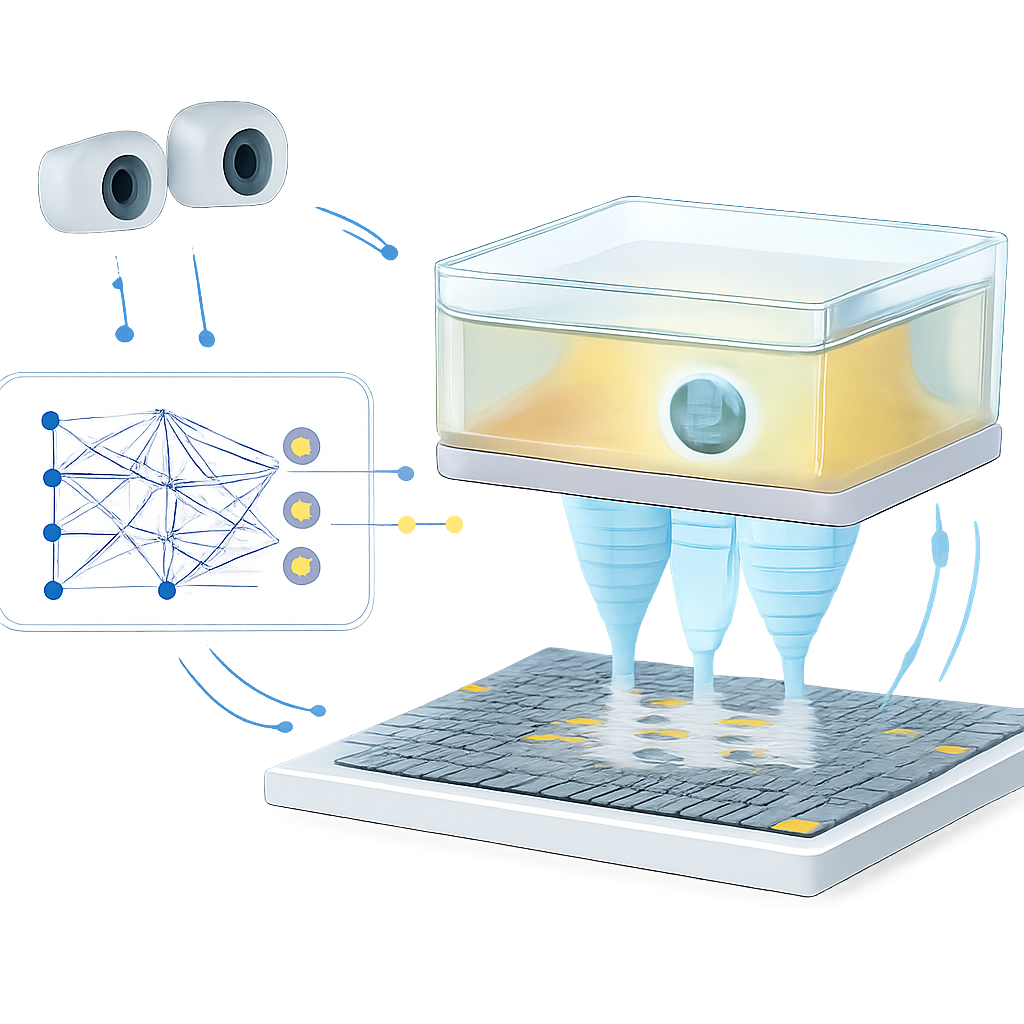

Insegnare a un modello a prevedere i percorsi del suono

Gli autori affrontano questo collo di bottiglia con un modello basato sull’apprendimento che funge da scorciatoia veloce: invece di simulare le onde sonore ogni volta, addestrano una rete neurale a prevedere quanto tempo impiegherà ciascun impulso a raggiungere un punto bersaglio. Prima costruiscono un ambiente virtuale dettagliato usando una camera riempita di gas separata dall’aria tramite una sottile pellicola di plastica, imitando il passaggio del suono attraverso diversi strati tissutali. Usando un simulatore basato sulla fisica, generano un set di addestramento dei tempi di percorrenza del suono tra molti bersagli e un array a ultrasuoni 14 per 14. Lasciano inoltre la camera muoversi in due direzioni per imitare il moto, e descrivono la sua posizione tracciando tre marker visivi, in modo simile a come marker visibili in MRI potrebbero seguire la respirazione del paziente. La rete addestrata impara a mappare la posizione desiderata della trappola più la posa della camera direttamente sul pattern temporale richiesto per tutti i 196 emettitori, raggiungendo una precisione a livello di microsecondi in circa 26 millisecondi.

Chiudere il ciclo con visione e aggiornamenti rapidi

La velocità da sola non basta; la trappola deve anche adattarsi quando l’ambiente cambia inaspettatamente. Per dimostrarlo, il team costruisce un sistema di controllo a ciclo chiuso. Telecamere stereo osservano una piccola sfera di polistirene sospesa dalla trappola acustica all’interno della camera in movimento. Quando la sfera devia dal bersaglio oltre una soglia impostata, il sistema sposta leggermente la posizione bersaglio, inserisce le coordinate aggiornate e la posa della camera nel modello di apprendimento e aggiorna rapidamente il pattern di fase che guida l’array. Negli esperimenti, il sistema può aggiornare il pattern di fase fino a 15 volte al secondo, guidando la sfera lungo percorsi a forma di H, K e U con un errore medio di circa 1 millimetro—paragonabile alla precisione di posizionamento di alcuni sistemi clinici a ultrasuoni focalizzati. Lo stesso principio di feedback riduce anche il tempo in cui la sfera si allontana dalla posizione prevista quando la camera si muove, mostrando che il ciclo di controllo può compensare il moto e gli effetti non modellati della pellicola plastica e della struttura di supporto.

Cosa significa questo per i trattamenti futuri

Per un non specialista, il messaggio centrale è che i ricercatori hanno costruito una specie di “raggio trattore” remoto e senza contatto che un giorno potrebbe parcheggiare bolle cariche di farmaco vicino a un tumore e mantenerle lì, anche mentre il paziente respira. Il loro modello di apprendimento automatico sostituisce simulazioni pesanti con un predittore veloce, mentre le telecamere (e in futuro i marker MRI) dicono al sistema come si muove il corpo in modo che la trappola possa essere riaggiustata al volo. Sebbene il lavoro attuale usi aria, gas e plastica invece dei tessuti reali, e leviti una sfera di plastica invece di microbolle vere, dimostra il controllo in tempo reale in un mezzo stratificato e in movimento. Con hardware più robusto, frequenze ultrasonore più alte e tracciamento del moto basato su MRI, questo approccio potrebbe evolversi in uno strumento clinico per terapie a ultrasuoni robotiche guidate da MRI che consegnano farmaci in modo più accurato e sicuro in profondità nel corpo.

Citazione: Wu, M., Li, X. & Tang, T. Machine learning-facilitated real-time acoustic trapping in time-varying multi-medium environments toward magnetic resonance imaging-guided microbubble manipulation. Commun Eng 5, 52 (2026). https://doi.org/10.1038/s44172-026-00600-z

Parole chiave: intrappolamento acustico, terapia guidata da MRI, consegna di farmaci con microbolle, machine learning in ultrasuoni, manipolazione robotica non invasiva