Clear Sky Science · it

Quando i grandi modelli linguistici sono affidabili nel giudicare la comunicazione empatica

Perché l’empatia delle macchine conta per te

Sempre più spesso le persone si rivolgono a chatbot e assistenti digitali quando sono stressate, sole o devono affrontare decisioni difficili. Questi sistemi possono apparire premurosi e comprensivi—ma possono anche valutare se un messaggio è veramente di sostegno e gentile? Questo articolo esplora quando i grandi modelli linguistici (LLM), la tecnologia alla base di molti chatbot, possono valutare in modo affidabile quanto una risposta scritta risulti empatica, e cosa ciò significa per strumenti di uso quotidiano come app per il benessere, terapeuti virtuali e bot di assistenza clienti.

Studiare conversazioni di supporto

I ricercatori hanno analizzato 200 conversazioni reali basate su testo in cui una persona descriveva un problema personale—come stress lavorativo, conflitti familiari, preoccupazioni economiche o difficoltà di salute mentale—and un’altra persona cercava di rispondere con sostegno. Queste conversazioni provenivano da quattro dataset esistenti, ciascuno collegato a un diverso insieme di domande per giudicare l’empatia. Alcuni si concentravano sul fatto che il rispondente mostrasse comprensione o offrisse conforto emotivo; altri valutavano se dava consigli pratici, incoraggiava la persona a parlare di più, o invece riportava l’attenzione su di sé. Insieme, questi quadri scompongono il “essere empatici” in 21 comportamenti specifici che possono essere valutati su scale, molto simili a un sondaggio di soddisfazione del cliente.

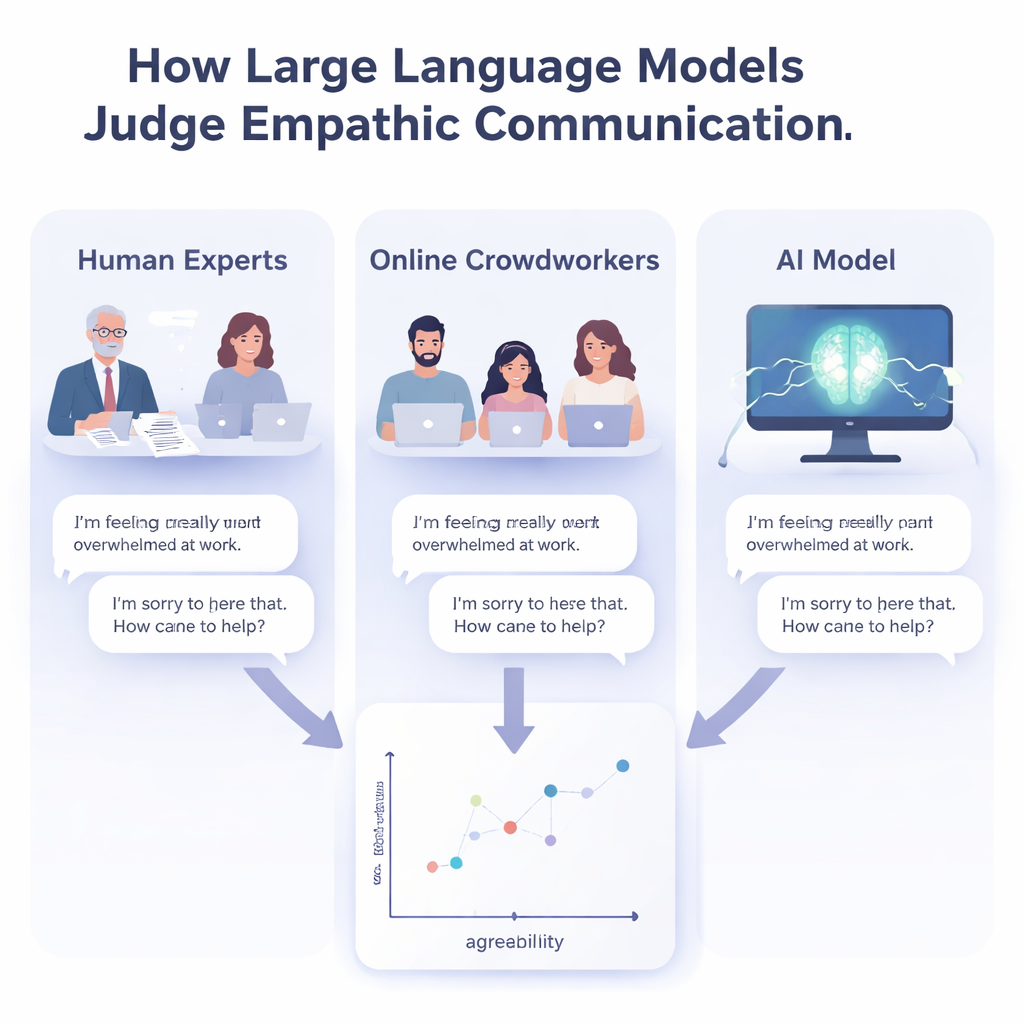

Esperti, crowd e macchine

Per vedere quanto bene gli LLM possano valutare l’empatia, il team ha confrontato tre tipi di giudici: esperti di comunicazione, lavoratori della folla online e moderni modelli linguistici. Tre studiosi esperti di comunicazione empatica hanno valutato in modo indipendente ogni conversazione su tutti e 21 i comportamenti. I crowdworker—utenti comuni di internet—avevano già fornito valutazioni per gli stessi messaggi in studi precedenti. Infine, tre modelli linguistici di punta sono stati accuratamente istruiti con linee guida in linguaggio semplice ed esempi di valutazione degli esperti, e poi invitati a valutare ogni conversazione sulle stesse scale. Questa configurazione ha permesso agli autori di misurare quanto ciascun gruppo concordasse, non solo rispetto a una «risposta corretta», ma tra di loro.

Quanto concordano?

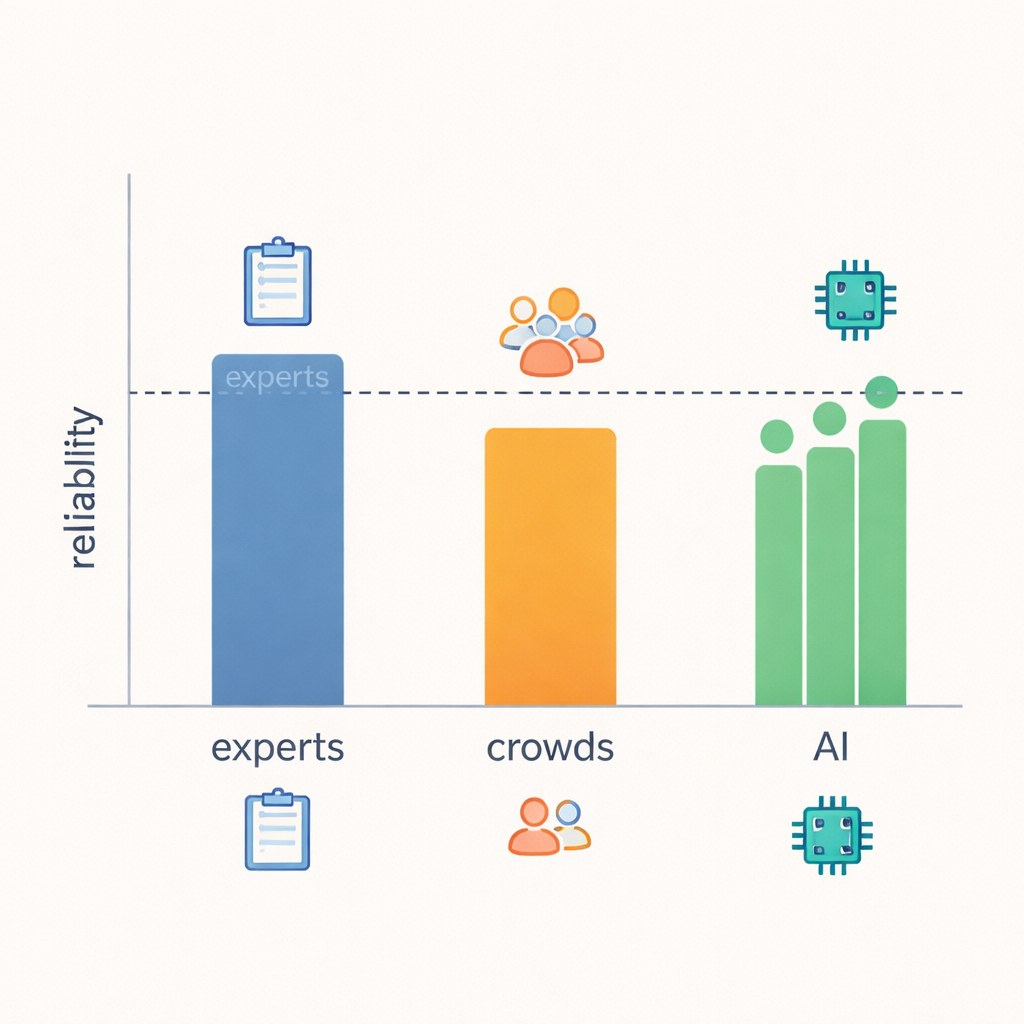

Il risultato principale è che gli LLM si sono avvicinati sorprendentemente all’affidabilità a livello di esperti. Quando i ricercatori hanno misurato quanto spesso le valutazioni coincidenti e quanto grandi fossero i disaccordi, i modelli hanno eguagliato o quasi eguagliato gli esperti nella maggior parte dei 21 comportamenti, e hanno nettamente sovraperformato i crowdworker. In ambiti con segnali chiari e osservabili—come se una risposta offriva consigli pratici, faceva domande di follow-up, o riportava l’attenzione sul parlante—esperti, LLM e persino i crowd tendevano a concordare di più. Ma quando si giudicavano idee più sfumate, come se una risposta realmente “dimostrasse comprensione” o quali fossero le intenzioni del rispondente, anche gli esperti discutevano più spesso, e l’affidabilità degli LLM calava insieme alla loro. Questo suggerisce che alcuni aspetti dell’empatia sono semplicemente più difficili da definire solo dal testo, indipendentemente da chi effettua la valutazione.

Perché punteggi semplici possono fuorviare

Molti studi sull’IA riportano risultati positivi usando metriche di classificazione familiari—trattando ogni valutazione degli esperti come verità indiscussa e misurando quanto spesso un modello la riproduce. Gli autori mostrano che questo approccio può dipingere un quadro distorto quando si tratta di giudizi umani sottili. Per esempio, un sistema può ottenere buoni punteggi indovinando per lo più la valutazione di maggioranza su una scala sbilanciata, anche se fatica nei casi meno frequenti ma importanti. Allo stesso modo, un metodo che per lo più fornisce punteggi “quasi corretti”—con un errore di un solo punto—può risultare male su una metrica di corrispondenza rigorosa, pur comportandosi in modo molto simile a un esperto umano. Concentrandosi sull’affidabilità inter-valutatori—quanto coerentemente diversi giudici valutano la stessa cosa—lo studio offre una visione più onesta di ciò che sia gli umani sia le macchine possono valutare in modo affidabile.

Cosa significa per l’IA di tutti i giorni

Per il lettore comune, la conclusione è al tempo stesso incoraggiante e cauta. Gli LLM ben configurati possono ora aiutare a verificare se risposte scritte—di operatori umani o di altri bot—soddisfano gli standard esperti di comunicazione empatica, e spesso lo fanno in modo più consistente rispetto a valutatori umani non addestrati. Questo potrebbe rendere più semplice monitorare e migliorare i chatbot impiegati in sanità, istruzione e assistenza clienti. Allo stesso tempo, lo studio avverte che non tutti i «test di empatia» sono uguali: domande vaghe o sovrapposte portano a una fragile concordanza umana e, di conseguenza, a giudizi macchina incerti. Prima di affidare all’IA la valutazione di qualcosa di delicato come il supporto emotivo, dovremmo prima assicurarci che gli esperti stessi possano concordare su cosa significhi «buono»—e usare quel punto di riferimento per decidere dove le macchine possono assistere in sicurezza e dove invece il giudizio umano resta essenziale.

Citazione: Kumar, A., Poungpeth, N., Yang, D. et al. When large language models are reliable for judging empathic communication. Nat Mach Intell 8, 173–185 (2026). https://doi.org/10.1038/s42256-025-01169-6

Parole chiave: comunicazione empatica, grandi modelli linguistici, compagni AI, supporto alla salute mentale, interazione uomo–AI