Clear Sky Science · it

Inferenza basata sulla simulazione per una fisica dei neutrini di precisione tramite il tuning Monte Carlo neurale

Rifinire gli «occhi» dei telescopi per neutrini

I futuri esperimenti sui neutrini mirano a rispondere a grandi questioni sull’universo, come l’ordine di massa dei minuscoli neutrini e il meccanismo delle esplosioni stellari. Per farlo, i loro giganteschi rivelatori devono misurare l’energia con precisione estrema—molto oltre quello che le semplici formule dei manuali riescono a gestire. Questo articolo mostra come gli strumenti moderni di machine learning possano aiutare a mettere a punto e validare le complesse simulazioni che collegano ciò che avviene dentro un rivelatore agli impulsi di luce che effettivamente registriamo.

Perché comprendere la risposta del rivelatore è così difficile

In esperimenti come lo Jiangmen Underground Neutrino Observatory (JUNO) in Cina, i neutrini interagiscono in un vasto serbatoio di liquido che produce luce quando le particelle lo attraversano. Quella luce viene raccolta da migliaia di tubi fotomoltiplicatori sotto forma di piccoli impulsi elettrici, conteggiati come “fotoelettroni”. La sfida è ricostruire da quei conteggi l’energia originaria della particella. In realtà questa relazione non è una retta pulita: dipende dalla geometria del rivelatore, dal comportamento del liquido e da diversi effetti fisici intrecciati. Gli approcci tradizionali si basavano sul tarare a mano i parametri di simulazione finché gli spettri simulati non somigliavano più o meno ai dati di calibrazione, un metodo che diventa ingestibile per esperimenti moderni e ad alta precisione.

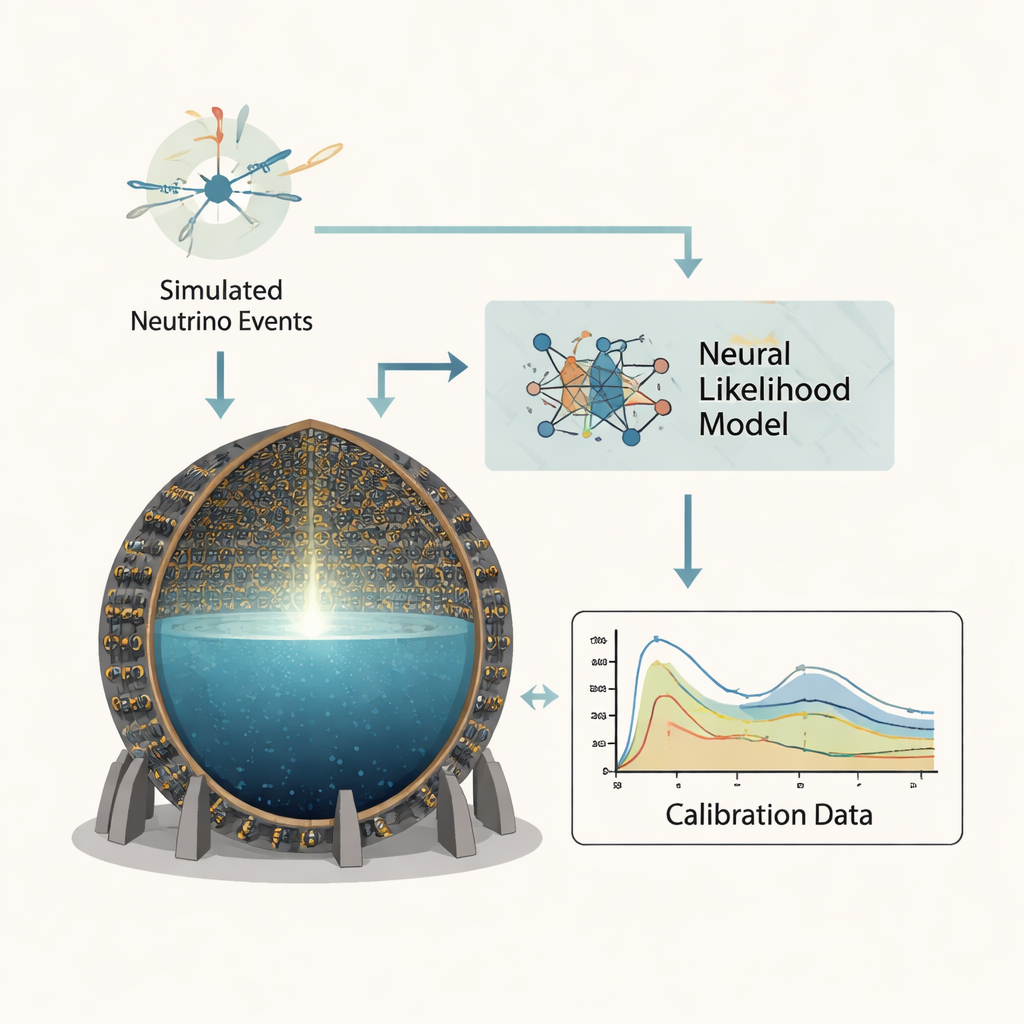

Insegnare alle reti neurali a emulare il simulatore

Gli autori adottano una strategia nota come inferenza basata sulla simulazione, dove invece di tentare di scrivere una formula matematica esatta per la risposta del rivelatore si lascia che siano le simulazioni e le reti neurali a fare il lavoro pesante. Si concentrano su tre parametri chiave che governano come JUNO converte l’energia vera in luce rilevata: un coefficiente che descrive come la produzione di luce viene «quenchata» ad alta densità di ionizzazione, un rendimento luminoso complessivo che fissa la brillantezza media, e un fattore che controlla la quantità di luce di Čerenkov. Usando il software Monte Carlo ufficiale di JUNO, generano circa un miliardo di eventi di calibrazione simulati da cinque sorgenti radioattive poste al centro del rivelatore, ciascun evento riassunto in un singolo numero: la luce totale raccolta. Questo costituisce il terreno di addestramento per reti neurali che imparano quanto è probabile osservare un dato segnale di luce per qualsiasi scelta dei tre parametri.

Due lenti complementari di machine learning

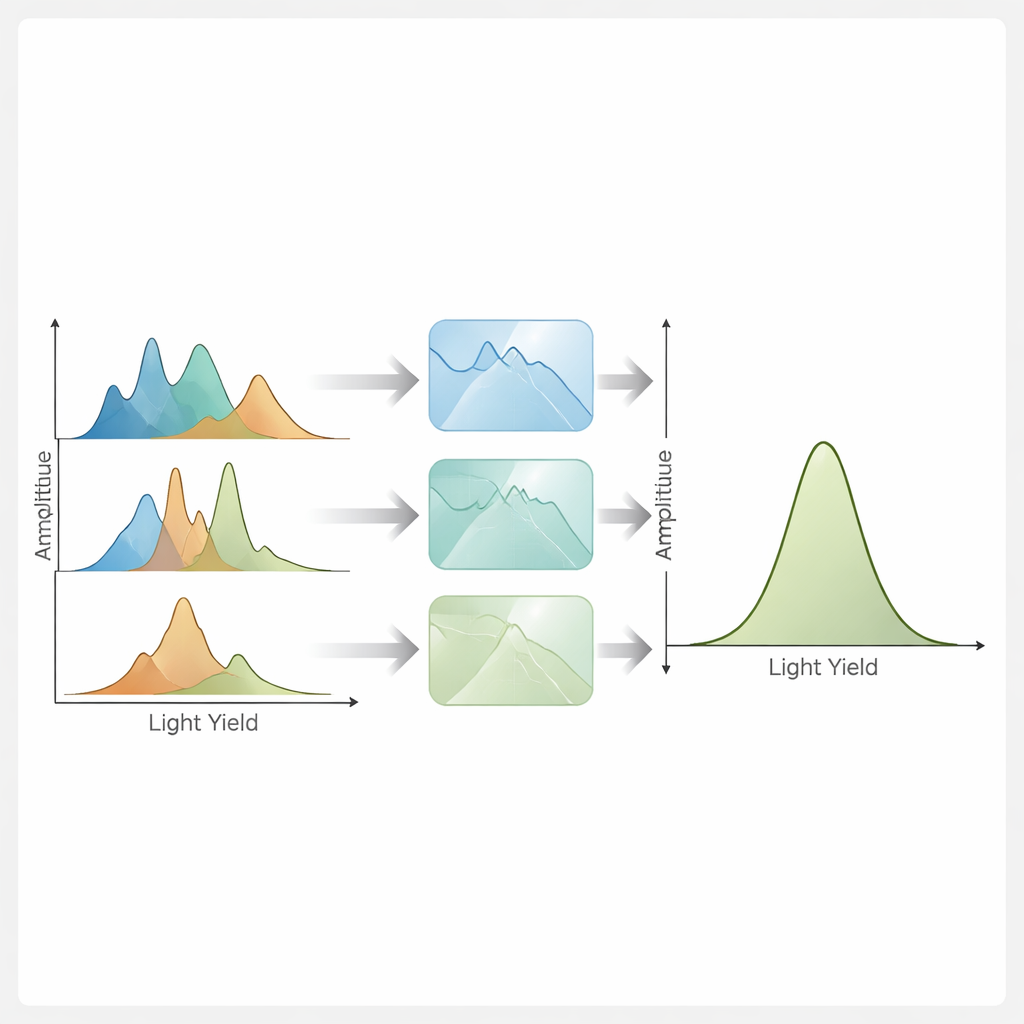

Il team sviluppa due stimatori di likelihood neurali complementari che approssimano la probabilità di osservare un dato segnale di luce per impostazioni specifiche del rivelatore. Il primo, chiamato Transformer Encoder Density Estimator, utilizza un’architettura transformer—la stessa famiglia di modelli dietro molti strumenti linguistici—per prevedere direttamente un istogramma finemente suddiviso dello spettro luminoso per ogni combinazione di parametri e sorgente. Questo supporta in modo naturale le analisi statistiche tradizionali a bin. Il secondo, chiamato Normalizing Flows Density Estimator, usa una catena di trasformazioni invertibili per mappare gli spettri complicati e multimodali in una semplice distribuzione a campana. Poiché queste trasformazioni sono controllate matematicamente, il metodo può valutare la probabilità esatta per ciascun evento non binningato, permettendo analisi che sfruttano l’informazione completa dei dati.

Verificare accuratezza, precisione e robustezza

Per dimostrare che questi strumenti neurali sono affidabili, gli autori li sottopongono a test rigorosi. Innanzitutto verificano se i modelli riescono a riprodurre gli spettri simulati attraverso migliaia di combinazioni dei tre parametri, usando diverse distanze statistiche che confrontano distribuzioni previste e “vere”. Entrambi i metodi seguono picchi netti e sottili caratteristiche spettrali estremamente bene, con discrepanze a livello di poche unità per mille. Poi inseriscono le likelihood apprese in motori statistici consolidati—nested sampling bayesiano, catene di Markov Monte Carlo e minimizzazione classica—per recuperare i parametri originali della simulazione da dataset fittizi. Su un ampio intervallo di valori dei parametri e di statistiche di eventi, i parametri recuperati risultano non distorti e le incertezze dichiarate corrispondono alla dispersione effettiva dei risultati. Le incertezze si riducono con più dati esattamente come previsto dalla statistica dei conteggi di base, e i metodi catturano fedelmente le forti correlazioni tra i parametri.

Da mesi di calcolo a pochi secondi

Un risultato sorprendente è l’accelerazione computazionale. Eseguire simulazioni complete del rivelatore con un numero sufficiente di eventi per caratterizzare ogni punto di parametro può richiedere molte ore per impostazione su un processore convenzionale. Una volta addestrati, tuttavia, il modello transformer può generare uno spettro predetto in pochi millisecondi, e il modello a flussi normalizzanti può valutare probabilità per decine di migliaia di eventi in molto meno di un decimo di secondo. Questo rende realistico scandagliare ampi spazi di parametri e quantificare le incertezze sistematiche che altrimenti sarebbero proibitivamente costose, aprendo la strada a calibrazioni del rivelatore più dettagliate e affidabili.

Cosa significa questo per i futuri esperimenti sui neutrini

Per i non specialisti, il messaggio centrale è che questo lavoro trasforma simulazioni di rivelatori complesse e lente in surrogati rapidi e precisi senza sacrificare il significato fisico. I tre parametri ottimizzati continuano a corrispondere direttamente a proprietà reali del rivelatore e del suo liquido, quindi i risultati restano interpretabili dai fisici. Lo studio mostra che entrambi gli approcci neurali possono determinare questi parametri con bias estremamente piccoli ed errori limitati principalmente dalla quantità di dati disponibile. Mentre esperimenti imminenti come JUNO, DUNE e Hyper-Kamiokande spingono verso precisioni sub-percentuali nelle misure sui neutrini, metodi come questi saranno essenziali per garantire che ciò che inferiamo sull’universo non sia limitato da quanto bene comprendiamo i nostri rivelatori.

Citazione: Gavrikov, A., Serafini, A., Dolzhikov, D. et al. Simulation-based inference for precision neutrino physics through neural Monte Carlo tuning. Commun Phys 9, 63 (2026). https://doi.org/10.1038/s42005-026-02499-6

Parole chiave: rivelatori di neutrini, apprendimento automatico, tuning Monte Carlo, flussi normalizzanti, inferenza basata sulla simulazione