Clear Sky Science · it

Prestazioni indipendenti e collaborative dei grandi modelli linguistici e dei professionisti sanitari nella diagnosi e nel triage

Perché questo è importante per la tua prossima visita dal medico

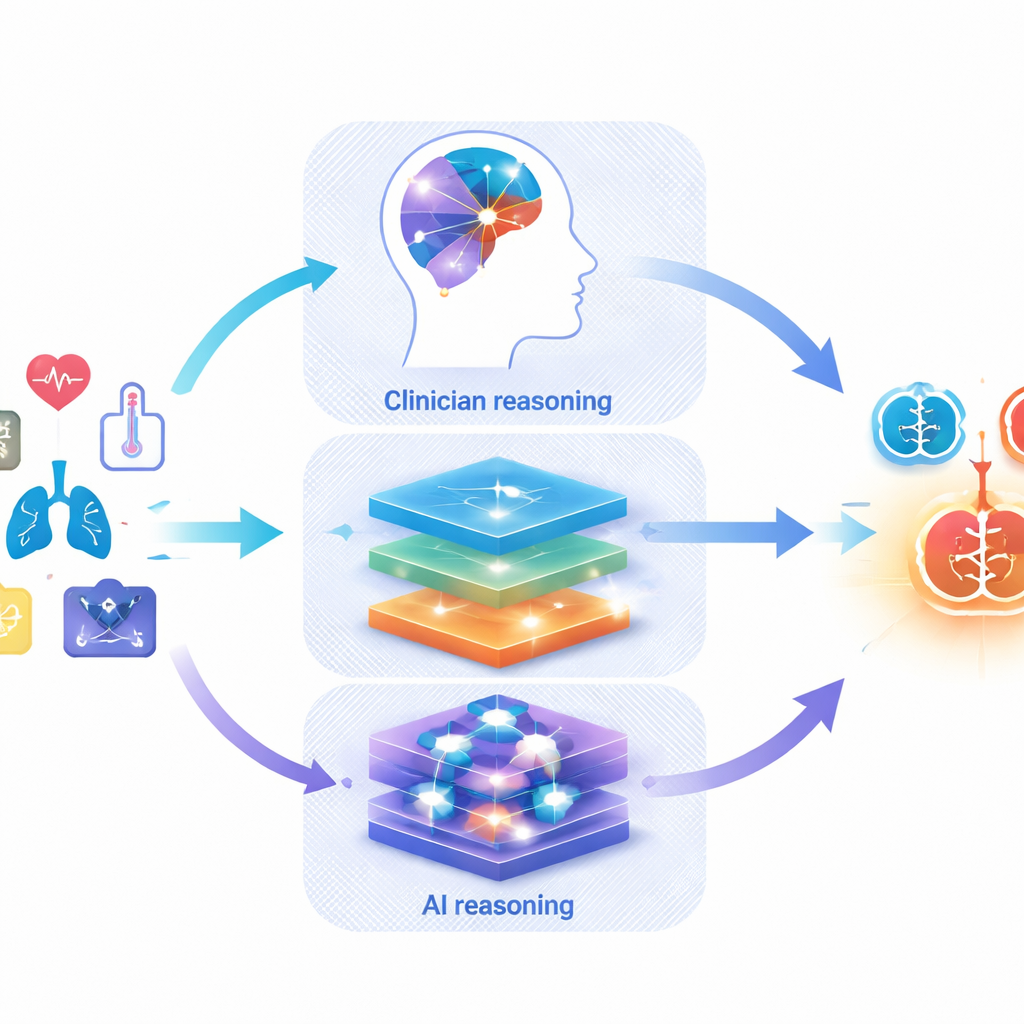

Quando scrivi i tuoi sintomi in un chatbot online o chiedi a un’app di intelligenza artificiale cosa potrebbe non andare, stai usando lo stesso tipo di tecnologia che i medici stanno testando negli ospedali: i grandi modelli linguistici, o LLM. Questo studio pone una domanda semplice ma cruciale: quanto sono efficaci questi strumenti nel diagnosticare le malattie e nel valutare l’urgenza di un caso, rispetto ai professionisti sanitari reali — e cosa succede quando i due lavorano insieme?

Come i ricercatori hanno adottato una visione d’insieme

Gli autori non hanno testato un singolo chatbot in una clinica. Hanno invece combinato le prove di 50 studi distinti condotti in tutto il mondo tra il 2020 e il 2025. Questi studi hanno coperto molte specialità, dalle malattie oculari alle immagini cerebrali fino alle cure d’emergenza. In ciascuno, a medici e a uno o più LLM sono state fornite le stesse descrizioni di casi paziente reali o progettati con cura. Gli LLM dovevano suggerire possibili diagnosi o decidere quanto velocemente un paziente avesse bisogno di cure, mentre i medici facevano lo stesso. In alcuni studi i medici hanno anche visto i suggerimenti dell’AI per valutare se questo li aiutasse a ottenere prestazioni migliori.

Quanto sono bravi i sistemi di AI da soli?

Nel complesso degli studi, gli strumenti di AI spesso riuscivano a includere la diagnosi corretta da qualche parte nella loro lista, ma in genere rimanevano indietro rispetto ai medici quando era richiesto indicare una sola risposta. Se si considerava solo la prima ipotesi, gli LLM risultavano mediamente circa l’11% meno accurati dei professionisti sanitari. Man mano che il numero di ipotesi consentite aumentava, quel divario si riduceva e alla fine scompariva — quando venivano ammesse fino a dieci possibili diagnosi, i sistemi AI erano almeno altrettanto propensi quanto i medici a includere quella corretta. Per le decisioni di triage — valutare l’urgenza e il livello di assistenza necessario — AI e umani si sono comportati in modo simile nel complesso. Tuttavia, i risultati variavano molto tra i singoli modelli e i diversi protocolli di test, suggerendo che alcuni strumenti sono molto più affidabili di altri.

Cosa succede quando i medici usano l’AI come compagno di lavoro?

Nove studi hanno esaminato direttamente la collaborazione: i medici hanno prima lavorato da soli e poi hanno ripetuto il compito con l’aiuto di un LLM. Qui le notizie sono incoraggianti. Supportati dall’AI, i medici hanno mostrato una maggiore accuratezza complessiva, soprattutto quando potevano indicare più possibili diagnosi. Per esempio, con l’aiuto di un LLM la loro accuratezza su liste di candidati brevi è migliorata di circa il 10–40%, a seconda del numero di opzioni considerate. Questo suggerisce che l’AI è particolarmente utile come partner di brainstorming che amplia l’insieme di ipotesi e spinge i clinici a considerare condizioni meno ovvie, mentre l’esperto umano rimane responsabile della decisione finale.

Perché i risultati odierni possono sembrare migliori della realtà

Nonostante i numeri apparenti promettenti, gli autori avvertono che la maggior parte degli studi esistenti è lontana dalla perfezione. Molti si sono basati su riassunti di casi ordinati in stile manuale o su casi rari scelti a fini didattici, e non sulle storie disordinate e incomplete che i pazienti presentano nelle cliniche reali. Solo pochi hanno usato pazienti in tempo reale. Spesso mancavano dettagli su come i casi erano stati selezionati, su come gli strumenti AI erano stati configurati e su come erano state giudicate le risposte. Informazioni visive come esami o foto della pelle sono state usate meno frequentemente e, quando sono state testate solo immagini, clinici esperti hanno chiaramente superato l’AI. I ricercatori sottolineano inoltre che clinici junior ed esperti possono reagire in modo diverso ai consigli dell’AI, e che questioni come la privacy dei dati, i bias nascosti e la sovra‑fiducia nelle proposte della macchina restano in gran parte non testate nella pratica quotidiana.

Cosa significa questo per i pazienti e per il futuro dell’assistenza

Nel complesso, lo studio suggerisce che gli attuali chatbot e LLM non sono pronti a sostituire il tuo medico, ma potrebbero presto diventare assistenti preziosi. Usati con buon senso, possono aiutare a generare liste più ampie di possibili diagnosi e a sostenere decisioni più accurate, soprattutto quando i medici restano al comando e considerano l’AI come un secondo parere piuttosto che un verdetto definitivo. Prima che questi strumenti vengano integrati nella cura di routine, tuttavia, gli autori sostengono che sono necessari trial real‑world meglio progettati, standard di rendicontazione più chiari e robuste salvaguardie sulla sicurezza, l’equità e la privacy. Per i pazienti, questo significa che l’AI potrebbe eventualmente aiutare il tuo team di cura a pensare più ampiamente e ad agire più rapidamente, ma qualsiasi sistema affidabile deve essere testato con la stessa rigore di un nuovo farmaco o dispositivo medico.

Citazione: Chen, M., Wu, Y., Ma, J. et al. Independent and collaborative performance of large language models and healthcare professionals in diagnosis and triage. npj Digit. Med. 9, 222 (2026). https://doi.org/10.1038/s41746-026-02409-8

Parole chiave: diagnosi medica AI, triage clinico, grandi modelli linguistici, collaborazione medico-AI, sicurezza della salute digitale