Clear Sky Science · it

Collaborazione tra esseri umani e modelli linguistici di grande dimensione nella medicina clinica: revisione sistematica e meta-analisi

Perché questo conta per l’assistenza sanitaria di tutti i giorni

I medici si rivolgono sempre più spesso a potenti chatbot di intelligenza artificiale, chiamati modelli linguistici di grande dimensione, per aiutarli a ragionare su casi complessi, redigere note e interpretare esami medici. Questo studio pone una domanda semplice ma cruciale: quando i medici collaborano con questi strumenti, i pazienti ne beneficiano davvero? Riunendo i risultati delle migliori sperimentazioni disponibili, gli autori mostrano che la risposta è più complessa rispetto all’hype: a volte la collaborazione aiuta, a volte produce pochi effetti e in alcune situazioni può perfino ostacolare.

Cosa hanno esaminato i ricercatori

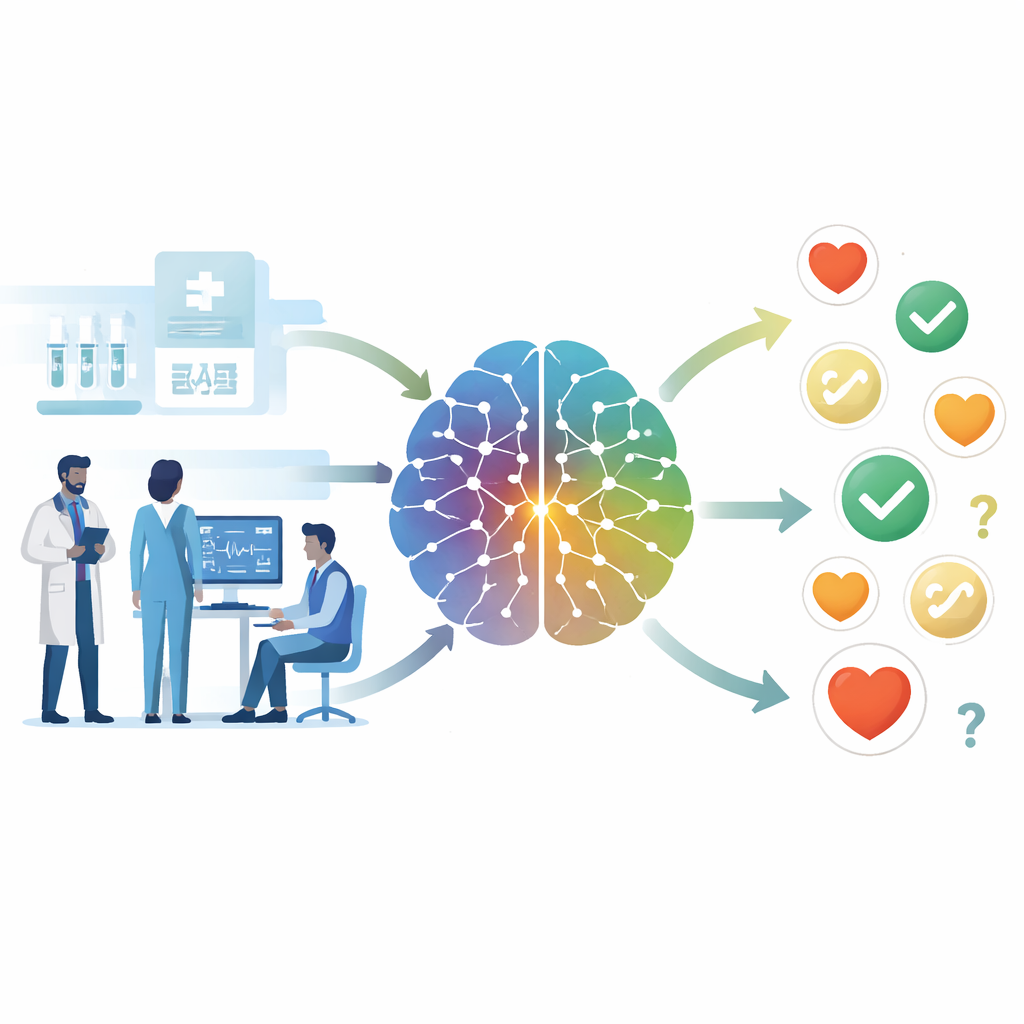

Il gruppo ha condotto una ricerca sistematica nelle principali banche dati mediche per trovare studi in cui i clinici lavoravano con o senza l’aiuto di un sistema di IA basato su modelli linguistici di grande dimensione come GPT-4. Per essere inclusi, gli studi dovevano confrontare direttamente un flusso di lavoro “medico più IA” con la cura abituale fornita dai soli medici e talvolta anche con l’IA operante da sola. I compiti clinici coprivano una gamma di problemi reali: capire cosa potesse avere un paziente critico, interpretare immagini cerebrali, scrivere e leggere note di ambulatorio e decidere come gestire dolore toracico e altri sintomi comuni. In totale, 10 trial peer‑reviewed hanno costituito l’ossatura dell’analisi, con alcuni preprint aggiuntivi usati solo per verificare la robustezza delle conclusioni.

Quanto bene hanno funzionato le squadre medico–IA

Nel complesso, affiancare i medici con l’IA ha mostrato miglioramenti piccoli ma rilevabili in alcune misure di qualità diagnostica e di gestione. In due trial randomizzati che utilizzavano punteggi dettagliati per le decisioni sui casi, le squadre medico–IA hanno ottenuto punteggi di circa cinque punti percentuali superiori rispetto ai soli medici. In termini pratici, se un medico da solo prendeva circa 100 decisioni chiave, aggiungere l’IA potrebbe evitare grosso modo cinque decisioni sbagliate. Tuttavia, gli autori sottolineano che i dati sottostanti sono scarsi: solo un paio di trial hanno contribuito a queste stime e l’intervallo di risultati plausibili nel mondo reale è abbastanza ampio da includere l’assenza di beneficio — o persino danno — in altri contesti.

Velocità, documentazione ed errori nascosti

Molti sperano che l’IA liberi tempo ai medici. Qui le evidenze sono state deludenti. Combinando tre trial che misuravano la durata delle attività, i ricercatori non hanno riscontrato risparmi di tempo complessivi significativi. In alcuni esercizi simulati i medici sono risultati leggermente più rapidi con l’IA; in uno studio in una clinica reale l’effetto netto sulla durata della visita è stato quasi nullo, sebbene alcuni sottogruppi abbiano mostrato guadagni modesti. Anche la documentazione ha raccontato una storia «mista». L’assistenza dell’IA spesso rendeva le note più chiare e strutturate e aiutava i non specialisti a comprendere meglio referti tecnici dell’oculistica. Tuttavia, quando i ricercatori hanno verificato i fatti, hanno trovato che circa una nota su tre supportata dall’IA conteneva ancora errori. Questa dicotomia — cartelle dall’aspetto migliore che possono comunque essere sbagliate — solleva evidenti problemi di sicurezza.

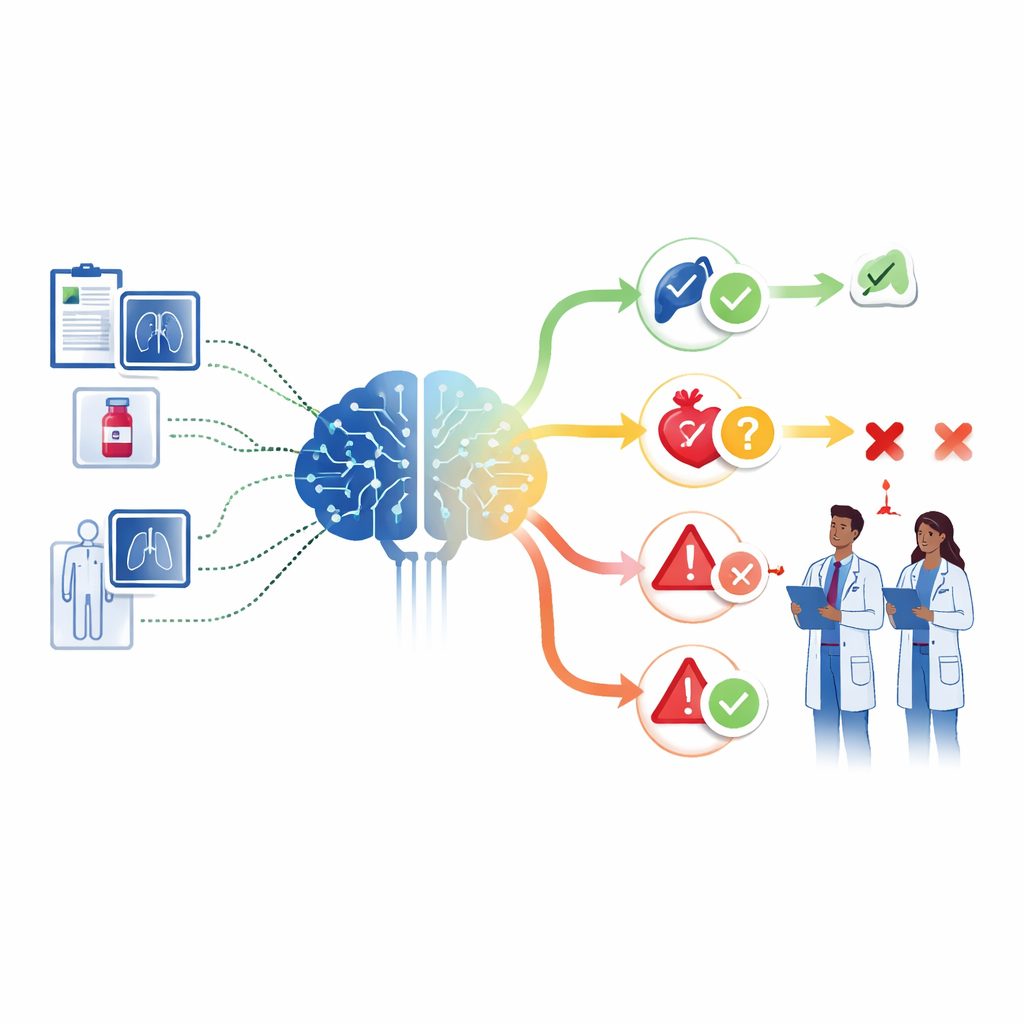

Quando collaborare non batte la macchina

Un risultato sorprendente è emerso dai trial che hanno testato anche l’IA da sola. In uno studio su pazienti critici, l’IA operante da sola ha fatto più o meno quanto il team medico–IA e meglio di molti medici che lavoravano da soli. In un altro, i referti generati dall’IA erano nettamente inferiori a quelli prodotti da esperti umani, sia che l’IA venisse usata come assistente sia no. Nel complesso, questi risultati evidenziano quello che gli autori chiamano un «paradosso della collaborazione»: inserire semplicemente un umano nel processo non garantisce un miglioramento rispetto a un’IA potente e, in alcune situazioni, la collaborazione può diluire i punti di forza di entrambi. Fattori come il modo in cui viene presentato il consiglio, quanto i medici si fidano o diffidano di esso e come lo strumento è integrato nel flusso di lavoro quotidiano influenzano tutti se la collaborazione aiuta o ostacola.

Cosa significa questo per il futuro delle squadre medico–IA

Complessivamente, la revisione dipinge un quadro di promessa cauta più che di una rivoluzione già avvenuta. Le squadre medico–IA possono migliorare modestamente alcuni punteggi decisionali e rendere la scrittura medica più leggibile, ma non risparmiano tempo in modo affidabile e continuano a generare un numero preoccupante di errori fattuali. Gli autori sostengono che i sistemi sanitari dovrebbero introdurre questi strumenti gradualmente, con robuste salvaguardie che si concentrino sull’individuazione degli errori più che sul semplice aumento dell’efficienza. Chiedono inoltre trial clinici più ampi e real‑world che testino l’assistenza dell’IA in ospedali e cliniche affollati, non solo in simulazioni controllate. Fino all’arrivo di tale evidenza, il percorso più sicuro è considerare i modelli linguistici di grande dimensione come assistenti potenti ma fallibili — e progettare flussi di lavoro in cui i clinici agiscano come revisori critici e guardiani, non come accettatori passivi, dei consigli forniti dall’IA.

Citazione: Wang, G., Zhang, K., Jiang, J. et al. Human–large language model collaboration in clinical medicine: a systematic review and meta-analysis. npj Digit. Med. 9, 195 (2026). https://doi.org/10.1038/s41746-026-02382-2

Parole chiave: collaborazione uomo–IA, supporto decisionale clinico, modelli linguistici di grande dimensione, accuratezza diagnostica, documentazione medica