Clear Sky Science · it

DARE-FUSE: apprendimento guidato da evidenze allineate per la segmentazione e la classificazione congiunta delle risonanze magnetiche cerebrali

Perché scansioni cerebrali più intelligenti sono importanti

I tumori cerebrali sono fra le diagnosi più temute in medicina, e la risonanza magnetica (MRI) è lo strumento principale che i medici utilizzano per vedere dove inizia e dove finisce un tumore. Tuttavia anche i radiologi esperti possono avere difficoltà a delineare con precisione un tumore e a valutare come cambia nel tempo, soprattutto quando i suoi margini si confondono con il tessuto cerebrale edematoso. Questo articolo presenta DARE-FUSE, un nuovo sistema di intelligenza artificiale progettato per leggere le MRI cerebrali in modo più affidabile, tracciando confini tumorali più netti e offrendo spiegazioni più chiare delle proprie decisioni per supportare chirurghi, oncologi e pazienti.

Margini sfocati e reparti affollati

Negli ospedali reali, le MRI cerebrali sono spesso imperfette. I tumori si fondono con l’edema circostante, impianti metallici possono distorcere l’immagine e diversi centri usano impostazioni di scansione leggermente differenti. I radiologi devono scorrere manualmente centinaia di immagini, segnare il tumore slice per slice e poi decidere come si sta comportando. Quel lavoro è dispendioso in termini di tempo, stancante e soggetto a disaccordi tra esperti. Gli strumenti di IA esistenti possono aiutare a delineare i tumori o a etichettare le scansioni come “tumore” o “assenza di tumore”, ma la maggior parte dei sistemi svolge questi compiti separatamente, e molti vacillano quando le immagini provengono da nuovi centri o presentano crescite marginali sottili e irregolari.

Un assistente IA unificato per mappe tumorali e etichette

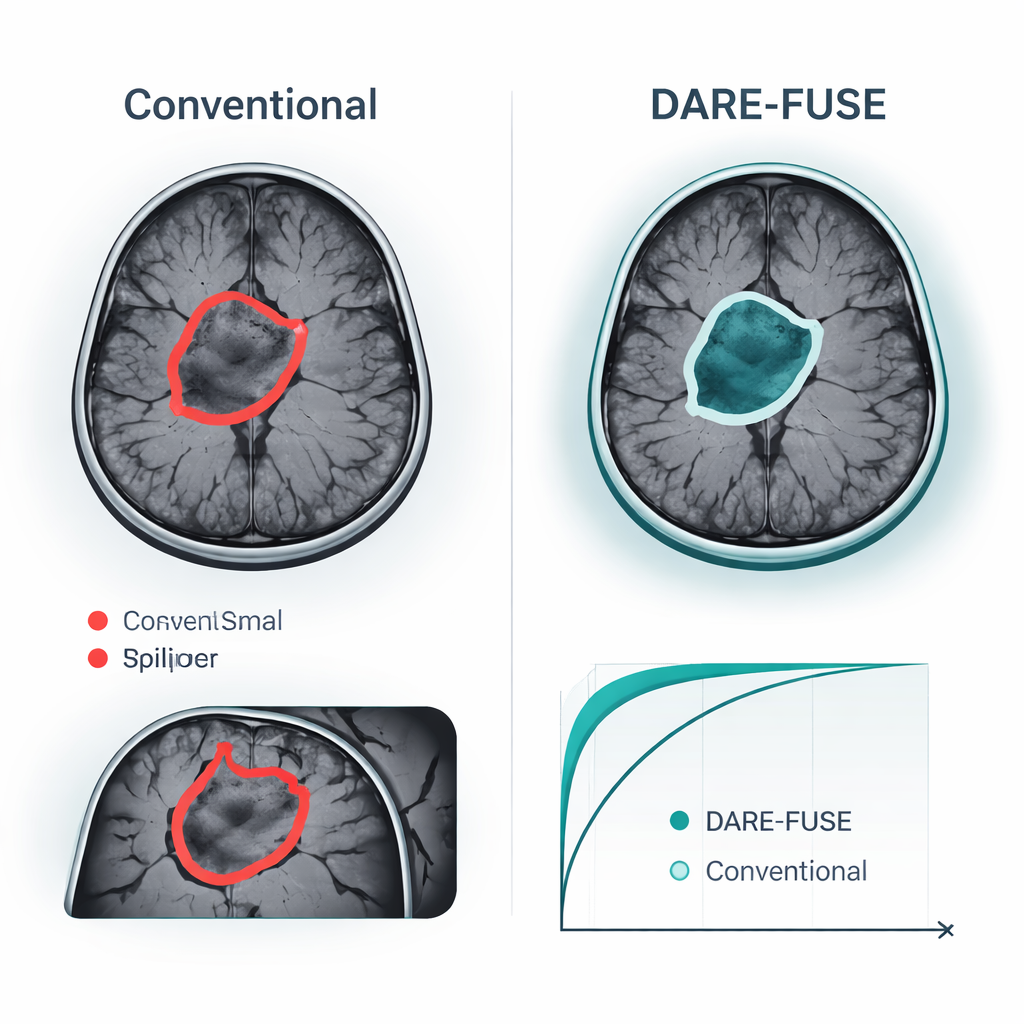

DARE-FUSE affronta diversi di questi ostacoli in modo congiunto. È concepito come una singola pipeline che sia traccia il tumore in ogni slice di MRI (segmentazione) sia classifica le immagini a livello diagnostico (classificazione). Al suo centro ci sono due “viste” cooperanti: una rete sintonizzata sulle forme dettagliate e sui confini, e un’altra orientata ai pattern globali che distinguono i diversi tipi di tumore. Un modulo di allineamento speciale mantiene queste viste sincronizzate tra ospedali e scanner, così le caratteristiche apprese da un dataset non compromettono le prestazioni su un altro. Il sistema stima inoltre la propria incertezza, segnalando le aree in cui è meno sicuro sull’esatto contorno tumorale, un elemento cruciale per un uso clinico sicuro.

Usare indizi da heatmap e ricostruzioni “senza tumore”

Piuttosto che fidarsi di un singolo segnale, DARE-FUSE apprende da più tipi di evidenza. Un ramo produce heatmap che mostrano quali parti del cervello supportano maggiormente la decisione di classificazione dell’IA. Un altro ramo usa un modello generativo per immaginare come sarebbe la stessa scansione se il tumore fosse stato rimosso, quindi confronta quella versione “senza tumore” con l’originale. Le differenze tra le due evidenziano cambiamenti strutturali sottili e bordi che potrebbero non emergere con forza su una heatmap standard. Un modulo di fusione combina quindi questi indizi in una mappa continua di “prior tumorale”: le regioni in cui più fonti concordano vengono trattate come nucleo tumorale, mentre le aree meno certe vengono aggiunte con più cautela e pesate meno quando l’incertezza del modello è alta. Questo prior fuso guida il contorno finale, aiutando a evitare sia porzioni tumorali mancate sia isole spurie nel tessuto sano.

Benefici dimostrati su dataset pubblici di tumori cerebrali

Gli autori hanno testato DARE-FUSE su sei grandi challenge multicentrici di tumori cerebrali (la serie BraTS) e su quattro raccolte pubbliche di MRI utilizzate per la classificazione a livello di immagine. In tutte le edizioni di BraTS, il sistema ha eguagliato o superato i migliori modelli recenti di deep learning, ottenendo una sovrapposizione leggermente maggiore tra le sue maschere tumorali previste e i disegni degli esperti, e errori costantemente più piccoli nella misura della superficie tumorale. Questi miglioramenti erano più marcati nei casi difficili: tumori piccoli, margini a basso contrasto e forme complesse e irregolari. Nei compiti di classificazione — decidere, per esempio, se una scansione mostra un glioma, un meningioma, un tumore ipofisario o assenza di tumore — DARE-FUSE ha anche superato solidi baseline basati su transformer e su supervisione debole in termini di accuratezza e di una misura standard di discriminazione (AUC). È importante notare che, quando i ricercatori hanno ridotto artificialmente il numero di annotazioni dettagliate, il nuovo sistema si è degradato in modo graduale mantenendo comunque un vantaggio rispetto a concorrenti semi-supervisionati e debolmente supervisionati.

Cosa potrebbe significare per i pazienti

Per pazienti e clinici, la promessa principale di DARE-FUSE non è un algoritmo appariscente, ma un supporto di imaging più affidabile e interpretabile. In pratica, il sistema potrebbe proporre un contorno tumorale, evidenziare le regioni in cui è meno sicuro e mostrare heatmap che spiegano quali aree dell’immagine guidano la classificazione. I medici potrebbero accettare le regioni a bassa incertezza come contorno di partenza e concentrarsi sulle aree segnalate invece di ridisegnare tutto da zero. Misurazioni del volume e della forma tumorale più accurate e coerenti potrebbero migliorare la pianificazione del trattamento, il targeting radioterapico e il monitoraggio della risposta nel tempo. Pur sottolineando che lo strumento è un assistente — non un sostituto — del giudizio esperto, i risultati indicano la possibilità di sistemi di IA che vedono i tumori più chiaramente e comunicano il loro livello di fiducia in modi utilizzabili dai clinici.

Citazione: Liu, Y., Sun, C., Niu, Y. et al. DARE-FUSE: domain aligned evidence guided learning for joint brain tumor MRI segmentation and classification. npj Digit. Med. 9, 178 (2026). https://doi.org/10.1038/s41746-026-02365-3

Parole chiave: risonanza magnetica tumore cerebrale, segmentazione di immagini mediche, deep learning in radiologia, supporto decisionale clinico, IA consapevole dell'incertezza