Clear Sky Science · it

Scalare la scienza normativa dei dispositivi medici con grandi modelli linguistici

Perché questo conta per pazienti e medici

La medicina moderna si sta rapidamente popolando di dispositivi “intelligenti” che utilizzano l’intelligenza artificiale per leggere scansioni, monitorare i segni vitali e assistere i medici nelle decisioni. Solo negli Stati Uniti, più di mille di questi strumenti sono già stati autorizzati o approvati dalla Food and Drug Administration (FDA). Ogni dispositivo lascia una traccia cartacea fatta di complesse relazioni e registri di sicurezza. Oggi la maggior parte di queste informazioni viene ancora esaminata manualmente, un processo lento, costoso e destinato a restare indietro rispetto alla realtà. Questo articolo indaga se i grandi modelli linguistici—lo stesso tipo di IA alla base dei chatbot avanzati—possano leggere in modo affidabile tali documenti su vasta scala e trasformarli in dati utilizzabili per aiutare regolatori, ricercatori e pubblico a capire come sono costruiti questi dispositivi e quanto siano sicuri.

Il problema dell’eccesso di documenti complessi

Ogni dispositivo medico basato su IA è accompagnato da ampie sintesi decisionali, rapporti di sicurezza e avvisi di richiamo. Questi documenti sono lunghi, scritti in gergo denso e spesso includono tabelle, immagini e formattazioni non uniformi. Ricerche precedenti hanno mostrato che rispondere a domande di base—come in che modo un dispositivo è stato testato prima dell’approvazione, o cosa sia effettivamente andato storto in caso di malfunzionamento—ha richiesto team di esperti che leggessero centinaia di PDF riga per riga. Strumenti di ricerca semplici e tecniche di rilevamento di pattern possono individuare dettagli ovvi come numeri di identificazione, ma faticano con questioni più profonde che richiedono giudizio, per esempio se uno studio è stato condotto in più ospedali o se un dispositivo ha effettivamente contribuito a una lesione o a un decesso del paziente. Con l’esplosione del numero di dispositivi abilitati all’IA, questo approccio manuale è diventato impossibile da sostenere.

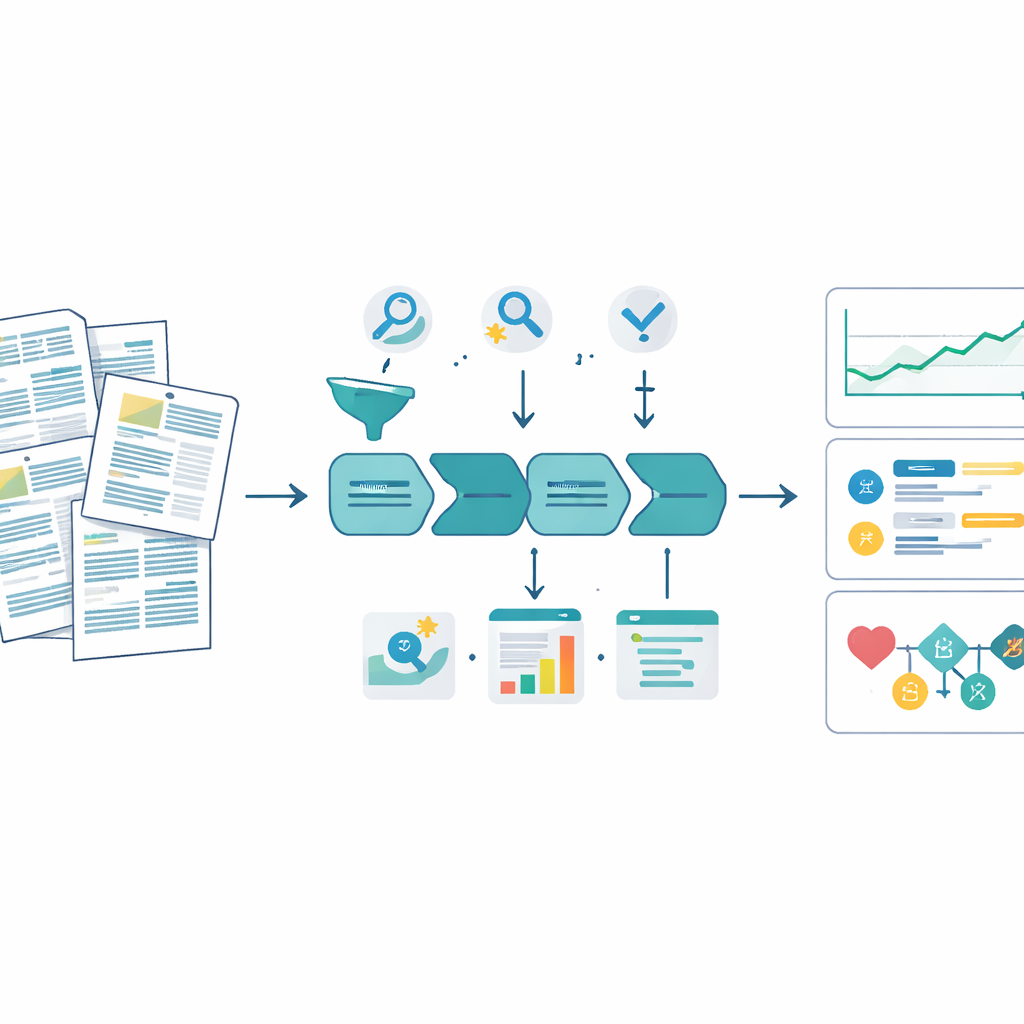

Una pipeline di IA che legge come un esperto

Gli autori hanno costruito una pipeline generale basata su un grande modello linguistico all’avanguardia per affrontare questa sfida. Per prima cosa hanno raccolto tutte le sintesi decisionali e i rapporti di sicurezza pubblicamente disponibili della FDA per 1.247 dispositivi basati su IA o apprendimento automatico e 1.852 segnalazioni di eventi avversi correlate fino alla metà del 2025, pulendo i PDF e utilizzando il riconoscimento ottico dei caratteri quando necessario. Poi, invece di chiedere al modello di rispondere a domande ampie tutte in una volta, hanno scomposto il lavoro in sottocompiti più piccoli e ben definiti. Per ogni tipo di documento, il modello ha ricevuto istruzioni dettagliate radicate nelle linee guida ufficiali della FDA più esempi di come gli esseri umani etichettano l’informazione. Al modello è stato chiesto di ragionare passo dopo passo e di produrre le risposte in un formato rigoroso e strutturato, trasformando il testo libero in campi chiari come “numero di siti dello studio”, “tipo di evento di sicurezza” o “tipo di modifica del dispositivo”.

Verificare l’accuratezza su domande regolatorie reali

Per capire se il sistema poteva essere considerato affidabile, il team ha eseguito tre studi di caso in cui ricerche precedenti avevano già impiegato mesi di revisione manuale. Prima, hanno rivisitato come i dispositivi vengono testati prima dell’approvazione chiedendo se gli studi fossero stati condotti prospetticamente (raccogliendo dati in avanti) e se coinvolgessero più ospedali. Confrontando le uscite del modello con le etichette degli esperti, hanno osservato tassi di accordo spesso superiori all’80–90 percento, confrontabili con l’accordo tra annotatori umani. Secondo, hanno utilizzato il modello per rietichettare rapporti di sicurezza che descrivevano malfunzionamenti, lesioni o decessi e per classificare cosa fosse andato storto nel dispositivo. Quando i revisori umani hanno confrontato i codici originali del produttore con quelli suggeriti dal modello—senza sapere quale fosse quale—hanno preferito le scelte del modello nella larga maggioranza dei casi, specialmente per categorie sensibili come morte rispetto a malfunzionamento. Terzo, i ricercatori hanno collegato i dettagli dei documenti pre‑approvazione ai successivi rapporti di sicurezza per esplorare quali scelte iniziali—come la selezione di un dispositivo predecessore con richiami precedenti o l’introduzione di cambiamenti hardware significativi—fossero statisticamente associate a un rischio maggiore di problemi futuri.

Cosa rivelano i risultati sulla sicurezza e la sorveglianza

Una volta convalidata, la pipeline ha permesso al team di ampliare queste analisi da dozzine di dispositivi all’intera popolazione nota di strumenti medici abilitati all’IA. Hanno scoperto, per esempio, che le valutazioni cliniche prospettiche sono rimaste relativamente rare nell’arco di tre decenni, aggirandosi intorno a un dispositivo su dieci, mentre le menzioni di test multi‑sito sono cresciute sostanzialmente. Nei rapporti di sicurezza, il modello ha individuato schemi in cui il tipo di problema descritto nel testo non corrispondeva al codice inviato alla FDA—forse situazioni in cui guasti hardware venivano etichettati come problemi di qualità dell’immagine. Quando hanno collegato le caratteristiche pre‑approvazione agli eventi di sicurezza successivi, i dispositivi i cui predecessori avevano già richiami o storie di eventi avversi hanno mostrato rischi significativamente più elevati di nuove segnalazioni, mentre i dispositivi supportati da test clinici tendevano ad avere un rischio inferiore. Questi risultati sono esplorativi ma illustrano il tipo di domande che ora possono essere poste regolarmente invece che come progetti isolati.

Limiti, salvaguardie e la strada da percorrere

Gli autori sottolineano che il loro approccio non è infallibile e non dovrebbe sostituire il giudizio di esperti. Un’accuratezza intorno all’80 percento può essere più che sufficiente per analizzare tendenze di ampio respiro ma non per prendere decisioni su un singolo dispositivo o paziente. Le prestazioni possono variare a seconda del tipo di dispositivo e dell’anno, e la qualità dei documenti FDA di base e delle banche dati di sicurezza rimane un collo di bottiglia importante. Tuttavia, questo studio mostra che sistemi basati su modelli linguistici progettati con cura possono trasformare montagne di testo normativo non strutturato in dati strutturati e verificabili in giorni anziché anni. Per il lettore non specialista, la conclusione è che le stesse tecnologie IA che alimentano i chatbot consumer possono anche aiutare i controllori e i ricercatori a monitorare come i dispositivi medici con IA sono progettati, testati e sorvegliati—potenzialmente portando a una più rapida individuazione dei problemi e a evidenze migliori per orientare regole e prodotti più sicuri.

Citazione: Li, H., He, X., Subbaswamy, A. et al. Scaling medical device regulatory science using large language models. npj Digit. Med. 9, 221 (2026). https://doi.org/10.1038/s41746-026-02353-7

Parole chiave: Dispositivi medici con IA, scienza regolatoria, grandi modelli linguistici, segnalazioni di sicurezza FDA, vigilanza sulla tecnologia sanitaria