Clear Sky Science · it

Modellazione dell’incertezza nell’analisi multimodale del linguaggio attraverso lo spettro della psicosi

Ascoltare indizi nascosti nel linguaggio quotidiano

La psicosi è spesso percepita come qualcosa di improvviso e drammatico—voci, visioni e una rottura con la realtà. Ma molto prima di una crisi, possono emergere cambiamenti sottili nel modo in cui le persone parlano: il timbro della voce, la scelta delle parole, persino il ritmo delle frasi. Questo studio esplora se i computer possono cogliere quei segnali deboli nel parlato e, cosa cruciale, indicare quanto siano fiduciosi di ciò che rilevano. Facendo ciò, il lavoro indica possibili strumenti futuri che potrebbero aiutare i clinici a monitorare la salute mentale in modo più oggettivo e a personalizzare le cure lungo tutto lo spettro, dal rischio lieve alla malattia conclamata.

Dal parlato informale alle interviste cliniche

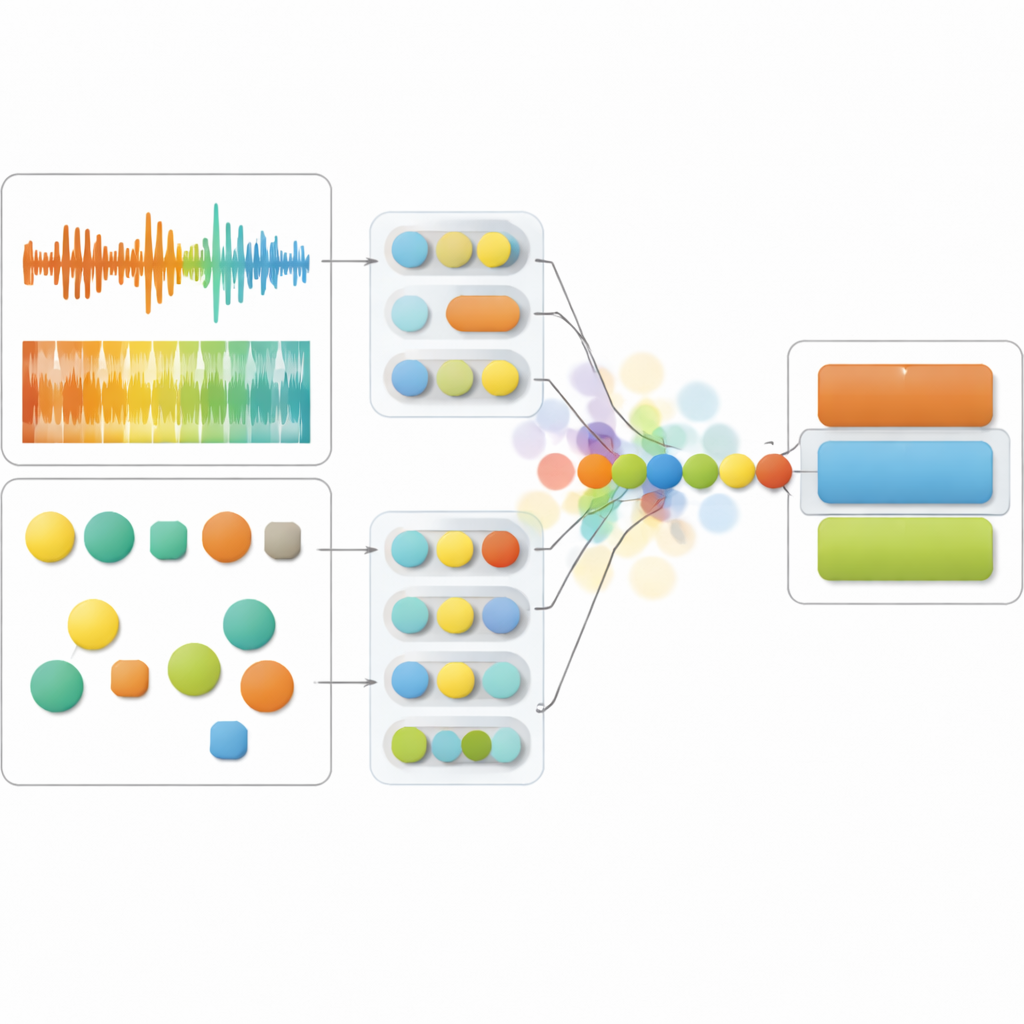

I ricercatori hanno registrato il parlato di 114 volontari di lingua tedesca che coprivano lo spettro della psicosi: persone con disturbi psicotici precoci e persone senza diagnosi ma con livelli bassi o alti di tratti psicotici (noti come schizotipia). Ogni partecipante ha svolto quattro tipi di compiti di parlato, dalle interviste cliniche strutturate a racconti autobiografici più liberi, narrazioni basate su immagini e conversazioni quotidiane. Questi diversi contesti sono importanti perché un’intervista strettamente guidata può far emergere certi sintomi, come l’appiattimento emotivo, mentre narrazioni aperte possono rivelare pensieri vaganti o percezioni insolite. Campionando attraverso i contesti, il team ha potuto osservare quanto affidabilmente il parlato segnalasse i sintomi in situazioni vicine al mondo reale.

Ascoltare sia come parliamo sia cosa diciamo

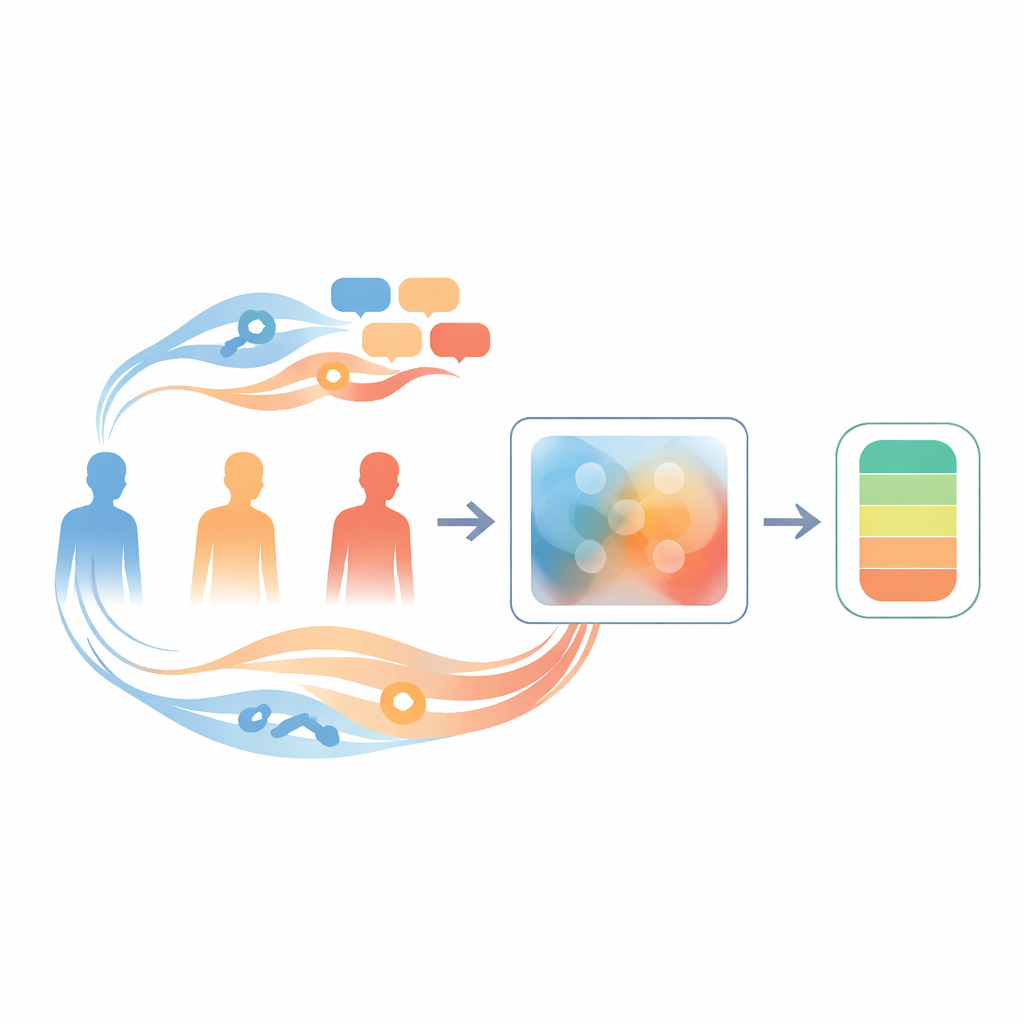

Il sistema dello studio ascolta contemporaneamente due aspetti del parlato. Sul lato sonoro, traccia caratteristiche come variazioni di intonazione, volume e la struttura fine della voce, che insieme catturano espressività, tensione e fluenza. Sul lato linguistico, analizza le parole stesse—quanto emotive sono, se si concentrano su percezioni o relazioni sociali e quanto coerenti appaiono. Reti neurali avanzate, originariamente addestrate su vaste raccolte di audio e testo, trasformano questi segnali grezzi in impronte numeriche compatte. Il modello centrale poi fonde queste impronte nel tempo in modo da poter giudicare, momento per momento, quale canale—suono o linguaggio—fornisca l’indizio più affidabile sullo stato mentale di una persona.

Insegnare al modello ad ammettere quando è incerto

Ciò che distingue questo lavoro è che il modello non fornisce solo una previsione; stima anche la propria incertezza. Invece di trattare i flussi audio e testuali come fissi, li rappresenta come nuvole di probabilità che possono espandersi quando i dati sono rumorosi o insoliti. Se la registrazione vocale è distorta o la persona borbotta, il sistema attenua il canale sonoro e dà più peso alle parole. Se la trascrizione è inaffidabile o il parlato è estremamente frammentato, fa l’opposto. Questa fusione consapevole dell’incertezza, chiamata Temporal Context Fusion, ha raggiunto performance elevate: ha distinto i gruppi a bassa schizotipia, alta schizotipia e psicosi precoce con un F1-score dell’83% e ha mostrato una fiducia ben calibrata, ossia la certezza dichiarata corrispondeva da vicino a quanto spesso il modello risultava effettivamente corretto.

Modelli del parlato che rispecchiano diversi tipi di sintomi

Analizzando il funzionamento interno del modello, i ricercatori hanno identificato quali aspetti del parlato tracciavano in modo più coerente le diverse dimensioni sintomatiche. Le persone con sintomi positivi più intensi—come esperienze insolite o idee deliranti—tendevano a mostrare intonazioni più alte e più variabili, rapidi cambiamenti nello spettro della voce e maggiori oscillazioni di volume, specialmente nelle narrazioni aperte. Il loro linguaggio conteneva anche molte parole legate alla percezione (collegate al vedere, udire o sentire) e termini emotivamente carichi. Al contrario, le persone con sintomi negativi più marcati—come ritiro sociale e appiattimento emotivo—parlavano in modo più monotono, con intonazione ristretta e articolazione meno flessibile, e usavano meno parole relative a emozioni positive e relazioni sociali. Tratti disorganizzati, sia nei pazienti sia nei volontari ad alta schizotipia, si manifestavano come instabilità del volume, esitazioni e linguaggio frammentato pieno di parole legate al rischio e ai processi cognitivi, suggerendo sforzo mentale senza una struttura chiara.

Perché questo è importante per la cura della salute mentale futura

Nel complesso, i risultati mostrano che il parlato porta tracce misurabili di tratti correlati alla psicosi anche in persone non clinicamente malate, e che queste tracce variano a seconda della situazione comunicativa. Il modello che tiene conto dell’incertezza è stato in grado di sfruttare sia il suono sia il linguaggio per tracciare caratteristiche positive, negative e disorganizzate lungo un continuum, segnalando allo stesso tempo quando le prove erano insufficienti. Per un lettore non specialistico, l’idea chiave è che un ascolto attento—amplificato da un’IA che conosce i propri limiti—potrebbe un giorno aiutare i clinici a monitorare la salute mentale in modo più oggettivo, ridurre le congetture e individuare cambiamenti significativi prima. Piuttosto che sostituire il giudizio umano, tali strumenti potrebbero fungere da secondo paio d’orecchie, evidenziando nei discorsi quotidiani schemi che meritano un’attenzione più approfondita.

Citazione: Rohanian, M., Hüppi, R., Nooralahzadeh, F. et al. Uncertainty modeling in multimodal speech analysis across the psychosis spectrum. npj Digit. Med. 9, 218 (2026). https://doi.org/10.1038/s41746-025-02309-3

Parole chiave: psicosi, analisi del linguaggio, apprendimento automatico, valutazione della salute mentale, IA multimodale