Clear Sky Science · it

Fusione multimodale di modelli fondamentali di patologia e radiologia per il sottotipaggio dei gliomi secondo l'OMS 2021

Unire Due Prospettive sui Tumori Cerebrali

Quando a una persona viene diagnosticato un tumore cerebrale, i medici devono sapere non solo che un tumore è presente, ma quale tipo preciso sia. Diversi tipi di tumore rispondono in modo molto diverso a chirurgia, radioterapia e farmaci. Oggi questo dettaglio del “sottotipaggio” richiede di solito test genetici che possono essere lenti, costosi e non sempre disponibili. Questo studio esplora se un sistema informatico avanzato che analizza sia le immagini cerebrali sia le immagini al microscopio del tessuto tumorale possa inferire in modo affidabile questi sottotipi, accelerando e ampliando l’accesso a cure di precisione.

Perché il Tipo di Tumore è Importante

I gliomi diffusi nell’adulto sono tra i tumori cerebrali più letali, eppure spesso appaiono simili sulle scansioni standard e al microscopio. Le linee guida moderne li raggruppano in tre sottotipi genetici che differiscono molto per aggressività e prognosi. Lo standard attuale per distinguerli dipende da test molecolari sul DNA tumorale. Questi test richiedono tessuto aggiuntivo, laboratori specializzati e tempi di attesa che vanno da giorni a settimane. Gli autori si chiedono se le risonanze magnetiche (RM) e le vetrini di patologia digitali raccolti di routine possano essere combinati per estrarre informazioni sufficienti a sostituire in parte questo iter genetico.

Addestrare le Macchine a Leggere Scansioni e Vetrini

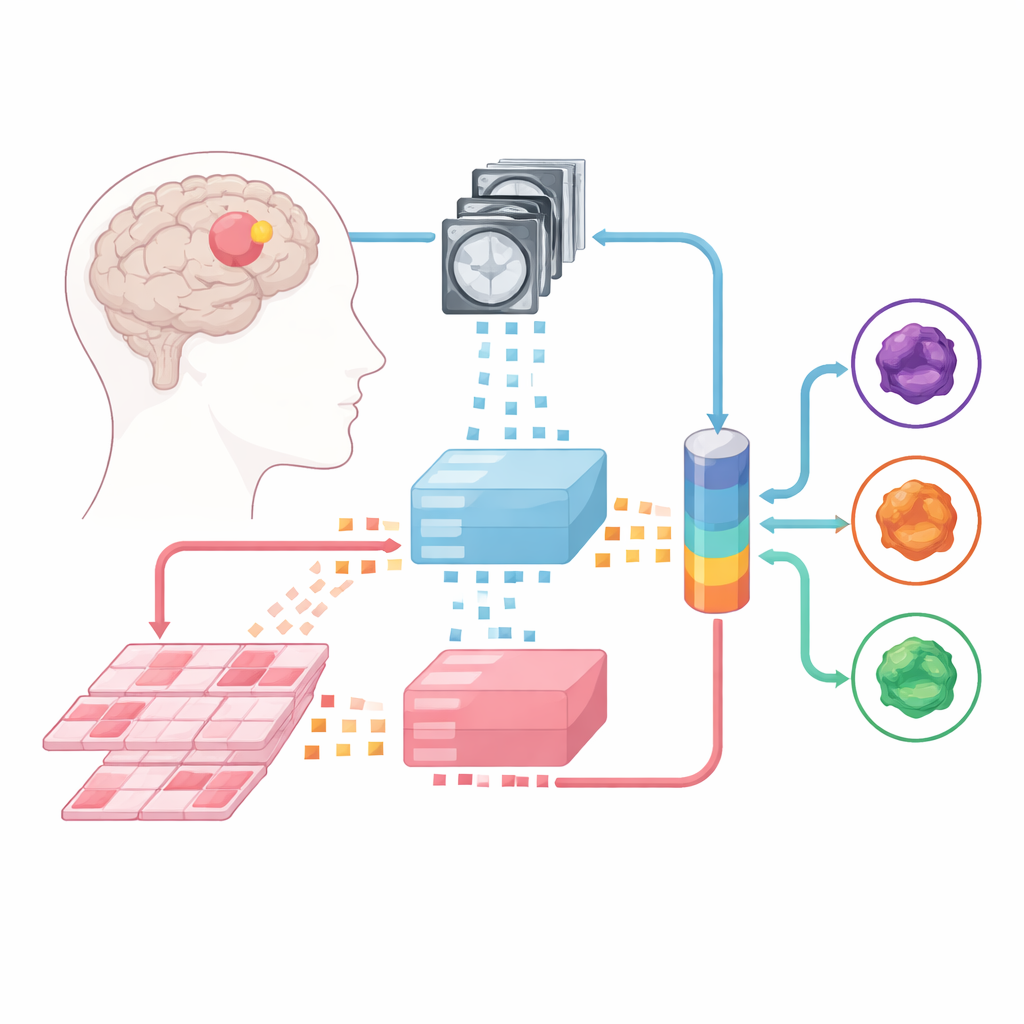

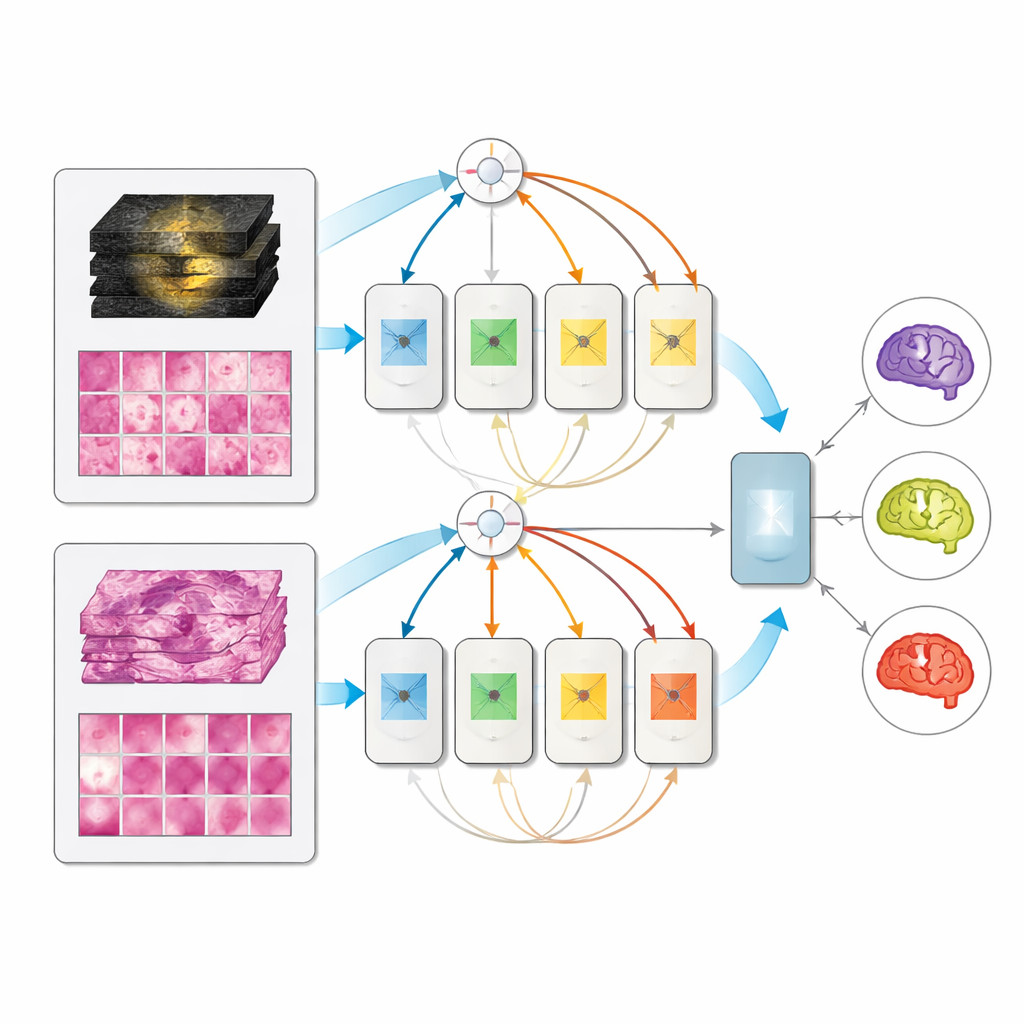

Il gruppo ha costruito il lavoro su grandi “modelli fondamentali” – potenti analizzatori di immagini preaddestrati su enormi collezioni di immagini mediche. Un modello di questo tipo elabora RM multiparametriche, un altro gestisce vetrini di patologia ad alta risoluzione ricavati dal tessuto tumorale. Ogni caso in ingresso viene suddiviso in piccoli tasselli d’immagine, che i modelli fondamentali convertono in impronte numeriche. Sui questi “esperti” fissi, i ricercatori hanno allenato tre tipi di modelli di fusione che imparano a combinare le informazioni di RM e patologia: un’architettura a fusione tardiva, una a fusione precoce e una più flessibile a mixatura di esperti che può decidere dinamicamente quanto affidarsi a ciascuna fonte.

Mescolare le Modalità Senza Abbinarle per Paziente

Un ostacolo pratico per questi metodi multimodali è che gli ospedali raramente dispongono di grandi dataset in cui ogni paziente abbia entrambe le immagini di RM e patologia correttamente abbinate. Invece di affidarsi a dati perfettamente appaiati, gli autori hanno assemblato raccolte separate: centinaia di casi di RM da diversi centri e centinaia di casi di patologia da un’altra risorsa, più un set più piccolo di 171 pazienti provenienti da un progetto pubblico sul cancro che avevano entrambi i tipi di immagini. Durante l’addestramento hanno spesso accoppiato una RM di una persona con un vetrino patologico di un’altra, purché i tumori appartenessero allo stesso sottotipo. Sorprendentemente, i modelli addestrati su tali dati “non appaiati” hanno funzionato tanto bene quanto quelli addestrati su coppie reali di pazienti, e nettamente meglio della semplice media di due modelli monomodali separati.

Un Modello Unico che si Adatta a Quanto è Disponibile

Sul set di test escluso di 171 pazienti completamente caratterizzati, tutti i modelli multimodali hanno superato i corrispondenti modelli a input singolo, e l’architettura a mixatura di esperti è risultata la migliore, raggiungendo punteggi molto elevati nella distinzione dei tre sottotipi. È significativo che, quando al momento del test era fornita solo la RM o solo la patologia, il modello multimodale non collassasse; ha reso circa quanto i modelli dedicati a una sola modalità. Ciò significa che una clinica potrebbe distribuire un unico sistema unificato che usa le informazioni disponibili — solo le scansioni preoperatorie, solo il tessuto post-operatorio, o entrambi — invece di mantenere strumenti separati per ogni scenario.

Vedere Quel che il Modello Vede

Per aumentare la fiducia nelle decisioni del sistema, i ricercatori hanno esplorato dove il modello “guarda” e quali caratteristiche delle immagini contano di più. Le mappe di attenzione hanno mostrato che il modello congiunto distribuisce il focus in modo più ampio sul tumore e sui tessuti circostanti, sia nelle RM sia nei vetrini, e che un’attenzione più diffusa tendeva a coincidere con predizioni corrette. Un’analisi più profonda delle caratteristiche apprese ha rivelato schemi coerenti con indizi medici noti: per esempio, caratteristiche RM che evidenziano i nuclei tumorali a contrasto e spazi fluidi deformati hanno aiutato a separare i tumori più aggressivi, mentre caratteristiche tissutali che catturano forme cellulari e texture classiche hanno facilitato il riconoscimento di sottotipi specifici di glioma. Sono emerse anche lacune interessanti: il modello non codificava fortemente alcuni segni da manuale dei tumori più aggressivi, a sostegno dell’idea che spesso tratti quel gruppo come un “default” a meno che non ci sia forte evidenza a favore di un sottotipo più favorevole.

Cosa Potrebbe Significare per i Pazienti

In termini semplici, questo lavoro mostra che un sistema di IA che combina scansioni cerebrali e immagini al microscopio può classificare i tumori cerebrali più accuratamente rispetto a sistemi che guardano un solo tipo di immagine, e che può essere addestrato anche quando i due tipi di immagine non provengono dagli stessi pazienti. Se validati ulteriormente su gruppi più grandi e diversificati, tali strumenti potrebbero aiutare i medici a stimare il sottotipo tumorale prima e in maniera più diffusa, specialmente dove i test genetici sono limitati. Pur non sostituendo i test molecolari, possono fungere da guide rapide e a basso costo che indirizzano chirurghi e oncologi verso la diagnosi più probabile e il percorso terapeutico più appropriato.

Citazione: Saueressig, C., Scholz, D., Raffler, P. et al. Multimodal fusion of pathology and radiology foundation models for WHO 2021 glioma subtyping. npj Precis. Onc. 10, 118 (2026). https://doi.org/10.1038/s41698-026-01366-5

Parole chiave: sottotipaggio dei gliomi, imaging multimodale, intelligenza artificiale, RM e patologia, diagnosi del cancro cerebrale