Clear Sky Science · it

Un ensemble di vision e swin transformer con spiegazioni basate su LLM per la diagnosi delle malattie delle foglie di canna da zucchero

Perché è importante individuare le foglie di canna da zucchero malate

La canna da zucchero è una coltura fondamentale per lo zucchero, i biocarburanti e il sostentamento di molte comunità rurali, ma le sue foglie sono vulnerabili a una serie di malattie che erodono silenziosamente la resa. Gli agricoltori si affidano di solito all'ispezione visiva, che può essere lenta, incoerente e difficile da scalare su campi estesi. Questo articolo esplora come l'intelligenza artificiale moderna possa leggere automaticamente le foto delle foglie per rilevare con alta accuratezza più malattie della canna da zucchero e poi usare un modello linguistico per trasformare quelle predizioni in consigli in linguaggio semplice per gli agricoltori.

Come le foto delle foglie vengono trasformate in dati

I ricercatori hanno costruito il loro sistema usando una raccolta aperta di immagini di foglie di canna da zucchero disponibile su Kaggle, contenente quasi ventimila foto a colori. Ogni immagine appartiene a una delle sei categorie: sana o una delle cinque malattie comuni, inclusi Blight batterico, Mosaic, Red Rot, Rust e Yellow Leaf Disease. Le foto sono state scattate in condizioni di campo reali, quindi includono variazioni di luce, ombre e sfondi disordinati. Per preparare i dati, il team ha rimosso duplicati e immagini corrotte, quindi ha suddiviso il dataset in insiemi di training, validazione e test mantenendo lo stesso bilanciamento delle tipologie di malattia in ciascuno. Durante l'addestramento hanno applicato aumenti solo alle immagini di training con rotazioni, ribaltamenti e zoom per imitare diverse angolazioni e distanze della fotocamera, rendendo il sistema più robusto senza gonfiare le prestazioni sul test set.

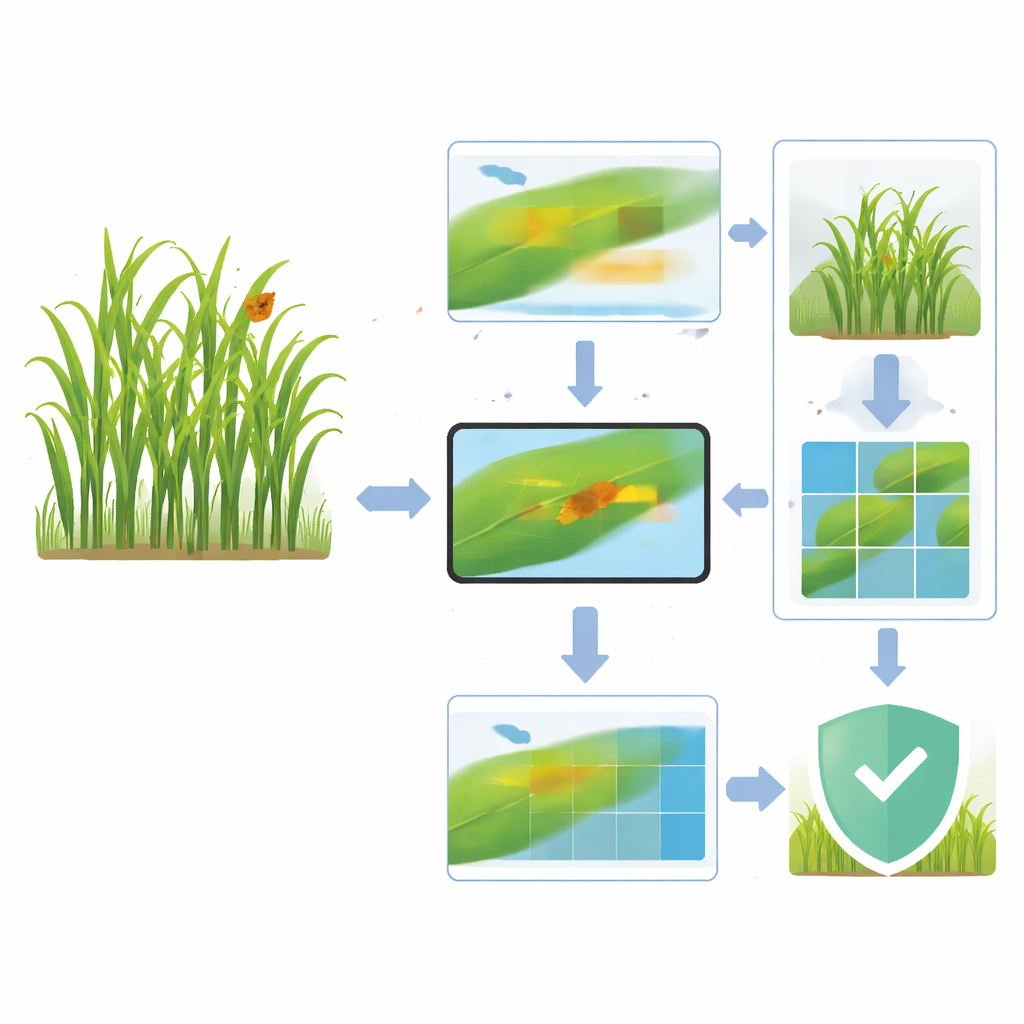

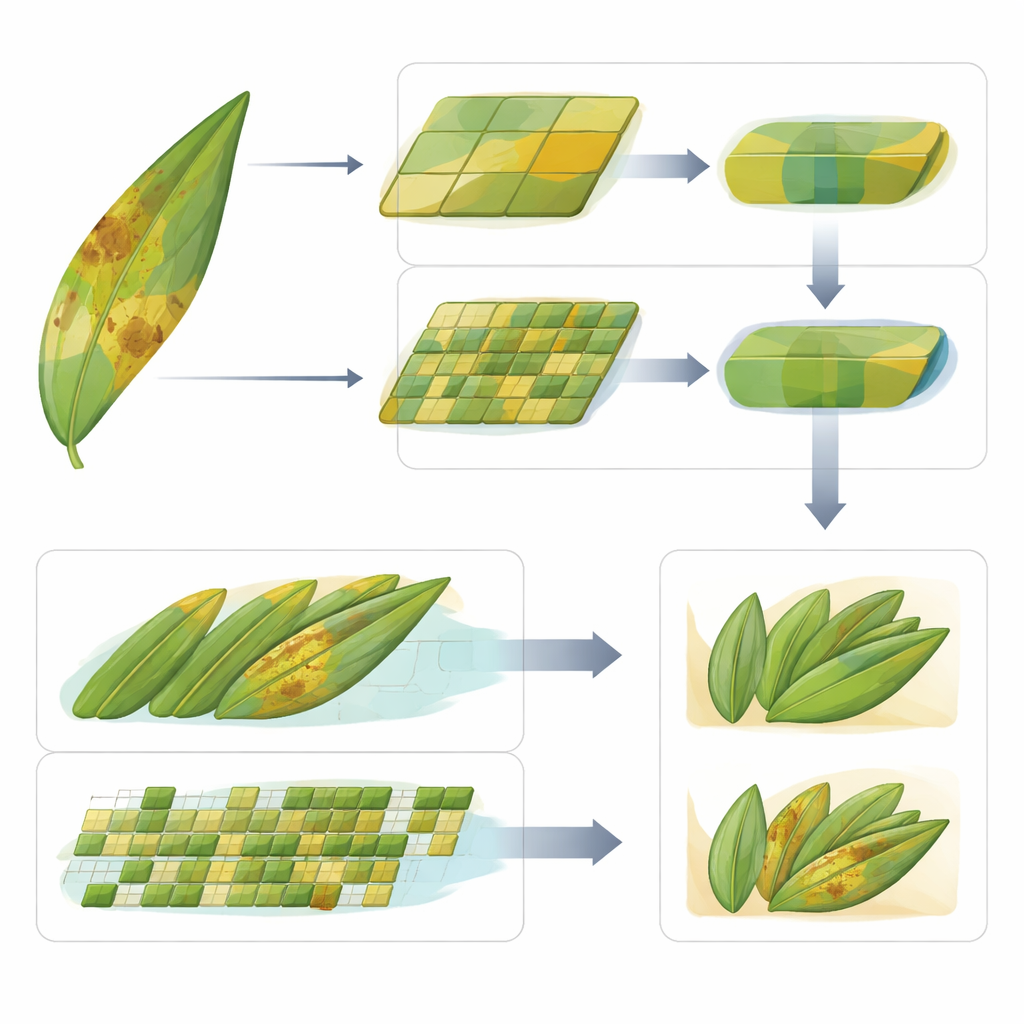

Due modi complementari di osservare una foglia

Al centro dello studio c'è un “ensemble” che combina due modelli di visione avanzati noti come transformer. Uno, il Vision Transformer (ViT), considera ogni immagine come un insieme di patch e impara pattern sull'intera foglia in una sola volta. Questa visione globale è adatta alle malattie che si manifestano come ampie aree diffuse di scolorimento. L'altro, chiamato Swin Transformer, lavora con finestre sovrapposte più piccole che scorrono sull'immagine, costruendo una comprensione stratificata delle texture fini e delle piccole macchie. Questo focus locale aiuta con le malattie che appaiono come lesioni minute, striature o puntini. Per progettazione, ViT è sensibile ai cambiamenti cromatici ampi mentre Swin presta attenzione ai dettagli piccoli e raggruppati—due prospettive di come le vere malattie fogliari si manifestano nei campi.

Come i due modelli uniscono le forze

Invece di costruire una nuova rete complessa, gli autori combinano ViT e Swin in modo semplice e trasparente. Ogni modello analizza prima la stessa immagine di foglia e produce i propri punteggi di probabilità per le sei classi. Questi punteggi vengono poi mediati, senza pesi addizionali allenabili, e la probabilità combinata più alta decide la diagnosi finale. Questa strategia di mediazione bilancia i punti di forza di ciascun modello ed evita l'overfitting su un dataset che, pur essendo ragionevolmente grande, riflette ancora un insieme specifico di regioni e condizioni. Gli esperimenti mostrano che sostituire Swin con una rete convoluzionale tradizionale elimina dettagli locali cruciali, e usare solo ViT perde segnali sottili—evidenza che il vantaggio deriva dalla vera sinergia di attenzione globale e locale, non semplicemente dall'aggiunta di più modelli.

Quanto bene funziona il sistema nella pratica

Sul test set rimasto fuori, di quasi tremila immagini, l'ensemble raggiunge un'accuratezza di circa il 97 percento, con precisione, recall e F1-score altrettanto elevati per tutte e sei le classi. Supera forti baseline convoluzionali come ResNet, EfficientNet, MobileNet e DenseNet, oltre ai singoli modelli ViT e Swin. La matrice di confusione mostra che la maggior parte degli errori si verifica tra malattie visivamente simili, come Yellow Leaf e Mosaic, ma complessivamente i tassi di classificazione errata restano bassi. Le curve ROC per ciascuna classe sono quasi perfette, indicando che l'ensemble è molto fiducioso e coerente nel separare foglie sane da quelle malate e nel distinguere i diversi tipi di malattia.

Trasformare le predizioni in indicazioni utili per gli agricoltori

Per andare oltre le etichette grezze, gli autori collegano il loro ensemble di immagini a un grande modello linguistico (LLM) ospitato online. Una volta classificata una foto di foglia, il nome della malattia predetta viene inviato all'LLM, che restituisce una breve spiegazione dei probabili sintomi e suggerimenti di gestione generale, pensati per agricoltori e tecnici di estensione. Un'interfaccia web costruita sulla piattaforma Hugging Face permette agli utenti di caricare un'immagine di foglia, vedere la malattia predetta e leggere le indicazioni generate dall'IA in pochi secondi. Gli autori sottolineano che queste raccomandazioni sono a scopo consultivo e dovrebbero essere verificate con esperti di agronomia, perché gli LLM possono a volte generare consigli troppo sicuri o incompleti. Tuttavia, questo livello linguistico rende il sistema più accessibile ai non specialisti.

Cosa significa questo per i futuri strumenti di agricoltura intelligente

In termini chiari, lo studio mostra che combinare due “modi di vedere” la stessa foglia—uno che vede la foresta, uno che vede gli alberi—può produrre una sentinella digitale molto affidabile per le malattie della canna da zucchero. L'ensemble di ViT e Swin Transformer cattura sia i sintomi ampi sia quelli fini, mentre il modello linguistico collegato aiuta a tradurre predizioni tecniche in suggerimenti comprensibili. Sebbene i modelli debbano ancora essere testati su più regioni, condizioni di illuminazione e dispositivi, e le uscite linguistiche richiedano la verifica degli esperti, questo lavoro indica la strada verso strumenti pratici per smartphone o tablet che potrebbero aiutare gli agricoltori a individuare i problemi precocemente, ridurre l'incertezza e favorire un uso più mirato dei trattamenti nella canna da zucchero e, in prospettiva, in molte altre colture.

Citazione: Saritha, M., Rasane, K. An ensemble of vision and swin transformers with LLM-based explanations for sugarcane leaf disease diagnosis. Sci Rep 16, 10707 (2026). https://doi.org/10.1038/s41598-026-45453-w

Parole chiave: rilevamento malattie della canna da zucchero, modelli vision transformer, agricoltura di precisione, imaging delle foglie delle piante, supporto decisionale AI