Clear Sky Science · it

L'addestramento ibrido evolutivo‑gradiente migliora la previsione a lungo termine delle serie temporali

Perché contano previsioni migliori a lungo termine

Dalla domanda di elettricità e il traffico autostradale ai tassi di cambio e il meteo locale, le nostre vite sono governate da sistemi che evolvono nel tempo. Prevedere con precisione questi andamenti per giorni o settimane può far risparmiare energia, ridurre la congestione e rendere le imprese più resilienti. Ma più ci si proietta nel futuro, più gli strumenti di intelligenza artificiale odierni fanno fatica a gestire condizioni che cambiano, misurazioni rumorose e risorse di calcolo limitate. Questo articolo introduce un nuovo modo di addestrare i modelli di previsione affinché restino accurati e stabili anche quando il mondo non resta fermo.

Imparare da molti modelli invece che da uno solo

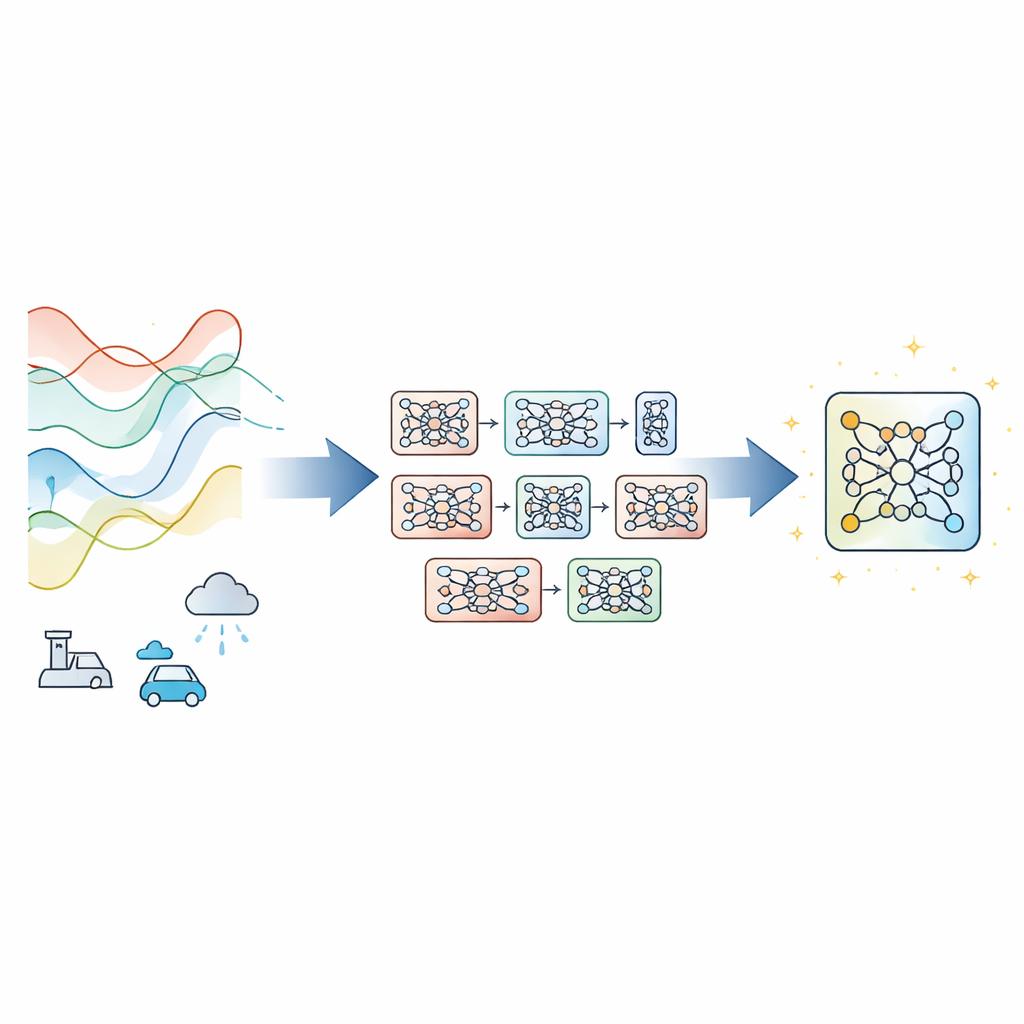

La maggior parte dei previsori moderni per serie temporali si basa su una singola rete neurale profonda addestrata con discesa del gradiente, il metodo standard che modifica i parametri passo dopo passo per ridurre l’errore. Questo funziona bene quando i dati si comportano in modo coerente, ma può fallire quando le condizioni mutano, le misure sono rumorose o i tempi di addestramento sono ristretti. Invece di inventare un nuovo progetto di rete, gli autori propongono Evolutionary‑Guided Module Fusion with Gradient Refinement (EGMF‑GR), un framework di addestramento che può avvolgere architetture esistenti. L’idea chiave è mantenere una piccola “popolazione” di modelli che condividono la stessa struttura ma partono da impostazioni casuali diverse. Durante l’addestramento, questi modelli esplorano modi differenti di adattarsi ai dati, e il modello con le prestazioni migliori in un dato momento viene usato per guidare i miglioramenti negli altri.

Prendere le parti buone mantenendo la diversità utile

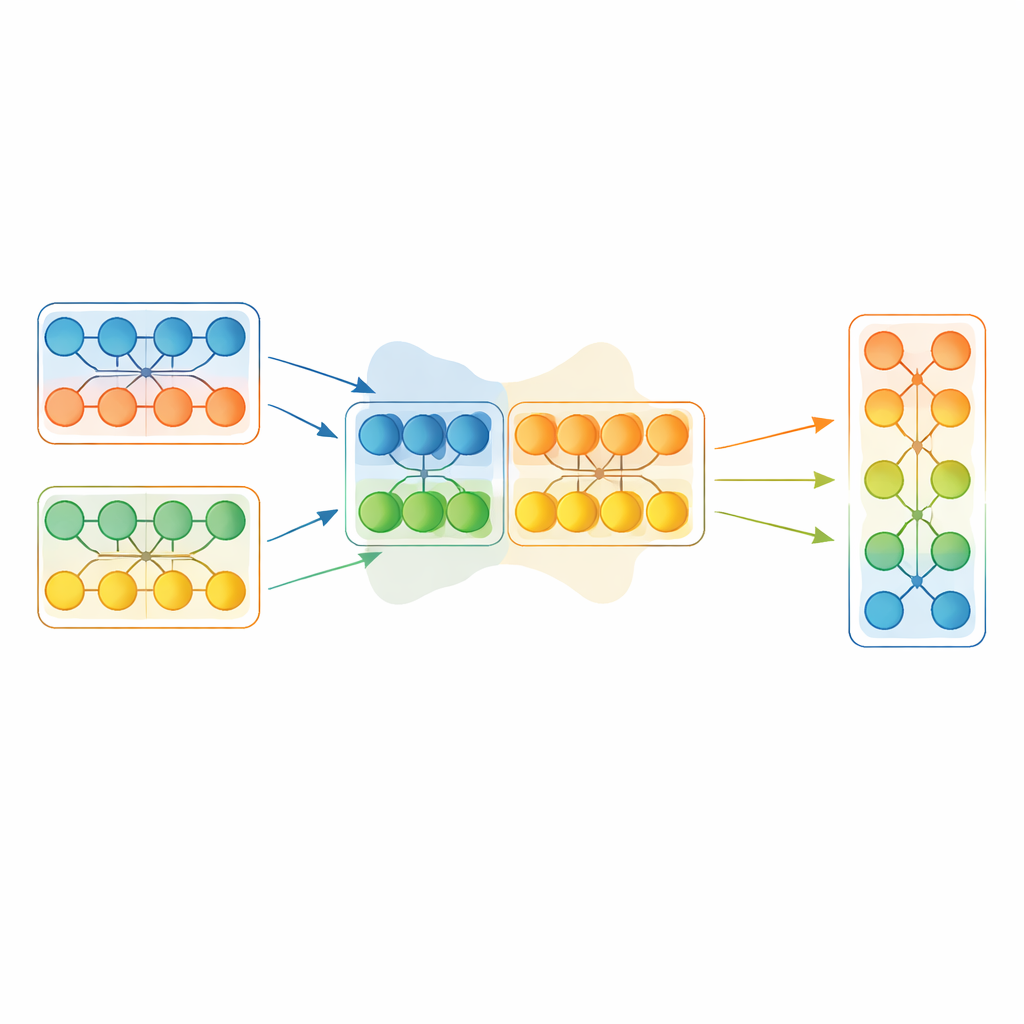

Piuttosto che copiare interamente un modello vincente, EGMF‑GR opera a livello di moduli — blocchi ripetuti all’interno di una rete, come pile di layer. Per ogni modello nella popolazione, il framework allinea i moduli corrispondenti con quelli dell’attuale modello migliore e confronta i loro segnali interni mentre processano la stessa batch di input. Usa diverse misure semplici di differenza, catturando sia come sono plasmati i pattern di attività sia la loro ampiezza. Queste discrepanze a livello di modulo vengono quindi riassunte, e solo i moduli il cui comportamento appare fortemente anomalo rispetto ai pari sono considerati per l’aggiornamento. Quando ciò accade, il modulo in ritardo viene spinto verso il corrispondente modulo del modello migliore tramite una fusione ponderata dei loro parametri, più una piccola scossa casuale per preservare la diversità.

Lasciare che i gradienti sistemino le cose dopo i grandi spostamenti

Fondere parti di reti diverse può introdurre cambiamenti bruschi. Per evitare di destabilizzare l’addestramento, ogni modello fuso passa poi attraverso una breve fase convenzionale di discesa del gradiente sui dati di addestramento. Questo passo di raffinamento permette alla rete di riadattarsi in modo graduale alla sua nuova configurazione interna mantenendo i benefici della conoscenza trasferita. La procedura complessiva alterna: selezionare il modello migliore attuale basandosi su una porzione di dati tenuta da parte, fondere selettivamente moduli da quel leader nel resto della popolazione e perfezionare brevemente tutti con i gradienti. Cruciale è anche la sincronizzazione degli stati interni di bookkeeping, come le medie mobili usate da certi layer, che spesso vengono ignorati in schemi di fusione più semplici ma possono influire molto sulla stabilità.

Dimostrare i vantaggi su molti segnali del mondo reale

Per testare il framework, gli autori hanno applicato EGMF‑GR a diversi backbone di previsione popolari, inclusi modelli in stile Transformer e un recente progetto basato su convoluzioni, senza cambiare le loro strutture di base. Hanno valutato le prestazioni su otto benchmark pubblici che coprono consumo energetico, flusso di traffico, tassi di cambio e meteo, e su orizzonti di previsione che vanno da poche ore a diversi giorni. Con un budget strettamente corrispondente di aggiornamenti costosi in backpropagation, l’addestramento ibrido ha ridotto in modo consistente gli errori di previsione e ha reso il comportamento di addestramento più regolare per la maggior parte delle combinazioni modello‑dataset, specialmente in contesti ad alta dimensionalità o rumorosi. Il team ha anche confrontato il loro approccio con trucchi comuni a modello singolo come le medie mobili esponenziali e lo stochastic weight averaging, trovando che la fusione di moduli basata sulla popolazione portava benefici aggiuntivi oltre la semplice levigatura dei pesi.

Rimanere affidabili quando le condizioni peggiorano

I sistemi reali raramente si comportano come esempi puliti dei manuali, quindi gli autori hanno anche testato la robustezza in scenari più difficili: input artificialmente corrotti, porzioni di dati mancanti e periodi in cui la dinamica sottostante cambia bruscamente. EGMF‑GR ha chiaramente aiutato quando gli input erano rumorosi o parzialmente mancanti, suggerendo che prendere in prestito comportamenti modulari stabili dall’attuale modello migliore può contrastare glitch locali. Durante cambi di regime improvvisi, il vantaggio è stato più contenuto, suggerendo che un’allineamento eccessivo può talvolta rallentare l’adattamento a nuovi pattern. Questo indica possibili perfezionamenti futuri in cui la forza della fusione viene ridotta quando l’ambiente diventa altamente volatile.

Cosa significa per gli strumenti di previsione di tutti i giorni

In termini semplici, lo studio mostra che addestrare molte versioni cooperanti dello stesso modello di previsione, lasciando che condividano solo le parti che emergono davvero come migliori, può rendere le previsioni a lungo termine più accurate e più stabili senza riprogettare i modelli stessi. EGMF‑GR funziona come uno sport di squadra disciplinato: i membri adottano occasionalmente le mosse più forti degli altri, poi si allenano un po’ da soli per adattarsi al gioco corrente. Per i praticanti, questo offre una strategia di addestramento plug‑in che può rafforzare i sistemi di previsione esistenti in finanza, energia, trasporti e applicazioni climatiche, specialmente quando i dati sono disordinati e i budget di calcolo sono limitati.

Citazione: Zhao, L., Chen, Z., Wu, N. et al. Hybrid evolutionary-gradient training improves long-term time series forecasting. Sci Rep 16, 10697 (2026). https://doi.org/10.1038/s41598-026-45017-y

Parole chiave: previsione di serie temporali, addestramento evolutivo, reti neurali, fusione di modelli, shift di distribuzione