Clear Sky Science · it

Segmentazione degli strumenti chirurgici con supervisione debole e indipendente dal dominio

Perché sono importanti viste più intelligenti degli strumenti chirurgici

I chirurghi moderni operano sempre più spesso con l'ausilio di telecamere, microscopi e scanner avanzati. Per guidare robot, allineare viste 3D o rimuovere strumenti da certe immagini, i computer devono individuare in modo affidabile ogni strumento chirurgico in ogni fotogramma, un compito chiamato segmentazione. Oggi ciò richiede solitamente migliaia di annotazioni meticolose, pixel-perfette, fatte da esperti medici—e anche così i sistemi spesso falliscono quando l'apparato di imaging o la procedura cambiano. Questo studio propone un modo per permettere a potenti modelli di visione di trovare strumenti attraverso tipi molto diversi di immagini mediche, senza bisogno di disegnare in dettaglio ogni strumento in anticipo.

La sfida di trovare strumenti in molti tipi di immagini

I chirurghi impiegano una vasta gamma di sistemi di imaging: video a colori da telecamere laparoscopiche all'interno dell'addome, viste microscopiche dell'occhio durante la chirurgia della cataratta e scansioni tomografiche come l'ottica a coerenza (OCT) o l'ecografia. In ciascuno di questi contesti, gli strumenti chirurgici appaiono molto diversi—aste metalliche lucide nelle immagini a colori, linee sottili o mezzaluna luminose nell'OCT, o macchie puntinate nell'ecografia. I metodi di deep learning esistenti possono funzionare molto bene, ma solo dopo l'addestramento su grandi dataset accuratamente etichettati di uno specifico contesto. Quando cambia il dispositivo di imaging, l'anatomia o il tipo di strumento, le prestazioni spesso calano bruscamente, e raccogliere nuove annotazioni è lento, costoso e vincolato da problemi di privacy e competenza.

Un'idea nuova: trattare gli strumenti come oggetti fuori posto

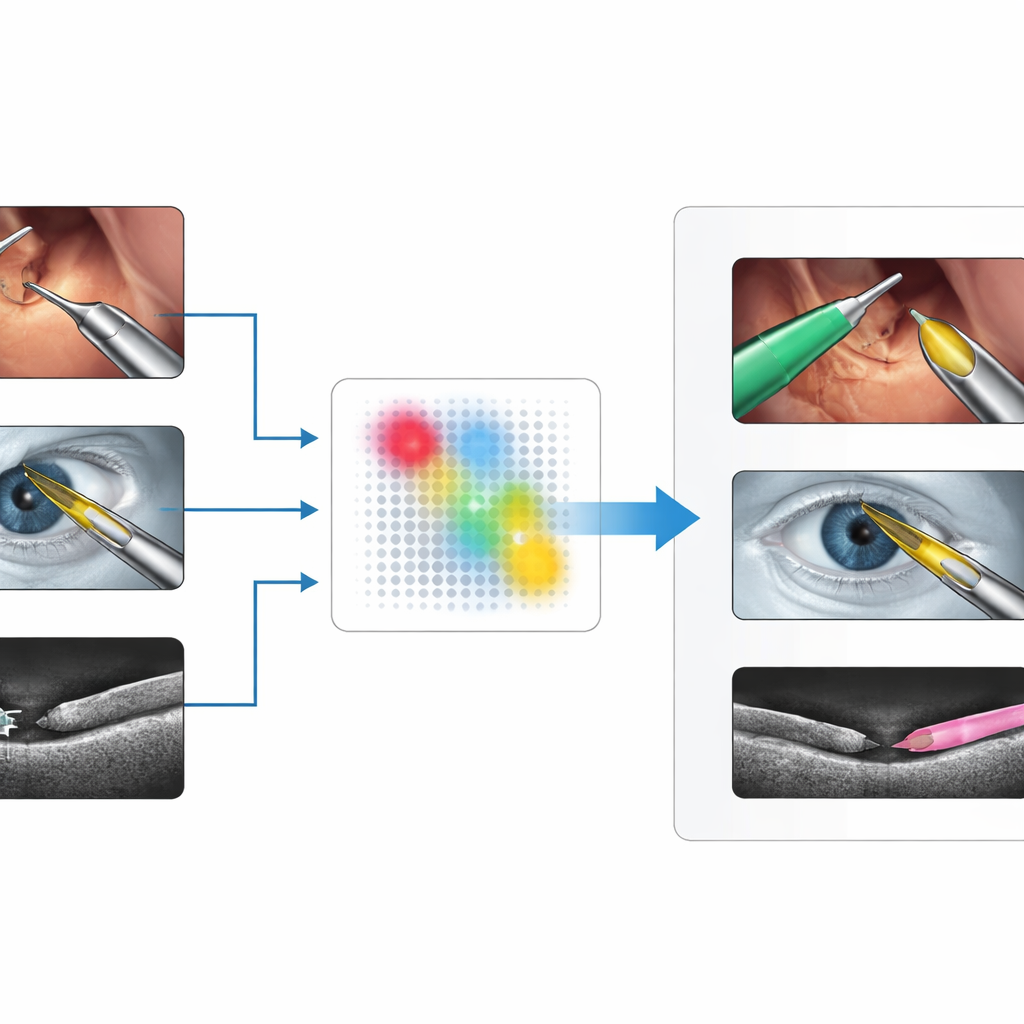

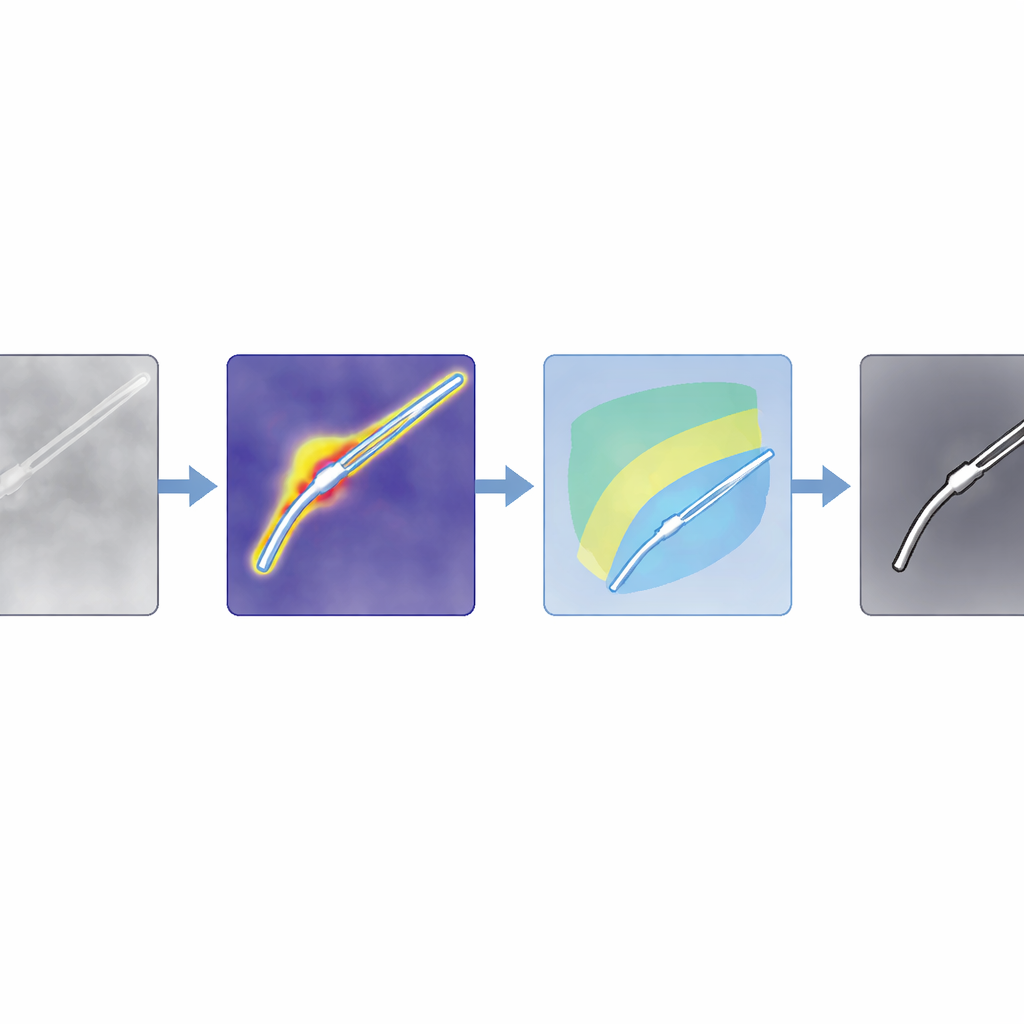

Gli autori propongono un metodo che chiamano SAM4SIS che capovolge il problema. Invece di insegnare al sistema esattamente come appare ogni strumento, mostrano prima immagini senza alcuno strumento, permettendogli di apprendere come appare il tessuto “normale”. Usano un rilevatore di anomalie chiamato PatchCore per costruire una memoria di questi pattern normali. Quando arriva una nuova immagine, PatchCore evidenzia le regioni la cui apparenza non si adatta a questa memoria—aree che probabilmente contengono strumenti chirurgici. Questo passaggio richiede solo informazioni a livello di immagine sul fatto che uno strumento sia presente o meno, non disegni pixel-wise del suo contorno, rendendo l'installazione molto più semplice.

Da indizi approssimativi a contorni precisi

Le mappe di anomalie sono grossolane, quindi il team le combina con un potente modello foundation, Segment Anything Model 2 (SAM2), che può tracciare contorni nitidi se gli viene fornito un punto all'interno dell'oggetto di interesse. Il trucco chiave è scegliere automaticamente quei punti dalla mappa di anomalie, invece di chiedere a un umano di cliccarli. Gli autori progettano filtri su misura per immagini a colori ordinarie e per scansioni basate su intensità come l'OCT, rafforzando le regioni che probabilmente contengono strumenti e sopprimendo ombre e artefatti luminosi. Poi valutano le potenziali regioni di strumento e selezionano i punti più forti come prompt per SAM2. Poiché SAM2 restituisce diversi contorni candidati, gli autori introducono una nuova regola di punteggio, SAM4SIS, che misura quanto ogni candidato corrisponda alla mappa basata sulle anomalie e seleziona la maschera che meglio si adatta.

Funziona in molte chirurgie e scanner diversi

I ricercatori testano il loro approccio su tre dataset impegnativi: video di chirurgia robotica addominale (EndoVis2017), immagini microscopiche di operazioni di cataratta (CaDIS) e scansioni OCT trasversali di occhi suini con piccoli strumenti (PASO-SIS). Questi coprono viste, colori e pattern di rumore molto diversi. Senza mai riaddestrare il grande modello di segmentazione o disegnare nuove maschere, SAM4SIS raggiunge punteggi di accuratezza dei bordi tra circa il 53% e il 73%, rivaleggiando o superando metodi di prompting basati su testo e avvicinandosi ad alcuni sistemi supervisionati. Funziona particolarmente bene dove i metodi tradizionali faticano, come nei dati OCT e ecografici, e richiede meno di un minuto per la configurazione. Il team mostra inoltre che la stessa idea può evidenziare altri oggetti estranei, come palline di cotone nelle ecografie cerebrali, suggerendo che il concetto non è limitato agli strumenti.

Cosa significa per la chirurgia intelligente futura

Per i lettori, il messaggio principale è che i computer possono ora imparare a “segmentare qualsiasi cosa di nuovo” nelle scene chirurgiche comprendendo prima come appare il tessuto normale e poi segnalando forme non familiari come probabili strumenti, che vengono quindi raffinate da un modello di visione a uso generale. Questo approccio evita un pesante lavoro di annotazione, si adatta a diverse tecnologie di imaging e può essere inserito nei flussi di lavoro chirurgici con preparazione minima. Pur restando il caso che modelli specializzati e accuratamente addestrati vincano quando sono disponibili molti dati etichettati, SAM4SIS offre un'alternativa pratica per nuove procedure, configurazioni di imaging rare o ricerca in fase iniziale, avvicinando il rilevamento automatico e robusto degli strumenti alla realtà clinica quotidiana.

Citazione: Peter, R., Pham, D.X.V., Matten, P. et al. Domain-agnostic weakly supervised surgical instrument segmentation. Sci Rep 16, 9337 (2026). https://doi.org/10.1038/s41598-026-43054-1

Parole chiave: segmentazione degli strumenti chirurgici, IA per l'imaging medico, rilevamento di anomalie, modelli di visione foundation, chirurgia robotica