Clear Sky Science · it

Sviluppo e valutazione di un framework di transfer learning multistadio per l’analisi robusta delle immagini mediche

Perché una lettura delle immagini più intelligente è importante

La medicina moderna fa ampio affidamento sulle immagini — dalle mammografie alle radiografie del torace — per rilevare le malattie precocemente e guidare le terapie. Ma insegnare ai computer a interpretare queste immagini con la stessa accuratezza degli esperti umani richiede di solito grandi dataset accuratamente etichettati, che molti ospedali semplicemente non possiedono. Questo studio presenta un nuovo modo di addestrare sistemi di intelligenza artificiale che sfrutta meglio le immagini esistenti, incluse foto di laboratorio a basso costo di cellule tumorali, per migliorare le prestazioni sulle scansioni cliniche reali riducendo al contempo esigenze di privacy e dati.

Dalle foto di tutti i giorni alle scansioni ospedaliere

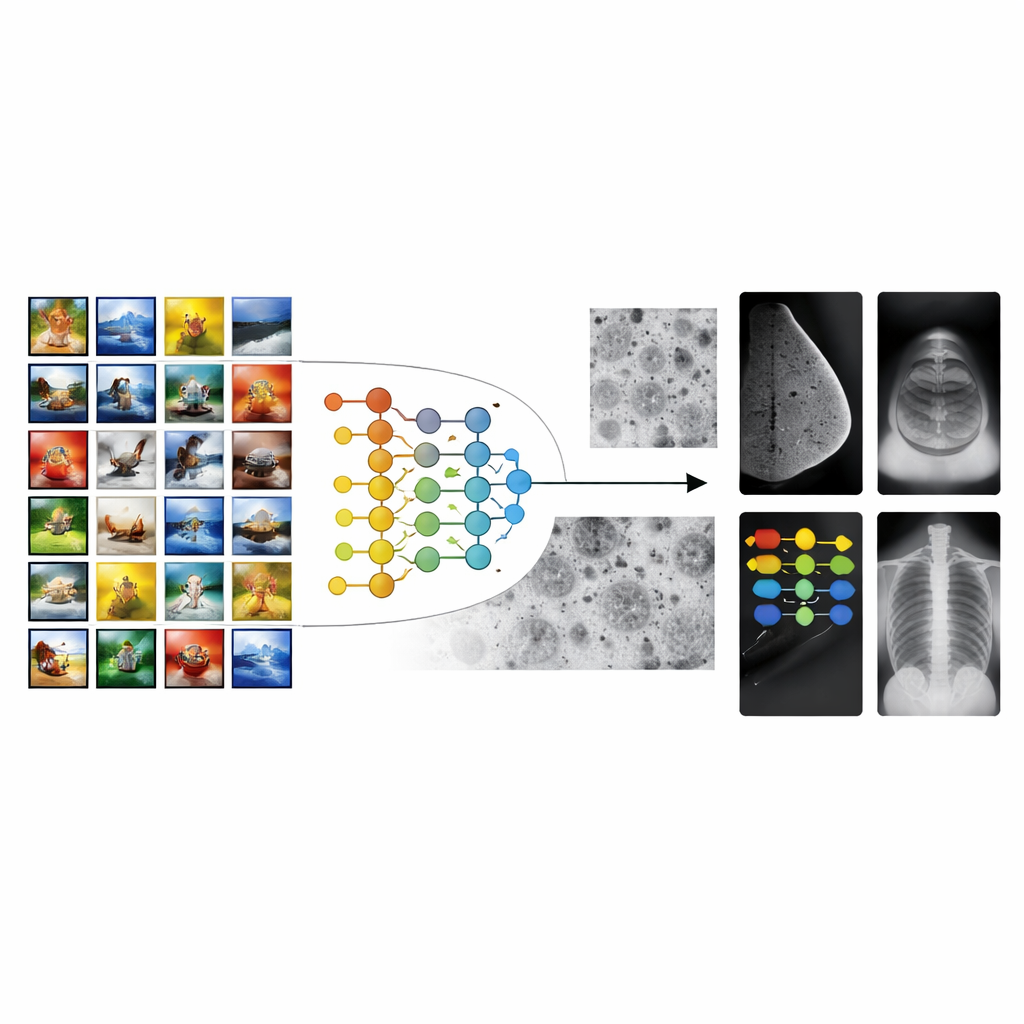

La maggior parte dei sistemi di IA per imaging medico parte da modelli addestrati su milioni di immagini di uso comune, come animali, oggetti e paesaggi. Questa strategia, nota come transfer learning, offre agli algoritmi un «vantaggio iniziale» nel riconoscere forme e texture. Tuttavia esiste un grande divario tra le foto di vacanza e le scansioni mediche. I pattern rilevanti in una mammografia o in una radiografia — minuscoli puntini, ombre sfumate o texture tissutali sottili — non somigliano affatto agli oggetti delle foto ordinarie. Di conseguenza, il transfer learning convenzionale può incepparsi, portando a strumenti che funzionano bene in laboratorio ma faticano quando applicati in diversi ospedali, su macchine differenti o su gruppi di pazienti diversi.

Costruire un ponte con le immagini di cellule

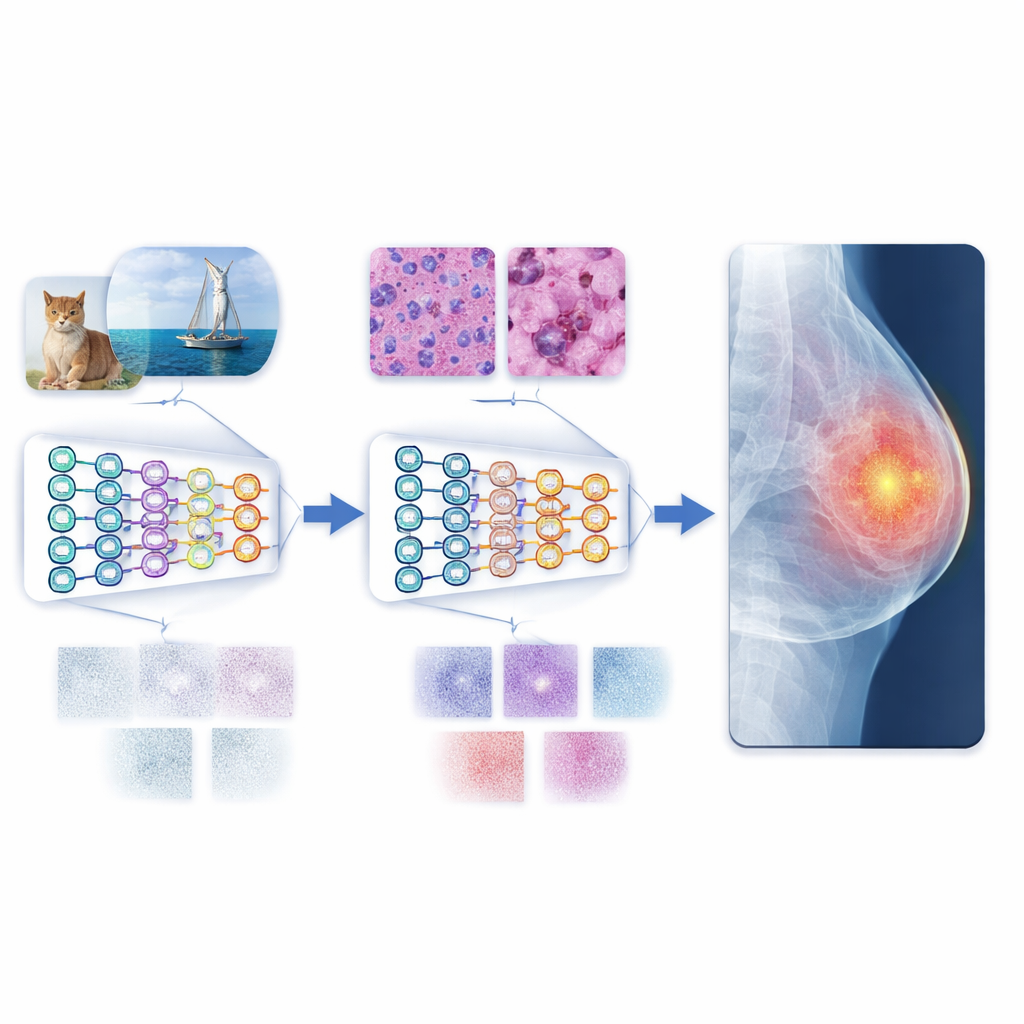

Gli autori propongono un framework di transfer learning multistadio (MSTL) che aggiunge un passaggio intermedio cruciale tra le immagini generiche e le scansioni cliniche. Dopo un primo addestramento su una vasta collezione di immagini naturali, il modello viene rifinito su immagini microscopiche di linee cellulari tumorali coltivate in laboratorio. Queste immagini di cellule condividono molte caratteristiche visive con le scansioni mediche: strutture dense e affollate; texture a granulometria fine; e sottili variazioni di luminosità. Sono inoltre relativamente economiche da produrre, possono essere generate in grandi quantità e evitano i problemi di privacy legati ai dati dei pazienti. Adattandosi prima a questo mondo di immagini cellulari, il modello impara caratteristiche più pertinenti ai pattern di malattia prima ancora di vedere una mammografia, un’ecografia o una radiografia.

Testare su diversi tipi di scansioni

Per valutare questa strategia, i ricercatori hanno addestrato sia reti neurali convoluzionali tradizionali sia più recenti vision transformer su tre compiti di imaging comuni: rilevamento del cancro al seno in mammografie, analisi delle lesioni mammarie in ecografia e identificazione della polmonite nelle radiografie toraciche. Hanno confrontato tre stili di addestramento: partire da zero, usare il transfer learning convenzionale da immagini naturali e adottare il nuovo metodo multistadio con immagini di cellule tumorali come ponte. L’approccio multistadio ha fornito costantemente i migliori risultati, spesso portando l’accuratezza vicino alla perfezione sui dataset testati. I vision transformer, che possono catturare pattern a lungo raggio su tutta l’immagine, hanno superato le reti convoluzionali standard in quasi tutti gli scenari, specialmente quando abbinati all’addestramento multistadio.

Misurare quanto bene trasferisce la conoscenza

Oltre alle semplici misure di accuratezza, il team ha esaminato quanto facilmente le caratteristiche apprese in una fase si trasferissero a quella successiva. Hanno usato tre misure di trasferibilità che riflettono quanto i pattern d’immagine appresi siano compatibili con nuovi compiti. Per le mammografie e le radiografie del torace in particolare, queste misure hanno seguito da vicino le prestazioni effettive, soprattutto per il modello più forte, un vision transformer base (ViTB-16). Questa stretta correlazione suggerisce che la fase intermedia sulle immagini di cellule fa più che migliorare i numeri: produce rappresentazioni che «si adattano» realmente meglio alle immagini mediche. Esperimenti aggiuntivi hanno mostrato che dimezzare il numero di immagini di cellule peggiora le prestazioni, e sostituirle con altre modalità mediche (come endoscopia o immagini oculari) è stato meno efficace, sottolineando il valore particolare delle linee cellulari tumorali come ponte.

Verso diagnosi automatizzate più affidabili

In termini pratici, lo studio dimostra che insegnare a un sistema di IA a leggere immagini di cellule coltivate in laboratorio prima delle scansioni ospedaliere lo rende un «lettore» di immagini mediche più abile e affidabile. Questo percorso multistadio riduce lo scarto tra le foto colorate di uso quotidiano e i pattern smorzati e complessi delle immagini cliniche, consentendo al modello di generalizzare meglio anche quando sono disponibili solo quantità modeste di dati medici etichettati. Abbinato ai moderni vision transformer, l’approccio raggiunge prestazioni allo stato dell’arte su diversi dataset di riferimento. Pur richiedendo dati più vari e test più ampi, il framework indica strumenti scalabili e rispettosi della privacy che potrebbero aiutare i medici a diagnosticare le malattie in modo più accurato e coerente nel mondo.

Citazione: Ayana, G., Park, Sy., Jeong, K.C. et al. Development and evaluation of a multistage transfer learning framework for robust medical image analysis. Sci Rep 16, 8873 (2026). https://doi.org/10.1038/s41598-026-42157-z

Parole chiave: analisi delle immagini mediche, transfer learning, deep learning, vision transformers, imaging di cellule tumorali