Clear Sky Science · it

Progettazione e implementazione di un framework di deep learning per la classificazione automatizzata delle colture e la diagnosi della salute in agricoltura di precisione

Campi più intelligenti per un mondo affamato

Nutrire una popolazione globale in crescita significa ottenere più cibo da ogni campo consumando meno acqua, fertilizzanti e lavoro. Eppure gli agricoltori continuano a trascorrere innumerevoli ore camminando nei loro terreni, controllando visivamente foglie e suolo a occhio nudo. Questo articolo presenta un modo automatizzato per sorvegliare le colture utilizzando droni volanti, satelliti in orbita e sensori interrati, tutti collegati a un sistema di deep learning in grado di individuare precocemente problemi e suggerire interventi rapidi.

Unire cielo e suolo

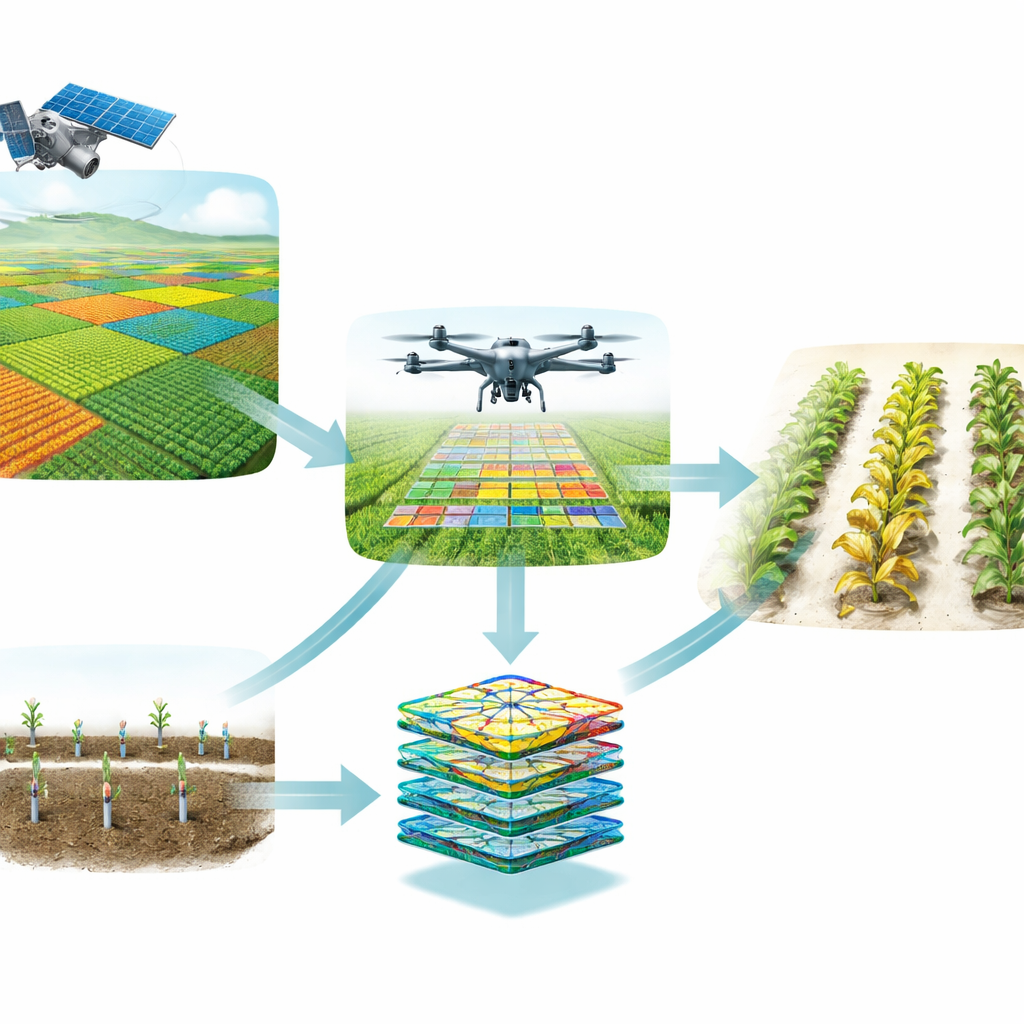

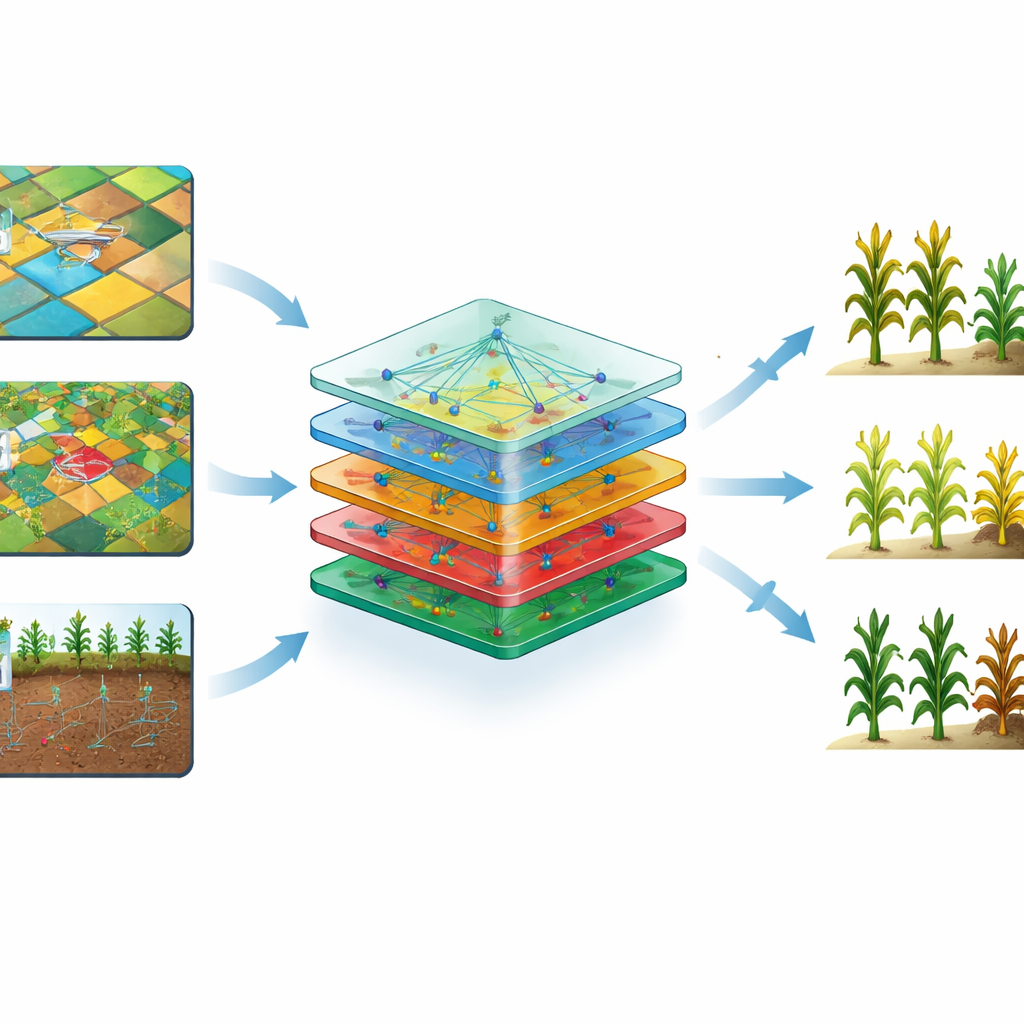

La maggior parte degli strumenti agricoli ad alta tecnologia guarda solo a un pezzo del puzzle: foto ravvicinate delle foglie o numeri grezzi dai sensori del suolo. Gli autori sostengono che questa visione «a silos» perde indizi importanti. Il loro framework invece fonde tre punti di osservazione. Dallo spazio, le immagini satellitari rivelano schemi su larga scala, come le parti di un campo sotto stress. Dall’aria, i droni catturano viste dettagliate in colore e nel vicino infrarosso delle singole piante. Nel terreno, i sensori connessi a Internet monitorano umidità, nutrienti, temperatura e altre condizioni. Allineando queste fonti di dati nel tempo e nello spazio, il sistema può collegare ciò che vede sulle foglie con ciò che accade nel suolo e nell’ambiente circostante.

Come impara il medico digitale delle colture

Il cuore del framework è un modello di deep learning addestrato a riconoscere tipi di colture e condizioni di salute. Per prima cosa, tutti i dati in arrivo vengono puliti e normalizzati: le scene satellitari nuvolose sono standardizzate, le immagini dei droni vengono ridimensionate e corrette per la variazione di luce, e le lacune nelle registrazioni meteorologiche vengono compensate. Il sistema inoltre aumenta i dati delle immagini ruotando e ribaltando le foto in modo che il modello impari a ignorare l’angolo della camera e a concentrarsi sulle caratteristiche reali della pianta. Poi una rete specializzata per l’analisi delle immagini, nota come rete neurale convoluzionale, estrae pattern come la texture delle foglie, i cambiamenti di colore e la forma delle lesioni, mentre ulteriori strati elaborano le letture numeriche dei sensori. Un meccanismo di “attenzione” aiuta il modello a concentrarsi sulle regioni più informative — come una zona di foglie macchiate — escludendo suolo o cielo di sfondo.

Da dati grezzi a decisioni in tempo reale

Una volta addestrato, il modello funziona come un medico delle colture sempre attivo. I dati multisorgente vengono inviati in streaming nel sistema e fusi in una rappresentazione interna unica. Gli strati guidati dall’attenzione confrontano ciò che vedono con migliaia di esempi passati, quindi il blocco di classificazione finale decide se una pianta è sana o mostra segni di malattia, danni da parassiti o stress. Invece di limitarsi a etichettare un campo come buono o cattivo, il framework collega la sua diagnosi visiva ai livelli attuali di umidità e nutrienti del suolo. Questa combinazione gli permette di dare priorità agli allarmi: per esempio, un pattern di malattia abbinato a condizioni umide potrebbe attivare un avviso ad alta urgenza, suggerendo uno spray mirato immediato anziché un trattamento a tappeto su tutta la fattoria.

Mettere il sistema alla prova

Per verificare se questo approccio funziona oltre la teoria, gli autori hanno addestrato e valutato il loro framework su un dataset pubblico di agricoltura di precisione che include immagini satellitari, foto da droni e letture dei sensori di terreno per colture fondamentali: mais, patata e grano. Hanno suddiviso i dati in set di addestramento, validazione e test per evitare l’overfitting e hanno confrontato il loro modello con tecniche standard di deep learning e metodi tradizionali di machine learning. Il loro sistema multimodale ha ottenuto costantemente oltre il 90% di accuratezza nell’identificare il tipo di coltura e lo stato di salute, fornendo inoltre previsioni più veloci rispetto ai modelli di riferimento. Importante, quando una fonte di dati risultava degradata — ad esempio immagini da droni influenzate da ombre — il sistema riusciva comunque a mantenere un’elevata accuratezza affidandosi maggiormente alle informazioni del suolo e dei satelliti.

Cosa significa per gli agricoltori

La conclusione dello studio è che combinare viste dal cielo al suolo permette ai computer di valutare la salute delle colture in modo più affidabile rispetto a scout umani o a strumenti a sensore singolo. Per gli agricoltori, questo potrebbe tradursi in avvisi più precoci di focolai di malattie, uso più preciso di acqua e prodotti chimici, costi di manodopera inferiori e, in ultima istanza, rese maggiori con un impatto ambientale ridotto. Sebbene il sistema attuale dipenda ancora da una buona connettività per inviare i dati al cloud, versioni future potrebbero funzionare direttamente su droni o dispositivi edge nel campo. Se realizzato su larga scala, questi guardiani intelligenti e multivista della fattoria potrebbero diventare una pietra angolare di un’agricoltura veramente sostenibile e guidata dai dati.

Citazione: Pal, A.K., Patro, B.D.K. & Chaube, S. Design and implementation of a deep learning framework for automated crop classification and health diagnosis in precision agriculture. Sci Rep 16, 11436 (2026). https://doi.org/10.1038/s41598-026-42151-5

Parole chiave: agricoltura di precisione, rilevamento delle malattie delle colture, deep learning, imaging con droni e satelliti, agricoltura intelligente