Clear Sky Science · it

GWKNN: un algoritmo k-nearest neighbor potenziato con ricostruzione della metrica G e Grey Wolf Optimizer

Riconoscimento di pattern più intelligente per l’odierna valanga di dati

Dalle scansioni mediche alle transazioni bancarie, la vita moderna genera oceani di dati. Gran parte di queste informazioni deve essere automaticamente classificata in categorie: sano o malato, fraudolento o normale, spam o genuino. Un cavallo di battaglia classico per questo tipo di compito è l’algoritmo k-nearest neighbors (KNN), che etichetta un nuovo caso osservando gli esempi passati più simili. Tuttavia, mano a mano che i dataset diventano più grandi, complessi e sbilanciati, questa idea semplice comincia a mostrare limiti. L’articolo presenta GWKNN, una versione rivista del KNN progettata per sfruttare meglio le distanze tra i punti e per trattare in modo più equo i casi rari ma importanti.

Perché la semplice similarità non basta

Il KNN convenzionale assume che tutte le caratteristiche di un punto dati contribuiscano allo stesso modo e misura la similarità con la classica distanza in linea retta. Questo può funzionare bene quando i dati sono a bassa dimensionalità e nettamente separati, ma i dati del mondo reale sono spesso ad alta dimensionalità, rumorosi e combinano diversi tipi di informazione. In tali casi, la distanza abituale può essere fuorviante, portando l’algoritmo a selezionare vicini non informativi. Allo stesso tempo, molti dataset sono sbilanciati: categorie comuni dominano, mentre categorie rare ma cruciali, come una malattia in fase iniziale, sono sottorappresentate. Quando il KNN vota tra gli esempi vicini, la classe di maggioranza tende a soffocare queste minoranze, causando decisioni distorte e talvolta pericolose.

Insegnare all’algoritmo un senso della distanza migliore

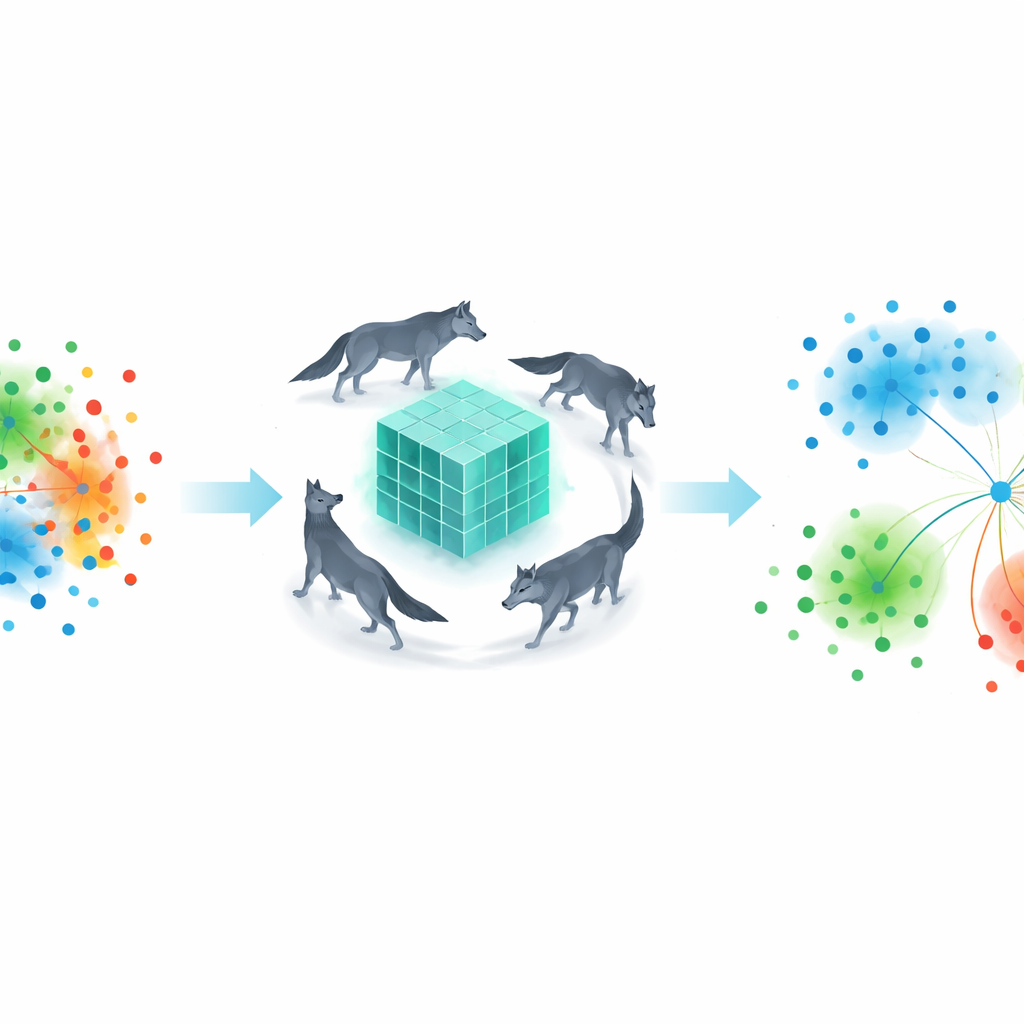

La prima innovazione importante in GWKNN è una misura di distanza appresa. Invece di fissare la regola della distanza euclidea, gli autori lasciano che l’algoritmo scopra quale separazione fra i punti migliori distingue le categorie. Questo viene codificato come una flessibile “metrica G” che rimodella lo spazio in modo che le caratteristiche informative pesino di più e quelle ridondanti di meno. Per tarare questa metrica, il metodo si ispira al comportamento di caccia dei lupi grigi. Una procedura di intelligenza di branco, chiamata Grey Wolf Optimizer, esplora molte possibili trasformazioni dello spazio dei dati, mantenendo quelle che riducono gli errori di classificazione pur garantendo stabilità matematica. Nel corso di molte iterazioni i “lupi” virtuali convergono su una regola di distanza che fa sì che i punti simili si raggruppino in modo più affidabile, anche in dataset ad alta dimensionalità e complessi.

Dare voce più forte ai casi rari

Il secondo miglioramento mira al bias nel voto. Il KNN standard conta semplicemente quanti dei k vicini appartengono a ciascuna classe e sceglie la maggioranza. GWKNN invece pesa ogni voto in funzione della frequenza di quella classe nel set di addestramento complessivo. Le classi meno frequenti ricevono pesi maggiori; le classi molto comuni pesi minori. Un piccolo termine di smoothing impedisce che categorie estremamente rare monopolizzino la decisione. In questo modo, se un nuovo punto dati è vicino a qualche esempio di classe minoritaria e a molti esempi di classe maggioritaria, i segnali della minoranza non vengono automaticamente sommersi. Lo schema è semplice da calcolare ma ha un effetto potente: spinge il classificatore a prestare maggiore attenzione a pattern rari ma significativi, migliorando equità e richiamo per le classi minoritarie.

Mettere alla prova il nuovo metodo

Per verificare se GWKNN sia davvero utile in pratica, gli autori lo hanno valutato su 12 dataset benchmark della nota repository UCI. Queste raccolte comprendono dati finanziari, misure mediche, scrittura a mano, semi di piante e diversi dataset ad alta dimensionalità su tumori ed espressione genica, con problemi sia binari sia multiclasse. Hanno confrontato quattro versioni di KNN: la versione di base, una versione con sola nuova metrica di distanza, una con soltanto i nuovi pesi di voto e la GWKNN completa che combina entrambe le idee. Hanno inoltre confrontato GWKNN con sette classificatori ampiamente usati, tra cui macchine a vettori di supporto, alberi decisionali, random forest, regressione logistica, naive Bayes e una rete neurale. Su ripetute suddivisioni train–test hanno monitorato non solo l’accuratezza media ma anche quanto i risultati variassero.

Risultati: più accurato e più coerente

L’approccio combinato GWKNN è risultato al primo posto o in parità per le migliori prestazioni nella maggior parte dei dataset, in particolare su quelli con molte caratteristiche e classi di dimensioni non uniformi. Su compiti relativamente semplici tutti i metodi hanno funzionato bene e i miglioramenti sono stati modesti, ma GWKNN ha comunque tendenzialmente aumentato leggermente l’accuratezza e ridotto la variabilità. Su dataset più difficili di espressione genica con migliaia di caratteristiche i vantaggi sono stati più evidenti: la metrica di distanza appresa ha aiutato l’algoritmo a formare vicinati più significativi e il voto pesato ha migliorato il riconoscimento delle classi sottorappresentate. Test statistici su tutti i dataset hanno confermato che le classifiche di GWKNN erano significativamente migliori rispetto al KNN standard e ad alcuni modelli classici, indicando che i miglioramenti non sono dovuti a fortunate fluttuazioni ma sono robusti in diverse condizioni dei dati.

Cosa significa per le decisioni quotidiane sui dati

Per i non specialisti, la conclusione è che GWKNN affina un’idea molto intuitiva — “osserva i casi passati simili” — per adattarla meglio alla realtà disordinata dei dati moderni. Imparando a misurare la similarità in modo guidato dai dati e aumentando l’influenza delle categorie rare nel voto, il metodo mira a essere sia più accurato sia più equo. Sebbene questa sofisticazione aggiuntiva comporti un costo computazionale maggiore, soprattutto per dataset molto grandi e ad alta dimensionalità, GWKNN mostra un forte potenziale per compiti in cui la classificazione corretta dei casi minoritari è cruciale, come la rilevazione precoce di malattie o l’individuazione di frodi. Il lavoro illustra come algoritmi classici possano essere aggiornati con intuizioni dall’ottimizzazione e dall’equità per tenere il passo con la scala e la complessità delle informazioni odierne.

Citazione: Guo, Z., Liu, G., Liu, W. et al. GWKNN: an enhanced k-nearest neighbor algorithm with G metric reconstruction and Grey Wolf Optimizer. Sci Rep 16, 8857 (2026). https://doi.org/10.1038/s41598-026-41851-2

Parole chiave: k-nearest neighbors, apprendimento della metrica di distanza, squilibrio delle classi, <keyword>classificazione dei dati