Clear Sky Science · it

Un modello vision transformer spiegabile con transfer learning per una classificazione accurata delle malattie delle foglie di fagiolo

Perché le foglie di fagiolo malate riguardano tutti

I fagioli sono un alimento base per centinaia di milioni di persone, soprattutto nei paesi in via di sviluppo, fornendo proteine e fibre a basso costo. Eppure due malattie fogliari comuni—Macchia Angolare e Ruggine del Fagiolo—possono silenziosamente privare i campi del loro raccolto, minacciando sia le diete sia i redditi degli agricoltori. Questo studio esplora come una nuova forma di intelligenza artificiale possa individuare queste malattie precocemente e, cosa cruciale, mostrare agli agricoltori esattamente ciò che vede, trasformando una misteriosa scatola nera in uno strumento comprensibile e affidabile.

Minacce nascoste sulle foglie di tutti i giorni

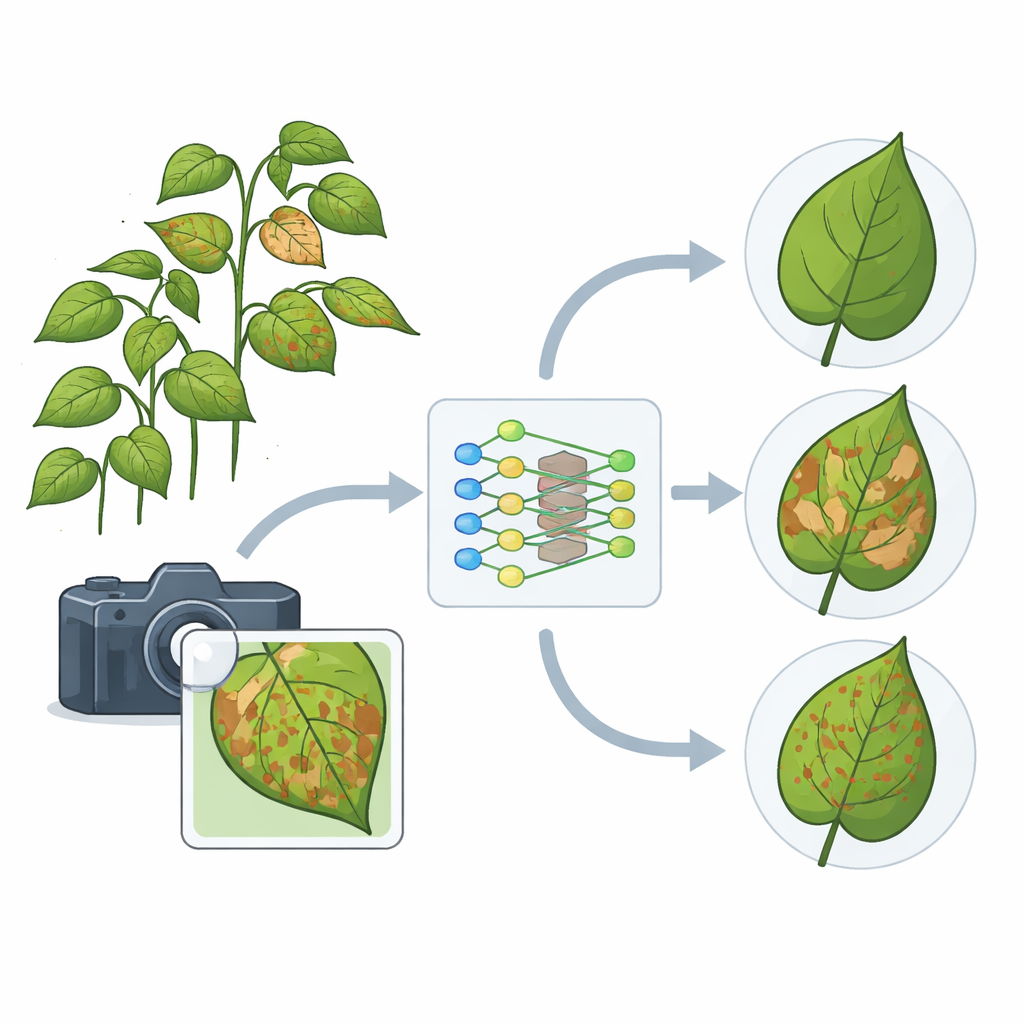

Le piante di fagiolo sono costantemente sotto attacco da invasori fungini che sfregiano le foglie, riducono la fotosintesi e portano a raccolti più piccoli e di qualità inferiore. Tradizionalmente, gli esperti camminano per i campi per controllare eventuali problemi, ma questo processo è lento, soggettivo e irrealistico su larga scala. Nel frattempo, molti sistemi di IA moderni che analizzano le foto delle piante possono essere sorprendentemente accurati, ma restano opachi per gli utenti: forniscono un'etichetta di malattia senza alcuna spiegazione. Per gli agricoltori che devono prendere decisioni ad alto rischio su trattamenti, reimpianti o raccolta, affidarsi ciecamente a un algoritmo silenzioso è una proposta rischiosa.

Un modo più intelligente di leggere le immagini delle foglie

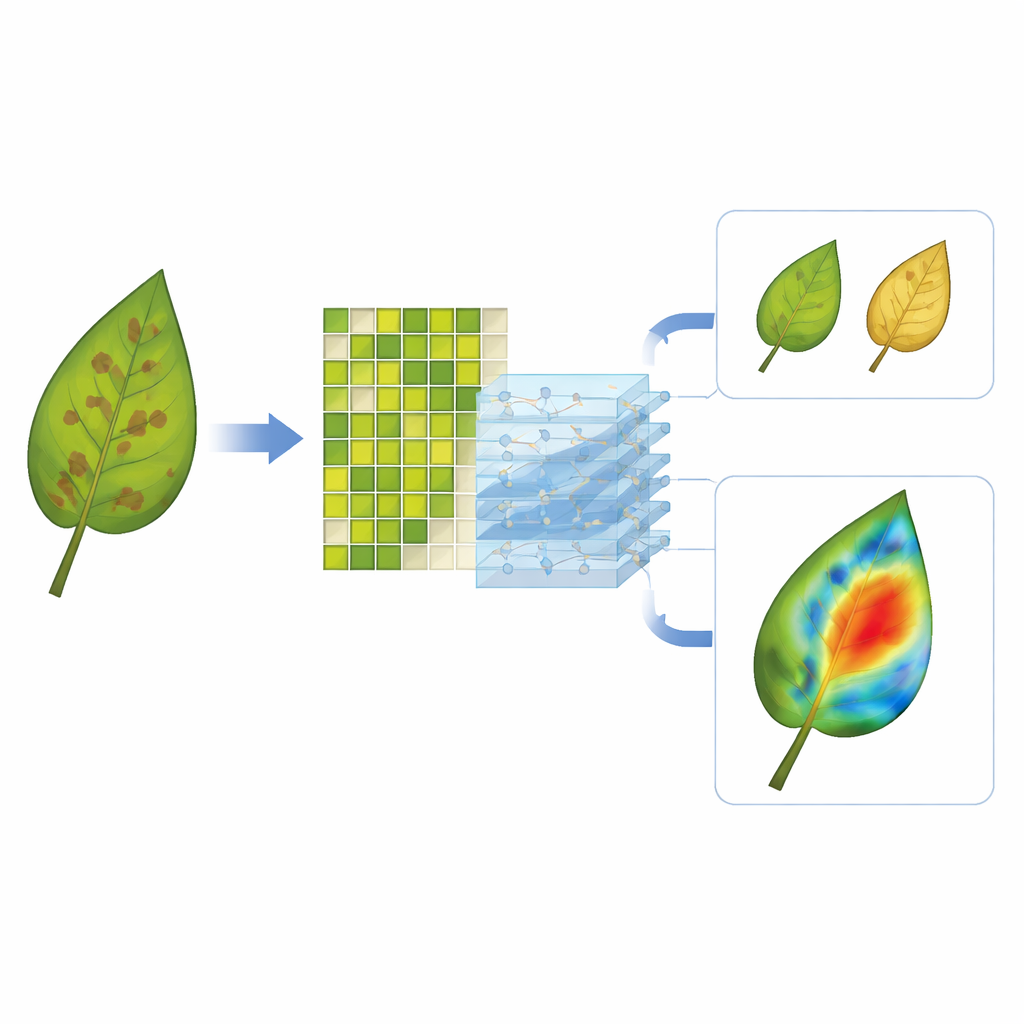

I ricercatori propongono un sistema di diagnosi automatica basato su un “vision transformer”, una famiglia relativamente nuova di modelli d'immagine che sta rimodellando la visione artificiale. Invece di scandagliare un'immagine con piccoli filtri scorrevoli, questo modello suddivide una foto della foglia in molte piccole patch e impara come tutte queste patch siano correlate tra loro contemporaneamente. Questa visione globale lo aiuta a rilevare segni di malattia sottili e sparsi che i metodi più vecchi potrebbero perdere. Per superare la solita necessità di set di addestramento enormi, il team parte da un modello già addestrato su milioni di immagini generali e poi affina i suoi strati finali su foglie di fagiolo, una strategia nota come transfer learning.

Trasformare scatole nere in scatole di vetro

Ciò che fa risaltare questo sistema non è solo quanto bene classifica le foglie come sane, Macchia Angolare o Ruggine del Fagiolo, ma quanto chiaramente mostra il proprio lavoro. Gli autori integrano una tecnica di spiegabilità chiamata GradCAM++, che trasforma i segnali interni del modello in una mappa di calore sovrapposta alla foto originale. Le regioni luminose sulla foglia corrispondono alle macchie e alle pustole che più hanno influenzato la decisione. Per le foglie malate, l'attenzione del modello si concentra sulle lesioni caratteristiche; per le foglie sane, distribuisce l'attenzione in modo più ampio anziché aggrapparsi a texture di sfondo casuali. Questo crea un ciclo di feedback visivo in cui agronomi e agricoltori possono verificare che il modello si stia focalizzando su sintomi reali piuttosto che su suolo, dita o artefatti della fotocamera.

Mettere il sistema alla prova

Per valutare le prestazioni, il team utilizza un dataset pubblico “I-Bean”, originariamente raccolto nei campi ugandesi e etichettato da esperti di salute delle piante. Ampliano notevolmente la porzione di addestramento ruotando, capovolgendo e modificando i colori delle immagini per simulare diversi angoli di ripresa e condizioni di illuminazione. Dopo aver perfezionato il modello su questo dataset arricchito e mantenuto fisso il suo estrattore di caratteristiche principale, lo valutano su un set di test intatto. Il sistema raggiunge circa il 97,5 percento di accuratezza, con punteggi altrettanto elevati per precisione, richiamo e una misura F1 combinata. La confusione tra i tre stati delle foglie è rara, suggerendo che il modello separa in modo affidabile le piante sane da ciascun tipo di malattia anche quando le differenze visive sono sottili.

Passi verso un'agricoltura più intelligente e più equa

Nonostante le prestazioni brillanti, l'approccio deve ancora affrontare ostacoli. I vision transformer sono computazionalmente pesanti, rendendo difficile eseguirli in tempo reale su smartphone a basso costo o droni senza ulteriori ottimizzazioni. Il dataset, sebbene aumentato, rappresenta solo tre stati di malattia e un intervallo limitato di condizioni di illuminazione estreme. Gli autori delineano direzioni future come comprimere il modello in modo che possa risiedere su dispositivi edge, espandere l'ambito a più malattie e sintomi da stress e esplorare varianti di transformer più leggere. Se queste sfide verranno affrontate, il risultato potrebbe essere un assistente portatile e affidabile che aiuta gli agricoltori di tutto il mondo a individuare precocemente le malattie, salvare i raccolti e gestire le risorse in modo più saggio—pur potendo sempre mostrare esattamente perché è giunto a quella conclusione.

Citazione: Potharaju, S., Singh, A., Singh, D. et al. An explainable vision transformer model with transfer learning for accurate bean leaf disease classification. Sci Rep 16, 10402 (2026). https://doi.org/10.1038/s41598-026-41723-9

Parole chiave: malattia delle foglie del fagiolo, rilevamento delle malattie delle piante, vision transformer, IA spiegabile, agricoltura di precisione