Clear Sky Science · it

Un sistema di visual servoing qualitativo HOG in tempo reale ottimizzato per sedie a rotelle autonome

Viaggi più intelligenti per chi ne ha più bisogno

Per molte persone che dipendono da sedie a rotelle elettriche, guidare attraverso corridoi affollati o marciapiedi irregolari può essere faticoso, stressante o persino impossibile senza assistenza. Questo articolo presenta un nuovo modo per una sedia a rotelle di “vedere” l’ambiente tramite una piccola telecamera e guidarsi da sola in modo fluido e sicuro in tempo reale, anche con hardware economico. Ridisegnando con cura il modo in cui l’informazione visiva viene elaborata e trasformata in movimento, l’autore dimostra che una navigazione intelligente della sedia a rotelle può funzionare su un piccolo computer a basso consumo mantenendo comunque il comfort e il controllo per l’utilizzatore.

Perché le sedie a rotelle tradizionali faticano nella vita reale

Le normali sedie a rotelle motorizzate sono generalmente pilotate direttamente con un joystick o si affidano a semplici sensori di urto per evitare ostacoli. Questi approcci spesso falliscono in spazi affollati e mutevoli come corridoi di ospedali, centri commerciali o marciapiedi cittadini. Gli utenti segnalano che ciò che desiderano di più è un movimento fluido e prevedibile e affidabilità in diverse condizioni di illuminazione, non la pura velocità. Allo stesso tempo, molti metodi robotici avanzati che usano telecamere e matematica complessa richiedono computer potenti, troppo costosi e ingombranti per l’uso quotidiano su una sedia a rotelle. Questo divario — tra ciò di cui gli utenti hanno bisogno e ciò che l’hardware a basso costo può sostenere — è esattamente ciò che lo studio mira a colmare.

Insegnare a una sedia a rotelle a leggere pattern invece che punti

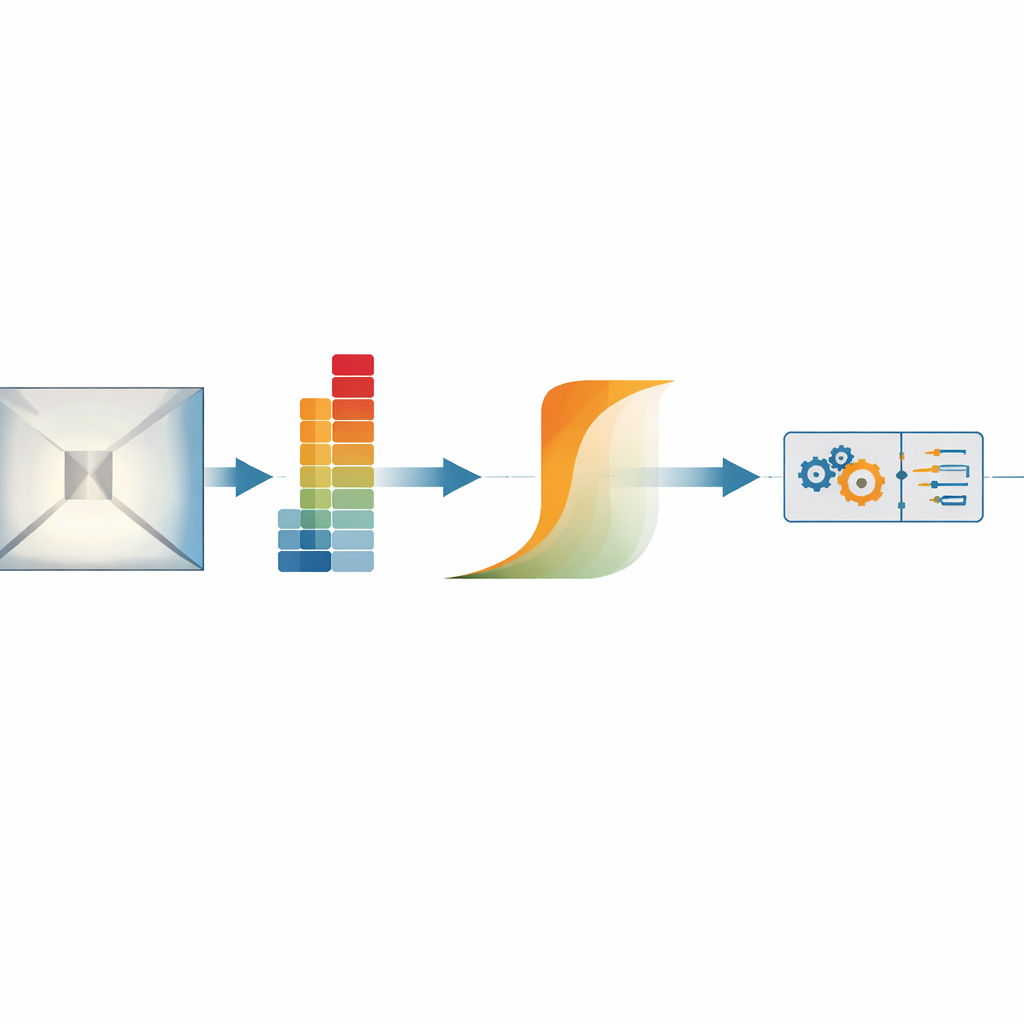

Il sistema utilizza una telecamera montata sulla sedia per osservare la scena davanti e rappresentarla non come singoli punti o reperi, ma come pattern di bordi e linee noti come istogrammi di gradienti. In termini semplici, analizza come cambia la luminosità nell’immagine e lo riduce a un’impronta compatta della scena. Questo tipo di descrizione dei pattern è naturalmente tollerante ai cambiamenti di luce e alle occlusioni parziali, come un passante che attraversa brevemente il campo visivo. La sedia confronta il pattern corrente con un pattern “obiettivo” corrispondente a una vista desiderata — per esempio l’aspetto di un corridoio dritto o un punto di riferimento alla fine di un percorso — e poi regola il movimento per far corrispondere i due pattern più da vicino.

Lasciare un margine di manovra per un controllo più sicuro

Piuttosto che insistere su una corrispondenza perfetta tra vista corrente e vista obiettivo, il metodo introduce una “zona di confidenza” flessibile. Se la vista della telecamera è sufficientemente vicina all’obiettivo, il sistema di controllo si rilassa deliberatamente, evitando correzioni nervose avanti e indietro. Questo viene ottenuto tramite una funzione di attivazione matematica che aumenta o diminuisce gradualmente la risposta dello sterzo in base all’entità dell’errore visivo, invece di spingere più forte ogni volta che esiste un errore. Di conseguenza, la sedia è in grado di gestire occlusioni parziali e incertezza visiva senza scatti improvvisi, mantenendo traiettorie morbide in compiti come seguire un corridoio o avvicinarsi a una sequenza di target visivi.

Far funzionare la visione avanzata su un computer minuscolo

Una sfida importante è che queste impronte visive ricche sono tipicamente costose da calcolare. L’autore affronta il problema riscrivendo i calcoli in modo da usare operazioni efficienti “tutte insieme” anziché cicli annidati lenti, riducendo la precisione dove non è necessaria e organizzando con cura l’uso della memoria. Eseguendo su un Raspberry Pi — un computer delle dimensioni di una carta di credito spesso usato in progetti hobbistici — il software migliorato aumenta la velocità di elaborazione da livelli inutilizzabili (circa un’immagine ogni 12 secondi) a circa cinque immagini e mezzo al secondo. I motori della sedia ricevono comandi a una frequenza molto più alta e costante, così le ruote si muovono in modo fluido mentre la telecamera e il sistema di visione si aggiornano in background. Sono previste ulteriori barriere di sicurezza, inclusi freni hardware e un watchdog che blocca la sedia se i comandi smettono di arrivare, per adattarsi all’uso assistivo reale.

Dalla teoria di laboratorio all’aiuto quotidiano

Attraverso esperimenti in corridoi, marciapiedi e test video controllati, il sistema sterza costantemente la sedia da un obiettivo visivo al successivo riducendo progressivamente le correzioni di sterzo man mano che si avvicina a ciascun target. L’errore di corrispondenza del pattern della telecamera diminuisce costantemente, confermando che la sedia si allinea visivamente senza perdere di vista caratteristiche importanti lungo il percorso. In termini semplici, lo studio mostra che un piccolo computer economico e una telecamera semplice sono sufficienti per fornire a una sedia a rotelle motorizzata un “pilota automatico” guidato dalla telecamera, che rispetta comfort e sicurezza. Questo apre la strada a ausili di navigazione basati su telecamere più accessibili per persone con mobilità ridotta e pone le basi per aggiornamenti futuri come una percezione 3D più ricca e un’elusione degli ostacoli ancora più fluida.

Citazione: Hafez, A.H.A. An optimized real-time qualitative HOG-based visual servoing system for autonomous wheelchair. Sci Rep 16, 8688 (2026). https://doi.org/10.1038/s41598-026-41566-4

Parole chiave: sedia a rotelle autonoma, robotica assistiva, visione artificiale, navigazione visiva, controllo in tempo reale