Clear Sky Science · it

Predizione, sintassi e ancoraggio semantico nel cervello e nei grandi modelli linguistici

Come il tuo cervello indovina la parola successiva

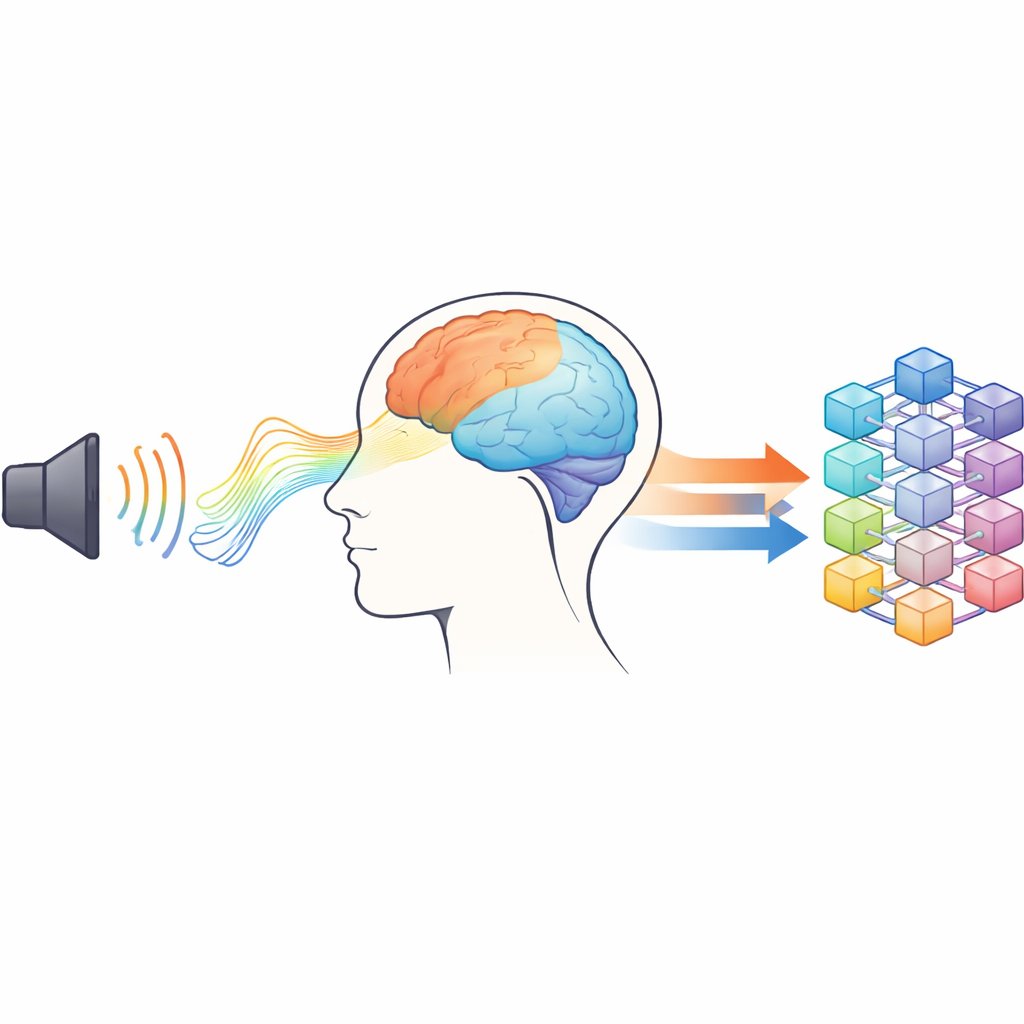

Quando ascolti una storia, spesso sembra facile seguirla—ma sotto la superficie il tuo cervello continua a ipotizzare cosa verrà dopo. Allo stesso tempo, i sistemi di intelligenza artificiale moderni come i grandi modelli linguistici (LLM) prevedono le parole successive per generare testo fluente. Questo studio mette insieme questi due mondi, chiedendosi come il cervello umano anticipi le parole in tempo reale e come questi processi si confrontino con il funzionamento di un avanzato modello di IA.

Ascoltare una storia in laboratorio

Per studiare la comprensione del linguaggio naturale, i ricercatori sono andati oltre elenchi artificiali di parole o frasi brevi e isolate. Invece, 29 giovani adulti volontari hanno ascoltato circa 50 minuti di un audiolibro di fantascienza in tedesco mentre veniva registrata la loro attività cerebrale. Sono state usate contemporaneamente due tecniche complementari: l’elettroencefalografia (EEG), che misura piccole variazioni di tensione sul cuoio capelluto, e la magnetoencefalografia (MEG), che rileva i campi magnetici generati dall’attività cerebrale. Insieme, questi metodi possono tracciare le risposte del cervello a ciascuna parola con precisione millisecondo mentre le persone seguono una trama continua.

Seguire diversi tipi di parole

L’audiolibro è stato automaticamente suddiviso in parole singole e etichettato per tipo grammaticale: sostantivi (ad esempio “pianeta”), verbi (ad esempio “correre”), aggettivi (ad esempio “oscuro”) e nomi propri. Per ogni parola della storia, gli scienziati hanno estratto una breve finestra temporale dei segnali EEG e MEG prima e dopo la pronuncia della parola e poi hanno mediato questi segmenti all’interno di ciascuna classe di parola. Ciò ha rivelato “firme” elettriche e magnetiche affidabili per i diversi tipi di parola, inclusi componenti ben noti legati al significato e alla struttura della frase. È importante che il team abbia osservato che l’attività relativa ai sostantivi iniziava ad accumularsi già prima che la parola effettivamente cominciasse, suggerendo che il cervello era particolarmente pronto per questo tipo di parola nel contesto.

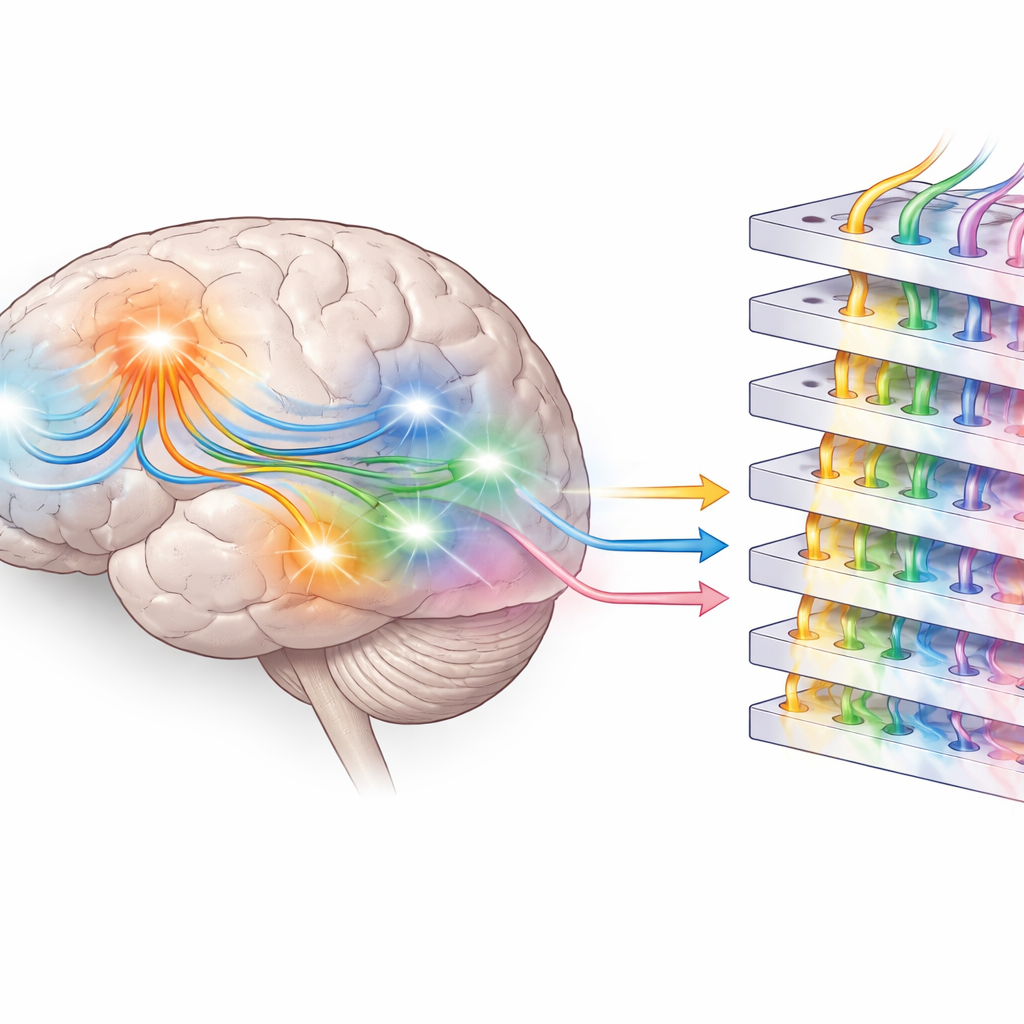

Dove il significato incontra il movimento

Per vedere dove nel cervello emergessero questi segnali, i ricercatori hanno usato modelli computazionali per stimare le probabili sorgenti dei pattern MEG e EEG all’interno della testa. I sostantivi non attivavano solo le classiche aree del linguaggio nei lobi temporali; coinvolgevano anche aree compatibili con parti del sistema sensorimotorio, vicino a regioni implicate nel movimento e nelle sensazioni corporee. I verbi, al contrario, mostravano uno schema diverso e più limitato. Questo supporta l’idea di un linguaggio “incarnato”, in cui la comprensione di una parola—specialmente un sostantivo concreto—riattiva parzialmente reti legate alla percezione e all’azione, ancorando il significato a esperienze sensoriali passate piuttosto che a regole astratte soltanto.

Confrontare i cervelli e i grandi modelli linguistici

Il gruppo si è poi rivolto al modello linguistico Llama 3.2 di Meta per avere un riferimento computazionale. Prima hanno testato la “predizione semantica” fornendo al modello il contesto precedente dall’audiolibro e chiedendo quanto fosse probabile, secondo il modello, la parola reale successiva. I sostantivi si sono dimostrati i più facili da predire, coerentemente con il loro ruolo centrale nella costruzione della storia. Successivamente, i ricercatori hanno esplorato la “predizione sintattica” esaminando le attivazioni interne, o embedding, all’interno di Llama. Anche senza un addestramento aggiuntivo, gli strati nascosti del modello raggruppavano naturalmente le parole in base al tipo grammaticale della parola seguente, e una semplice rete di probe poteva spesso indicare quale classe di parola sarebbe venuta dopo. Attraverso gli strati, la struttura interna per i nomi propri e i sostantivi diventava più distinta, riecheggiando la crescente separazione dei ruoli osservata nei pattern di attività cerebrale.

Due tipi di prontezza per le parole

Nel complesso, i risultati suggeriscono che il cervello si prepara al linguaggio in arrivo su almeno due livelli. Nelle regioni temporali, l’attività prima dell’inizio della parola sembra riflettere una sorta di prontezza grammaticale o “sintattica”—conoscenza di dove certi tipi di parole tendono a comparire in una frase. Nelle regioni più frontali e sensorimotorie, i pattern di prontezza sembrano portare aspettative “semantiche” più ricche legate al significato e all’esperienza, soprattutto per sostantivi e nomi propri. I grandi modelli linguistici, addestrati solo a prevedere la parola successiva, sviluppano proprie strutture interne stratificate che in parte rispecchiano queste distinzioni, ma mancano di un ancoraggio diretto nel mondo fisico. Combinando registrazioni cerebrali ad alta velocità con analisi di IA all’avanguardia, questo lavoro aiuta a chiarire come gli esseri umani anticipano le parole durante l’ascolto quotidiano e quanto lontano siano arrivate le macchine odierne nell’approssimare quella caratteristica fondamentale della comprensione linguistica umana.

Citazione: Kölbl, N., Rampp, S., Kaltenhäuser, M. et al. Prediction, syntax and semantic grounding in the brain and large language models. Sci Rep 16, 8728 (2026). https://doi.org/10.1038/s41598-026-41532-0

Parole chiave: predizione linguistica, cervello e IA, grandi modelli linguistici, ancoraggio semantico, EEG MEG linguaggio