Clear Sky Science · it

Un nuovo ibrido leggero CNN–ViT per la classificazione delle malattie delle foglie di mais

Aiutare gli agricoltori a individuare prima le piante di mais malate

Il mais alimenta persone, animali e persino i nostri veicoli. Ma infezioni nascoste sulle sue foglie possono ridurre silenziosamente rese e mezzi di sostentamento. Questo studio presenta un sistema intelligente e leggero di visione artificiale che individua automaticamente le malattie nelle piante di mais, anche in immagini di campo disordinate e realistiche. Combinando due diversi tipi di intelligenza artificiale e ottimizzandoli per dispositivi a basso costo, i ricercatori mostrano come un giorno gli agricoltori potrebbero usare telefoni, droni o telecamere semplici per monitorare rapidamente e con precisione la salute delle colture.

Perché è difficile individuare le malattie del mais

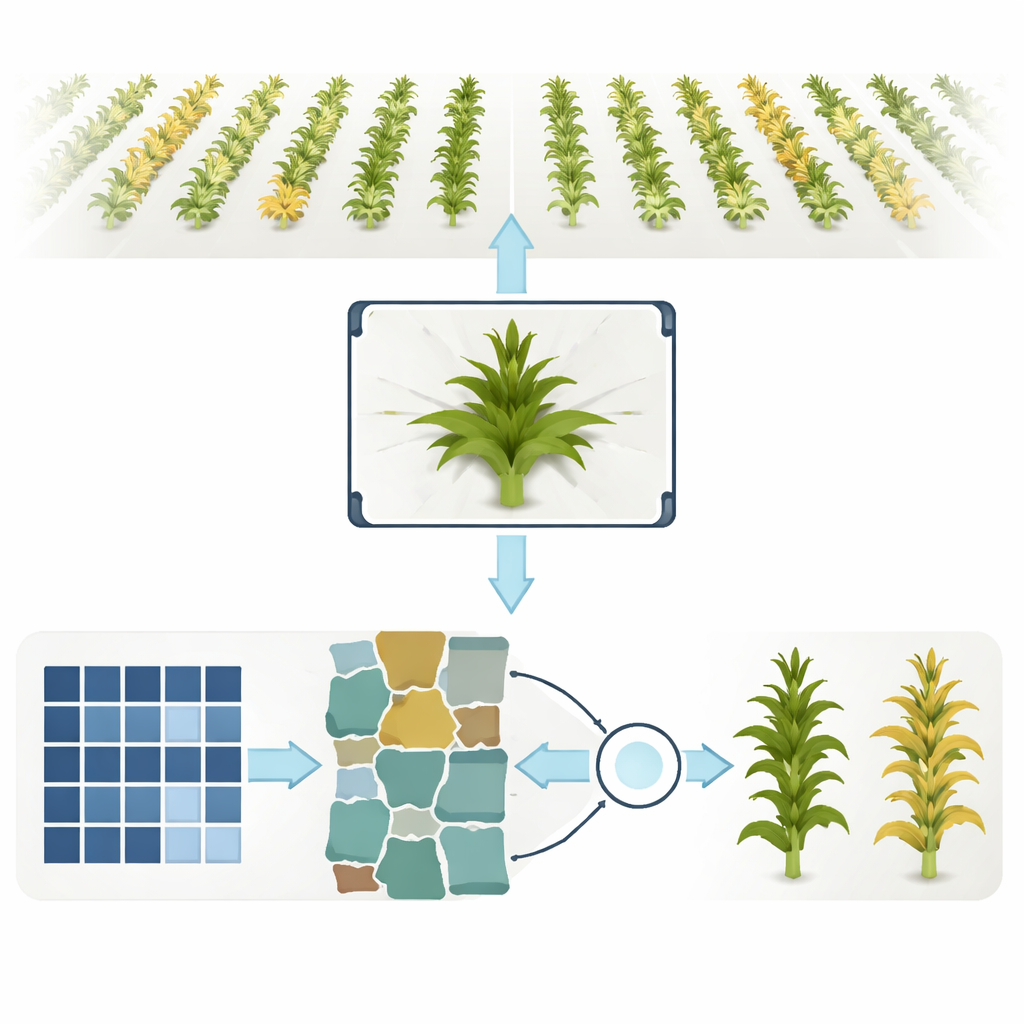

Nei campi reali, le piante di mais raramente si mostrano in posa ordinata per la fotocamera. Le foglie si sovrappongono, l’illuminazione varia e il suolo o i vasi confondono lo sfondo. Gli esperti che camminano tra i filari possono non notare sintomi precoci e sottili, e il loro tempo è limitato. Molti strumenti esistenti basati su immagini sono addestrati su foto idealizzate che mostrano una singola foglia su uno sfondo uniforme—molto diverso dall’intreccio di foglie che un drone o una camera fissa osservano davvero. Questa discrepanza fa sì che gli algoritmi attuali spesso fatichino una volta usciti dal laboratorio, soprattutto quando devono anche funzionare su hardware modesto come telefoni cellulari o piccoli dispositivi edge.

Due modi in cui le macchine “vedono” e perché si servono a vicenda

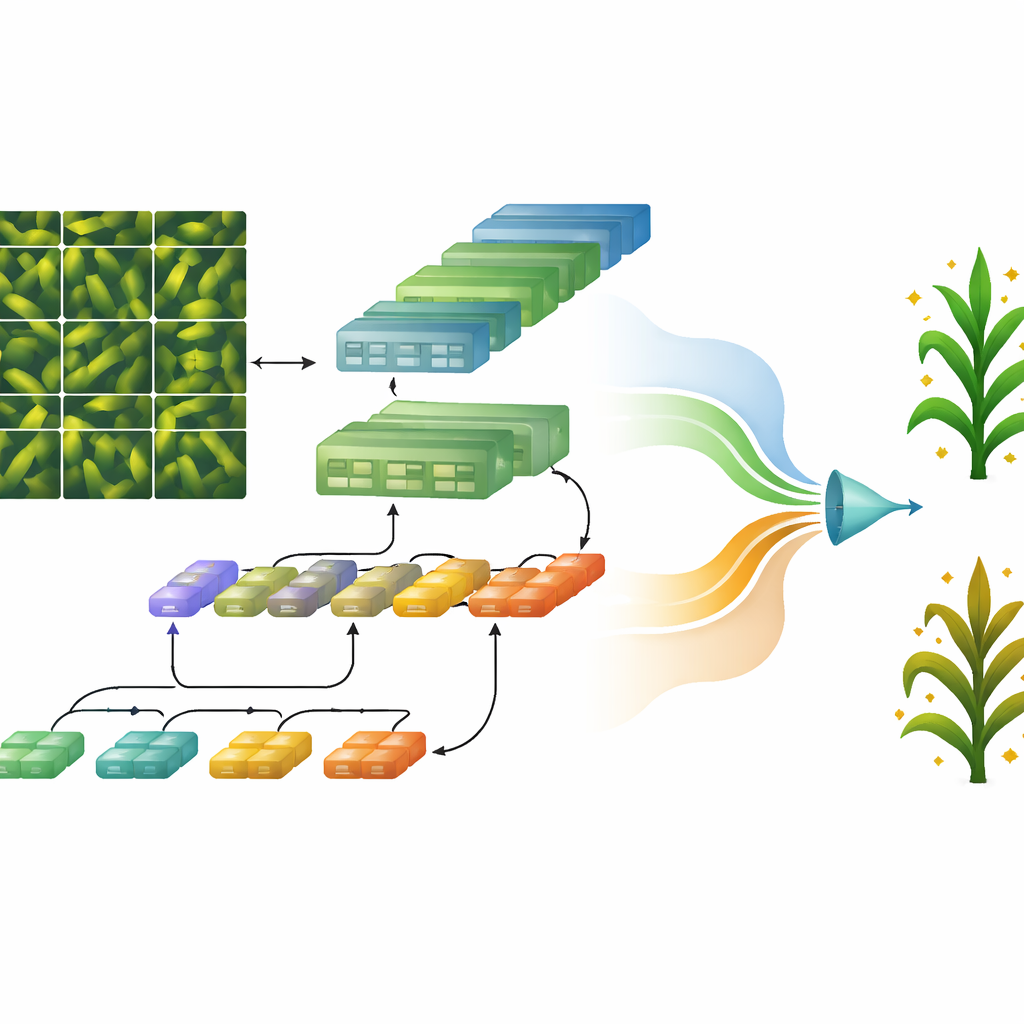

I moderni sistemi di riconoscimento delle immagini tendono a basarsi o su reti neurali convoluzionali o su una famiglia più recente chiamata vision transformer. Le reti convoluzionali eccellono nel captare dettagli fini come bordi e macchie in piccole aree dell’immagine, il che le rende adatte a individuare indizi locali di malattia. I transformer, invece, sono più abili a comprendere il quadro generale—come i pattern si relazionano attraverso parti distanti dell’immagine—ma richiedono tipicamente set di addestramento molto grandi e computer potenti. Usati separatamente, entrambi gli approcci hanno limiti: le convoluzioni possono perdere il contesto a lungo raggio, mentre i transformer possono essere troppo pesanti e bisognosi di dati per l’uso quotidiano in campo.

Un modello leggero a “squadra di esperti”

I ricercatori hanno progettato un modello ibrido, chiamato MXiT, che combina intenzionalmente questi due modi di vedere. Le immagini delle piante in ingresso vengono prima suddivise in patch sovrapposte in modo da preservare le piccole texture. Un percorso nella rete usa strati convoluzionali per concentrarsi sulle texture locali e sui dettagli delle foglie; un altro percorso utilizza un meccanismo di attenzione semplificato ispirato ai transformer per catturare la struttura globale dell’intera chioma. Una semplice unità di gating decide quindi, per ogni immagine, quanto affidarsi all’“esperto dei dettagli locali” rispetto all’“esperto del contesto globale”, fondendo le loro uscite in un’unica previsione sullo stato di salute della pianta. Fondamentalmente, il componente di attenzione è snellito e ottimizzato in modo che il sistema complessivo impieghi pochi parametri e relativamente poca potenza di calcolo, rendendolo adatto per dispositivi portatili.

Test su dataset realistici e di riferimento

Per valutare l’efficacia del modello al di fuori delle condizioni ideali, il team si è basato su un dataset impegnativo di immagini zenitali del mais noto come PlantScanner. Ogni fotogramma mostra l’intera pianta dall’alto, con molte foglie sovrapposte e variazioni naturali di forma. Una pianta è etichettata come “infetta” se una qualsiasi foglia mostra sintomi di un fungo chiamato Ustilago maydis. Lo stesso modello è stato valutato anche su una raccolta di riferimento ben nota di foto di foglie di mais chiamata PlantVillage, che include diversi tipi di malattia oltre alle foglie sane. In entrambi i dataset, MXiT è stato addestrato da zero e confrontato con modelli leggeri e basati su transformer affermati, come MobileViT, PiT, EdgeNeXt e DeiT.

Precisione quasi perfetta con meno potenza di calcolo

Sul impegnativo dataset PlantScanner, MXiT ha raggiunto circa il 99,9% di accuratezza usando meno parametri e con un costo computazionale inferiore rispetto ai concorrenti. Ha convergito rapidamente durante l’addestramento e ha mostrato comportamento stabile, a differenza di alcune alternative la cui accuratezza oscillava o era in ritardo nonostante dimensioni maggiori. Sul benchmark PlantVillage, il modello ibrido ha nuovamente ottenuto un’elevata accuratezza con l’ingombro più piccolo tra i sistemi migliori. Le visualizzazioni delle aree su cui i diversi modelli “guardano” nelle immagini hanno rivelato che MXiT si concentrava costantemente su regioni biologicamente significative—tessuto fogliare stressato e centri delle piante—mentre altri modelli spesso disperdevano attenzione sul suolo o sullo sfondo, suggerendo che il design ibrido non è solo accurato ma anche più interpretabile.

Cosa significa questo per il futuro della cura delle colture

Per un pubblico non specialista, il messaggio centrale è semplice: permettendo a due sistemi di visione complementari di lavorare insieme e condividere il carico in modo efficiente, MXiT può individuare la malattia delle foglie di mais in immagini realistiche da campo con affidabilità quasi perfetta, senza necessitare di un supercomputer. Questo tipo di modello compatto e preciso potrebbe alimentare strumenti pratici eseguibili su droni, trattori o smartphone, fornendo agli agricoltori avvisi precoci prima che i problemi si diffondano. Pur concentrandosi attualmente sullo stato sano o malato della pianta, lo stesso approccio potrebbe essere esteso per stimare la gravità dell’infezione, aprendo la strada a una gestione delle colture più intelligente, più precisa e meno dipendente dai trattamenti chimici negli anni a venire.

Citazione: Mehdipour, S., Mirroshandel, S.A. & Tabatabaei, S.A. A novel lightweight hybrid CNN–ViT for maize leaf disease classification. Sci Rep 16, 10468 (2026). https://doi.org/10.1038/s41598-026-41190-2

Parole chiave: rilevamento delle malattie delle foglie di mais, trasformatore ibrido CNN, fenotipazione delle piante, agricoltura di precisione, deep learning leggero