Clear Sky Science · it

Classificazione pan‑cancer delle sezioni congelate tramite un Vision Transformer con miscela morbida di esperti in supervisione debole

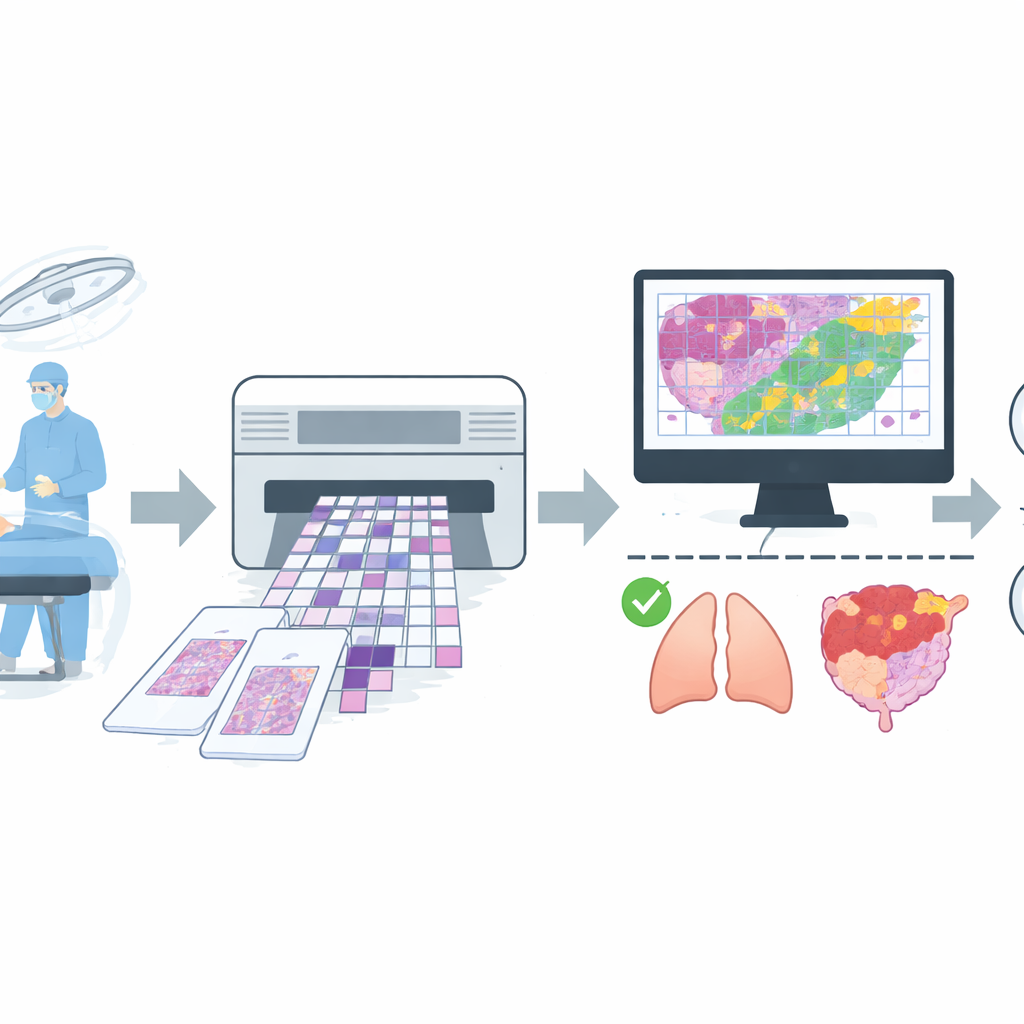

Perché è importante in sala operatoria

Quando i chirurghi asportano un presunto tumore, spesso hanno solo pochi minuti per stabilire se tutto il tessuto maligno è stato rimosso. I patologi si affrettano a esaminare una sottile fetta di tessuto rapidamente congelata e a fornire una risposta mentre il paziente è ancora in sala operatoria. Questo processo ad alta pressione può essere ostacolato da vetrini sfocati, tumori poco evidenti e semplici limiti di tempo. Lo studio descritto qui esplora come un sistema di intelligenza artificiale (IA) possa aiutare i patologi a distinguere rapidamente e in modo affidabile tessuto innocuo da tessuto pericoloso in molti organi diversi, utilizzando apparecchiature realistiche per gli ospedali di tutti i giorni.

Un test rapido con difficoltà intrinseche

L’analisi delle sezioni congelate è una pratica consolidata nella chirurgia moderna: un sottile frammento di tessuto viene congelato, affettato, colorato e osservato al microscopio per valutare se sia benigno o maligno e se il margine chirurgico sia libero. A differenza dei vetrini permanenti di laboratorio, le sezioni congelate spesso presentano crepe, pieghe e colorazioni irregolari. Diversi patologi possono non concordare nei casi borderline e il tempo è sempre un fattore critico. Questi problemi sono particolarmente seri negli ospedali più piccoli o molto affollati, dove pochi specialisti devono coprire molti tipi di tumore. Gli autori sostengono che un assistente informatico robusto potrebbe rendere le decisioni sulle sezioni congelate più consistenti, più rapide e più ampiamente disponibili.

Costruire un ampio insieme di immagini reali

Per addestrare un tale assistente, il team ha raccolto una grande collezione di immagini digitali provenienti da operazioni di routine in un ospedale importante. Hanno raccolto 4.754 immagini a vetrino intero (whole‑slide) di tessuto congelato da oltre 2.600 pazienti, quindi hanno applicato regole di qualità rigorose per rimuovere vetrini con artefatti gravi o diagnosi incerte. Il dataset finale conteneva 4.667 vetrini, ciascuno etichettato semplicemente come benigno o maligno sulla base dell’accordo tra la lettura rapida della sezione congelata e il successivo referto più accurato della sezione permanente. I vetrini includevano sedi comuni come polmone, seno, tiroide, linfonodi e organi riproduttivi femminili, oltre a un gruppo misto di localizzazioni meno frequenti come stomaco, fegato e pelle. I dati sono stati suddivisi in gruppi separati per addestramento, messa a punto e test finale, curando che le immagini dello stesso paziente non comparissero in più di un gruppo.

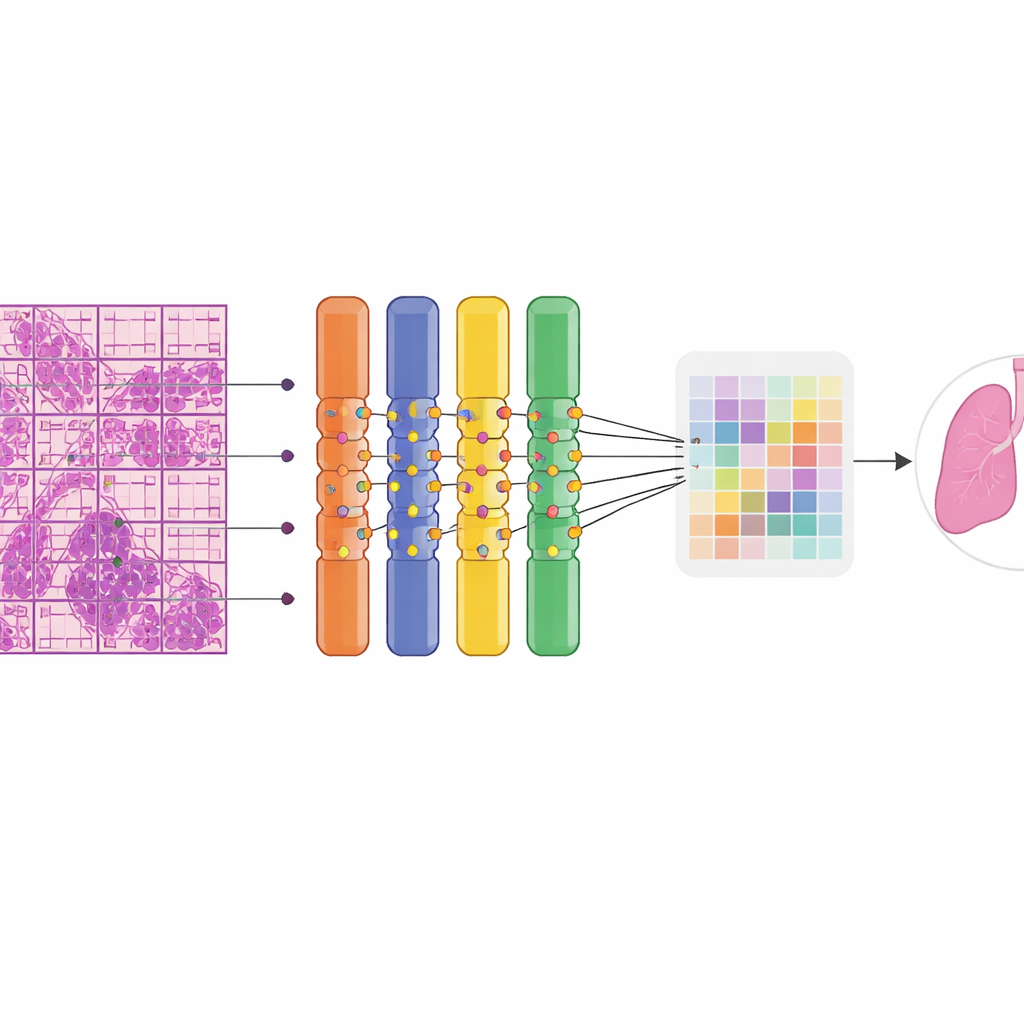

Come l’IA apprende da indizi deboli

I ricercatori hanno costruito il loro modello su una classe di reti neurali chiamata Vision Transformer, particolarmente adatta a individuare schemi su immagini di grandi dimensioni. Ogni immagine tissutale molto ampia è stata automaticamente suddivisa in molte tessere e patch più piccole per poter essere processata su hardware grafico standard. Un’innovazione chiave è stata la sostituzione di una parte della rete con una “miscela morbida di esperti”, un insieme di molti rami specialistici di piccole dimensioni che si focalizzano su differenti pattern visivi. Piuttosto che attivare o disattivare singoli esperti, il sistema fonde in modo continuo i loro contributi, stabilizzando l’addestramento e sfruttando meglio dati limitati. Poiché i patologi non tracciavano contorni attorno ai tumori, il modello ha dovuto imparare con supervisione debole: sapeva solo se l’intero vetrino fosse benigno o maligno. Una strategia di multiple‑instance learning ha promosso le patch più sospette all’interno di un vetrino maligno come esempi positivi, permettendo alla rete di concentrarsi gradualmente sulle regioni più informative.

Quanto funziona il sistema nella pratica

Testato su 669 vetrini non visti in precedenza, l’IA ha distinto tessuto benigno da maligno con alta accuratezza. Ha classificato correttamente circa il 90% dei casi nel complesso e ha mostrato un’eccellente capacità di separare i due gruppi attraverso le soglie di probabilità. La sensibilità, la probabilità di segnalare correttamente un vetrino davvero maligno, è stata intorno a quattro casi su cinque, mentre la specificità, la probabilità di identificare correttamente un vetrino benigno, è risultata ancora più alta. È importante che le prestazioni siano rimaste elevate tra gli organi: il sistema ha rilevato perfettamente tutti i casi maligni di polmone e seno presenti nel set di test e ha funzionato bene anche su gruppi più rari come i tumori adnexali femminili e gli organi “altri” misti. Le mappe di calore a colori sovrapposte ai vetrini hanno rivelato che l’attenzione del modello si concentrava su regioni riconosciute dai patologi esperti come tumorali, incluse metastasi nei linfonodi, mentre ignorava in gran parte strutture normali. Il sistema è risultato efficiente nell’esecuzione, richiedendo meno di 5 GB di memoria, rendendolo adatto all’uso su schede grafiche comunemente disponibili piuttosto che su costosi cluster.

Limiti, errori e margini di miglioramento

Gli autori hanno anche esaminato i casi in cui l’IA ha fallito. I falsi negativi spesso coinvolgevano cellule tumorali estremamente sparse, aree di scansione sfocate o infiammazione intensa che mascherava i nidi maligni. I falsi positivi tendevano a verificarsi in condizioni benigne che imitano il cancro al microscopio, come iperplasia reattiva o tessuto congelato distorto. Poiché i flussi di lavoro chirurgici di routine non includono contorni dettagliati delle regioni tumorali, il team non ha potuto quantificare esattamente quanto le mappe di calore corrispondessero alle marcature degli esperti, facendo affidamento invece su una revisione qualitativa. Alcuni tipi di organo, come lingua o certi tumori dei tessuti molli, sono rimasti sotto‑rappresentati, suggerendo che saranno necessarie raccolte più ampie e multicentriche per estendere la portata del sistema.

Cosa potrebbe significare per pazienti e ospedali

Nel complesso, lo studio dimostra che un sistema di IA progettato con cura può assistere in modo accurato e interpretabile in un compito fondamentale della patologia chirurgica: decidere, in tempo reale, se il tessuto è benigno o maligno in molti tipi di organo. Operando solo con etichette a livello di vetrino, funzionando su hardware ampiamente disponibile e evidenziando le aree sospette per la revisione umana, il modello offre una strada pratica verso decisioni sulle sezioni congelate più coerenti. Per i pazienti, questo potrebbe tradursi in interventi chirurgici meglio informati in un’unica operazione; per gli ospedali, specialmente quelli con personale esperto limitato, indica un futuro in cui strumenti digitali avanzati aiutano a fornire cure oncologiche di alta qualità in modo più equo.

Citazione: Wu, J., Yang, M., Li, J. et al. Pan-cancer frozen section classification using a soft mixture of experts vision transformer under weak supervision. Sci Rep 16, 10297 (2026). https://doi.org/10.1038/s41598-026-40924-6

Parole chiave: sezione congelata, patologia digitale, diagnosi del cancro, vision transformer, apprendimento debolmente supervisionato