Clear Sky Science · it

Intelligenza umana vs artificiale nella diagnosi di patologia orale: uno studio comparativo su ChatGPT, Grok e MANUS

Perché questo è importante per la tua prossima visita dal dentista

Quando un dentista individua una macchia sospetta nella bocca, la parola definitiva sul fatto che sia innocua o pericolosa proviene di solito da uno specialista che esamina il tessuto al microscopio. Questo lavoro è accurato, richiede tempo e in molte parti del mondo gli esperti non sono sufficienti. Questo studio pone una domanda attuale: i moderni sistemi di intelligenza artificiale possono aiutare a interpretare queste immagini microscopiche dei tessuti orali con una precisione vicina a quella degli specialisti umani, rendendo la diagnosi più rapida, più coerente e più accessibile?

Che cosa i ricercatori hanno deciso di testare

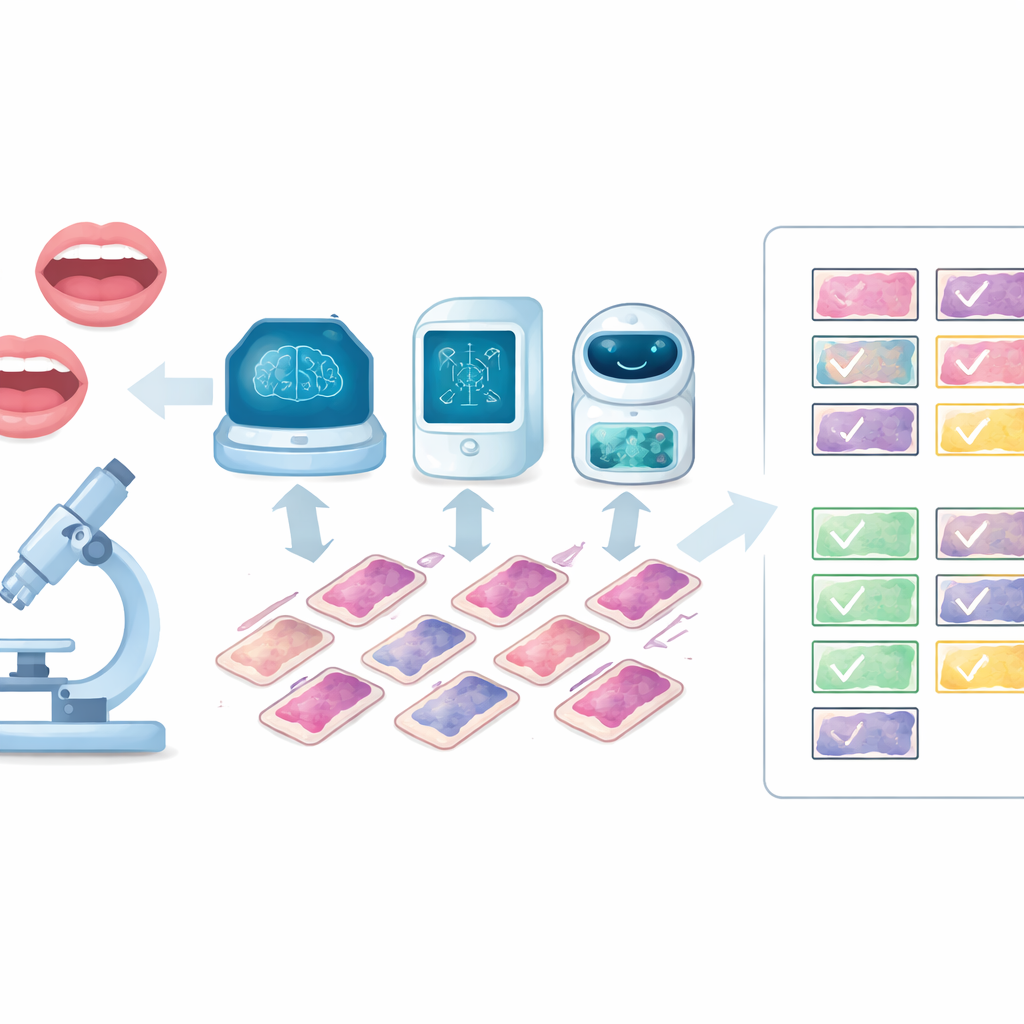

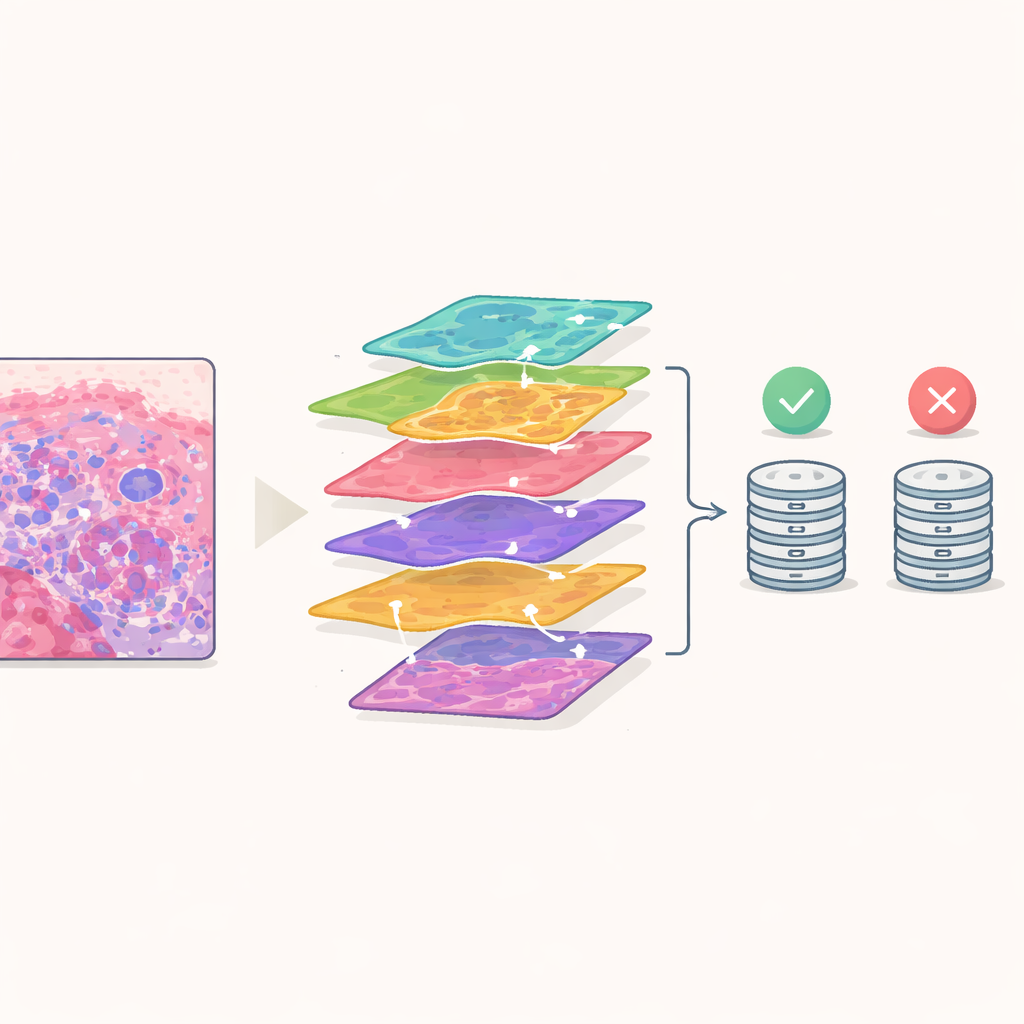

Il team si è concentrato su tre avanzati programmi informatici noti per comprendere sia immagini sia linguaggio: ChatGPT, Grok e un sistema medico chiamato MANUS. Invece di utilizzare dati reali di pazienti, hanno impiegato 100 immagini microscopiche nitide e di alta qualità tratte da un manuale standard sulle malattie della bocca. Ogni immagine mostrava un tipo diverso di lesione, che andava da precoci modificazioni precancerose a tumori, cisti e proliferazioni reattive. Due patologi orali esperti hanno prima concordato la diagnosi corretta per ogni vetrino, creando uno standard umano solido con cui confrontare le macchine.

Come è stato condotto il confronto diretto

Ognuno dei 100 vetrini è stato mostrato ai tre sistemi di IA usando lo stesso breve messaggio descrittivo del caso e la stessa immagine digitale. Ai modelli è stato chiesto di indicare la singola diagnosi più probabile, proprio come farebbe uno specialista nella stesura di un referto. Per verificare la stabilità delle risposte nel tempo, i ricercatori hanno ripetuto l’intero processo due settimane dopo con gli stessi vetrini e le stesse istruzioni. Nel frattempo, i due patologi hanno letto i vetrini in modo indipendente senza vedere i risultati dell’IA, quindi hanno discusso le eventuali differenze fino a concordare una decisione finale. Queste decisioni degli esperti sono state trattate come la migliore risposta disponibile.

Quanto hanno performato macchine e umani

Tutti e tre gli strumenti di IA si sono comportati in modo notevole. Nella seconda tornata di test, Grok ha identificato correttamente 97 casi su 100, MANUS 96 e ChatGPT 94. La coppia di specialisti umani ha ottenuto un punteggio leggermente superiore, classificando correttamente 98 vetrini. ChatGPT si è distinta per aver fornito risposte quasi identiche in entrambe le tornate, mostrando una forte coerenza interna, mentre MANUS e Grok hanno mostrato prestazioni solide e stabili. Quando i sistemi sono stati confrontati tra loro, concordavano nella stragrande maggioranza dei casi, il che suggerisce che progetti di IA diversi possono comunque giungere a giudizi molto simili se ricevono le stesse immagini di alta qualità.

Quanto l’IA si è allineata al ragionamento degli esperti

Raggiungere la risposta corretta è solo una parte della questione; conta anche se i computer tendono ad accordarsi con i modelli di ragionamento umani. In questo ambito MANUS ha mostrato l’allineamento più stretto con le decisioni dei patologi, anche quando non ha superato Grok in termini di accuratezza grezza. Grok, sebbene leggermente più accurato nel complesso, a volte ha preso decisioni diverse rispetto agli esperti nei pochi casi difficili. La maggior parte degli errori per tutti e tre i sistemi è comparsa in vetrini visivamente confusi anche per occhi addestrati, dove le modificazioni tissutali si sovrapponevano o risultavano borderline tra due condizioni. Tuttavia, non si sono evidenziate grandi differenze di prestazione tra i modelli, e tutti e tre hanno mostrato livelli di accordo con gli umani che gli autori descrivono come da moderati a sostanziali.

Cosa potrebbe significare per la cura futura

Lo studio suggerisce che gli attuali sistemi di IA multimodale sono già in grado di funzionare come assistenti affidabili nella diagnosi microscopica delle malattie orali. Non sostituiscono i patologi, che mantengono la migliore accuratezza complessiva e forniscono giudizio clinico essenziale, ma potrebbero fungere da second reader rapidi, supportare la formazione di nuovi specialisti o offrire assistenza a livello esperto in regioni con accesso limitato ai servizi di patologia dentale. Poiché la ricerca ha utilizzato immagini scelte con cura da testi didattici piuttosto che campioni clinici disordinati del mondo reale, gli autori sottolineano che sono necessari ulteriori test su raccolte cliniche più ampie e variegate e con informazioni aggiuntive sui pazienti. Se questi controlli successivi confermeranno le promesse iniziali, l’IA potrebbe rendere la diagnosi delle malattie della bocca più accurata, coerente e accessibile per i pazienti ovunque.

Citazione: Alshammari, A.F., Madfa, A.A. & Anazi, B.A. Human versus artificial intelligence in oral pathology diagnosis: a comparative study of ChatGPT, Grok, and MANUS. Sci Rep 16, 11057 (2026). https://doi.org/10.1038/s41598-026-40792-0

Parole chiave: patologia orale, patologia digitale, intelligenza artificiale, modelli linguistici di grandi dimensioni, diagnosi istopatologica