Clear Sky Science · it

Aprire la scatola nera: intelligenza artificiale interpretabile per l’analisi automatizzata della bioturbazione in carote e affioramenti

Scoprire indizi nascosti nel fango antico

Quando gli animali scavano nel fango molle del fondale marino, lasciano dietro di sé un labirinto di cunicoli che può conservarsi per milioni di anni. Questi motivi sottili, chiamati bioturbazione, aiutano i geologi a leggere gli ambienti passati e persino a individuare riserve di petrolio e gas. Ma individuare e classificare a occhio questi segni è un lavoro lento e soggettivo. Questo studio mostra come una nuova generazione di intelligenza artificiale “interpretabile” possa non solo automatizzare quel compito, ma anche rivelare esattamente cosa il computer sta guardando, trasformando una scatola nera in una di vetro.

Perché i cunicoli nella roccia contano

Molte decisioni geologiche partono ancora da un semplice sguardo: a scogliere, carote di perforazione e sezioni sottili di roccia. Il modo in cui gli strati sono disposti, quanto appaiono integri o disturbati e dove i cunicoli li attraversano suggeriscono profondità dell’acqua, energia, livelli di ossigeno e le creature che vi abitavano. I geologi spesso sintetizzano questo disturbo come intensità di bioturbazione, che va da strati intatti a sedimento completamente rimescolato. Queste graduazioni sono fondamentali per ricostruire antiche linee costiere e per valutare quanto facilmente i fluidi possono muoversi attraverso arenarie sepolte che possono fungere da serbatoi. Tuttavia anche gli esperti possono dissentire, specialmente nei casi al limite in cui la bioturbazione è moderata anziché chiaramente debole o intensa.

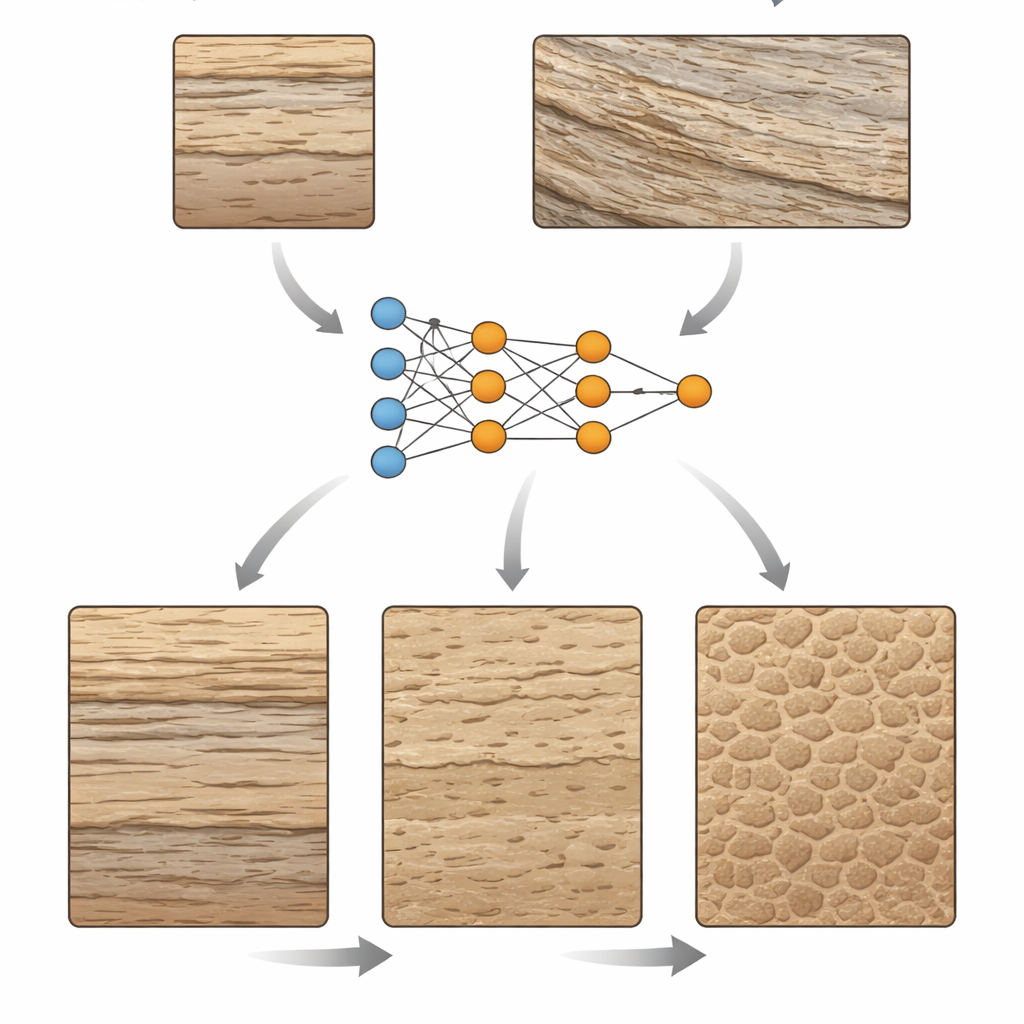

Insegnare a un computer a leggere le foto di roccia

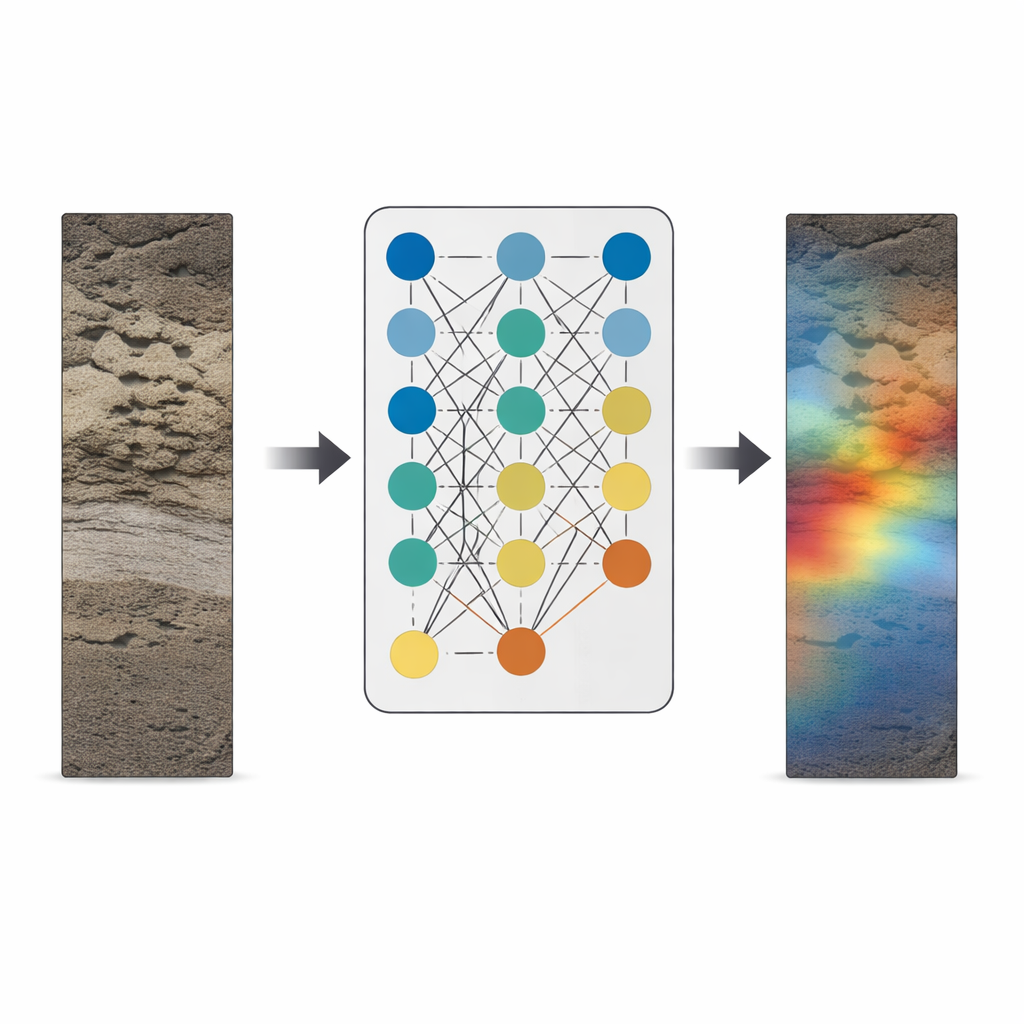

Gli autori si basano su un precedente modello di deep learning addestrato a classificare foto di carote e affioramenti di arenaria in tre ampie categorie di bioturbazione: non lavorata, moderatamente lavorata e intensamente lavorata. Il modello aveva già mostrato elevata accuratezza, classificando correttamente la maggior parte delle 262 immagini di test. In questo studio l’attenzione si sposta da “Quanto è performante?” a “Cosa sta effettivamente osservando?”. Per rispondere, il team utilizza strumenti di IA interpretabile che producono mappe di calore su ogni immagine, evidenziando le regioni che hanno influenzato maggiormente la scelta del modello. Le aree più rosse influiscono di più sulla decisione; i toni più freddi contano meno. Questo approccio permette ai geologi di confrontare l’attenzione visiva della macchina con quella di un ichnologo esperto — uno specialista di tracce fossili.

Come la scatola nera si illumina

Il metodo, noto come Grad-CAM, si collega agli strati finali della rete neurale, dove l’immagine è stata distillata in patch grossolane di caratteristiche. Quando il modello decide una classe, Grad-CAM misura quanto quella decisione sia sensibile a ciascuna patch, quindi proietta il risultato sull’immagine originale come una sovrapposizione colorata. Per le rocce non bioturbate, le mappe di calore tendono ad accendersi su patch di stratificazione ben conservata o su unità massive e indisturbate, talvolta evidenziando anche fratture naturali o ciottoli sparsi che risaltano rispetto a uno sfondo uniforme. Nelle immagini moderatamente bioturbate, le mappe solitamente si concentrano su singoli cunicoli o zone dove la stratificazione è parzialmente interrotta, corrispondendo strettamente a ciò che gli esperti umani cercherebbero su una pagina. Nei campioni intensamente lavorati, dove quasi tutta la struttura originale è cancellata, le mappe mostrano un motivo a macchie diffuso sull’immagine, rispecchiando il rimescolamento pervasivo del fondale antico.

Cosa sbaglia il modello — e perché

Poiché le spiegazioni sono visive, i ricercatori possono indagare gli errori del modello invece di limitarli a registrarli come fallimenti. Alcune immagini non lavorate sono state interpretate come bioturbate quando certi clasti o texture somigliavano per caso a cunicoli. In altri casi, tracce fossili piccole o molto deboli sono state trascurate, specialmente quando occupavano solo un angolo ridotto della foto. Anche strutture molto grandi hanno creato problemi: se un unico ampio cunicolo riempiva gran parte dell’inquadratura e i suoi dettagli interni erano attenuati, il modello lo trattava come una massa priva di caratteri piuttosto che come una traccia. È importante notare che le mappe di calore mostrano che il sistema generalmente ignora il disordine non geologico come segni di penna, tagli di sega e ombre, dimostrando che ha imparato a concentrarsi sui tessuti rocciosi piuttosto che sul rumore fotografico. Gli autori suggeriscono che immagini di addestramento più varie e di qualità superiore e una migliore copertura dei livelli d’intensità al limite migliorerebbero ulteriormente le prestazioni.

Da strumento per esperti a supporto didattico

Aprendo il funzionamento interno del modello all’ispezione, l’IA interpretabile aiuta a colmare il divario di fiducia tra geoscienziati e algoritmi. Lo studio mostra che l’attenzione della rete di solito si allinea al giudizio degli esperti, concentrandosi sugli stessi cunicoli e sulle stesse zone disturbate che un ichnologo formato evidenzierebbe. Questa trasparenza rende più facile adottare l’analisi automatizzata della bioturbazione nella ricerca e nell’industria, dove lo screening coerente e rapido di grandi librerie di immagini può far risparmiare tempo e ridurre i bias umani. Allo stesso tempo, le mappe di calore colorate fungono da strumento didattico, guidando lo sguardo degli studenti verso gli indizi testurali sottili che separano roccia non lavorata, moderatamente lavorata e completamente rimescolata. Trasformando decisioni invisibili del modello in pattern visibili, il lavoro indica un futuro in cui l’IA non sostituisce l’intuizione geologica, ma la affina e la rende scalabile.

Citazione: Ayranci, K., Yildirim, I.E., Yildirim, E.U. et al. Opening the black box: explainable AI for automated bioturbation analysis in cores and outcrops. Sci Rep 16, 9725 (2026). https://doi.org/10.1038/s41598-026-40747-5

Parole chiave: intelligenza artificiale interpretabile, bioturbazione, analisi di immagini geologiche, deep learning, carote sedimentarie