Clear Sky Science · it

Attribuzione della fotocamera sorgente mediante una rete neurale convoluzionale esplicabile basata su regole

Perché le tue foto possono rivelare più di quanto pensi

Ogni foto che scatti porta con sé indizi nascosti sulla fotocamera che l’ha catturata. Per gli investigatori digitali, questi indizi possono aiutare a confermare se un’immagine è autentica, risalire al dispositivo d’origine o collegare foto provenienti da scene del crimine diverse. Oggi strumenti di intelligenza artificiale (IA) potenti individuano questi schemi meglio degli esseri umani, ma spesso funzionano come misteriose “scatole nere”. Questo articolo presenta un modo per aprire quella scatola: un metodo basato su regole che spiega come un modello di deep learning decide quale fotocamera ha scattato un’immagine, in una forma che un esaminatore umano può comprendere e ritenere attendibile.

La sfida di fidarsi di strumenti forensi intelligenti

La moderna informatica forense digitale deve setacciare enormi volumi di dati — da smartphone, backup cloud e social media — ben oltre ciò che gli analisti umani possono esaminare manualmente. I sistemi di deep learning possono rapidamente segnalare immagini o suggerire quali siano rilevanti, ma il loro funzionamento interno è notoriamente opaco. In contesti sensibili come le aule di tribunale, dire semplicemente “la rete neurale lo indica” non basta. Gli strumenti di spiegazione esistenti solitamente evidenziano regioni dell’immagine che il modello ha ritenuto importanti, utile per compiti come riconoscere volti o oggetti. Tuttavia, per l’identificazione della fotocamera sorgente, il segnale cruciale non è una caratteristica visibile ma una firma del sensore molto debole — modelli di rumore sottili che le persone non vedono. Di conseguenza, gli strumenti visivi di spiegazione odierni non mostrano chiaramente perché un modello ritenga che un’immagine provenga da una fotocamera specifica, né aiutano gli esaminatori a individuare quando il modello si sbaglia.

Un nuovo modo di osservare il pensiero di una rete neurale

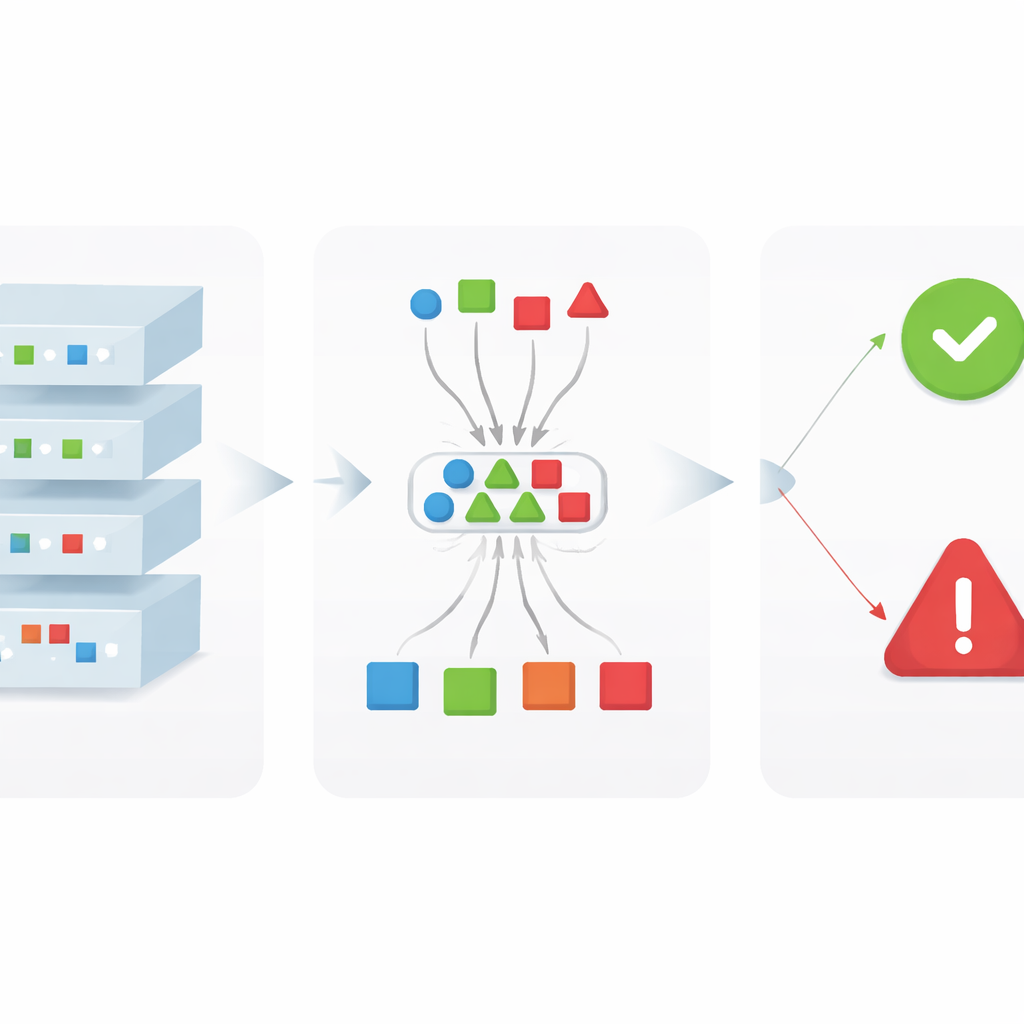

Gli autori presentano xDFAI, un framework progettato appositamente per la forense digitale che spiega come una rete neurale convoluzionale (CNN) arriva alle sue decisioni senza modificare il modello originale. Invece di trattare la rete come un’unica scatola opaca, xDFAI la esplora livello per livello. Per ogni livello e per ciascuna classe di fotocamera, identifica un insieme di pattern interni ricorrenti, chiamati “tracce”, che si attivano con coerenza quando il modello ritiene che un’immagine appartenga a quella fotocamera. Queste tracce vengono estratte da un modello addestrato usando metodi di attribuzione esistenti, quindi filtrate per mantenere solo i pattern che compaiono in modo affidabile su molte immagini di addestramento. Insieme, queste tracce formano una mappa strutturata di come gli indizi sull’identità della fotocamera evolvono mentre l’immagine attraversa la rete.

Lasciare che i livelli votino e trasformare i voti in regole

Una volta note le tracce, xDFAI le usa per esaminare immagini nuove e non viste. Per una foto di prova, il framework misura quanto le sue attivazioni interne somigliano alle tracce memorizzate per ciascuna fotocamera a ogni livello. Ogni livello esprime di fatto un voto per i modelli di fotocamera le cui tracce gli somigliano di più. Una “votazione” a maggioranza attraverso i livelli riepiloga quindi quanto fortemente la rete, nel suo insieme, supporti ciascun candidato. È fondamentale che gli autori non usino questo voto per sostituire la previsione del modello; invece lo impiegano come controllo. Regole logiche semplici confrontano la votazione di maggioranza con la previsione originale: se la fotocamera prevista riceve anche un forte supporto da molti livelli, la decisione viene confermata; se i voti sono dispersi o favoriscono una fotocamera diversa, il comportamento viene segnalato come anomalo e mostrato all’esaminatore come possibile errore del modello.

Mettere il framework alla prova

Per dimostrare xDFAI, gli autori lo applicano a una CNN a sette livelli addestrata a identificare quale dei 27 modelli di fotocamera ha catturato un’immagine, usando un noto dataset forense. La CNN di base da sola ottiene già ottime prestazioni, classificando correttamente circa il 97% delle immagini di test. Quando le regole di xDFAI vengono applicate in aggiunta, il sistema segnala automaticamente 27 delle 37 predizioni errate come sospette. I casi segnalati non vengono più contati come identificazioni sicure, il che aumenta la precisione — la frazione delle decisioni accettate che sono effettivamente corrette — dal 97,33% al 99,2%, riducendo solo leggermente l’accuratezza complessiva. Per il lavoro forense, dove una singola attribuzione errata può avere conseguenze serie, questo compromesso è altamente desiderabile: meno falsi allarmi tra le conclusioni che gli analisti scelgono di considerare attendibili.

Che cosa significa per le indagini nel mondo reale

Questo lavoro mostra che è possibile conservare tutta la potenza di un moderno modello di deep learning aggiungendo spiegazioni fruibili dagli umani che rispettino le regole di integrità forense — senza riaddestrare, senza manomettere il modello originale e senza affidarsi solo a mappe di calore vaghe. Esponendo tracce interne stabili, aggregandole tramite uno schema di voto trasparente ed esprimendo l’esito come regole semplici, xDFAI offre agli esaminatori un modo per confermare o mettere in dubbio le attribuzioni di fotocamera generate dall’IA. Sebbene lo studio si concentri sull’identificazione della sorgente della fotocamera, le stesse idee potrebbero essere estese ad altri compiti di attribuzione forense. A lungo termine, approcci come questo potrebbero contribuire a colmare il divario tra sistemi di IA altamente accurati e il livello di trasparenza e affidabilità richiesto nei tribunali e nella pratica investigativa.

Citazione: Nayerifard, T., Amintoosi, H. & Ghaemi Bafghi, A. Source camera attribution using a rule-based explainable convolutional neural network. Sci Rep 16, 9137 (2026). https://doi.org/10.1038/s41598-026-40387-9

Parole chiave: informatica forense digitale, IA spiegabile, identificazione della fotocamera, reti neurali convoluzionali, forense delle immagini