Clear Sky Science · it

Colorizzazione di immagini basata su deep transfer learning usando VGG19 e CLAHE

Ridare vita alle vecchie foto

Molti di noi conservano scatole di fotografie di famiglia in bianco e nero o apprezzano film classici e documentari d’epoca. Immaginare come apparivano quelle scene nella realtà—cieli azzurri, campi verdi, toni della pelle caldi—può rendere il passato più vicino e tangibile. Questo articolo esplora un nuovo metodo computazionale che aggiunge automaticamente colori realistici e un contrasto gradevole alle immagini in scala di grigi, facilitando il restauro di vecchie fotografie, il rinnovo di film in bianco e nero e persino il miglioramento di esami medici, senza richiedere a un esperto di dipingere manualmente ogni sfumatura.

Dalla pittura a mano alle macchine intelligenti

Colorizzare le immagini è più difficile di quanto sembri perché un singolo tono di grigio può corrispondere a molti colori possibili: un grigio medio potrebbe essere un mattone rosso, una foglia verde o una camicia blu. Gli strumenti più vecchi dipendevano molto dall’intervento umano. Gli artisti potevano tracciare rapide “sgrovigliamenti” di colore su parti dell’immagine e il software diffondeva quei suggerimenti nelle regioni simili. Altri sistemi prendevano i colori da una foto di riferimento con contenuto affine. Sebbene questi metodi potessero convincere, fallivano quando le indicazioni erano scarse, la foto di riferimento non era una corrispondenza perfetta o la scena era complessa. Con l’avvento del deep learning, nuovi programmi hanno imparato a “indovinare” i colori direttamente da grandi collezioni di esempi fotografici, riducendo il lavoro manuale ma richiedendo tempi di addestramento enormi e potenza di calcolo considerevole.

Insegnare a una rete com’è il mondo

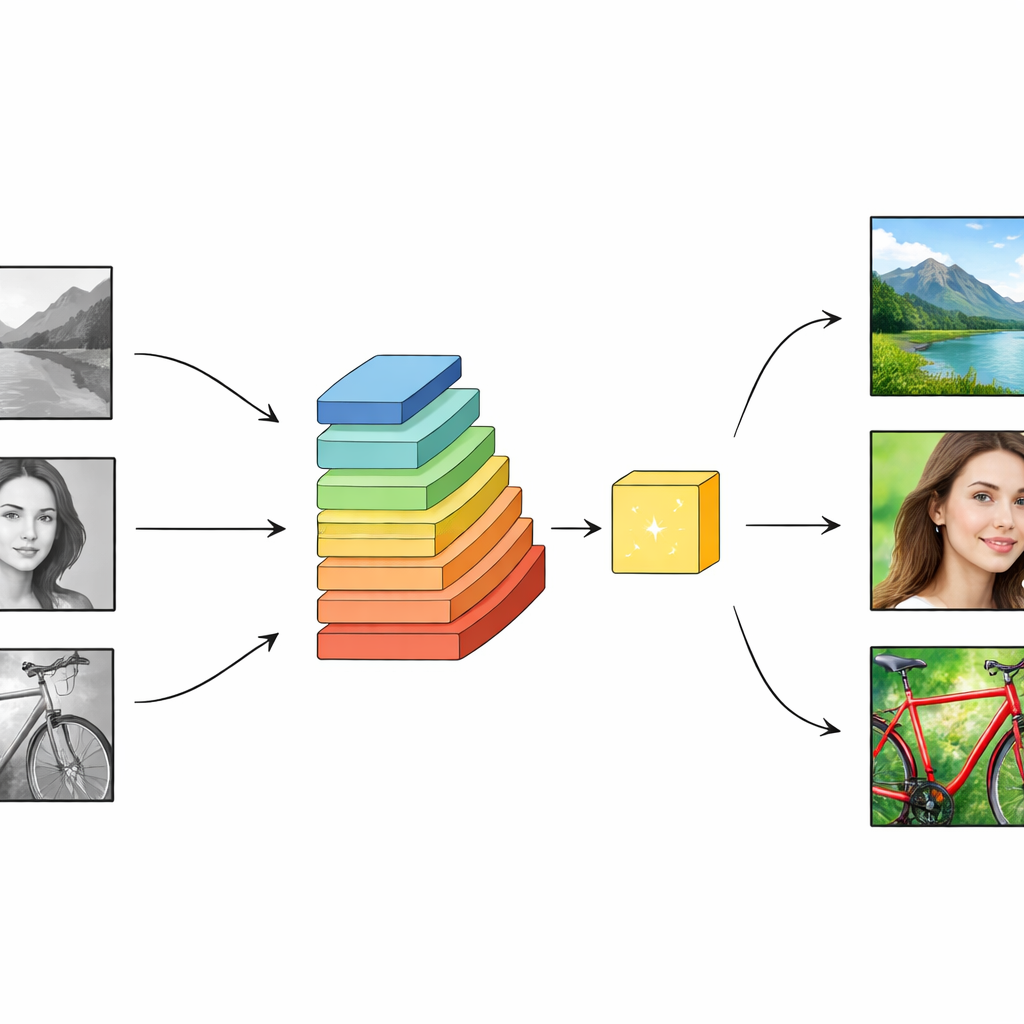

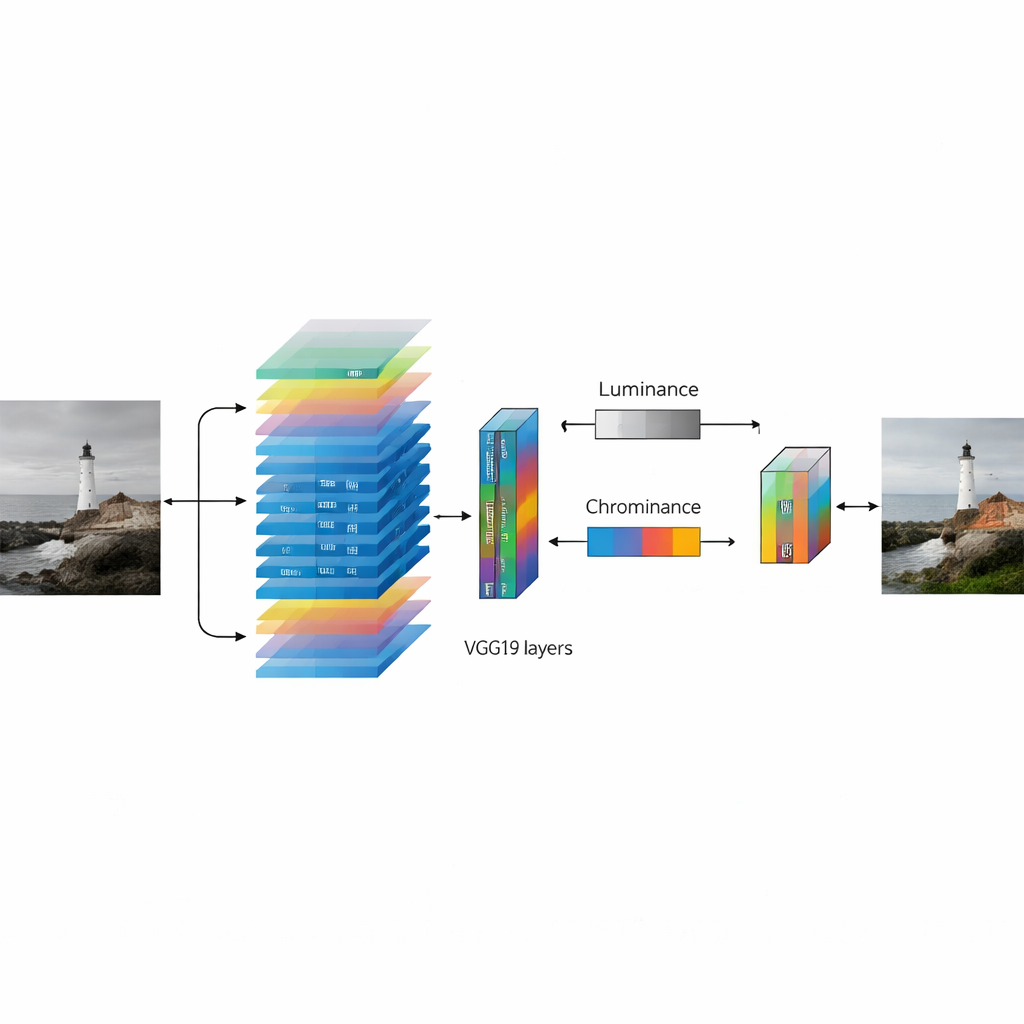

Gli autori si basano su questi progressi con una strategia nota come transfer learning. Invece di addestrare un sistema da zero, riutilizzano una potente rete di visione chiamata VGG19, già addestrata su milioni di immagini a colori. Questa rete ha molti strati che passano gradualmente da pattern semplici come bordi e texture a oggetti e scene complete: volti, alberi, edifici, cieli. Il sistema di colorizzazione fornisce a VGG19 una versione in scala di grigi dell’immagine e raccoglie caratteristiche da più livelli contemporaneamente, formando una ricca “impalcatura” di informazioni per ogni pixel. Questo aiuta il modello a comprendere sia i dettagli fini—come ciocche di capelli o bordi delle foglie—sia il contesto più ampio, per esempio se la scena è una spiaggia, una strada cittadina o una foresta. Con questo contesto, la rete è più orientata a scegliere colori credibili, non solo soluzioni matematicamente plausibili.

Trasformare luce e ombra in colore e contrasto

Per rendere le decisioni cromatiche più stabili, il metodo rappresenta le immagini in uno spazio colore che separa la luminanza dal contenuto cromatico. L’input in scala di grigi funge da canale di luminosità, mentre il compito della rete è predire i due canali restanti che codificano le sottili variazioni tra rosso e verde e tra blu e giallo. Mantenendo la luminosità fissa, il sistema conserva l’ombreggiatura e la struttura originali dell’immagine. Dopo che la rete produce la sua migliore stima delle informazioni cromatiche mancanti, si applica un passaggio finale di miglioramento. Qui gli autori usano una tecnica chiamata equalizzazione adattiva dell’istogramma, che allunga localmente l’intervallo tra zone scure e chiare. Questo rende le texture più nitide, i bordi più definiti e i colori più vividi, senza semplicemente “bruciare” le zone luminose o perdere dettagli nelle ombre.

Mettere il metodo alla prova

Per valutare l’efficacia del loro approccio, i ricercatori lo hanno addestrato e testato su diverse collezioni di immagini ben note che includono oggetti, scene, persone e ambienti quotidiani. Hanno confrontato i loro risultati con una varietà di metodi concorrenti, inclusi sistemi guidati da suggerimenti dell’utente, modelli generativi che cercano di inventare immagini realistiche e più recenti modelli basati su transformer. Usando misure standard di qualità dell’immagine, il loro metodo ha prodotto in modo consistente colori più nitidi e fedeli e strutture più chiare, con prestazioni particolarmente solide su un set di fotografie di scene particolarmente impegnativo. I confronti visivi mostrano che le loro immagini colorizzate spesso risultano più vicine alle foto a colori originali, con saturazione più ricca ma controllata e contrasto meglio bilanciato. Segnalano anche i limiti: immagini molto scure o eccessivamente luminose, o scene con texture insolite e colori rari, possono ancora generare tonalità strane o illuminazione disomogenea.

Cosa significa per le immagini di tutti i giorni

In termini semplici, questo studio dimostra che fornire a un sistema di colorizzazione una solida “educazione” preventiva sul mondo visivo—e poi migliorare attentamente il risultato—può produrre immagini che appaiono più naturali all’occhio umano. Appoggiandosi a una grande rete pre‑addestrata e aggiungendo un intelligente passaggio di potenziamento del contrasto, gli autori offrono uno strumento pratico in grado di ridare vita a fotografie storiche, arricchire film in bianco e nero e rendere più interpretabili alcuni tipi di immagini mediche. Pur non essendo perfetto e potendo incontrare difficoltà con illuminazioni estreme o scene molto insolite, questo approccio avvicina la colorizzazione automatica a una soluzione su cui i non esperti possono fare affidamento, rendendo i colori realistici accessibili per un’ampia gamma di usi quotidiani.

Citazione: Ghosh, N., Mandal, G. Deep transfer learning based image colorization using VGG19 and CLAHE. Sci Rep 16, 9528 (2026). https://doi.org/10.1038/s41598-026-40292-1

Parole chiave: colorizzazione di immagini, deep learning, transfer learning, restauro fotografico, miglioramento del contrasto