Clear Sky Science · it

Un quadro integrato per la mitigazione proattiva dei deepfake tramite watermarking guidato dall’attenzione e verifica dell’autenticità basata su blockchain

Perché i video falsi sono un problema di tutti

Video che appaiono e suonano reali possono ora essere falsificati con software pronti all’uso, sfumando la linea tra verità e finzione online. Questi cosiddetti deepfake sono già impiegati per truffe, molestie e trucchi politici. Invece di cercare di individuare i falsi dopo che si sono diffusi, questo studio pone una domanda diversa: e se potessimo proteggere silenziosamente i video autentici nel momento in cui vengono creati, in modo che qualsiasi manomissione successiva diventi evidente?

Dal rincorrere i falsi al proteggere gli originali

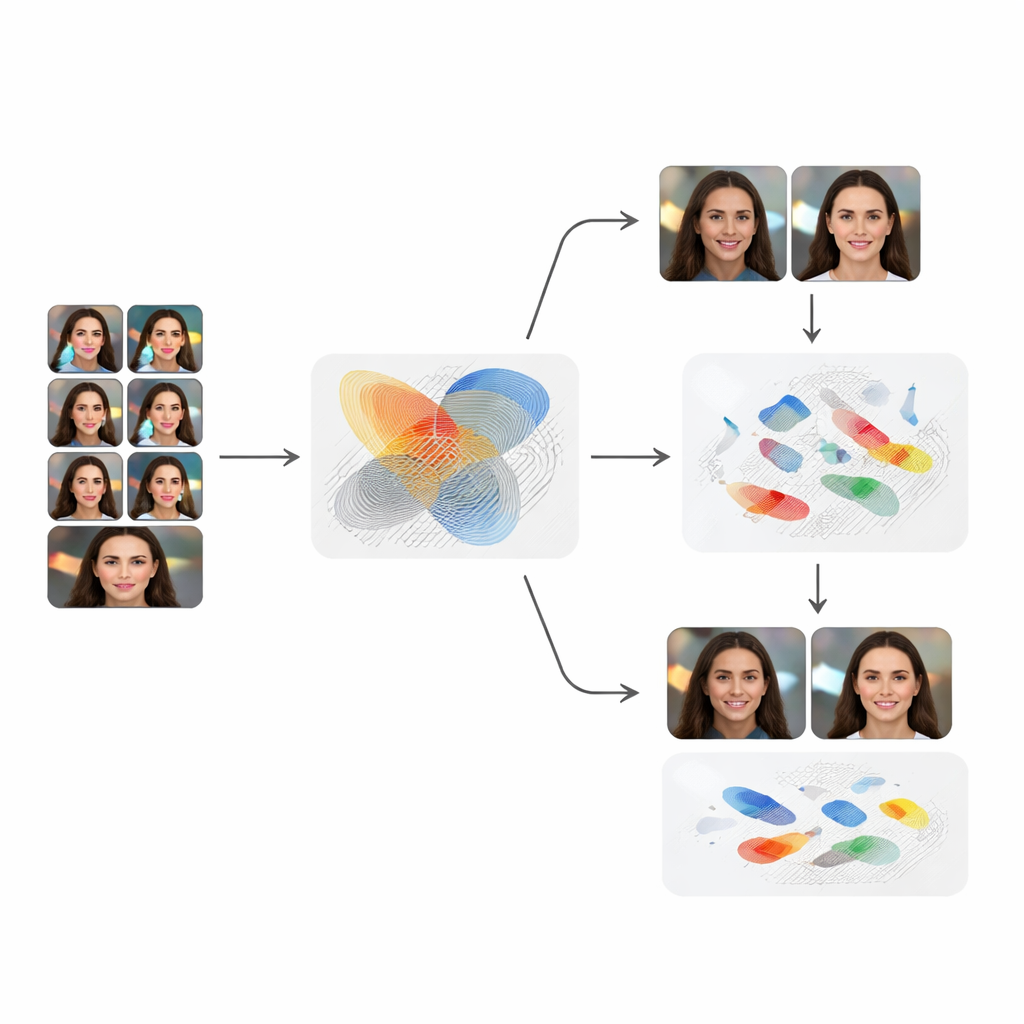

La maggior parte delle ricerche attuali cerca di individuare i deepfake a posteriori, addestrando algoritmi a riconoscere minuscole imperfezioni lasciate dai modelli generativi. Ma man mano che quei modelli migliorano, questo gioco del gatto e del topo diventa più difficile da vincere. Gli autori propongono un approccio proattivo: proteggere le riprese autentiche mentre vengono registrate, così che spettatori e piattaforme possano in seguito verificare se ciò che vedono è l’originale non modificato. Il loro framework combina tre livelli: un analizzatore video intelligente che decide dove la protezione è più importante, un marchio digitale invisibile inserito in ogni fotogramma e un registro blockchain che fissa l’identità del file nel suo insieme.

Insegnare al sistema cosa conta davvero in un video

Il primo livello è un modello di attenzione che impara quali parti di un video contengono i movimenti e i dettagli più significativi nel tempo. Il team addestra una rete compatta ma potente su migliaia di clip quotidiane che mostrano persone mentre compiono azioni. Una parte della rete esamina ogni fotogramma come una fotografia statica, mentre un’altra osserva come gli elementi si muovono attraverso frammenti di 16 fotogrammi. Insieme raggiungono oltre il 97% di accuratezza in un test standard di riconoscimento delle azioni, dimostrando che il sistema ha appreso schemi ricchi di come esseri umani e scene cambiano nel tempo. Questi schemi vengono poi trasformati in mappe di attenzione che evidenziano le regioni in cui qualsiasi manomissione influirebbe maggiormente sulla storia raccontata dal video.

Nascere un marchio segreto dove i falsari faranno più danno

Successivamente, un marchio digitale invisibile—un watermark—viene incorporato in ogni fotogramma, ma non in modo semplice e uniforme. Una rete generativa crea un motivo sottile, simile a rumore, che viene miscelato con maggiore intensità nelle regioni che il modello di attenzione segnala come importanti, come volti o mani in movimento, e più debolmente altrove per preservare la qualità visiva. Gli spettatori non notano differenze e i punteggi di qualità confermano che i fotogrammi marcati sono quasi indistinguibili dagli originali. Eppure il motivo è sufficientemente forte e complesso perché una rete complementare, addestrata come una specie di decodificatore, possa in seguito recuperare la firma nascosta dal materiale genuino, fotogramma per fotogramma.

Mettere alla prova i deepfake e le distorsioni di tutti i giorni

Per verificare se questa protezione regge nel mondo reale, gli autori eseguono una serie di test di stress. Per prima cosa marcano con watermark un set diversificato di brevi video stock e poi li inseriscono in DeepFaceLab, uno degli strumenti di face‑swap più usati, per creare deepfake convincenti. In ognuno dei 50 clip manipolati, il marchio nascosto viene o distrutto o fortemente alterato, e il sistema segnala correttamente il video come manomesso. Il metodo resiste anche ai comuni processi di elaborazione come compressione pesante, ridimensionamento e sfocatura che spesso si verificano quando i clip vengono condivisi online, sebbene rumore casuale molto intenso possa alla fine sovrascrivere il segnale nascosto. Esperimenti accurati mostrano che sia la guida tramite attenzione sia l’uso del movimento nel tempo sono cruciali; rimuovere uno dei due componenti rende la protezione sensibilmente più debole.

Fissare la fiducia con un’impronta permanente

L’ultimo livello va oltre il contenuto dei fotogrammi e mette in sicurezza il file video stesso. Dopo il watermarking, il file completo viene sottoposto a una funzione crittografica che produce una breve impronta digitale. Quell’impronta, insieme a informazioni di base sul clip, viene scritta in un registro blockchain, dove non può essere alterata senza lasciare traccia. Successivamente, chiunque può caricare una copia del video: il sistema tenta di recuperare il watermark e ricalcola anche l’impronta. Se sia il marchio nascosto sia l’impronta crittografica corrispondono ai record originali, il video può essere considerato autentico con alta fiducia; se uno dei due fallisce, gli osservatori sanno che il filmato è stato modificato.

Cosa significa questo per i video che vedi

In termini chiari, questo lavoro dimostra che possiamo passare dal supporre che un video sia falso al provare che un video è reale. Intrecciando discretamente un marchio intelligente e difficile da contraffare nelle parti più significative di ogni fotogramma e sostenendolo con una voce di registro a prova di manomissione, il framework intercetta tutti gli attacchi di face‑swap testati e resiste a molte distorsioni di uso quotidiano. Pur avendo ancora difficoltà sotto rumore visivo estremo e necessitando di test più ampi, indica una direzione verso un futuro in cui telecamere, piattaforme e redazioni possono distribuire video con prove di autenticità integrate—rendendo molto più difficile per i deepfake passare per verità.

Citazione: Hajjej, F., Hamid, M. & Alluhaidan, A.S. An integrated framework for proactive deepfake mitigation via attention-driven watermarking and blockchain-based authenticity verification. Sci Rep 16, 9545 (2026). https://doi.org/10.1038/s41598-026-40166-6

Parole chiave: protezione dai deepfake, autenticità video, watermarking digitale, verifica blockchain, sicurezza dei media