Clear Sky Science · it

Strategie di ensemble machine learning per la mappatura della prospettività mineraria in condizioni di scarsità di dati

Trovare il minerale con meno indizi

La società moderna dipende da metalli come piombo e zinco per batterie, elettronica e infrastrutture, eppure i giacimenti più facili da trovare sono già stati individuati. In nuove aree, i geologi spesso dispongono di poche scoperte minerarie confermate, di campioni chimici sparsi e di mappe incomplete. Questo studio mostra come usare il machine learning non per inseguire il punteggio più alto sui dati passati, ma per fornire previsioni di cui i decisori possano effettivamente fidarsi quando le informazioni sono scarse.

Perché i dati sono esigui nel mondo reale

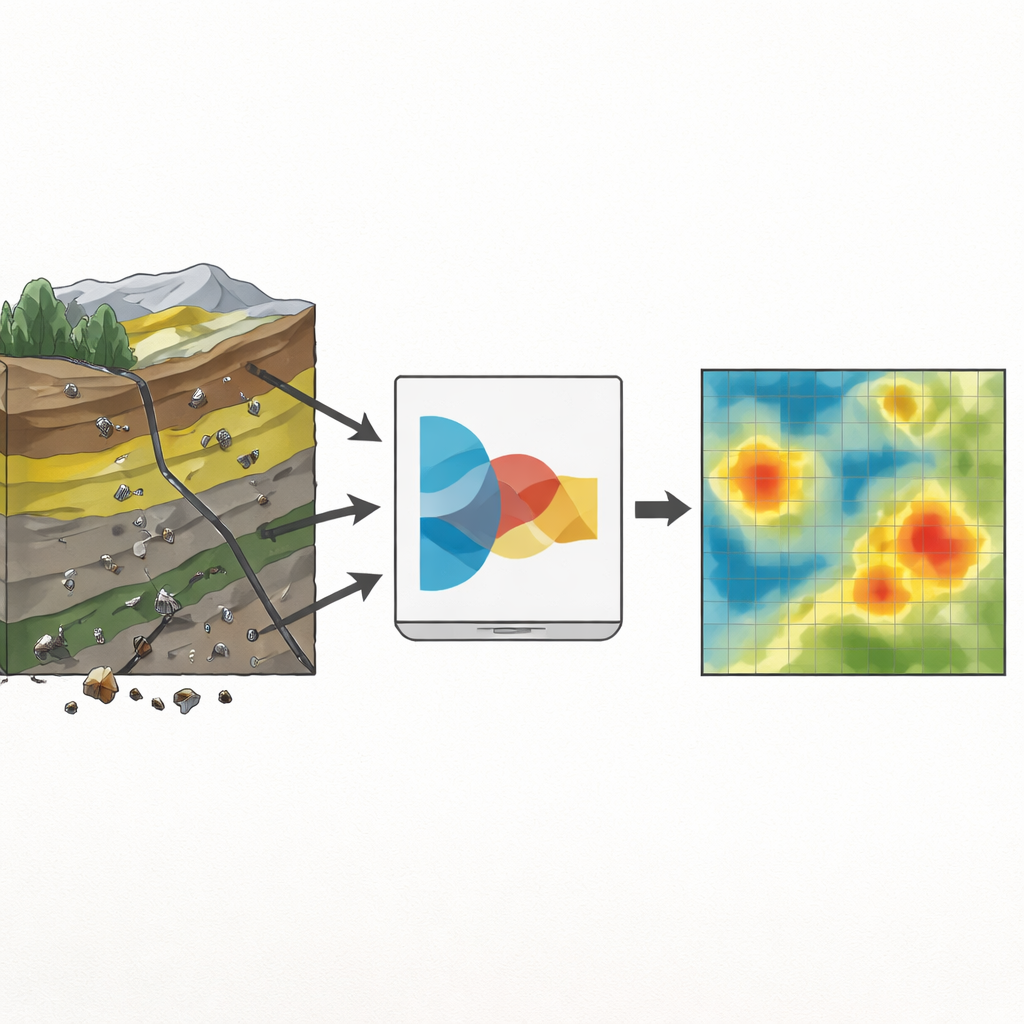

La mappatura della prospettività mineraria mira a evidenziare le parti di un territorio che hanno maggiori probabilità di contenere minerali. Combina strati informativi, come tipi di rocce, faglie, immagini satellitari e chimica dei sedimenti fluviali, in una mappa di probabilità che guida il lavoro di campo e le perforazioni. Nei progetti in fase iniziale, tuttavia, sono noti solo pochi giacimenti e molte aree non sono mai state campionate. Gli strumenti standard di machine learning prosperano con dataset grandi e ben etichettati; quando si trovano di fronte a poche decine di esempi positivi, possono diventare instabili e troppo sicuri, producendo numeri che sembrano precisi ma sono poco legati alla realtà.

Trasformare indizi scarsi in segnali utilizzabili

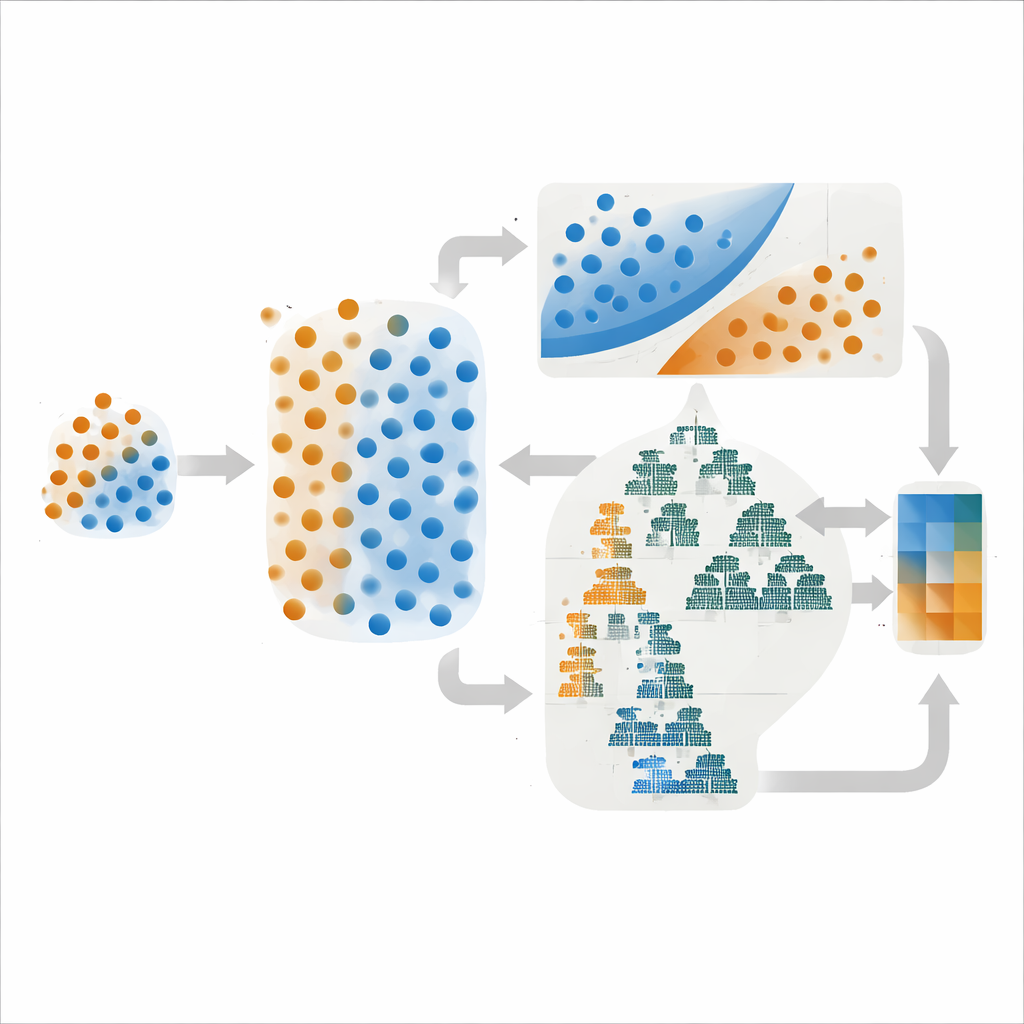

Gli autori hanno lavorato nel distretto piombo‑zinco di Dehaq, nell'Iran centrale, una regione in cui la mineralizzazione è legata a specifici strati calcarei, faglie e zone di alterazione chimica. Hanno costruito mappe digitali delle rocce ospiti, della densità delle fratture e dell'alterazione da rilevamenti geologici e immagini satellitari, ed estratto anomalie geochimiche da 624 campioni di sedimenti. Da queste prove ricche ma diseguali hanno ricavato solo 108 localizzazioni etichettate: 27 con giacimenti noti e 81 senza. Per evitare che la classe maggioritaria sovrastasse i pochi esempi di minerale, hanno usato una tecnica che crea punti di giacimento sintetici realistici interpolando tra quelli esistenti, riequilibrando le classi solo all'interno dei dati di addestramento. Ciò ha fornito un insieme di esempi più bilanciato mantenendo separate le set di validazione e di test che rispecchiano la rarità reale.

Costruire team di modelli invece di un singolo eroe

Piuttosto che affidarsi a un singolo algoritmo, lo studio ha accoppiato metodi con punti di forza diversi. Un ensemble ha combinato una support vector machine, che traccia il confine più netto possibile tra le classi, con un modello probabilistico semplice chiamato Gaussian Naive Bayes. L'altro ha miscelato due metodi basati su alberi, LightGBM e AdaBoost, eccellenti nel catturare pattern complessi in molte variabili. In entrambi i casi, la previsione finale era la media delle stime di probabilità dei modelli componenti, una strategia che spesso riduce le oscillazioni di prestazione. In modo cruciale, gli autori hanno confrontato non solo quanto spesso questi modelli fossero corretti, ma anche quanto le loro probabilità previste corrispondessero alla realtà—una proprietà nota come calibrazione.

Ottimizzare per la fiducia, non solo per il punteggio

Scegliere i parametri di un modello—quanto penalizza gli errori, quante alberature costruisce e così via—può cambiare drasticamente il suo comportamento. Il team ha testato tre strategie comuni di ottimizzazione: Grid Search, che scandaglia sistematicamente un menu fisso di opzioni; Random Search, che campiona combinazioni a caso; e Bayesian Optimization, che usa prove precedenti per stimare nuove configurazioni promettenti. Sulla carta, la Bayesian Optimization ha fornito il singolo miglior punteggio di discriminazione (un ROC–AUC di 0,95) per l'ensemble basato su support vector. Tuttavia, quando gli autori hanno esaminato le curve di calibrazione, che confrontano le probabilità previste con gli esiti reali, le versioni ottenute con Grid Search di entrambi gli ensemble hanno prodotto risultati più morbidi e stabili, specialmente nell'intervallo di probabilità intermedio dove di solito si fissano le soglie per l'esplorazione.

Dai numeri alle decisioni sul campo

Per l'esplorazione iniziale, dove ogni foro di sondaggio è costoso, gli autori sostengono che probabilità ben comportate siano più importanti che spremere un piccolo guadagno in accuratezza. La loro raccomandazione più pratica è l'ensemble più semplice a base di support vector più Bayes, sintonizzato tramite Grid Search. Esso ottiene una forte discriminazione offrendo al contempo il collegamento più affidabile tra i valori di probabilità e i tassi reali di scoperta, permettendo ai geologi di impostare soglie che corrispondano alla loro tolleranza al rischio. Man mano che i progetti maturano e si accumulano più dati, modelli più complessi basati su alberi come l'ensemble LightGBM possono essere introdotti per affinare le previsioni, ma sempre con attenzione alla calibrazione. In questo modo, il machine learning diventa non un generatore di punteggi in una scatola nera, ma un partner trasparente per prendere decisioni consapevoli sul rischio su dove cercare la prossima generazione di risorse minerarie.

Citazione: Amirajlo, P., Hassani, H., Pour, A.B. et al. Ensemble machine learning strategies for mineral prospectivity mapping under data scarcity. Sci Rep 16, 9171 (2026). https://doi.org/10.1038/s41598-026-40125-1

Parole chiave: mappatura della prospettività mineraria, ensemble machine learning, scarsità di dati, calibrazione del modello, esplorazione mineraria