Clear Sky Science · it

Calibrare i classificatori profondi con propagazione dinamica della fiducia e normalizzazione adattiva

Perché è importante fidarsi delle stime di fiducia dell’IA

I moderni sistemi di intelligenza artificiale non si limitano a dire cosa pensano sia presente in una foto o in una lettura di sensore: forniscono anche quanto ne siano sicuri. Questa fiducia auto‑segnalata è cruciale in contesti di sicurezza, come l’imaging medico, la guida autonoma o il monitoraggio industriale, dove una sensazione di certezza mal riposta può essere pericolosa. Eppure le reti neurali profonde odierne sono famose per essere troppo sicure nei loro errori, e le correzioni esistenti spesso falliscono quando i dati sono sbilanciati o provengono da ambienti in evoluzione. Questo articolo presenta un nuovo metodo, chiamato Propagazione Dinamica della Fiducia con Normalizzazione Alternata (DCP‑AN), progettato per rendere i punteggi di confidenza dei sistemi IA più onesti, stabili ed efficienti in condizioni realistiche e variabili.

Quando le macchine intelligenti sono troppo sicure di sé

I modelli di deep learning più diffusi vengono addestrati per predire l’etichetta corretta, non per giudicare quanto affidabile sia ogni previsione. Di conseguenza, una rete può essere al 99% “sicura” che un’immagine mostri un gatto quando in realtà è un cane. Le tecniche standard di calibrazione, come il temperature scaling o la suddivisione delle predizioni in intervalli di confidenza, provano a correggere questo problema dopo l’addestramento applicando aggiustamenti globali. Tuttavia, questi metodi trattano tutte le categorie e tutti gli esempi allo stesso modo. Nel mondo reale i dati raramente sono bilanciati: poche classi “head” comuni hanno molti esempi, mentre classi rare in coda potrebbero comparire solo poche volte. Le reti tendono a essere troppo sicure sulle classi comuni e troppo insicure su quelle rare, una discrepanza che correzioni statiche e uguali per tutti non riescono a colmare—soprattutto quando la distribuzione dei dati cambia tra domini, ad esempio da schizzi artistici a foto del mondo reale.

Un nuovo modo di condividere informazioni tra dati e etichette

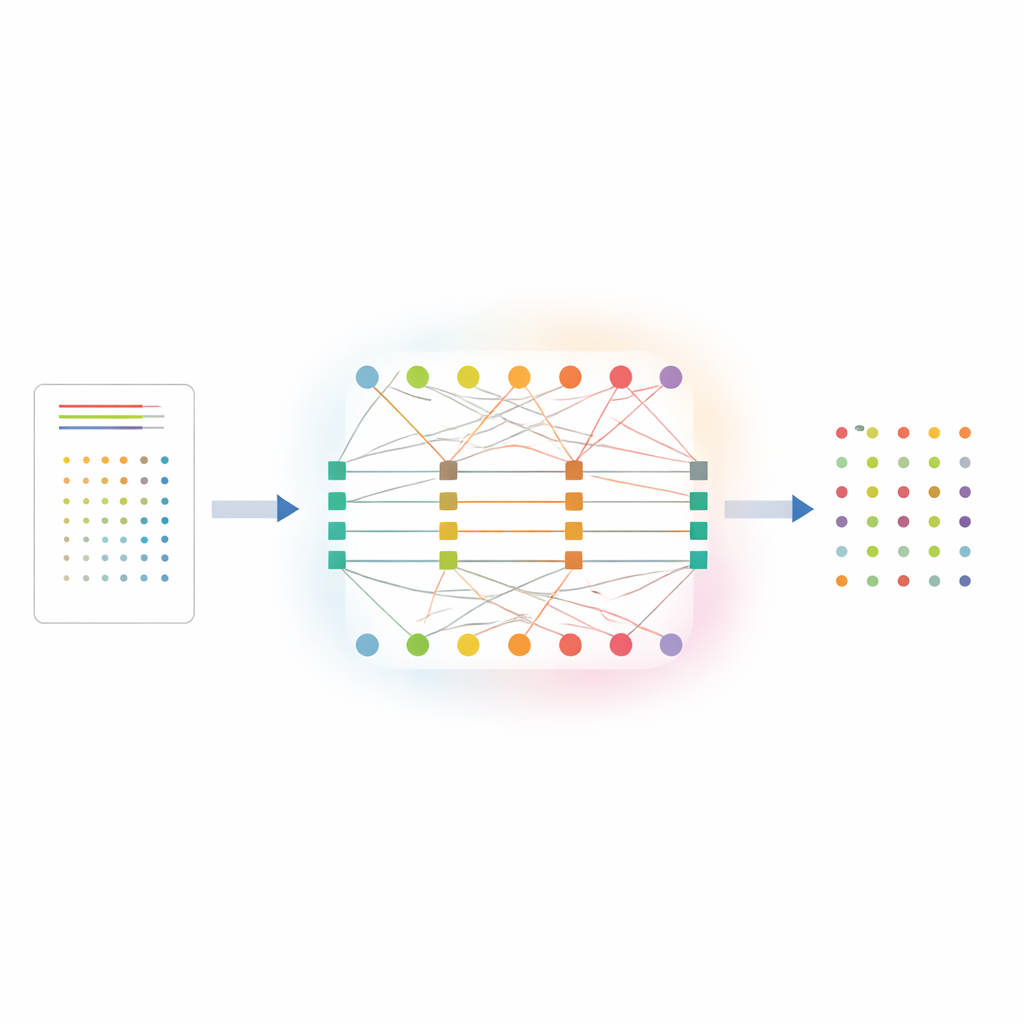

DCP‑AN affronta questo problema modellando esplicitamente come la fiducia dovrebbe fluire tra i singoli campioni e le classi a cui appartengono. Il metodo rappresenta la relazione tra campioni e classi come una rete a due livelli: un livello di nodi per i campioni e un altro per le classi, collegati da connessioni pesate che codificano le forze di previsione iniziali. La fiducia viene quindi raffinata attraverso una danza in due fasi. Nella prima fase, l’informazione fluisce dai campioni alle classi, aggiustando quanto siano diffuse le previsioni di ciascuna classe, guidata da quanto quella classe appare attualmente incerta. Nella seconda fase, l’informazione ritorna dalle classi ai campioni, spingendo il profilo di confidenza di ciascun campione in base a quanto sia coerente con le stime precedenti. Ripetendo questo processo avanti e indietro per un numero limitato di volte, il sistema favorisce una migliore “collaborazione” tra esempi ed etichette, così che le classi rare ricevano segnali più chiari invece di essere annullate da quelle comuni.

Aumentare la temperatura dove serve

Un’innovazione chiave di DCP‑AN è un “campo di temperatura” adattivo che modifica quanto intensamente il metodo rimodella la fiducia, a seconda di quanto incerte appaiono localmente e globalmente le cose. Invece di usare un singolo valore di temperatura per tutte le predizioni, il metodo calcola separate intensità di aggiustamento per le classi e per i campioni, basate su misure di incertezza e disallineamento nel tempo. Per le classi head che la rete già gestisce con sicurezza, la temperatura effettiva si abbassa delicatamente, evitando un eccesso di livellamento e preservando distinzioni nette. Per le classi tail e i campioni ambigui, la temperatura aumenta, permettendo correzioni più forti che elevano la loro confidenza quando giustificate e smorzano picchi spurii. Questo comportamento dinamico emerge da una regola di aggiornamento fondata e si dimostra reattivo quando l’incertezza cresce, rimanendo stabile quando il modello è già ben allineato.

Miglioramenti affidabili su compiti e hardware diversi

Gli autori valutano con cura DCP‑AN su diversi dataset di immagini ampiamente usati. Su una versione a coda lunga di ImageNet, dove alcune categorie hanno centinaia di volte più immagini di altre, il metodo aumenta l’accuratezza sulle classi rare di coda di circa 10 punti percentuali assoluti e riduce di più della metà una misura standard di errore di calibrazione rispetto a una baseline non corretta. In un test cross‑dominio che trasferisce un modello addestrato su opere d’arte a foto del mondo reale, DCP‑AN aumenta sia l’accuratezza nel nuovo dominio sia una misura statistica del divario tra dati di origine e di destinazione. Importante, questi guadagni non comportano un costo computazionale elevato: eseguendo su una moderna scheda grafica, il metodo aggiunge poco più di un millisecondo di latenza e meno di mezzo megabyte di memoria extra, mantenendolo praticabile per dispositivi in tempo reale e periferici.

Cosa significa per l’IA di tutti i giorni

In termini semplici, questo lavoro mostra che possiamo rendere i sistemi di IA non solo più intelligenti, ma anche più consapevoli di quando potrebbero sbagliare. Permettendo alle informazioni di fiducia di fluire avanti e indietro tra esempi e categorie, e adattando quanto aggressivamente si corregge in base all’incertezza che cambia, DCP‑AN produce stime di probabilità che corrispondono meglio alla realtà—even per eventi rari e in ambienti che mutano. Poiché è dotato di una garanzia matematica che i suoi aggiornamenti iterativi convergono rapidamente, e perché gira con un overhead minimo, questo framework potrebbe essere integrato nelle reti neurali esistenti in domini come la sanità, la robotica e il monitoraggio della sicurezza. Il risultato è un’IA che continua a sbagliare, ma è molto più onesta riguardo alla propria certezza—un passo cruciale verso sistemi di cui le persone possono fidarsi in sicurezza.

Citazione: He, P., Fu, W., Wang, L. et al. Calibrating deep classifiers with dynamic confidence propagation and adaptive normalization. Sci Rep 16, 10959 (2026). https://doi.org/10.1038/s41598-026-39842-4

Parole chiave: calibrazione della fiducia, reti neurali profonde, riconoscimento a coda lunga, stima dell'incertezza, adattamento del dominio