Clear Sky Science · it

ACFM: algoritmo di fusione con pesi adattivi sui canali per migliorare le prestazioni di rilevamento di oggetti piccoli nel traffico UAV

Vedere di più dal cielo

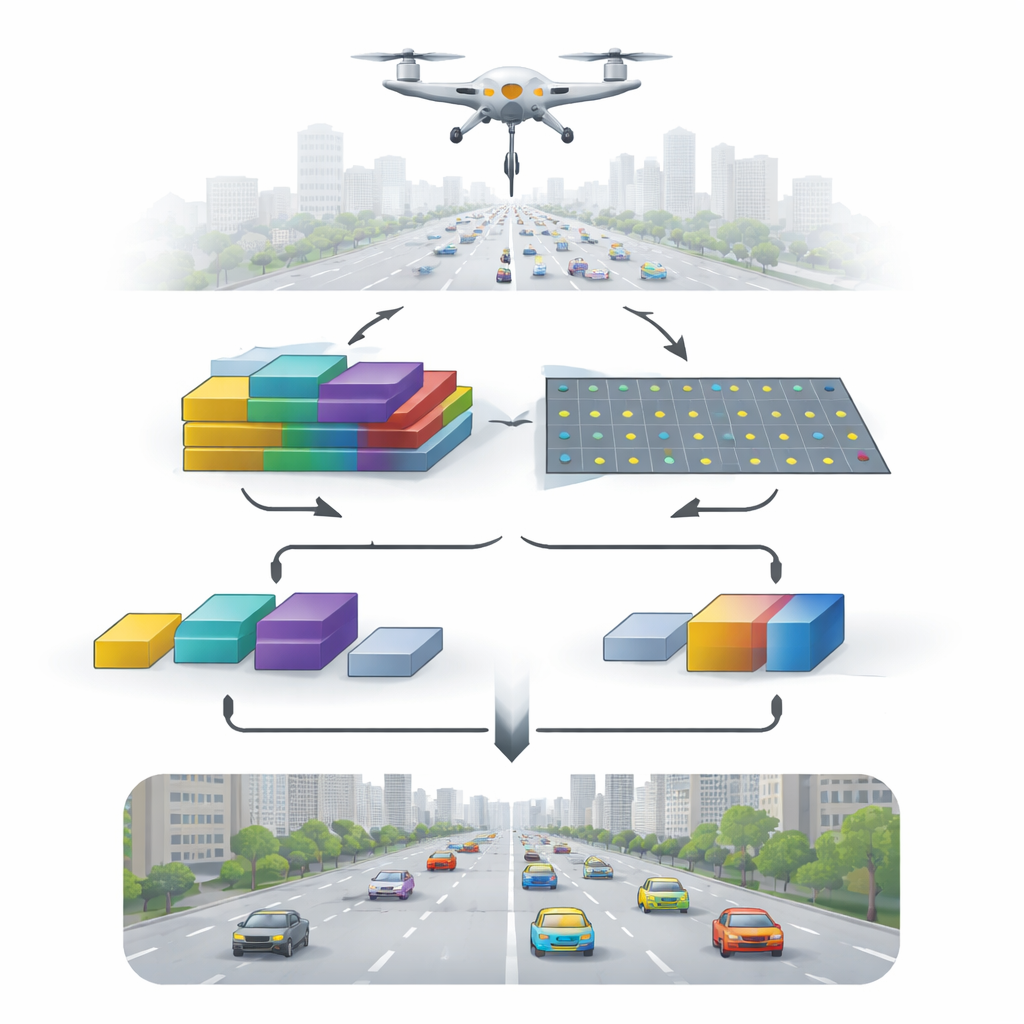

Con l’aumento dell’uso dei droni per monitorare il traffico, la sicurezza delle folle e le zone di calamità, emerge un problema semplice ma persistente: dall’alto, gli oggetti di interesse — automobili, autobus, persino persone — spesso occupano solo pochi pixel. Questi puntini sono facili da perdere per gli algoritmi, soprattutto in strade cittadine affollate di ombre, segnali e sfocature da movimento. Questo articolo presenta un nuovo approccio per aiutare i computer a “vedere” più chiaramente questi oggetti piccoli nei filmati da drone, senza rallentare eccessivamente il processo di rilevamento.

Perché i puntini contano

Le videocamere dei droni catturano scene ampie da grandi altezze, quindi una singola immagine può includere autostrade, edifici, alberi e dozzine di veicoli. La maggior parte di questi veicoli appare molto piccola e può sovrapporsi o nascondersi dietro ad altri. I rilevatori deep-learning tradizionali sono eccellenti nel trovare oggetti grandi e ben definiti, ma tendono a perdere i dettagli fini man mano che le informazioni scorrono attraverso gli strati più profondi della rete. Il risultato è che i veicoli piccoli si confondono con lo sfondo, specialmente in intersezioni affollate, con scarsa illuminazione o in riprese leggermente sfocate. I metodi multiscala esistenti aiutano in parte combinando informazioni di diversi strati della rete, ma solitamente si basano su regole fisse prefissate e faticano ad adattarsi quando la scena diventa particolarmente caotica o complessa.

Un modo più intelligente di fondere gli indizi

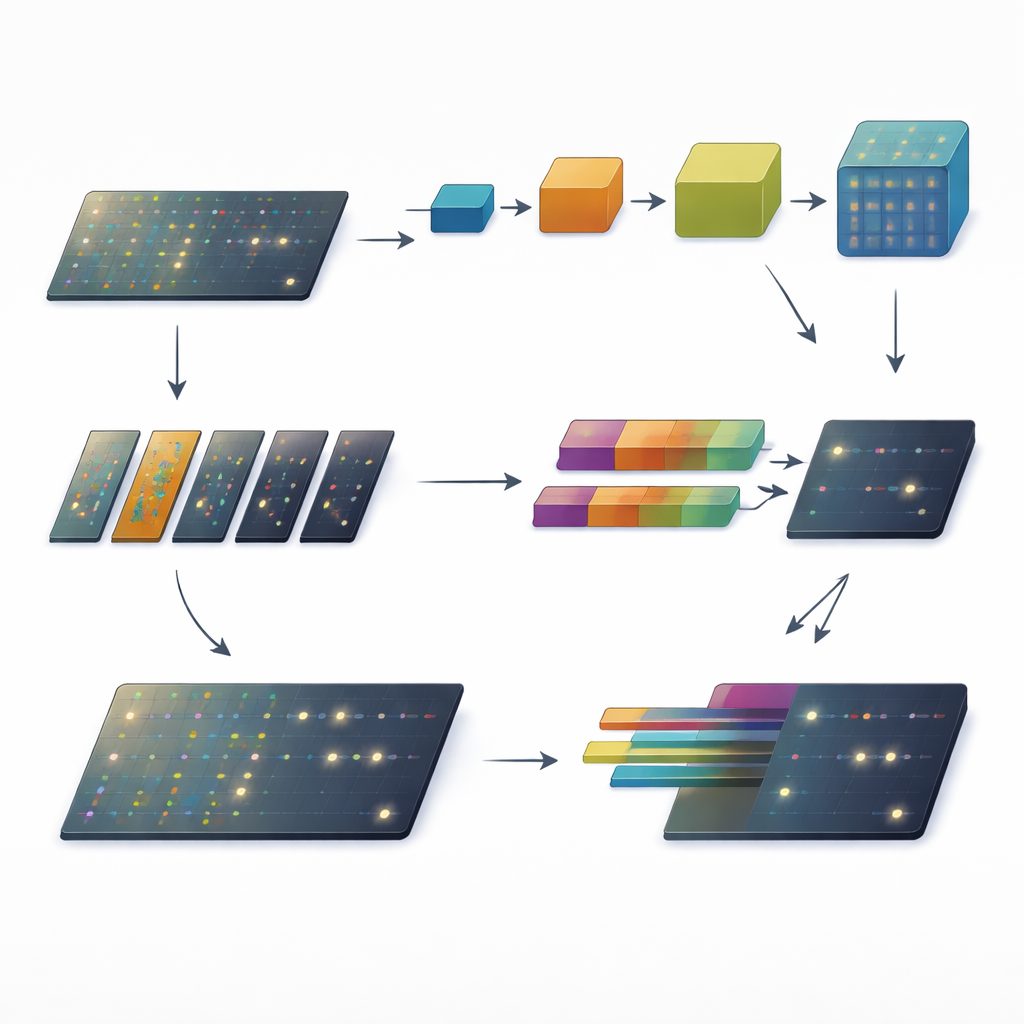

Gli autori propongono un modulo di fusione con pesi adattivi sui canali, chiamato ACFM, progettato per integrarsi nei rilevatori di oggetti esistenti e migliorarne la capacità di individuare obiettivi piccoli nelle scene di traffico riprese dai droni. Invece di trattare tutte le informazioni visive allo stesso modo, l’ACFM esegue in parallelo due rami specializzati e fonde i loro output in modo dipendente dalla scena. Un ramo affina la gestione delle feature attraverso le scale in modo che i dettagli spaziali fini non vengano annacquati. L’altro ramo funziona come un riflettore, potenziando i segnali realmente importanti degli oggetti piccoli mentre sopprime i pattern di sfondo distraenti. Fondamentale è che la fusione tra questi rami non è fissa: l’ACFM regola quanto si fida di ciascun ramo in base all’immagine corrente, permettendo al sistema di rispondere in modo differente a un’autostrada tranquilla rispetto a un’incrocio denso.

Mantenere i dettagli attraverso le scale

Nel primo ramo, chiamato blocco di raffinamento multiscala, la rete inoltra le feature attraverso una coppia di percorsi. Un percorso preserva semplicemente l’informazione originale, garantendo che i dettagli fini ad alta risoluzione sopravvivano. L’altro percorso comprime e poi espande la rappresentazione dell’immagine, aiutando il modello a comprendere il contesto più ampio di dove si trovano i veicoli piccoli nella scena. Alla fine, questi percorsi vengono uniti in modo che ogni pixel di output benefici sia di dettagli locali nitidi sia di una comprensione dell’area circostante. Ciò facilita al rilevatore il tracciamento di box di delimitazione più stretti e coerenti attorno a piccole auto e autobus di dimensioni diverse, anche quando lo sfondo è affollato o parzialmente oscurato.

Spegnere il rumore di fondo

Il secondo ramo si concentra sull’attenzione. Divide i canali delle feature in gruppi e, per ciascun gruppo, apprende una “maschera” sparsa che evidenzia solo le regioni più promettenti. Le aree che sembrano sfondo — superfici stradali, tetti degli edifici, chiome degli alberi — vengono attenuate, mentre segnali minuti ma significativi, come riflessi e bordi dei veicoli, vengono amplificati. Combinando questi dettagli affinati con le feature originali in modo controllato, questo ramo di attenzione raggruppata e sparsa produce una vista della scena più pulita e discriminativa. Ciò riduce la probabilità che il rilevatore confonda motivi sull’asfalto o ombre proiettate dagli edifici con veri veicoli.

Lasciare che sia la scena a scegliere la miscela

L’elemento finale dell’ACFM è un meccanismo di ponderazione adattiva a livello di canale che decide, canale per canale, quanto affidarsi a ciascun ramo. Riassume prima quello che succede nell’intera immagine, poi usa un’operazione leggera per inferire un set di pesi compresi tra zero e uno. Se la scena è semplice e gli oggetti sono ben separati, la rete può appoggiarsi maggiormente al raffinamento multiscala. Se la scena è densa, caotica o rumorosa, può spostare più enfasi sul ramo di attenzione che sopprime le distrazioni di sfondo. Questo bilanciamento dinamico sostituisce regole di fusione rigide e artigianali con una strategia automatica e guidata dai dati, consentendo al rilevatore di rispondere in modo flessibile quando le condizioni cambiano da un fotogramma all’altro.

Occhi più acuti per il traffico da drone

Integrato in un popolare rilevatore chiamato GFL e testato su tre dataset pubblici di traffico ripreso da droni, l’ACFM ha costantemente migliorato i punteggi di rilevamento, specialmente su set difficili con molti veicoli piccoli e sovrapposti. I guadagni in accuratezza sono arrivati con poco costo computazionale aggiuntivo, il che significa che il sistema migliorato può comunque operare vicino al tempo reale — requisito cruciale per la sorveglianza del traffico pratica. Per i non specialisti, il messaggio è semplice: preservando i dettagli, sopprimendo il rumore e adattando il modo in cui le feature vengono combinate in base alla scena, l’ACFM aiuta i droni a comportarsi più come osservatori umani attenti e meno come semplici corrispondenti di pattern, offrendo una base più affidabile per future applicazioni di smart city e monitoraggio aereo.

Citazione: Liu, S., Zhu, H., Yuan, Z. et al. ACFM: adaptive channel weighted fusion algorithm for improving small object detection performance in UAV traffic. Sci Rep 16, 8366 (2026). https://doi.org/10.1038/s41598-026-39789-6

Parole chiave: monitoraggio del traffico con droni, rilevamento di oggetti piccoli, visione artificiale, meccanismi di attenzione, fusione di feature multiscala