Clear Sky Science · it

Un quadro flessibile per l’ottimizzazione degli iperparametri usando omotopia e modelli surrogati

Perché è importante regolare i parametri dell’IA

I moderni sistemi di intelligenza artificiale dipendono non solo da algoritmi brillanti e da mari di dati, ma anche da uno strato sorprendentemente pignolo di impostazioni chiamate “iperparametri”. Sono le manopole che decidono quanto deve essere grande un modello, quanto velocemente apprende e come gestisce dati rumorosi. Sbagliarli può trasformare un sistema promettente in un fallimento. Questo articolo presenta HomOpt, un nuovo modo per regolare quelle manopole in modo più efficiente e affidabile, soprattutto quando lo spazio di ricerca è enorme e disordinato, rendendolo interessante per chiunque voglia far funzionare l’IA meglio con meno tentativi ed errori.

Un nuovo modo per guidare la ricerca

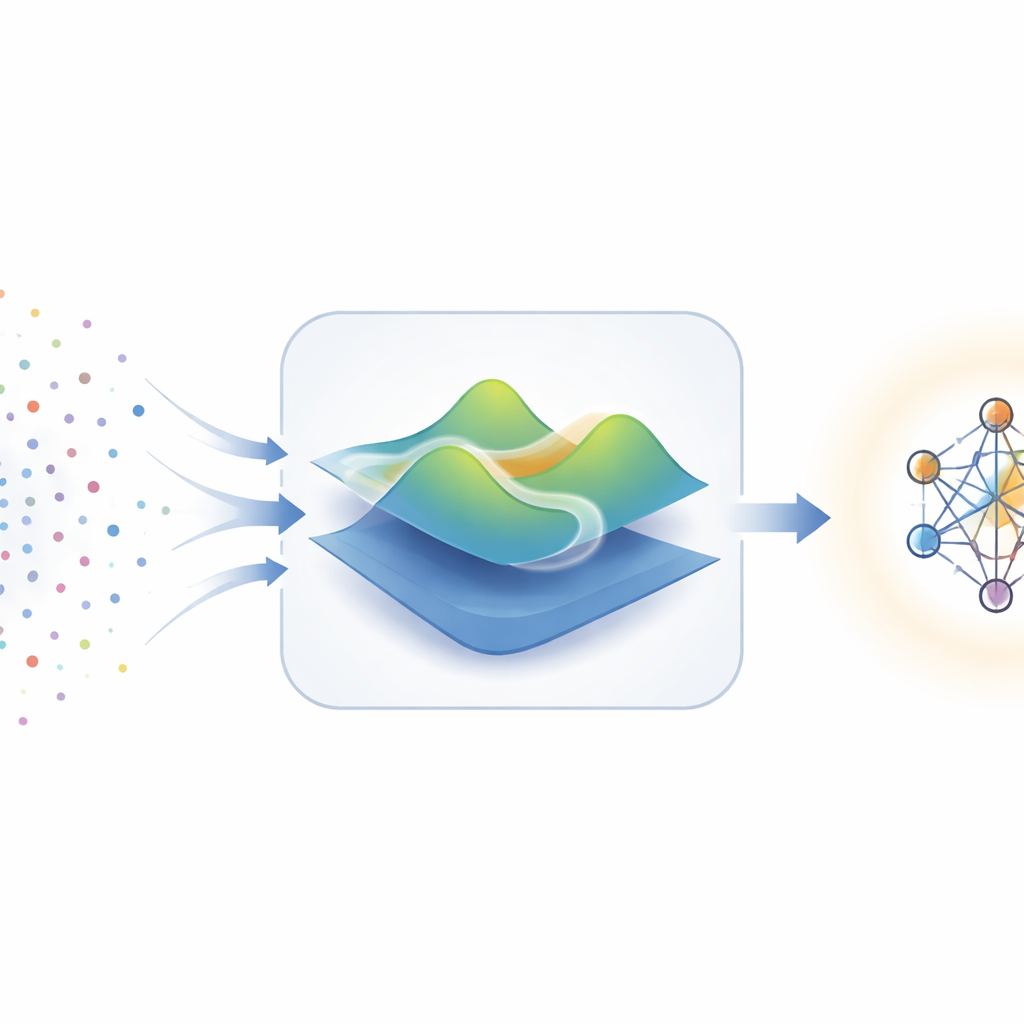

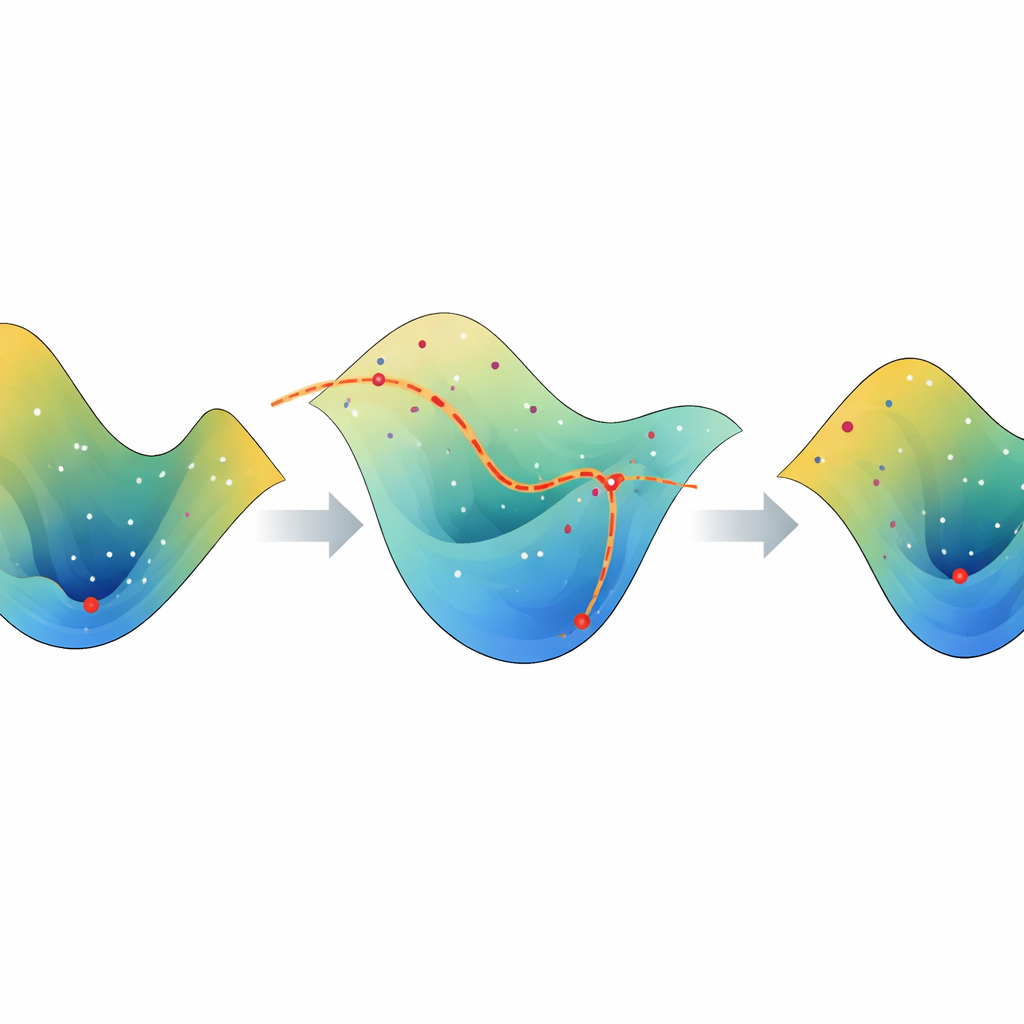

Gli approcci tradizionali all’ottimizzazione degli iperparametri, come la ricerca a griglia o la ricerca casuale, sono un po’ come provare ricette gettando insieme gli ingredienti sperando che il risultato sia buono. Metodi più raffinati, come l’ottimizzazione bayesiana, cercano di essere più intelligenti costruendo un modello approssimativo di come le impostazioni influenzano le prestazioni, e poi usando quel modello per scegliere la combinazione successiva da provare. Ma questi metodi assumono che il “paesaggio” delle prestazioni sia liscio e ben comportato, cosa che spesso non è vera nei problemi reali pieni di stranezze, rumore e salti improvvisi. HomOpt affronta questa sfida costruendo ripetutamente sostituti approssimativi del vero paesaggio—detti modelli surrogati—e trasformando dolcemente un surrogato nell’altro man mano che arrivano più dati, tracciando nel contempo come la soluzione migliore si muove durante quella trasformazione.

Modellare la transizione invece di ricominciare da capo

L’idea chiave dietro HomOpt deriva da un concetto matematico chiamato omotopia che, in termini semplici, riguarda il trasformare gradualmente una forma in un’altra senza strappi o salti. In questo quadro, ogni modello surrogato è una rappresentazione levigata di come diverse impostazioni di iperparametri influenzano le prestazioni di un modello. Man mano che si raccolgono nuovi risultati sperimentali, HomOpt costruisce un surrogato aggiornato e poi definisce una trasformazione continua tra la versione vecchia e quella nuova. Invece di scartare il lavoro passato e riavviare la ricerca, segue come il punto migliore sulla vecchia superficie scivola attraverso questo paesaggio che si trasforma per arrivare a un buon punto sulla nuova. Questo moto guidato rende la ricerca più diretta e meno casuale, aumentando le probabilità di trovare impostazioni migliori in meno passaggi.

Strumenti flessibili per diversi tipi di dati

Per dimostrare che l’idea funziona in pratica, gli autori inseriscono due tipi molto diversi di modelli surrogati in HomOpt. Innanzitutto, utilizzano modelli additivi generalizzati, che sono lisci e abbastanza facili da interpretare, rendendoli utili quando le relazioni tra impostazioni e prestazioni cambiano in modo graduale. In secondo luogo, adottano CatBoost, un potente metodo ensemble adatto a problemi complessi e ad alta dimensionalità come il riconoscimento delle immagini. HomOpt non si vincola a un singolo surrogato; al contrario tratta la scelta del surrogato come un componente plug-in che può adattarsi alla difficoltà e alla struttura del compito. Il framework può gestire impostazioni continue, discrete e categoriali, e può operare sopra strategie di ricerca comuni come la ricerca casuale, l’ottimizzazione bayesiana o metodi basati su alberi, fungendo da livello di raffinamento piuttosto che da sostituto.

Mettere il metodo alla prova

I ricercatori valutano HomOpt su un insieme variegato di benchmark. Su classici compiti di machine learning tratti da dataset tabellari pubblici, ottimizzano modelli come macchine a vettori di supporto, foreste casuali, regressione logistica, percettroni multistrato e alberi potenziati (gradient-boosted). Esaminano inoltre problemi impegnativi di riconoscimento a insieme aperto, dove un sistema deve gestire categorie non viste prima, usando un classificatore specializzato chiamato Extreme Value Machine. Infine, testano HomOpt su tabelle per la ricerca dell’architettura neurale relative a noti dataset di immagini come CIFAR-10 e collezioni nello stile ImageNet, dove lo spazio di possibili progetti è particolarmente ampio e accidentato. In molti di questi scenari, HomOpt accelera la discesa verso buone soluzioni o migliora la prestazione finale rispetto ai metodi sottostanti da soli, spesso usando meno valutazioni di modelli costose.

Cosa significa per la pratica quotidiana dell’IA

Per i praticanti, il messaggio principale è che HomOpt offre un modo strutturato per rendere l’ottimizzazione degli iperparametri più intelligente invece che semplicemente più esaustiva. Raffinando continuamente un quadro approssimativo del paesaggio delle prestazioni e seguendo dolcemente come il suo punto migliore si sposta man mano che quel quadro migliora, il metodo riduce ricerche inutili e sfrutta meglio ogni esecuzione di modello. Poiché funziona con un’ampia gamma di misure di perdita, tipi di modelli e strategie di ricerca, HomOpt può essere considerato un componente aggiuntivo di uso generale per strumenti di ottimizzazione esistenti. In termini semplici, promette di ottenere sistemi di IA più accurati e robusti con lo stesso budget computazionale—e di farlo in modo scalabile, dai piccoli problemi tabellari fino ai grandi e complessi compiti di visione.

Citazione: Abraham, S.J., Maduranga, K.D.G., Kinnison, J. et al. A flexible framework for hyperparameter optimization using homotopy and surrogate models. Sci Rep 16, 9412 (2026). https://doi.org/10.1038/s41598-026-39713-y

Parole chiave: ottimizzazione degli iperparametri, modelli surrogati, metodi di omotopia, apprendimento automatico automatizzato, ricerca dell’architettura neurale