Clear Sky Science · it

Un framework adattivo per il riequilibrio dei dati per la previsione del rischio del traffico in tempo reale

Perché bilanciare i dati del traffico è importante per la sicurezza

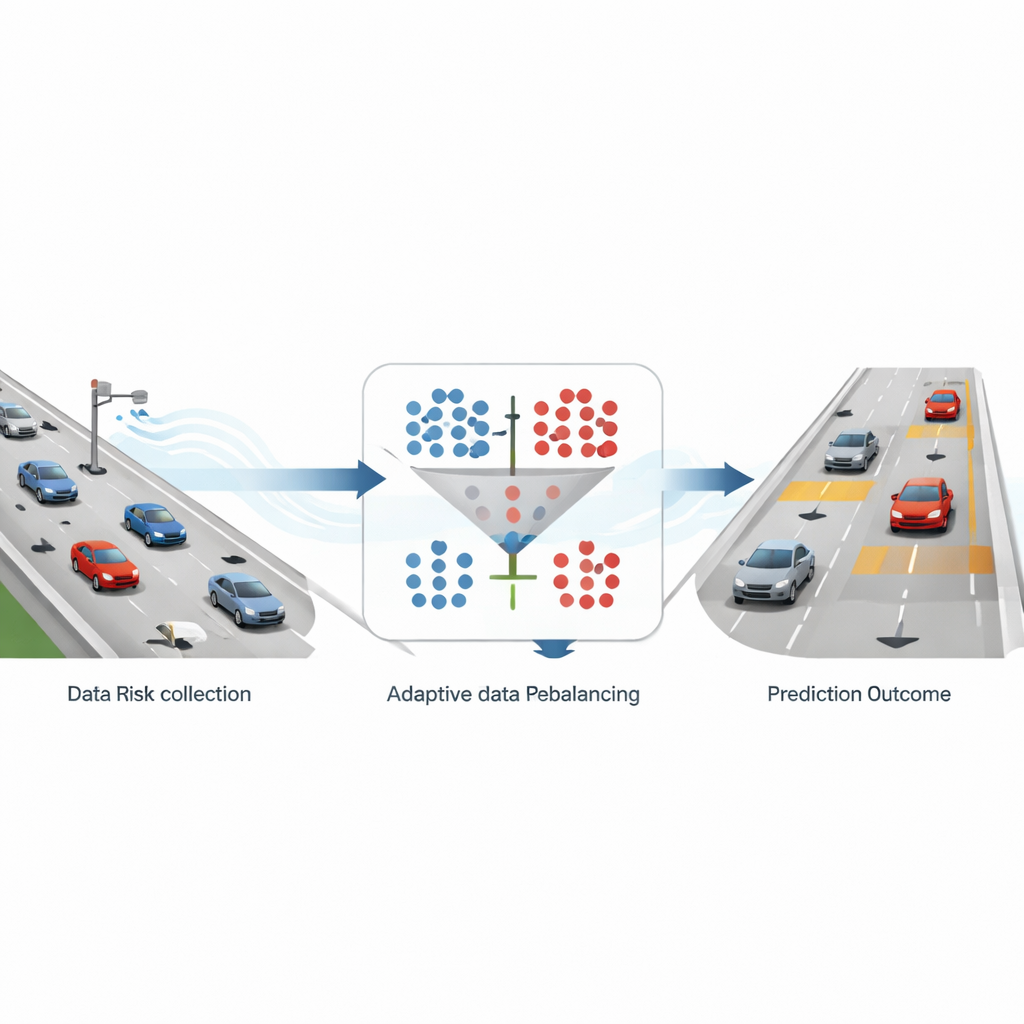

Gli incidenti autostradali sono eventi rari rispetto all’enorme quantità di guida ordinaria e senza eventi. Questo è positivo per la sicurezza, ma crea un problema nascosto per i sistemi informatici che cercano di prevedere in tempo reale quando e dove possano verificarsi incidenti. Quando i dati sono dominati da situazioni sicure, gli algoritmi possono diventare molto bravi a predire «non succederà nulla» e apparire comunque accurati nei numeri, pur mancando silenziosamente i momenti realmente pericolosi. Questo studio affronta direttamente tale sbilanciamento, proponendo un metodo adattivo per «riequilibrare» i dati del traffico in modo che i sistemi di allerta possano riconoscere meglio condizioni di rischio rare ma importanti senza diventare troppo lenti per l’uso nel mondo reale.

Come il traffico reale viene trasformato in segnali di allerta

I ricercatori costruiscono il loro framework su dati dettagliati di traiettorie autostradali ricavati da un ampio dataset basato su droni registrato su autostrade tedesche. La posizione e la velocità di ogni veicolo sono tracciate molte volte al secondo lungo tratti autostradali a sei corsie. Da questo ricco registro di movimento, il team calcola un indicatore di sicurezza largamente usato chiamato time-to-collision, che stima quanto tempo impiegherebbe un veicolo che segue a collidere con quello davanti se entrambi mantenessero il loro comportamento. Quando questo tempo scende sotto i tre secondi, la situazione viene etichettata come «alto rischio»; altrimenti è considerata «non a rischio». Dopo aver aggregato queste misure in finestre di 10 secondi e concentrandosi sulle strade a sei corsie, si ottiene circa nove campioni sicuri per ogni campione a rischio, un dataset fortemente sbilanciato che rispecchia le condizioni reali delle autostrade.

Correggere lo sbilanciamento senza perdere ciò che conta

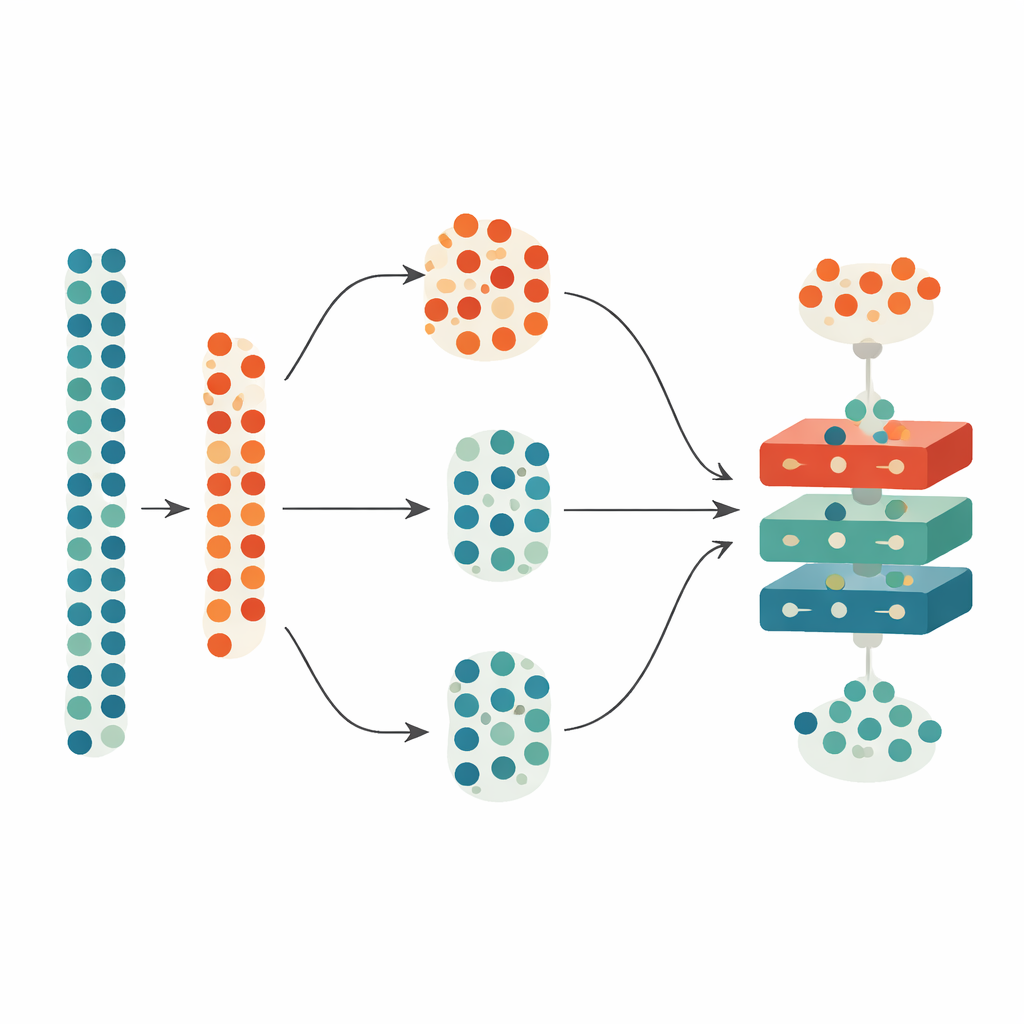

Per affrontare questo sbilanciamento, lo studio confronta due strategie comuni. La prima, chiamata oversampling, aggiunge più esempi delle rare situazioni a rischio creando campioni sintetici simili ai casi reali ad alto rischio. L’altra, undersampling, riduce il gran numero di casi sicuri scartandone alcuni in modo casuale. Gli autori utilizzano un metodo di oversampling molto diffuso (SMOTE) e un semplice metodo di undersampling casuale, applicandoli a diversi rapporti fissi tra sicuri e a rischio — 1:1, 2:1, 3:1 e 4:1. Poi alimentano sia i dataset originali sia quelli modificati in quattro modelli di previsione: due approcci tradizionali di machine learning e due modelli di deep learning specializzati nella gestione di serie temporali. Testando tutte queste combinazioni, è possibile osservare come diversi modi di bilanciare i dati modifichino la capacità del sistema di individuare il rischio mantenendo il riconoscimento delle condizioni sicure.

Lasciare che un algoritmo cerchi il punto ottimale

Invece di assumere che numeri perfettamente uguali di campioni sicuri e a rischio siano l’ideale, i ricercatori lasciano che un algoritmo genetico — un metodo di ricerca ispirato all’evoluzione — cerchi il bilanciamento più efficace. Questo ottimizzatore regola il rapporto sicuri-a-rischio entro un intervallo realistico da 1:1 a 4:1, generando ripetutamente rapporti candidati, valutandoli e perfezionandoli per centinaia di iterazioni. Cruciale è che non consideri la sola accuratezza predittiva: tiene conto anche del tempo che il modello impiega per addestrarsi e per fare previsioni, riflettendo le esigenze in tempo reale dei centri di controllo del traffico. Per garantire che accuratezza e tempo di calcolo possano essere combinati in modo equo, tutte le misure sono normalizzate prima di essere unite in un unico punteggio di “fitness” che l’algoritmo cerca di minimizzare.

Cosa imparano i modelli sul rischio in strada

Tra i molti esperimenti emerge un pattern chiaro. Bilanciare i dati migliora la previsione del rischio rispetto al lasciare lo sbilanciamento originale, e l’oversampling con casi sintetici a rischio tende a funzionare meglio che scartare casi sicuri. Un rapporto 2:1 tra campioni sicuri e a rischio fornisce le migliori prestazioni tra le impostazioni fisse, superando la scelta diffusa 1:1. Quando all’algoritmo genetico è permesso affinare questo rapporto, esso converge su valori leggermente sbilanciati ma ottimali — circa 2,3:1 per l’oversampling e 2,7:1 per l’undersampling. Tra i modelli di previsione, un particolare tipo di rete ricorrente nota come gated recurrent unit fornisce costantemente i risultati migliori, specialmente se abbinata a oversampling e ottimizzazione. I modelli rivelano inoltre che le velocità medie dei veicoli a monte e a valle di un punto autostradale sono più informative per il rischio rispetto al semplice conteggio dei veicoli.

Verificare la stabilità e prepararsi per il mondo reale

Poiché i metodi di ottimizzazione possono talvolta restare bloccati in soluzioni fuorvianti, gli autori esaminano il comportamento della loro ricerca nel tempo. Mostrano che i punteggi di fitness diminuiscono costantemente e alla fine si appiattiscono, suggerendo che l’algoritmo converge verso rapporti stabili e di alta qualità piuttosto che oscillare. Quindi modificano i rapporti scelti su e giù di qualche percento per vedere se le prestazioni collassano. Nella pratica, l’accuratezza cala solo leggermente per piccoli cambiamenti, indicando che il sistema è robusto e non eccessivamente sintonizzato su un’unica impostazione fragile. Tuttavia, quando la porzione di dati riservata al test diventa molto ampia, i modelli diventano più sensibili, evidenziando la necessità di dati di addestramento sufficientemente ricchi.

Che cosa significa per autostrade più sicure e più intelligenti

In termini concreti, lo studio mostra che insegnare ai computer a riconoscere il pericolo sulla strada non riguarda solo modelli sofisticati; riguarda anche fornire a quei modelli una rappresentazione equa di eventi rari ma critici. Regolando con cura il numero di esempi sicuri e a rischio usati nell’addestramento — e lasciando che un algoritmo adattivo trovi il miglior compromesso tra accuratezza e velocità — il framework proposto rende la previsione del rischio autostradale in tempo reale più affidabile e più pratica. Le agenzie del traffico potrebbero integrare questo approccio in sistemi che monitorano i dati dei sensori e emettono avvisi precoci su probabili tamponamenti, aiutando a orientare avvisi ai conducenti, il dispiegamento delle pattuglie o strategie di frenata automatica. Pur essendo il lavoro dimostrato su autostrade tedesche in condizioni meteorologiche buone, l’idea sottostante del riequilibrio adattivo dei dati offre una ricetta generale per migliorare le previsioni di sicurezza ovunque gli eventi pericolosi siano rari ma troppo importanti per essere trascurati.

Citazione: Chen, S., Cui, B. & Chang, A. An adaptive data rebalancing framework for real-time traffic risk prediction. Sci Rep 16, 8882 (2026). https://doi.org/10.1038/s41598-026-39539-8

Parole chiave: safety del traffico, previsione del rischio di incidenti, dati sbilanciati, machine learning, traiettorie autostradali