Clear Sky Science · it

Un modello visione-linguaggio 3D per la diagnostica medica efficiente nei dati usando solo un codificatore 2D

Un aiuto più intelligente dalle scansioni 3D

Quando i medici esaminano scansioni TC o MRI, non guardano solo singole immagini: ricompongono mentalmente centinaia di fette per capire un problema in tre dimensioni. Insegnare ai computer a fare lo stesso potrebbe velocizzare le diagnosi, rendere i referti più coerenti e più chiari per i pazienti. Ma i sistemi di intelligenza artificiale attuali che trattano scansioni 3D sono estremamente «affamati» di dati, richiedendo vasti insiemi di dati etichettati con cura che molti ospedali semplicemente non possiedono. Questo articolo presenta un modo per ottenere una comprensione a livello 3D sfruttando la tecnologia già esistente per immagini 2D, promettendo strumenti potenti più facili ed economici da costruire e distribuire.

Perché le scansioni 3D sono difficili per l’IA

I moderni sistemi «visione–linguaggio» possono già analizzare un’immagine medica 2D e rispondere a domande o redigere un referto in linguaggio naturale. Estendere questa capacità ai volumi 3D consentirebbe all’IA di ragionare su organi interi e su lesioni sottili che diventano evidenti solo quando si visualizzano molte fette insieme. Il problema è che la maggior parte dei sistemi 3D attuali si affida a codificatori 3D speciali, addestrati da zero su collezioni enormi di scansioni etichettate. Tali dataset sono rari, costosi da annotare e spesso legati a centri con grandi risorse, il che limita chi può beneficiarne. Allo stesso tempo, trattare ogni fetta come una semplice immagine 2D separata perde la continuità naturale tra fette e sommergerebbe il modello con informazioni ripetitive.

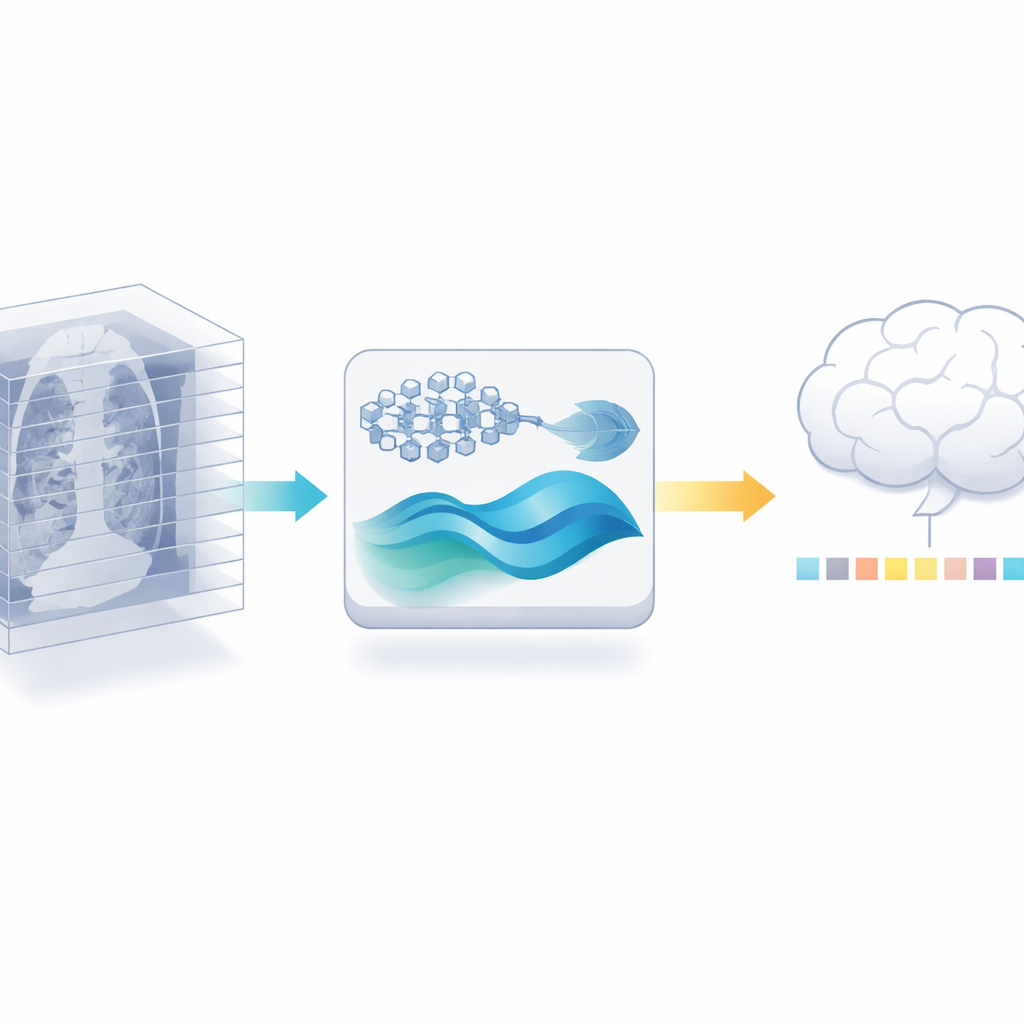

Riutilizzare un esperto 2D per il lavoro 3D

Gli autori propongono una strada diversa: invece di addestrare un nuovo codificatore 3D, riutilizzano un potente modello di immagini mediche 2D già addestrato su milioni di immagini etichettate della letteratura medica. Tagliano ogni scansione 3D nelle singole fette e lasciano che questo modello 2D estragga caratteristiche dettagliate da ogni fetta. Poi eliminano con cura le ridondanze: poiché le fette vicine in una scansione spesso si assomigliano molto, un controllo di similarità può scartare molti quasi-duplicati mantenendo le viste più informative. Questo passaggio da solo riduce la quantità di dati che le fasi successive devono gestire, senza richiedere più scansioni etichettate.

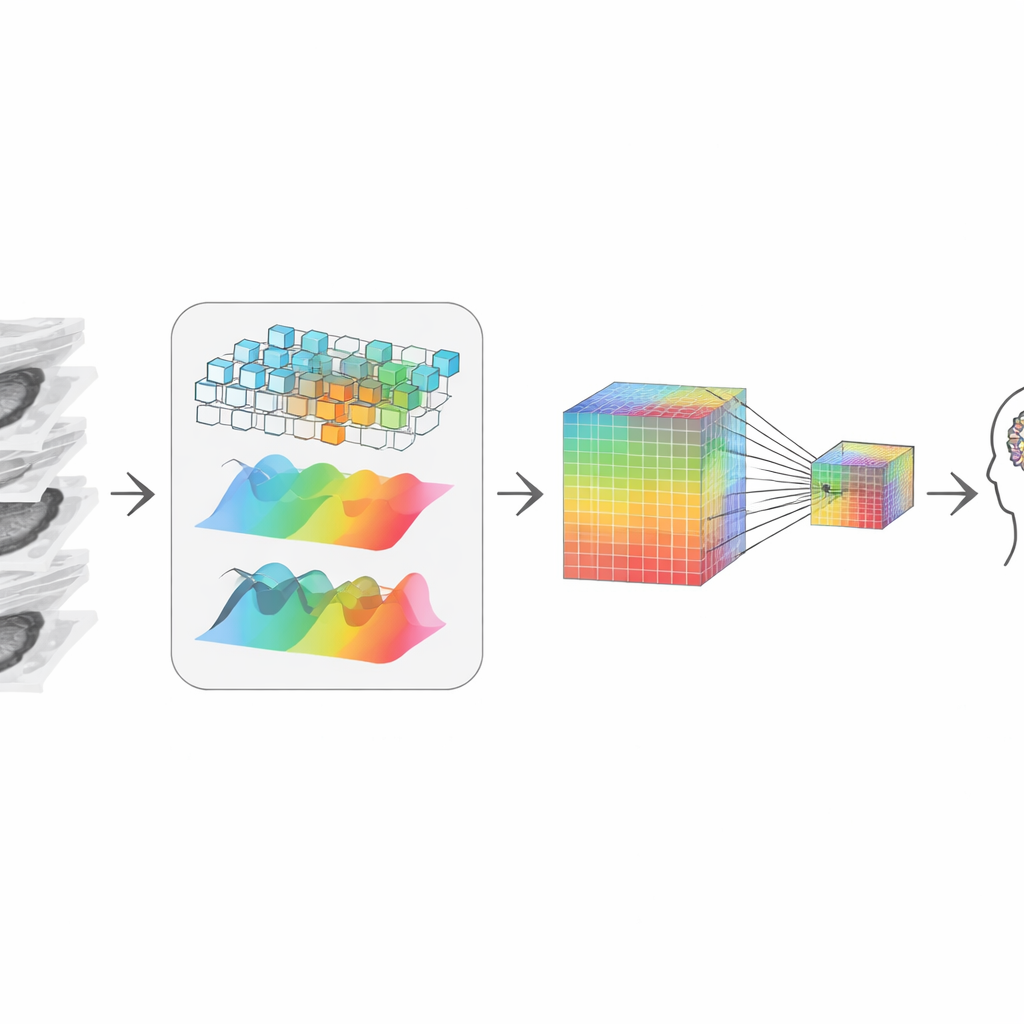

Ricostruire la storia 3D dai pezzi

Dopo il filtraggio, il sistema deve «ri-cucire» le fette rimanenti in un quadro 3D coerente. Gli autori lo fanno combinando due viste complementari dei dati. Un percorso osserva forme e bordi locali, come una lente di ingrandimento che si muove nel volume, sensibile a contorni netti e texture. L’altro percorso trasforma i dati in una rappresentazione in frequenza, più adatta a catturare schemi ampi e strutture a lungo raggio attraverso le fette—come si estende un tumore o qual è la forma complessiva di un organo. Un passaggio di fusione adattiva impara quanto fidarsi di ciascuna vista in ogni punto, producendo una rappresentazione che rispetta sia i dettagli fini sia il contesto globale, nonostante l’origine dalle fette 2D.

Mantenere gli indizi minuti durante la compressione

Per dialogare con un grande modello linguistico—la parte che risponde a domande e redige referti—l’informazione visiva deve essere compressa in un numero modesto di token, o «parole visive». Un semplice ridimensionamento cancellerebbe segnali piccoli ma critici, come piccole calcificazioni o sottili variazioni di texture rilevanti per la diagnosi. Per evitarlo, gli autori creano una rappresentazione a doppio binario: una mantiene una versione ad alta risoluzione ricca di dettagli e l’altra è una versione più piccola ed economica. Un meccanismo di attenzione permette a ogni punto della versione più piccola di «guardare indietro» selettivamente alla versione maggiore e recuperare i dettagli più nitidi. Il risultato è un sommario visivo compatto che conserva comunque gli indizi importanti per un radiologo, che viene poi passato al modello linguistico per il ragionamento.

Prova su compiti medici reali

Per testare il loro design, i ricercatori lo hanno valutato su benchmark 3D pubblici che pongono due domande principali: il sistema è in grado di scrivere descrizioni in stile radiologico di scansioni 3D in modo accurato, e può rispondere a domande su ciò che è visibile in esse? Il loro approccio, pur non avendo mai addestrato un codificatore specifico 3D, ha superato diversi forti modelli basati su 3D in entrambi i compiti. Ha prodotto referti più precisi e clinicamente ricchi e ha risposto alle domande con maggiore accuratezza, comprese quelle difficili sull’organo esatto, l’anomalia o la posizione coinvolta. Ha inoltre funzionato più velocemente, ha richiesto molto meno dato 3D per l’addestramento e si è generalizzato bene a diversi tipi di scansione come MRI e PET.

Che cosa significa per la cura futura

In termini pratici, questo lavoro dimostra che non è necessario partire da zero con modelli 3D affamati di dati per ottenere assistenza di alta qualità dall’IA su scansioni volumetriche. Riutilizzando intelligentemente un forte esperto 2D, selezionando con cura le fette informative e ricostruendo il quadro 3D preservando i dettagli minuti, gli autori raggiungono prestazioni all’avanguardia con molti meno dati e calcolo. Se adottato su larga scala, questo approccio potrebbe rendere l’assistenza avanzata basata sull’IA—come referti migliori, spiegazioni più chiare e triage più affidabili—accessibile a ospedali e cliniche privi di grandi risorse di dati, avvicinando l’analisi sofisticata delle immagini alla pratica clinica di routine.

Citazione: Lian, Y., Xie, Y., Jiang, Y. et al. A data-efficient 3D medical vision-language model using only a 2D encoder. Sci Rep 16, 8809 (2026). https://doi.org/10.1038/s41598-026-39526-z

Parole chiave: Imaging medico 3D, modelli visione-linguaggio, IA in radiologia, apprendimento efficiente nei dati, analisi TC e MRI