Clear Sky Science · it

Valutazione comparativa dei modelli linguistici video per la valutazione della qualità dei video di divulgazione scientifica sul cheratocono (occhio secco)

Perché questo è importante per gli spettatori di tutti i giorni

Le app di video brevi stanno rapidamente diventando il primo approdo per consigli sulla salute, compresi i problemi oculari come l’occhio secco, che interessa centinaia di milioni di persone nel mondo. Accanto a clip utili, però, è facile trovare video di bassa qualità o fuorvianti, difficili da controllare per i medici. Questo studio si chiede se i nuovi sistemi di intelligenza artificiale in grado di “guardare” i video possano aiutare a verificare automaticamente la qualità di questi contenuti sanitari, e mostra perché, per ora, tali strumenti non sono pronti a sostituire il giudizio degli esperti.

Occhi secchi e l’aumento dei video sulla salute

L’occhio secco è più di un fastidio passeggero: può offuscare la vista, causare dolore e interferire con il lavoro e la vita quotidiana. Con l’aumento della sua prevalenza, in particolare tra gli anziani e chi usa molto gli schermi, molte persone cercano online spiegazioni e consigli per l’autocura. Piattaforme come TikTok ospitano innumerevoli video brevi sull’occhio secco, ma la loro natura aperta consente a chiunque di pubblicare contenuti, a prescindere dalla formazione medica. Consigli errati o esagerati possono ritardare cure adeguate o promuovere rimedi casalinghi pericolosi, perciò servono con urgenza modi affidabili per verificare la qualità dei video su larga scala.

Come i ricercatori hanno testato i revisori video basati su AI

Il team ha raccolto 185 video in lingua cinese su TikTok riguardanti l’occhio secco usando un account nuovo e neutro e regole rigorose per conservare solo clip originali e didattiche. Due specialisti in oftalmologia hanno quindi valutato ogni video usando tre strumenti consolidati spesso impiegati nella ricerca sull’educazione medica. Uno strumento ha valutato quanto i video fossero facili da comprendere e quanto chiaramente suggerissero passi concreti che gli spettatori potessero intraprendere. Un secondo ha assegnato un voto complessivo di qualità da scarso a eccellente. Il terzo ha scomposto la qualità in aspetti come la scorrevolezza della presentazione, l’accuratezza, l’uso efficace di elementi aggiuntivi come animazioni e la corrispondenza del contenuto con il titolo del video.

Mettere alla prova modelli AI esperti di video

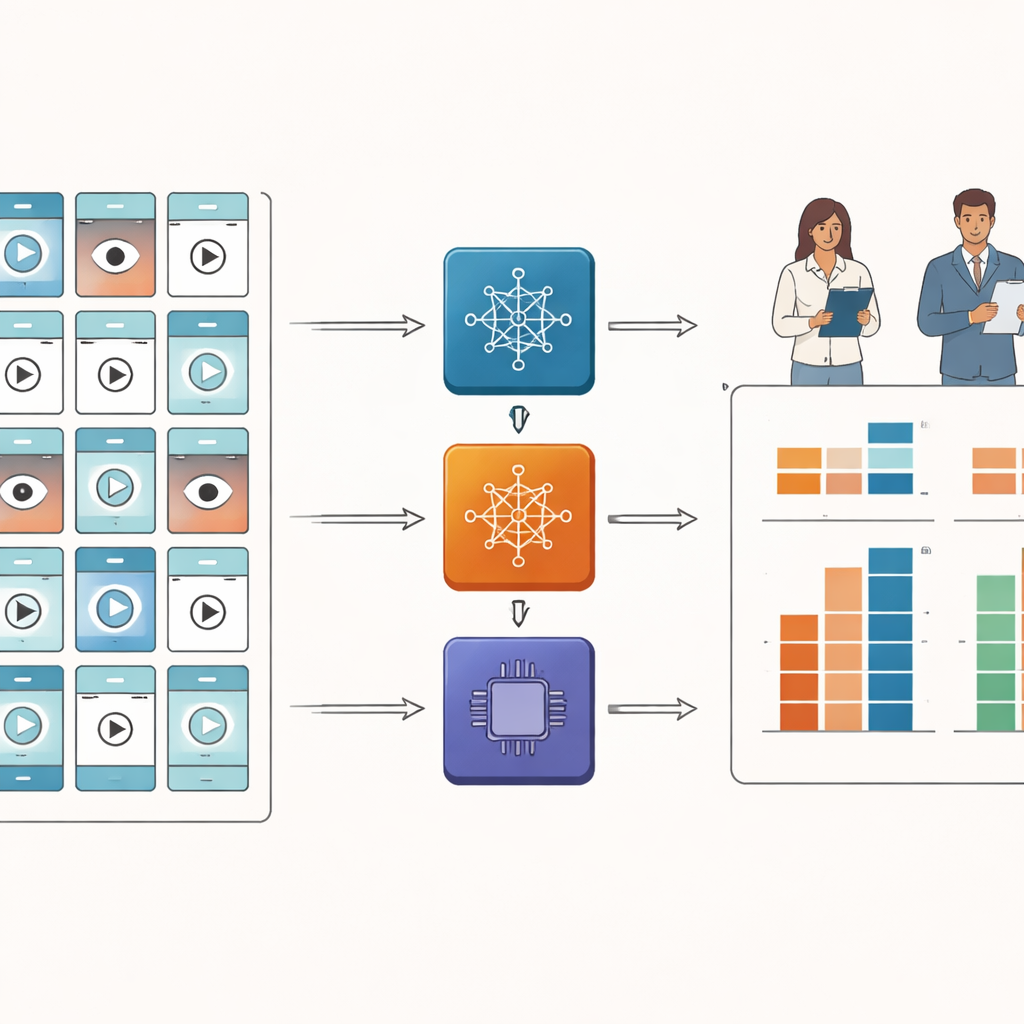

Successivamente i ricercatori hanno fornito gli stessi video a tre avanzati “modelli linguistici video”, sistemi di intelligenza artificiale progettati per interpretare informazioni visive fotogramma per fotogramma e rispondere a domande su ciò che vedono. Hanno formulato istruzioni dettagliate affinché ogni modello imitasse il più possibile gli strumenti di valutazione dei medici. La domanda chiave era se l’AI e gli esperti umani avrebbero assegnato punteggi simili. Per misurarlo, il team ha usato una statistica standard di affidabilità che cattura quanto due “giudici” diversi concordino, non solo nelle tendenze ma nei numeri effettivi.

Cosa l’AI ha fatto bene — e cosa no

I valutatori umani si sono in gran parte accordati tra loro, suggerendo che i loro punteggi erano stabili e attendibili. Al contrario, i tre sistemi AI hanno mostrato scarsa concordanza con gli esperti nella maggior parte delle aree. Nessuno dei modelli è riuscito a eguagliare in modo affidabile i medici nella qualità complessiva dei video o nelle caratteristiche dettagliate, come la corrispondenza tra titoli e contenuto. Un modello tendeva ad attribuire punteggi più alti rispetto agli esperti, un altro tendeva a valutarli più bassi, e solo uno si collocava a volte in una via di mezzo. L’unico aspetto relativamente positivo è stata l’“azione praticabilità” — quanto chiaramente i video indicavano cosa fare — dove due modelli hanno raggiunto un livello di accordo medio, ma comunque insufficiente per decisioni nel mondo reale.

Perché l’AI odierna non è all’altezza

Gli autori suggeriscono diverse ragioni per questo divario. I sistemi AI testati sono stati addestrati principalmente su scene di uso quotidiano e su compiti video generici, non sull’educazione sanitaria strutturata. Molti video scientifici si basano molto su spiegazioni parlate, sottotitoli, grafici e metafore anziché su immagini in movimento spettacolari, tuttavia i modelli di questo studio hanno analizzato solo i fotogrammi visivi e non hanno ascoltato l’audio né letto i titoli e le altre informazioni descrittive che gli esseri umani usano per giudicare rilevanza e accuratezza. Di conseguenza, vaste porzioni di significato non sono mai arrivate all’AI, specialmente quando dettagli chiave venivano detti anziché mostrati. Il linguaggio figurato comune nell’educazione sanitaria cinese può inoltre confondere sistemi che interpretano le affermazioni in modo troppo letterale.

Cosa significa questo per pazienti e piattaforme

Questo lavoro fornisce una prima tabella di marcia, non una rete di sicurezza pronta all’uso. Mostra che, in linea di principio, le checklist di qualità note per le informazioni sulla salute possono essere tradotte in istruzioni per modelli AI che osservano i video. Indica anche con chiarezza che gli attuali sistemi di uso generale non sono ancora sufficientemente affidabili per valutare video medici o controllare la disinformazione senza supervisione umana. Rilasciando il loro framework di valutazione e il dataset di video annotati, gli autori sperano di stimolare modelli migliori e più specializzati che possano combinare immagini, suono e contesto aggiuntivo, e che funzionino attraverso malattie e lingue diverse. Per ora, gli spettatori dovrebbero continuare a considerare i video brevi sulla salute come punti di partenza, non come consulenze mediche, e le piattaforme non dovrebbero fare affidamento solo sull’AI per garantire informazioni affidabili.

Citazione: Zhou, S., Huang, M., Wei, J. et al. Benchmark evaluation of video large language models in quality assessment of science popularization videos for dry eye. Sci Rep 16, 8756 (2026). https://doi.org/10.1038/s41598-026-39444-0

Parole chiave: malattia dell’occhio secco, video sulla salute, intelligenza artificiale, disinformazione, TikTok