Clear Sky Science · it

Ottimizzazione delle misure di intervento sulle malattie infettive usando il reinforcement learning con dati dell’epidemia COVID-19 nel Regno Unito

Strumenti intelligenti per decisioni sanitarie difficili

Quando una nuova malattia si diffonde in un Paese, i responsabili devono decidere rapidamente quanto stringere le restrizioni sulla vita quotidiana. Chiudere tutto può salvare vite ma distruggere l’economia; muoversi troppo tardi porta a ospedali sovraccarichi. Questo articolo esplora se una forma di intelligenza artificiale, chiamata reinforcement learning, possa aiutare i governi a trovare risposte più intelligenti e bilanciate usando simulazioni dettagliate di come un virus come il COVID‑19 si diffonde realmente nelle comunità.

Simulare un Paese al computer

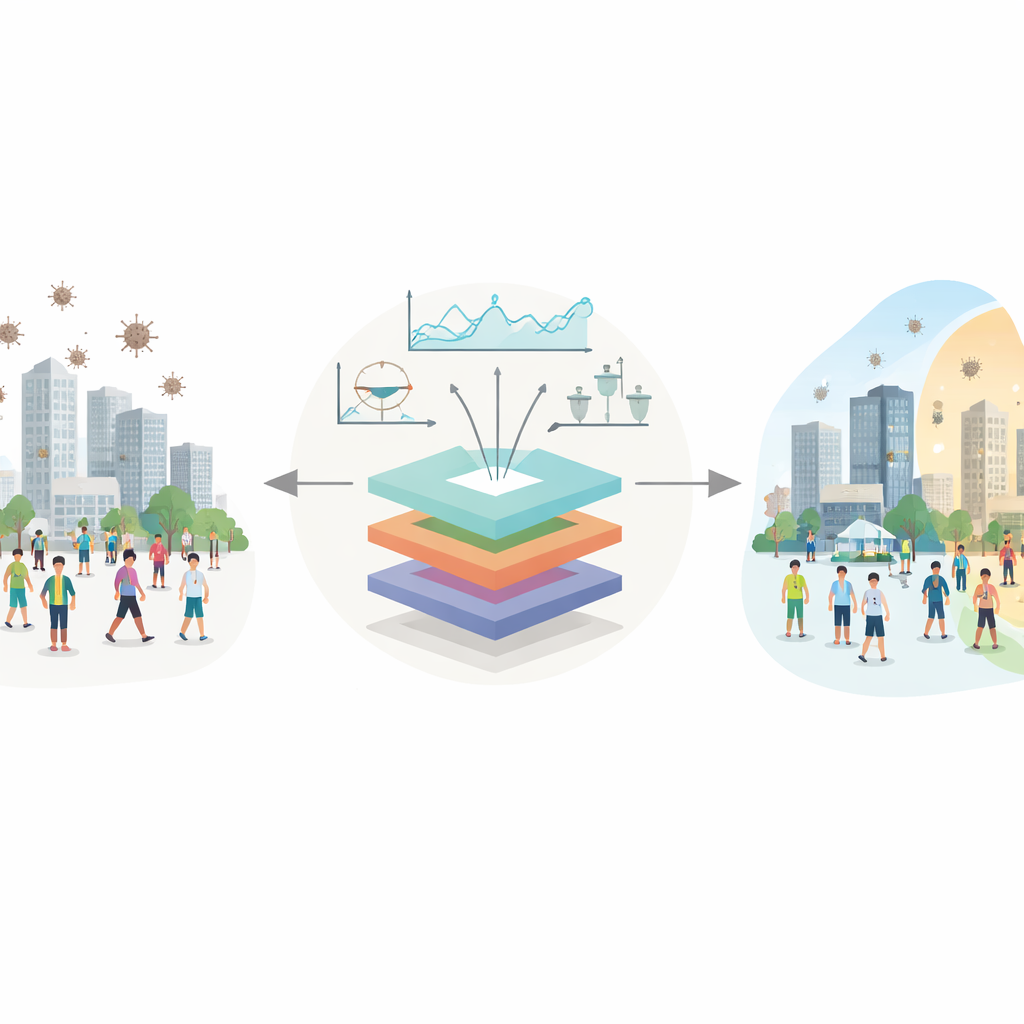

Invece di usare equazioni semplici che trattano le persone come identiche, gli autori si basano su Covasim, un modello computazionale ricco che segue migliaia di individui virtuali mentre vivono, lavorano, studiano e interagiscono. Ogni persona simulata ha un’età, un ruolo in famiglia, scuola e rete lavorativa, e uno stato di salute che può cambiare da sano a infetto a guarito o deceduto. Regolando attentamente i parametri del modello, il team fa in modo che questo Regno Unito virtuale si comporti come quello reale durante la prima ondata di COVID‑19, corrispondendo ai dati ufficiali di casi e decessi di inizio 2020. Questo passo di calibrazione è cruciale, perché qualsiasi strategia che il computer apprende deve funzionare in un mondo che somigli al nostro, non in un universo giocattolo.

Insegnare a un consigliere digitale ad agire

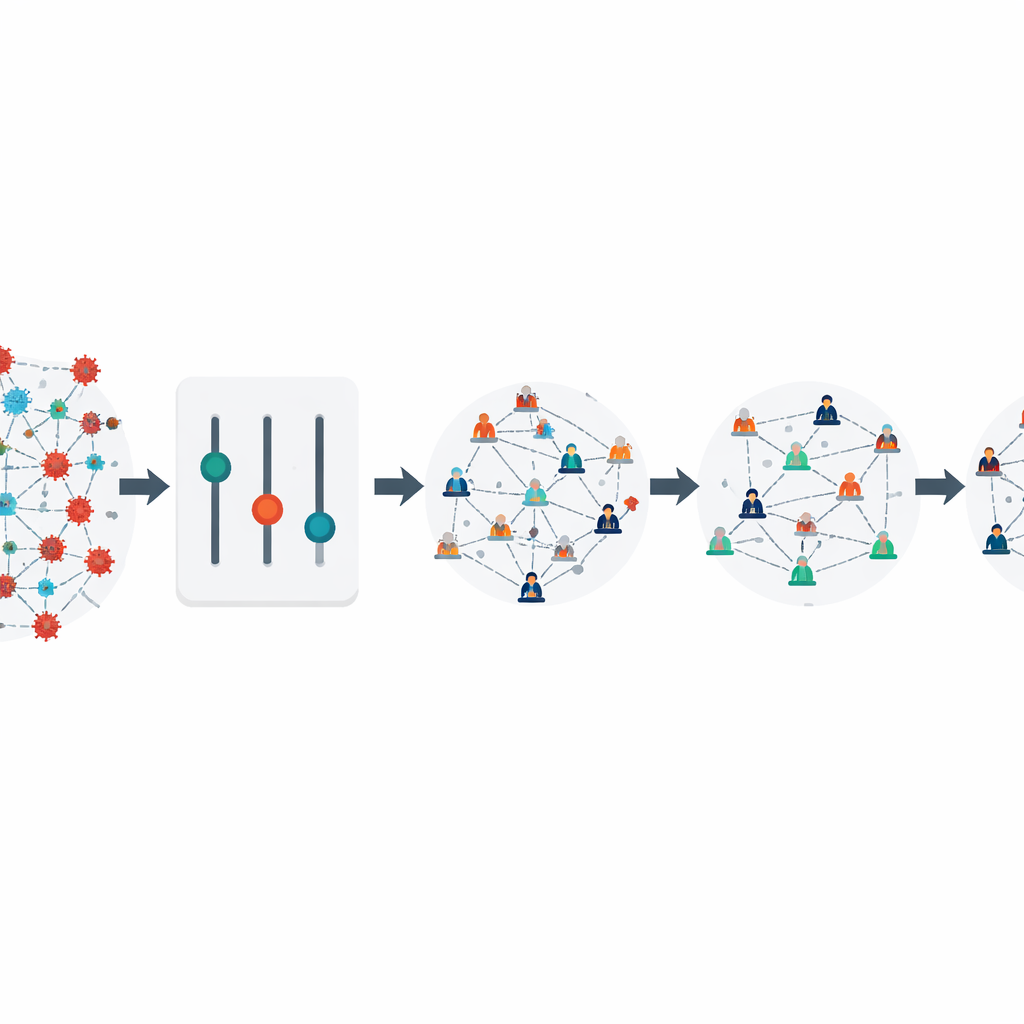

Una volta che il modello si comporta come la realtà, i ricercatori inseriscono il reinforcement learning, un ramo dell’IA in cui un “agente” software prova ripetutamente decisioni e viene premiato o penalizzato in base agli esiti. Qui l’agente può aggiustare tre leve principali ogni settimana simulata: quanto severe sono le chiusure parziali, quante persone vengono testate e quanto aggressivo è il tracciamento dei contatti. Il sistema di ricompensa è progettato per catturare due obiettivi in competizione: mantenere basso il numero di infezioni, forme gravi e decessi, limitando al contempo i danni economici causati dalla chiusura dei luoghi di lavoro e dall’isolamento delle persone. Eseguendo migliaia di epidemie simulate, l’agente scopre quali combinazioni e tempistiche di misure ottengono il punteggio complessivo più alto.

Trovare un equilibrio migliore rispetto a regole fisse

Lo studio confronta diversi metodi di apprendimento e modi di descrivere le scelte dell’agente. Un metodo che tratta le azioni come regolazioni fluide di un quadrante, piuttosto che come un piccolo menu di opzioni fisse, funziona particolarmente bene. Impara a rispondere rapidamente quando il virus comincia a diffondersi, imponendo restrizioni brevi ma severe abbinate a test e tracciamento intensi. Quando l’epidemia simulata si controlla, allenta i lockdown mantenendo però test e tracciamento, per poi stringere di nuovo brevemente se le infezioni minacciano di risalire. Questo schema flessibile mantiene il numero totale di infezioni a circa 300.000 nel modello, molto al di sotto di quanto avvenuto con le politiche reali adottate nel Regno Unito nello stesso periodo, e anche inferiore a una semplice regola “sette giorni aperto, sette giorni chiuso”. Le perdite economiche nel modello risultano ridotte di oltre due terzi rispetto a quella strategia rigida di alternanza dei lockdown.

Il timing conta davvero

Gli autori esaminano anche come queste diverse strategie influenzano il numero di riproduzione in tempo reale, una misura di quante nuove infezioni genera ciascun caso. Nelle loro simulazioni, la politica progettata dall’IA porta questo numero sotto il valore critico di uno circa un mese prima rispetto alla risposta effettiva del Regno Unito. Questo spostamento apparentemente piccolo riduce drasticamente le infezioni cumulative, sottolineando quanto possa fare la differenza un’azione precoce e ben pianificata. Testano inoltre la politica appresa in un contesto molto diverso, usando dati della grande ondata di COVID‑19 di Hong Kong nel 2022, e trovano che la stessa strategia funziona ancora bene, suggerendo che le regole apprese catturano principi generali piuttosto che adattarsi eccessivamente a un solo Paese.

Cosa significa per future epidemie

Per i non specialisti, il messaggio principale è che non dobbiamo scegliere alla cieca tra salvare vite e salvare i mezzi di sussistenza. Combinando simulazioni dettagliate di come un virus si muove attraverso reti sociali reali con un’IA che impara per tentativi ed errori, i responsabili politici potrebbero ricevere manuali basati sui dati che si adattano mentre le condizioni cambiano. Gli autori sottolineano che tali strumenti non sono pensati per sostituire il giudizio umano, ma per fungere da potenti ausili decisionali, esplorando innumerevoli scenari ipotetici molto più rapidamente di quanto possano fare le persone. Con l’emergere di nuove epidemie, questo approccio potrebbe aiutare i leader ad agire prima e con maggiore precisione, usando test mirati, tracciamento e chiusure parziali per mantenere la malattia sotto controllo preservando il più possibile la vita normale e l’attività economica.

Citazione: Zhang, B., Chen, Y., Li, H. et al. Optimization of infectious disease intervention measures using reinforcement learning with UK COVID-19 epidemic data. Sci Rep 16, 10627 (2026). https://doi.org/10.1038/s41598-026-39377-8

Parole chiave: politica COVID-19, reinforcement learning, simulazione epidemica, misure non farmaceutiche, strategia di sanità pubblica