Clear Sky Science · it

Parsing degli indirizzi dei pazienti tramite apprendimento contrastivo con KG e inferenza LLM vincolata on‑prem

Perché gli indirizzi dei pazienti ordinati contano

Dietro ogni visita ospedaliera c’è una linea di testo apparentemente umile: l’indirizzo di residenza del paziente. Lungi dall’essere un dettaglio amministrativo, questi indirizzi alimentano la mappatura delle malattie, la pianificazione delle emergenze e le decisioni su dove collocare cliniche e ambulanze. Tuttavia, in molti sistemi di cartelle cliniche gli indirizzi sono memorizzati come testo disordinato e incoerente, pieno di abbreviazioni, errori di battitura e elementi mancanti. Questo articolo presenta AddrKG‑LLM, un nuovo metodo che trasforma tale testo disordinato in registrazioni pulite e affidabili mantenendo la riservatezza dei dati sensibili.

Il problema degli indirizzi di casa disordinati

Quando gli indirizzi vengono digitati liberamente, le persone lasciano fuori i quartieri, scambiano l’ordine delle parole o usano soprannomi locali che le mappe ufficiali non riconoscono. I metodi informatici più vecchi confrontano le stringhe carattere per carattere o come semplici elenchi di parole, il che funziona solo quando gli input sono già ordinati e completi. I sistemi di deep learning più recenti comprendono il contesto in modo più intelligente, ma possono comunque essere disorientati da formulazioni insolite e richiedono notevole capacità di calcolo. Di recente, i grandi modelli linguistici hanno dimostrato una notevole abilità nel comprendere e generare testo. Tuttavia, se lasciati liberi di rispondere, tendono anche a “allucinare” dettagli non presenti nei dati — un rischio inaccettabile in ambito sanitario, dove le registrazioni devono essere precise e verificabili.

Un percorso in due fasi dal caos all’ordine

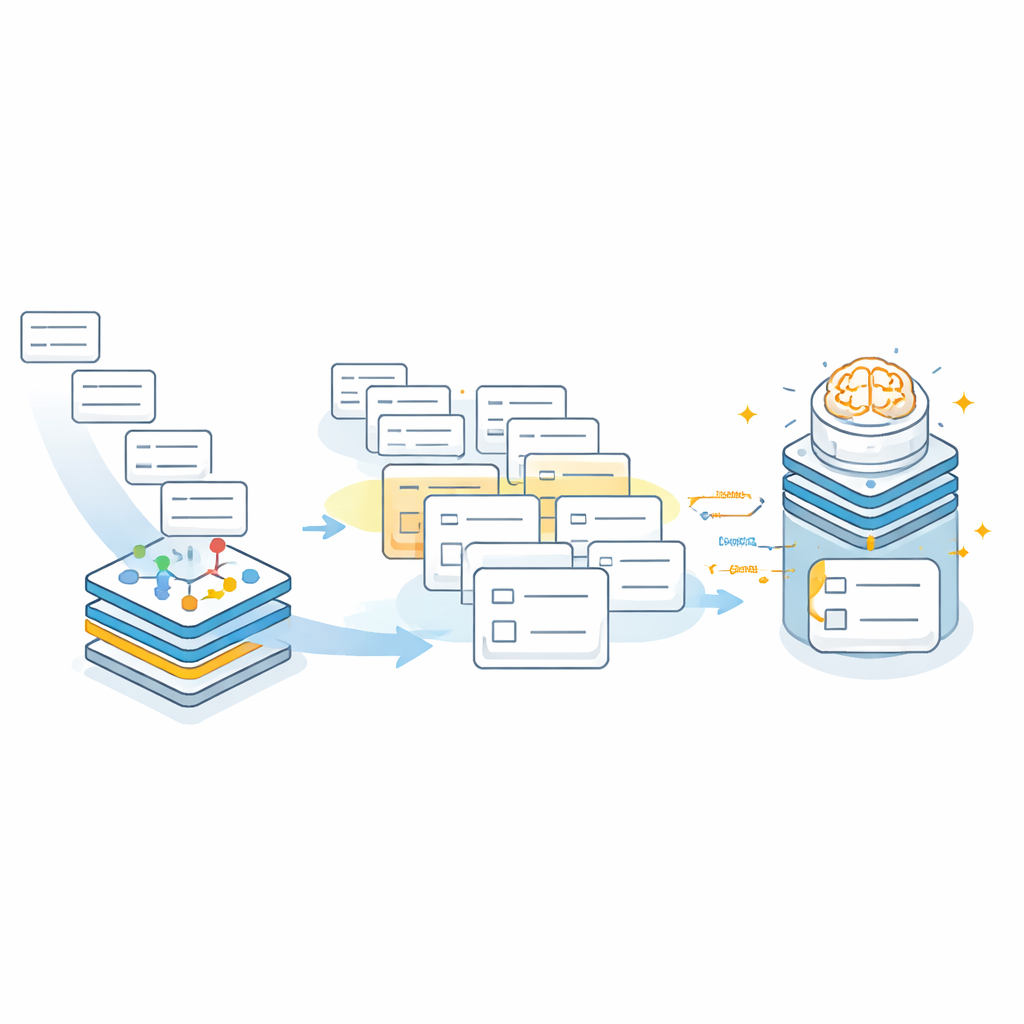

I ricercatori hanno progettato AddrKG‑LLM come una pipeline in due stadi che aggiunge struttura e vincoli attorno al modello linguistico invece di lasciarlo agire da solo. Per prima cosa, gli indirizzi dei pazienti in ingresso vengono ripuliti per rimuovere dettagli altamente identificativi come numeri civici, numeri di stanza e contatti telefonici, contribuendo a proteggere la privacy. Il testo rimanente viene convertito in una rappresentazione numerica densa che cattura il suo significato. Contemporaneamente, il team costruisce un grafo di conoscenza — una rete a mappa che codifica le relazioni ufficiali tra città, quartieri, strade e comunità residenziali. Usando una tecnica chiamata apprendimento contrastivo, addestrano il sistema in modo che gli indirizzi che si riferiscono alla stessa comunità reale stiano vicini in questo spazio condiviso, mentre i luoghi non correlati vengano spinti più lontano. Ciò permette al sistema di recuperare rapidamente una breve lista di candidati di indirizzo probabili per ogni nuova registrazione paziente.

Mantenere l’IA con un guinzaglio corto

Nella seconda fase, il grande modello linguistico opera all’interno di uno spazio di ricerca attentamente delimitato. Invece di inventare un indirizzo da zero, il modello riceve il testo originale ripulito più il piccolo insieme di comunità candidate suggerite dal grafo di conoscenza. Il prompt istruisce esplicitamente il modello a scegliere solo tra questi candidati e a produrre risultati in una struttura JSON fissa con campi separati per città, quartiere, via o municipio e comunità. Se nessuno dei candidati è adatto — per esempio quando la comunità reale non è stata recuperata — il modello è istruito a restituire valori vuoti anziché indovinare. Questo comportamento di “rifiuto prima” riduce nettamente il rischio che voci plausibili ma errate finiscano nelle cartelle ospedaliere.

Quanto funziona nella pratica?

Il team ha testato AddrKG‑LLM su diecimila indirizzi ospedalieri reali de‑identificati che riflettono il rumore del mondo reale: abbreviazioni, quartieri mancanti, varianti ortografiche e persino voci completamente invalide. Hanno confrontato il loro sistema con strumenti classici di string‑matching, modelli di etichettatura di sequenze basati su deep learning, modelli linguistici generalisti usati in modo libero e un servizio commerciale di standardizzazione degli indirizzi. Su misure rigorose che richiedono che ogni campo di un indirizzo sia corretto contemporaneamente, AddrKG‑LLM ha superato tutti questi baseline, aumentando l’accuratezza complessiva di oltre dodici punti percentuali rispetto a un solido modello basato su BERT. I miglioramenti sono stati particolarmente evidenti per indirizzi abbreviati e parzialmente mancanti, dove la gerarchia incorporata del grafo di conoscenza aiuta a colmare le lacune. Gli autori hanno anche esplorato come le prestazioni cambiano con diverse dimensioni del modello linguistico e con diversi numeri di candidati recuperati, mostrando come gli ospedali possano bilanciare velocità e accuratezza in base alle proprie esigenze.

Cosa significa per la cura quotidiana

Per i non specialisti, il messaggio chiave è che AddrKG‑LLM offre un modo per ripulire dati di indirizzo dei pazienti vitali ma disordinati mantenendo il controllo saldamente nelle mani umane. Accoppiando un grafo di conoscenza a mappa con un modello linguistico vincolato che gira interamente sui server ospedalieri, il framework fornisce indirizzi più accurati e coerenti senza inviare dettagli sensibili a servizi cloud esterni o permettere all’IA di improvvisare. Il risultato è uno strumento pratico che può rafforzare la sorveglianza delle malattie, migliorare la pianificazione delle risorse e supportare operazioni ospedaliere più sicure ed efficienti — semplicemente assicurando che ogni paziente sia affidabilmente sulla mappa.

Citazione: Li, J., Pan, X. & Jia, Y. Patient address parsing via KG-aware contrastive learning and constrained on-prem LLM inference. Sci Rep 16, 8003 (2026). https://doi.org/10.1038/s41598-026-39348-z

Parole chiave: parsing indirizzi pazienti, qualità dei dati sanitari, grafo di conoscenza, modello linguistico di grandi dimensioni, informatica medica