Clear Sky Science · it

Analisi delle relazioni tra tratti del parlante e caratteristiche multimodali consapevole della privacy nei colloqui di lavoro

Perché la tua voce nei colloqui di lavoro solleva nuove questioni

Sempre più aziende si affidano a colloqui video automatizzati, in cui algoritmi ascoltano come parli e deducono tratti come sicurezza, affidabilità o socievolezza. Ma la tua voce veicola molto più di una prima impressione: può suggerire la tua identità, il tuo stato di salute e il tuo background. Questo articolo esamina se sia possibile nascondere chi sei in una registrazione mantenendo però la capacità dei computer di valutare come ti presenti come candidato. In altre parole, possiamo conservare i vantaggi dell’assunzione assistita dall’IA senza sacrificare la nostra privacy di nascosto?

Dalle prime impressioni ai giudizi automatizzati

Gli psicologi del lavoro sanno da tempo che schemi di personalità ampi — spesso descritti dai Big Five: apertura, coscienziosità, estroversione, amicalità e stabilità emotiva — influenzano il successo professionale. I progressi recenti dell’intelligenza artificiale permettono ai computer di stimare questi tratti a partire dal modo in cui le persone parlano nei colloqui, cogliendo non solo cosa dicono ma come lo dicono: tono, intensità, ritmo e stile complessivo del parlato. Questi sistemi promettono uno screening dei candidati più rapido e coerente. Sollevano però anche una preoccupante domanda: se un’azienda conserva la tua voce, quegli stessi dati potrebbero poi essere usati per riconoscerti, profilarti o inferire dettagli sensibili che non hai autorizzato a condividere?

Come nascondere una voce senza perderne il carattere

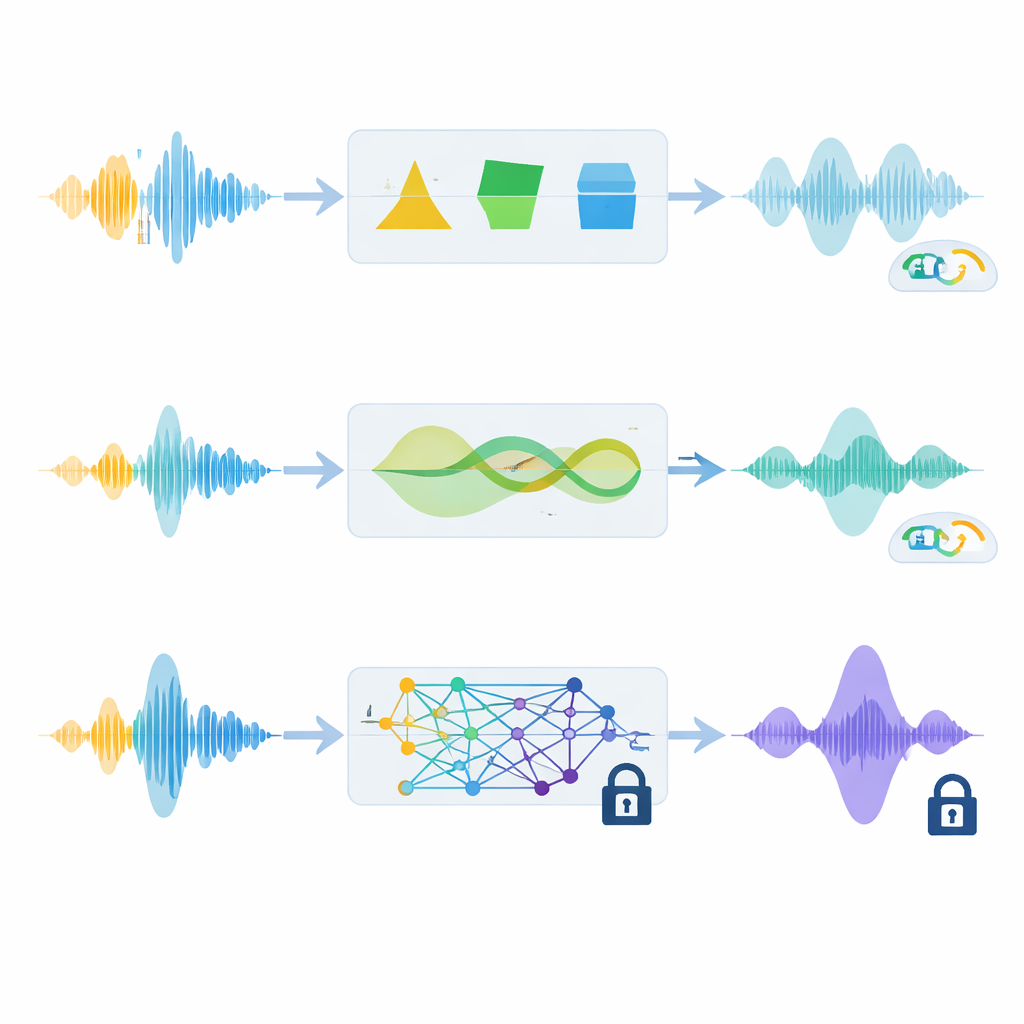

Per affrontare questo dilemma, i ricercatori hanno studiato tecniche che modificano la voce di una persona in modo che non sembri più la sua, preservando però gli indizi necessari per valutazioni di personalità e di idoneità al lavoro. Si sono concentrati su tre metodi di anonimizzazione. Due di essi impiegano trucchi audio tradizionali, come rimodellare lievemente le frequenze del suono e allungare o spostare il tono nel tempo. Il terzo si basa su un moderno codec audio neurale, che comprime la voce in una serie di codici digitali e la ricostruisce come una voce nuova, di alta qualità ma con timbro diverso. Crucialmente, il team ha regolato tutti i metodi in modo che il genere percepito del parlante rimanesse lo stesso e la voce convertita fosse coerente attraverso risposte multiple in un lungo colloquio online.

Mettere alla prova privacy e utilità

Usando quasi 1.900 video reali di colloqui di lavoro online di persone negli Stati Uniti, gli autori hanno posto due domande principali. Primo, quanto sarebbe difficile per un attaccante ricollegare voci anonimizzate ai parlanti originali usando un avanzato sistema di riconoscimento vocale? Secondo, dopo l’anonimizzazione, gli algoritmi riuscirebbero ancora a prevedere con simile accuratezza le principali valutazioni di personalità e le raccomandazioni di assunzione? Hanno valutato la privacy usando un tasso di errore della verifica automatica del parlante — errore più alto significa maggiore protezione — e misurato l’utilità tramite l’accuratezza del riconoscimento del parlato, la qualità audio percepita e quanto bene i modelli di machine learning potevano inferire tratti e decisioni di assunzione da caratteristiche acustiche e linguistiche.

Com’è davvero il compromesso

I risultati rivelano un bilanciamento sfumato tra sicurezza e prestazioni. Il metodo più semplice, che rimodella lievemente le frequenze vocali, ha fornito soltanto una privacy modesta e può fallire quasi del tutto quando il sistema dell’attaccante è tarato sulle voci anonimizzate. Una tecnica basata sul segnale più avanzata, che altera tempistica e intonazione, ha fatto molto meglio: ha ridotto significativamente le probabilità di re-identificazione riuscita preservando ritmo ed espressività del parlato. Di conseguenza, le previsioni su assunzione e personalità sono rimaste vicine a quelle ottenute dalle registrazioni originali. Il metodo con codec audio neurale ha offerto la privacy più elevata, rendendo molto più difficile collegare le voci anonimizzate ai parlanti reali e spesso rimuovendo anche il rumore di fondo. Tuttavia, nelle registrazioni di colloqui reali e rumorose, questo metodo ha anche disturbato sottili segnali prosodici che influenzano la percezione dei tratti, causando una diminuzione notevole nella stima dei tratti e un aumento degli errori nella trascrizione automatica.

Cosa significa per assunzioni eque e private

Lo studio dimostra che non esiste una soluzione valida per ogni contesto: una privacy più forte spesso si paga con una minore capacità dell’IA di leggere la personalità e raccomandare candidati. Per gli ambienti di assunzione tipici, in cui la stima dei tratti e decisioni eque sono prioritarie, approcci raffinati di elaborazione del segnale — in particolare il metodo basato sulla fase testato qui — possono offrire il miglior compromesso, proteggendo l’identità mantenendo il “timbral feel” della voce di una persona. In situazioni con esigenze di privacy più elevate, come la condivisione ampia di dati vocali o la difesa contro attaccanti potenti, i nuovi metodi con codec neurali possono dare maggiore protezione, ma i progettisti devono accettare una certa perdita nella precisione delle valutazioni di personalità e idoneità. In definitiva, il lavoro sostiene che proteggere la voce dei candidati dovrebbe essere trattato come un obbligo etico e non come un ripensamento, e che gli strumenti futuri devono mirare con cura a quali aspetti del parlato nascondere e quali preservare.

Citazione: Mawalim, C.O., Leong, C.W. & Okada, S. Privacy-aware speaker trait and multimodal features relationship analysis in job interviews. Sci Rep 16, 8181 (2026). https://doi.org/10.1038/s41598-026-39322-9

Parole chiave: anonimizzazione della voce, assunzioni con IA, tratti del parlante, privacy nei dati vocali, colloqui di lavoro