Clear Sky Science · it

Riconoscimento delle emozioni dominanti nei video per dispositivi EEG portatili

Perché i tuoi video potrebbero sapere come ti senti

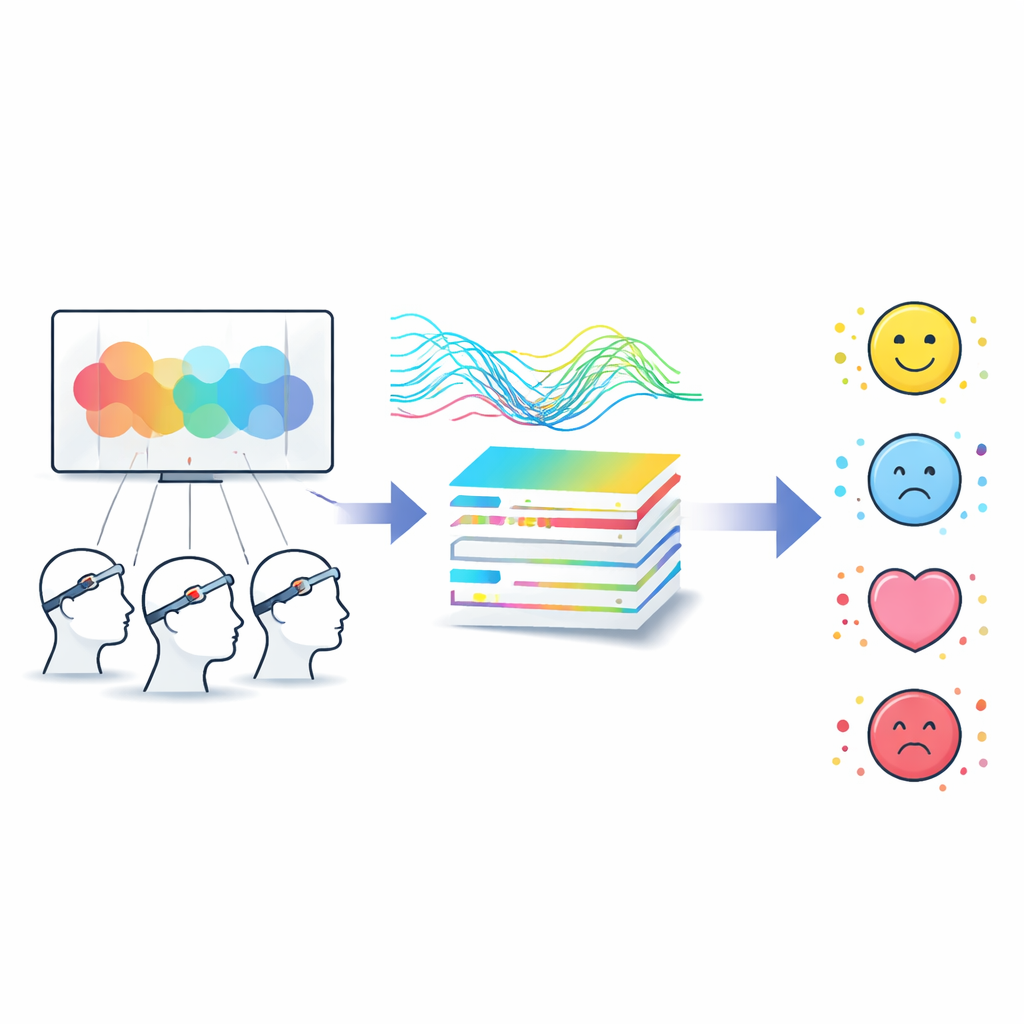

Immagina di guardare il trailer di un film mentre una fascia leggera tiene «l’orecchio» al tuo cervello e indovina se ti senti felice, rilassato, triste o spaventato. Questo studio esplora come rendere realistico quello scenario usando un piccolo dispositivo portatile per le onde cerebrali (EEG) invece di costose apparecchiature da laboratorio. Il lavoro è rilevante per chiunque sia interessato a media più intelligenti: dagli inserzionisti che vogliono comprendere le reazioni del pubblico, alle piattaforme di streaming che potrebbero raccomandare programmi basati su come gli spettatori si sentono realmente, non solo su ciò che cliccano.

Leggere le emozioni dalle onde cerebrali

I nostri cervelli producono deboli segnali elettrici rilevabili sul cuoio capelluto mediante l’elettroencefalografia, o EEG. Questi segnali cambiano sottilmente quando proviamo emozioni diverse. Un dataset di ricerca molto usato, chiamato DEAP, ha registrato l’EEG di persone mentre guardavano videoclip musicali e poi ha chiesto loro di valutare quanto ogni video fosse piacevole, intenso, controllato e apprezzabile. La maggior parte degli studi precedenti ha cercato di ottenere la massima accuratezza possibile usando molti elettrodi e potenti computer, ma in condizioni di laboratorio ideali che non rispecchiano la vita reale. Questo articolo pone invece una domanda più pratica: con un dispositivo portatile a basso costo e meno elettrodi, possiamo comunque catturare l’emozione principale che un video tende a suscitare nella maggior parte delle persone?

Trovare una storia emotiva condivisa

Un ostacolo è che le persone non descrivono le proprie sensazioni allo stesso modo. Due spettatori possono guardare lo stesso clip, uno chiamandolo «eccitante» e l’altro «così così». I ricercatori affrontano questo problema costruendo un sistema graduale di calibrazione delle etichette che cerca pattern attraverso gli spettatori invece di affidarsi alla valutazione di una singola persona. Prima, tutte le valutazioni vengono messe su una scala comune e compressi in poche dimensioni chiave. Poi, il clustering non supervisionato raggruppa risposte emotive simili, con l’obiettivo di dividere i video in quattro ampie aree dello spazio emotivo: felice (piacevole e intenso), rilassato (piacevole e calmo), pauroso (spiacevole e intenso) e triste (spiacevole e calmo). Una fase finale di raffinamento aggiusta i casi incerti basandosi su informazioni di voto aggiuntive, producendo un’etichetta di emozione dominante per ciascun video che riflette meglio l’impressione complessiva del gruppo.

Ottenere di più da meno hardware

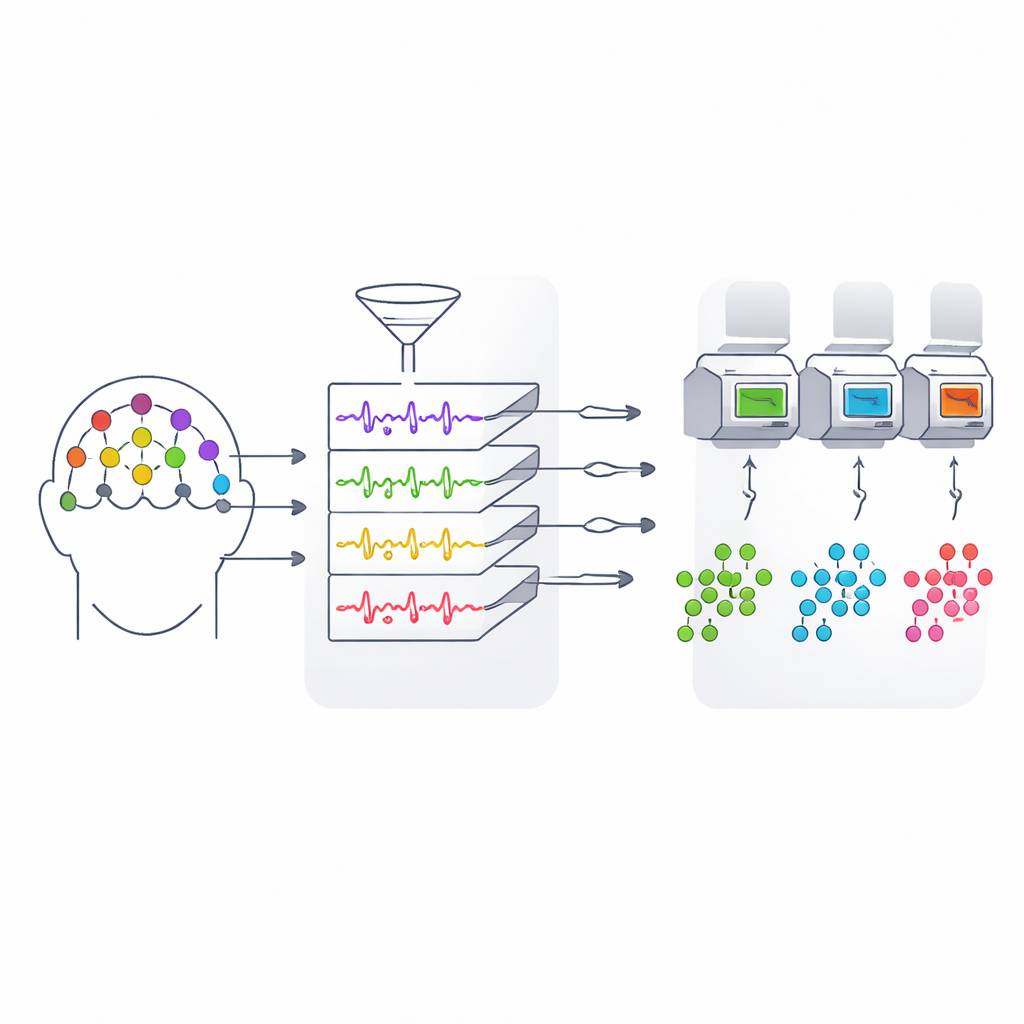

Un altro problema è l’hardware: cuffie EEG complete con 32 o più elettrodi sono ingombranti e costose. Il team progetta un modo per ridurle a sole 11 posizioni scelte con cura sulla fronte, centro, lati e retro della testa—aree legate al controllo emotivo, all’arousal, all’udito, alla visione e all’attenzione. Successivamente effettuano un’analisi dettagliata di come l’energia del segnale si distribuisce attraverso le classiche bande di onde cerebrali (da ritmi lenti a rapidi) in diversi stati emotivi. Confrontando questi schemi, mostrano che certe combinazioni di frequenze e posizioni sul cuoio capelluto contengono indizi particolarmente forti su se, per esempio, uno spettatore è altamente eccitato o profondamente rilassato. Questo approccio basato sul rapporto di energia multi-banda permette di conservare i segnali più informativi eliminando gran parte della ridondanza.

Lascare che i dati evidenzino ciò che conta

Anche con meno elettrodi, ogni secondo di registrazione contiene un flusso di numeri. Per non sovraccaricare i modelli, gli autori combinano diversi tipi di caratteristiche—come misure di energia basate su wavelet, quanto fortemente diverse aree cerebrali fluttuano insieme, e come la potenza nelle varie frequenze cambia nel tempo—in una descrizione ricca ma strutturata di ogni visione. Un passaggio di selezione guidato dalla salienza poi ordina queste caratteristiche in base a quanto sono utili per distinguere le emozioni, mantenendo solo un sottoinsieme compatto. Usando questa rappresentazione ridotta, vengono addestrati tre modelli standard di apprendimento automatico per riconoscere quale delle quattro emozioni dominanti si adatta meglio a un dato video. In test impegnativi, dove il sistema deve generalizzare su persone completamente nuove, il modello migliore raggiunge circa il 45% di accuratezza, un risultato solido per una scelta a quattro vie con dati cerebrali rumorosi e solo 11 canali.

Cosa significa per la tecnologia di tutti i giorni

Per i non specialisti, il messaggio chiave è che possiamo cominciare a valutare come gruppi di persone reagiscono emotivamente ai video usando piccoli dispositivi portatili per le onde cerebrali invece di ingombranti apparati di laboratorio. Pulendo le etichette emotive, concentrandosi sulle parti più informative del segnale EEG e selezionando solo una manciata di sensori ben posizionati, gli autori dimostrano che è possibile rilevare il tono emotivo dominante di un video—felice, rilassato, pauroso o triste—tra gli spettatori. Il sistema non è perfetto, ma indica la strada verso strumenti pratici per il monitoraggio del sentimento del pubblico, il testing dei contenuti e raccomandazioni sensibili alle emozioni basate su risposte cerebrali oggettive piuttosto che solo su sondaggi o clic.

Citazione: Wen, X., Xu, W., Tian, L. et al. Video-dominant emotion recognition for portable EEG-based devices. Sci Rep 16, 7899 (2026). https://doi.org/10.1038/s41598-026-39315-8

Parole chiave: riconoscimento delle emozioni con EEG, interfaccia cervello-computer, analisi affettiva dei video, neuroscienze indossabili, computazione affettiva