Clear Sky Science · it

Usare un large language model per migliorare il ragionamento di un altro large language model tramite GRPO aggiornato con ricompense

Insegnare alle macchine a ragionare fino in fondo

Molti dei modelli linguistici odierni sanno conversare, tradurre e rispondere a domande, ma faticano ancora a mostrare il processo di ragionamento come farebbe un bravo studente di matematica o un analista attento. Questo articolo esplora come un sistema di intelligenza artificiale possa essere usato per migliorare le capacità di ragionamento di un altro sistema, e come farlo senza costruire manualmente enormi dataset specializzati. Per i lettori interessati a come l’IA possa diventare più affidabile in ambiti come finanza, medicina o ricerca scientifica, il lavoro offre una ricetta pratica per far sì che i modelli spieghino le loro risposte in modo più chiaro e coerente.

Da documenti grezzi a esempi insegnabili

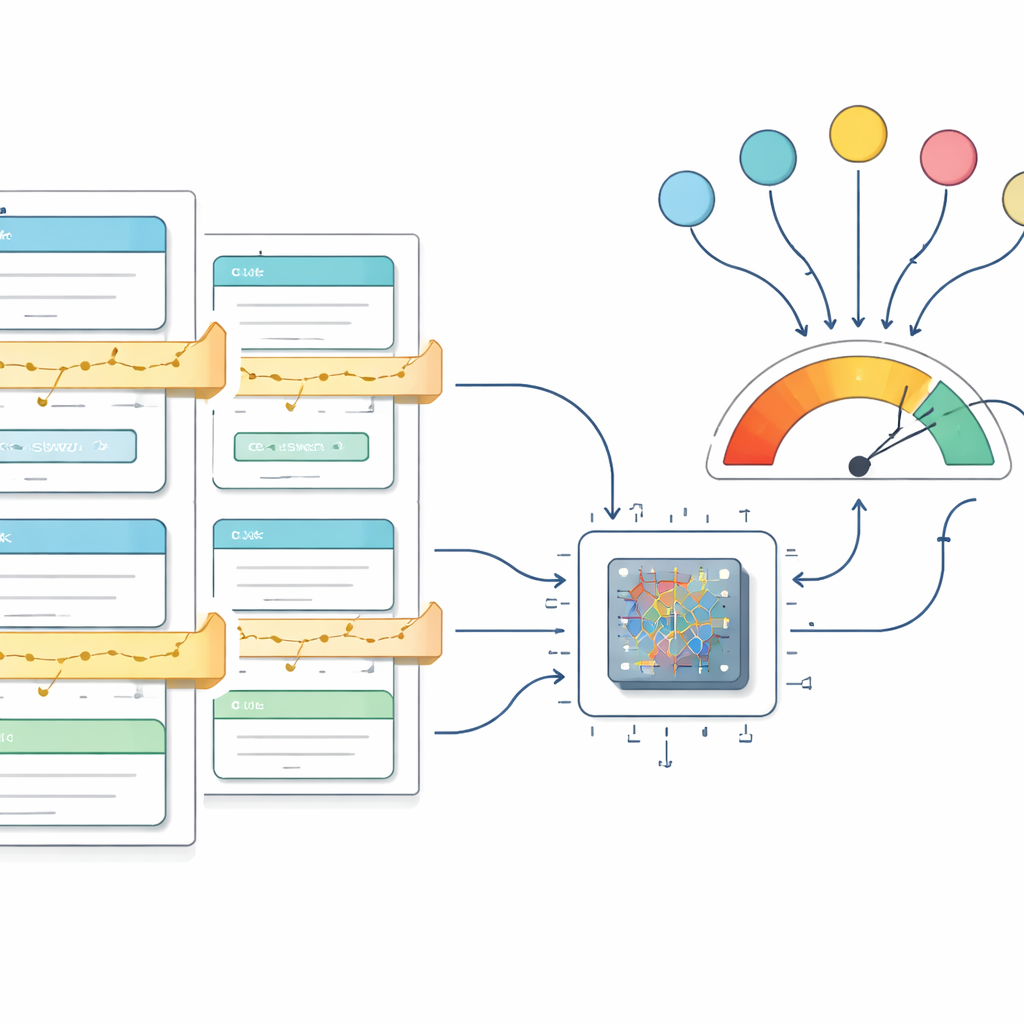

Gli autori partono da un’osservazione semplice: la maggior parte delle informazioni del mondo reale è contenuta in forme disordinate come report, lettere agli azionisti o pagine web, non in un ordinato formato domanda‑risposta. Per colmare questo divario introducono due strumenti software, Huggify-Data e il CoT Data Generator. Questi strumenti prendono testo non strutturato e lo convertono automaticamente in coppie di domande e risposte, quindi chiedono a un potente modello linguistico di fornire i passaggi di ragionamento mancanti. Il risultato è un triplice formato strutturato per ogni esempio: una domanda, una catena di ragionamento e una risposta. Crucialmente, questa pipeline può essere applicata quasi a qualsiasi dominio, dalla matematica scolastica alla finanza aziendale, rendendo possibile costruire dati di addestramento incentrati sul ragionamento senza eserciti di annotatori umani.

Come un modello istruisce un altro

Una volta creati questi triplette domanda–ragionamento–risposta, vengono usate per addestrare un modello “studente” più piccolo a pensare nello stesso modo strutturato. Allo studente non viene chiesto solo di fornire una risposta finale, ma di produrre una spiegazione chiaramente separata seguita dalla conclusione. L’addestramento è guidato da un metodo chiamato Group Relative Policy Optimization, che confronta diverse risposte candidate alla stessa domanda e spinge il modello verso quelle migliori. L’articolo aggiorna questo metodo con un termine di ricompensa aggiuntivo che verifica se l’output del modello segue il formato desiderato, fino a quanto si avvicina a un esempio di riferimento ben formato. Questa ricompensa penalizza delicatamente spiegazioni confuse o incomplete, orientando il modello verso risposte ordinate e interpretabili.

Mettere l’approccio alla prova

Per verificare se il framework funziona nella pratica, gli autori lo applicano a due dataset molto diversi. Il primo, GSM8K, è composto da problemi di matematica elementare che richiedono ragionamento aritmetico a più passaggi. Il secondo è costruito dalle lettere annuali di Warren Buffett agli azionisti, dove l’obiettivo è catturare il ragionamento esteso su investimenti e decisioni aziendali. In entrambi i casi, la pipeline trasforma testo grezzo in dati di addestramento strutturati e affina un modello di dimensioni medie chiamato Qwen 2.5. Durante l’addestramento, una semplice regola di punteggio premia risposte corrette e ben formattate; col progredire dell’apprendimento, la ricompensa media cresce costantemente e si stabilizza al suo massimo teorico, dimostrando che il modello ha in larga parte padroneggiato il comportamento target sui dati di addestramento.

Quanto bene si comporta il modello migliorato

Le prestazioni vengono misurate usando la “accuratezza media per token”, che valuta, in termini generali, quale frazione dei piccoli pezzi di testo (token) negli output del modello corrisponde a quelli attesi. Pur essendo diversa dalla consueta valutazione tutto-o-nulla delle risposte ai test, questa metrica è adatta a giudicare se spiegazioni e risposte sono prodotte nella struttura corretta. Su GSM8K, il miglior modello raggiunge il 98,2 percento di accuratezza per token, e sulle lettere di Buffett arriva al 98,5 percento. Questi punteggi sono superiori a quelli riportati per sistemi ampiamente noti come GPT‑4 e Claude 3.5 Sonnet con la stessa metrica, il tutto utilizzando un modello da soli 3 miliardi di parametri che può essere addestrato in meno di due giorni su hardware noleggiato. Gli autori condividono inoltre dettagli sui costi di calcolo e sulle configurazioni hardware, e rilasciano tutto il codice, i modelli e i dataset per permettere a altri di ispezionare e sviluppare ulteriormente il lavoro.

Cosa significa per l’uso quotidiano dell’IA

Per i non specialisti, la conclusione principale è che i sistemi di IA possono essere insegnati non solo a rispondere, ma a rispondere in modo disciplinato e facile da seguire, usando dati estratti automaticamente da documenti ordinari. Combinando un modello insegnante ricco di ragionamento, una pipeline di dati flessibile e uno schema di ricompense che valorizza correttezza e chiarezza, gli autori mostrano come modellare sistemi più piccoli in risolutori di problemi più affidabili. Pur segnalando limiti — come la necessità di test più severi per valutare la comprensione reale e la sicurezza — il framework indica un futuro in cui le organizzazioni possono trasformare i propri archivi di testo in assistenti IA su misura e trasparenti per l’istruzione, la finanza e oltre.

Citazione: Yin, Y. Use large language model to enhance reasoning of another large language model through reward updated GRPO. Sci Rep 16, 8360 (2026). https://doi.org/10.1038/s41598-026-39296-8

Parole chiave: large language model, ragionamento chain-of-thought, ottimizzazione delle ricompense, curazione dei dati, IA specifica per dominio