Clear Sky Science · it

Un'analisi comparativa di modelli chatbot integrati e ChatGPT-4 per rispondere a domande sul trattamento ortodontico

Perché i chatbot più intelligenti sono importanti per gli apparecchi

Chi ha portato l’apparecchio sa che le domande non aspettano l’orario della clinica: questo dolore finirà? Posso mangiare questo? Devo preoccuparmi per la mandibola? Questo studio esplora se un chatbot ortodontico progettato appositamente per rispondere a queste domande quotidiane possa fornire risposte più chiare e affidabili rispetto a un sistema di intelligenza artificiale generale, ChatGPT‑4. Il lavoro offre uno scorcio di come strumenti di IA accuratamente personalizzati possano supportare sia i pazienti sia i clinici nella cura dentale moderna.

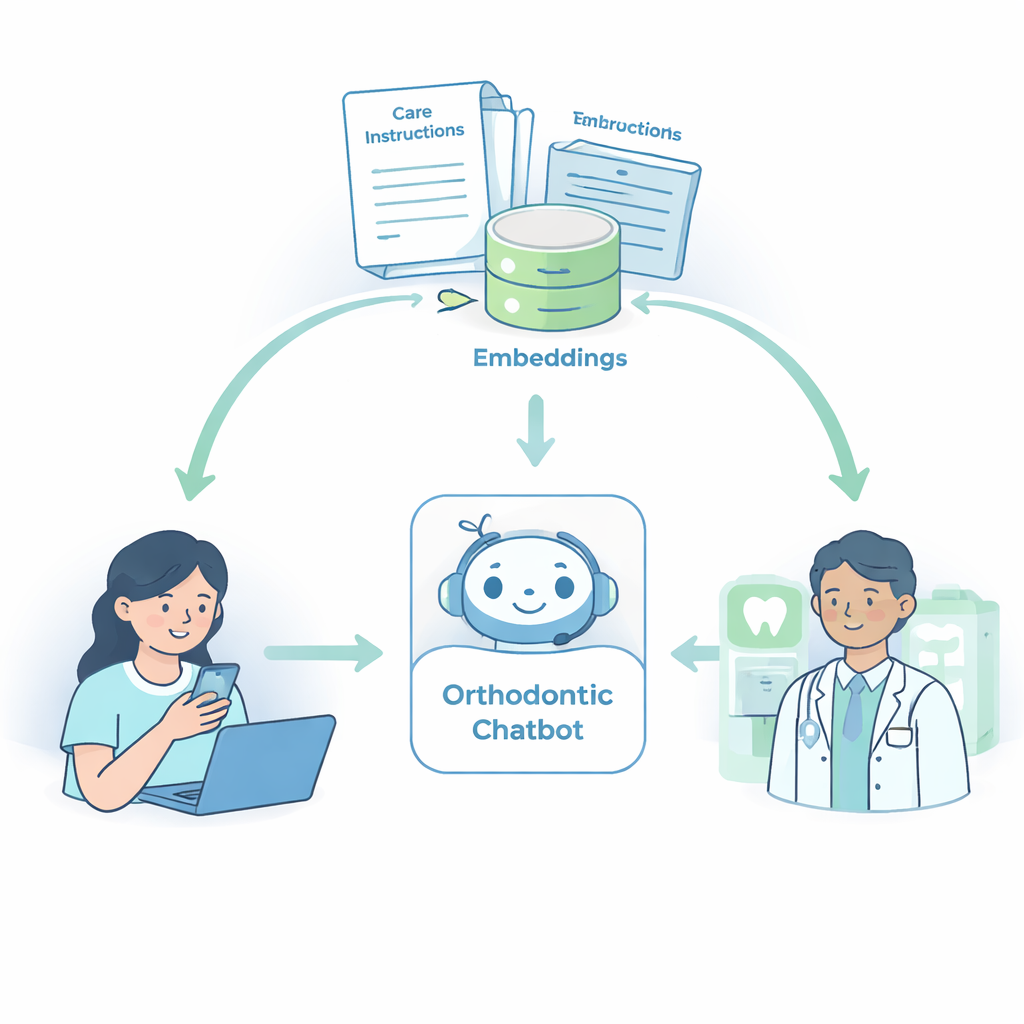

Un chatbot costruito appositamente per le domande sugli apparecchi

I ricercatori hanno creato un chatbot integrato focalizzato esclusivamente sul trattamento ortodontico. Invece di addestrare una nuova IA da zero, hanno collegato un avanzato modello linguistico a una biblioteca curata di materiali per i pazienti ed estratti chiave di manuali. Questa biblioteca includeva opuscoli della British Orthodontic Society su temi come igiene orale, dieta, cura degli apparecchi, elastici e contenzione, insieme a brevi spiegazioni tratte da testi ortodontici standard. Usando una tecnica chiamata retrieval‑augmented generation, il sistema cercava nella biblioteca i passaggi rilevanti ogni volta che veniva posta una domanda e li utilizzava per modellare la risposta, con l’obiettivo di rispecchiare ciò che un paziente sentirebbe durante una tipica conversazione al chairside.

Come lo studio ha testato i due sistemi

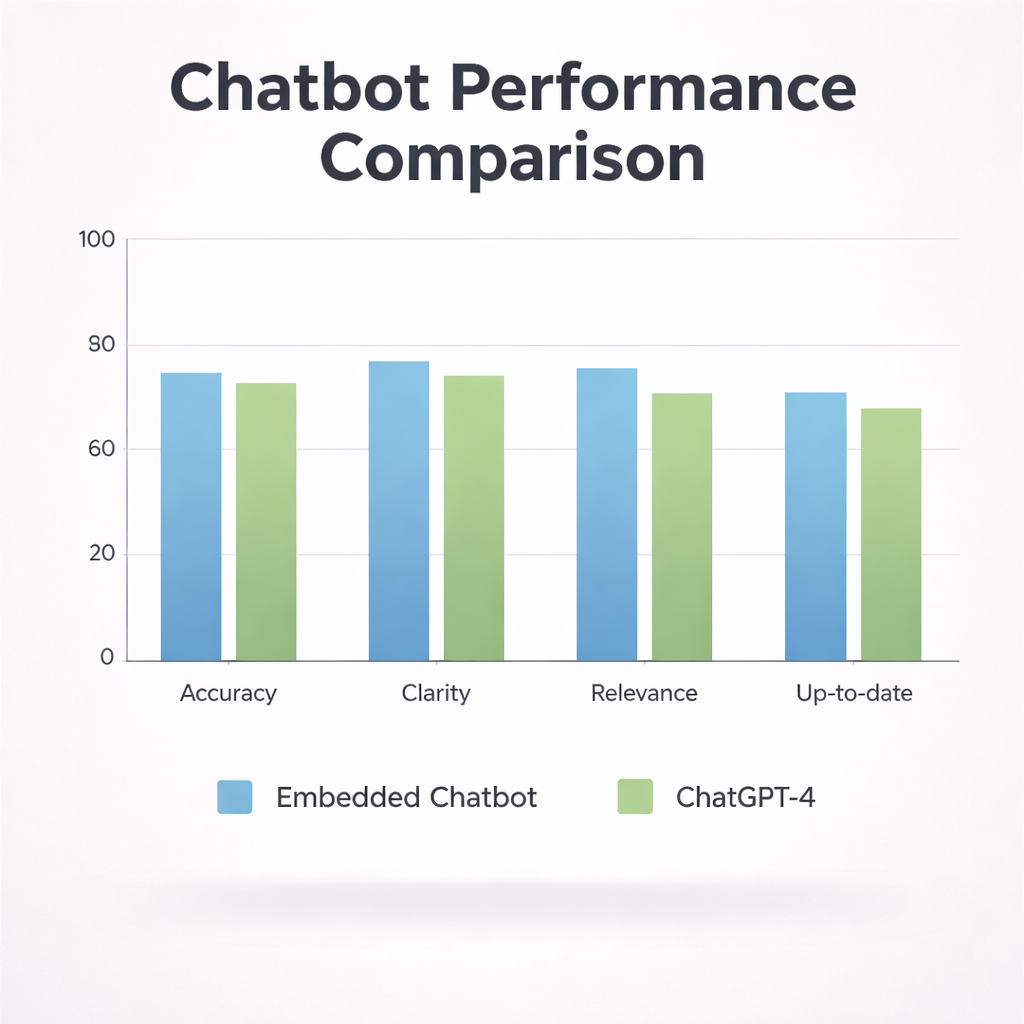

Per valutare le prestazioni di questo chatbot specializzato, il team lo ha confrontato con ChatGPT‑4, utilizzato in modo standard tramite l’interfaccia ChatGPT Plus. Hanno raccolto 30 domande del mondo reale che i pazienti pongono comunemente prima, durante e dopo il trattamento con apparecchio — per esempio, se l’apparecchio causa dolore, come influisce sul parlare o sul cantare, con quale frequenza occorrono i controlli e se l’apparecchio può aiutare problemi dell’articolazione mandibolare. Entrambi i sistemi hanno ricevuto gli stessi prompt, istruiti a rispondere come esperti di ortodonzia usando un linguaggio chiaro e adatto ai pazienti. Sei consulenti ortodontici esperti hanno poi valutato ciascuna risposta anonimizzata su quattro aspetti: accuratezza, chiarezza, rilevanza rispetto alla domanda e quanto l’informazione sembrava aggiornata, usando una scala a cinque punti.

Misurare la qualità, non solo le impressioni

Piuttosto che affidarsi a impressioni generali, i ricercatori hanno usato un metodo di valutazione strutturato chiamato Content Validity Index. Per ogni domanda e per ciascun aspetto di qualità, hanno contato quanti esperti hanno valutato una risposta come “d’accordo” o “fortemente d’accordo” e hanno convertito questo dato in un punteggio compreso tra zero e uno. Punteggi elevati significavano che la maggioranza degli esperti riteneva la risposta accurata, chiara, pertinente o aggiornata. Hanno anche calcolato le medie su tutte le domande per vedere come si comportava ciascun sistema nel complesso. Sono stati applicati test statistici per verificare se eventuali differenze tra i due chatbot fossero sufficientemente grandi da essere considerate significative piuttosto che dovute al caso.

Cosa hanno pensato gli ortodontisti delle risposte

Il chatbot integrato è risultato generalmente in vantaggio. Circa tre quarti delle sue risposte hanno raggiunto una soglia di qualità accettabile, rispetto a poco più della metà delle risposte di ChatGPT‑4. In media, il chatbot specializzato ha ottenuto punteggi migliori in accuratezza, chiarezza e rilevanza, e sembrava anche leggermente più allineato alle linee guida attuali. Per esempio, nello spiegare il dolore durante il trattamento con l’apparecchio o se l’apparecchio influisce sul linguaggio, le sue risposte erano dirette, concrete e molto vicine ai consigli standard forniti ai pazienti. Al contrario, le risposte di ChatGPT‑4, pur spesso ragionevoli, tendevano a essere più generiche e talvolta più tecniche, il che può averne diminuito la chiarezza agli occhi degli esperti. Tuttavia, quando i ricercatori hanno eseguito test statistici formali, le differenze tra i due sistemi non sono risultate sufficientemente grandi da essere considerate statisticamente significative.

Limiti e lezioni per la futura IA in clinica

Lo studio ha anche mostrato che nemmeno gli esperti concordano sempre su quale sia la “migliore” risposta. L’accordo complessivo tra gli ortodontisti è stato più debole del previsto, soprattutto per aspetti soggettivi come chiarezza e rilevanza. I ricercatori hanno notato altri limiti: hanno studiato solo due configurazioni di IA, non hanno coinvolto direttamente i pazienti e hanno basato il chatbot specializzato su un insieme specifico di materiali scritti. Nonostante ciò, il loro lavoro si aggiunge a prove crescenti che i sistemi di IA possono rispondere ragionevolmente bene a molte domande dentali comuni e che l’aggiunta di materiale di riferimento mirato e aggiornato può migliorare le prestazioni.

Cosa significa per le persone con l’apparecchio

Per i pazienti, la conclusione è incoraggiante ma cauta. Un chatbot ben progettato e focalizzato sull’ortodonzia può fornire risposte chiare e affidabili a molte domande quotidiane e può ridurre l’ansia tra un appuntamento e l’altro. Allo stesso tempo, questo studio mostra che uno strumento del genere non sostituisce ancora il giudizio professionale né il consiglio in presenza. La vera promessa è nella combinazione di questi assistenti di IA su misura con la cura esperta, in modo che le persone con l’apparecchio possano ottenere informazioni tempestive e facili da capire pur facendo affidamento sul proprio ortodontista per le decisioni finali.

Citazione: Khalil, R., Amin, L., Sukhia, R.H. et al. A comparative analysis of embedded chatbot models and ChatGPT-4 for answering orthodontic treatment queries. Sci Rep 16, 7776 (2026). https://doi.org/10.1038/s41598-026-39263-3

Parole chiave: chatbot ortodontico, IA dentale, domande sugli apparecchi, educazione del paziente, confronto con ChatGPT