Clear Sky Science · it

I modelli linguistici multimodali sfidano l’Image Challenge del NEJM

Perché questo conta per pazienti e medici

Ottenere la diagnosi giusta al momento giusto può fare la differenza tra un trattamento rapido e anni di sofferenza. Tuttavia i medici, anche quelli altamente specializzati, possono ancora mancare o ritardare diagnosi, soprattutto per malattie rare o inconsuete. Questo studio pone una domanda sorprendente: quando immagini mediche e dettagli clinici vengono forniti ai sistemi di intelligenza artificiale più avanzati di oggi, possono realmente diagnosticare casi complessi meglio di un ampio gruppo di medici reali — e, in tal caso, cosa significa questo per la medicina del futuro?

Un enorme rompicapo costruito su casi reali

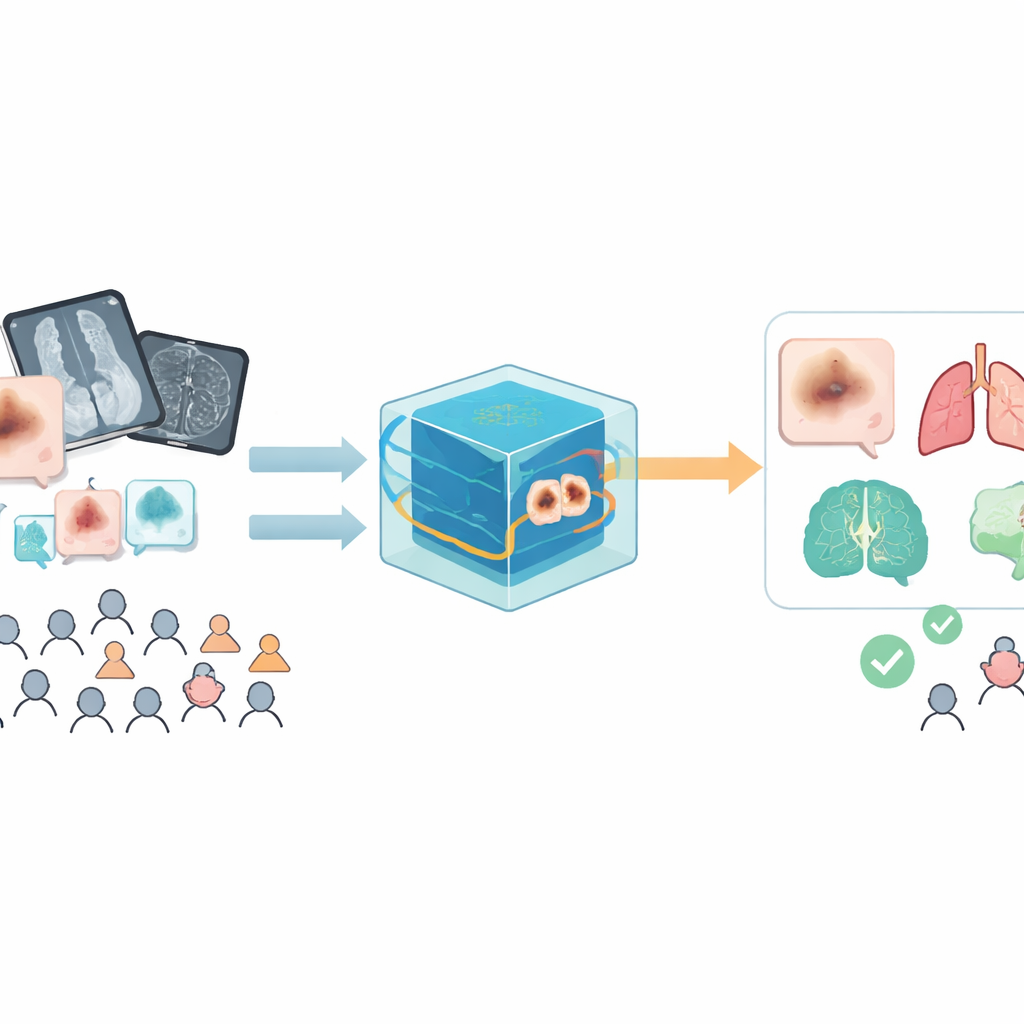

I ricercatori si sono rivolti a una rubrica di lunga data del New England Journal of Medicine chiamata "Image Challenge". Ogni challenge presenta l’immagine medica di un paziente reale — come una foto cutanea, una radiografia, una risonanza magnetica o un vetrino istologico — insieme a una breve storia clinica e a cinque possibili diagnosi. Dal 2009 sono state raccolte oltre 16 milioni di risposte da più di 60.000 medici per caso, creando un archivio globale unico su come i medici rispondono alle stesse domande difficili. Dall’archivio il team ha selezionato 272 casi che coprono tutte le età, entrambi i sessi e un’ampia gamma di condizioni, da infezioni e disturbi immunitari a tumori, malattie genetiche e traumi.

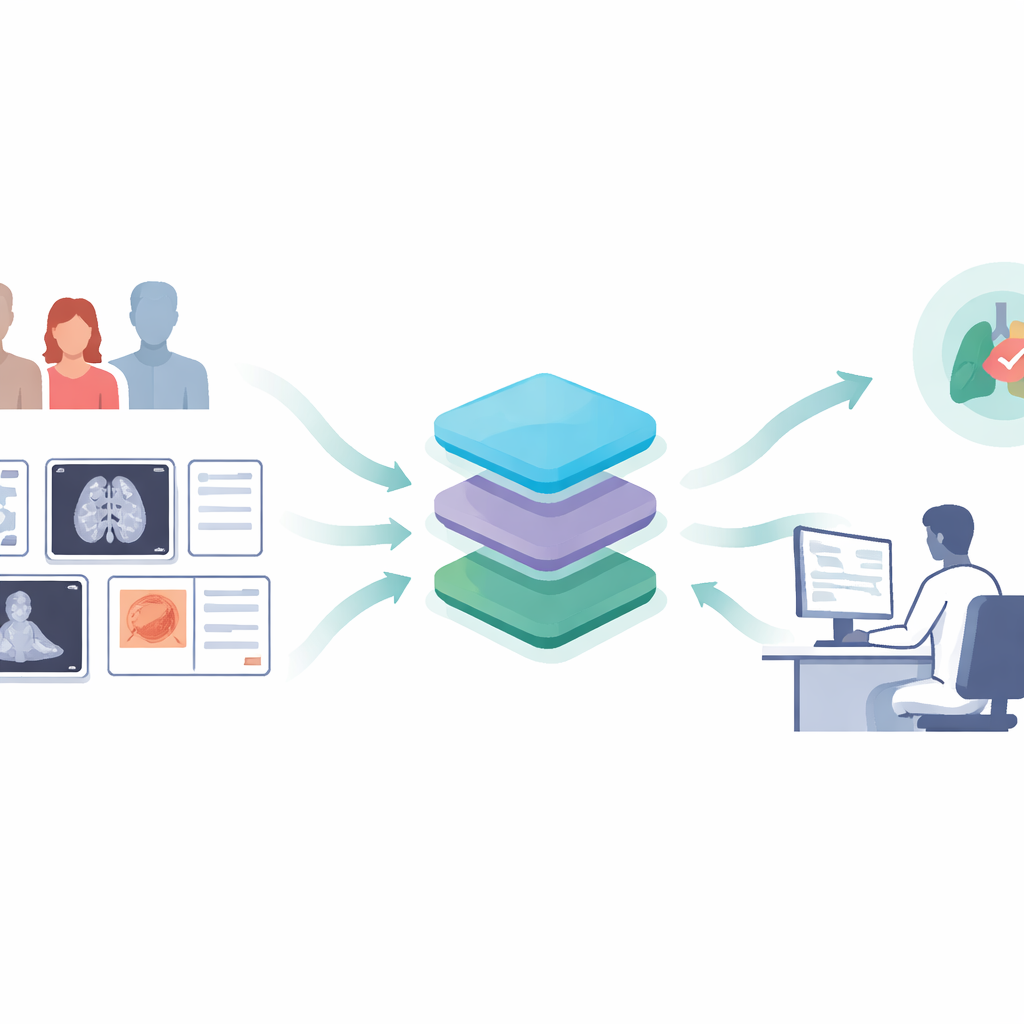

Mettere AI e medici sullo stesso piano

Lo studio ha testato tre modelli linguistici multimodali di punta — sistemi in grado di analizzare immagini e testo insieme: GPT‑4o, Claude 3.7 e Doubao. Per ogni caso i modelli hanno prima visto solo l’immagine e dovevano scegliere una delle cinque opzioni con una spiegazione. Poi hanno visto immagine e descrizione clinica e hanno risposto di nuovo. Per mantenere il test equo, i modelli sono stati utilizzati con impostazioni standard, disattivando ricerca web e funzionalità di ragionamento extra, e ogni caso è stato eseguito in una sessione nuova per evitare contaminazioni da risposte precedenti. Due medici hanno valutato le risposte dell’AI confrontandole con le soluzioni ufficiali del New England Journal, concentrandosi sul fatto che la scelta finale corrispondesse alla diagnosi vera, proprio come nel riferimento umano.

Performance sovrumane attraverso malattie e immagini

Quando hanno ricevuto sia immagini che testo, tutti e tre i sistemi AI hanno chiaramente superato il pool globale di medici. Claude 3.7 e GPT‑4o hanno ciascuno raggiunto circa l’89–90% di accuratezza, rispetto al 46,7% della maggioranza dei voti dei medici — un divario di oltre 40 punti percentuali. Anche nei casi più difficili, in cui meno del 40% dei medici era corretto, Claude 3.7 ha comunque indovinato l’86,5% delle diagnosi. Il vantaggio si è mantenuto attraverso la maggior parte dei tipi di malattia e dei formati di immagine: i modelli sono risultati particolarmente forti nelle condizioni correlate a farmaci e nelle malattie genetiche, e hanno gestito non solo foto e radiografie ma anche set endoscopici, patologici e misti. Le prestazioni sono state ugualmente solide per uomini e donne e, in alcuni dei gruppi più vulnerabili, come i lattanti sotto l’anno di età, i modelli sono risultati nettamente più accurati dei medici.

Menti diverse, non solo più veloci

Forse il risultato più sorprendente è stato quanto spesso i modelli avessero successo quando i medici non ci riuscivano. In quasi la metà dei casi, Claude 3.7 era corretto mentre la maggioranza dei medici sbagliava, mentre il contrario — medici corretti, modello sbagliato — era raro. Complessivamente, per Claude 3.7 c’erano circa quindici casi di "vantaggio del modello" per ogni caso di "vantaggio del medico." Tuttavia l’accordo tra umani e AI sulla risposta da scegliere era basso, segno che i sistemi non si limitano a riprodurre schemi umani ma arrivano a diagnosi corrette attraverso percorsi differenti. L’aggiunta del testo clinico in genere ha aiutato molto, aumentando l’accuratezza dell’AI di 28–42 punti percentuali rispetto alle sole immagini. Resta il fatto che in una minuscola frazione di casi i dettagli aggiuntivi hanno spinto i modelli da una risposta corretta basata sull’immagine a una sbagliata, suggerendo nuovi tipi di bias e modalità di fallimento che richiederanno studio attento.

Cosa potrebbe significare per le cure future

Gli autori concludono che i modelli linguistici multimodali hanno raggiunto un livello "sovrumano" in questo impegnativo quiz diagnostico: sono più accurati della media dei medici e mantengono il vantaggio anche quando i casi mettono in difficoltà la maggior parte dei clinici. Allo stesso tempo, la scarsa sovrapposizione con le scelte umane suggerisce che ragionano in modo complementare piuttosto che agire come copie digitali dei clinici. Usati con giudizio, questi sistemi potrebbero fungere da potenti second reader, offrendo opinioni indipendenti su casi difficili o rari e aiutando a intercettare problemi che i medici potrebbero non individuare. Non sono pronti a sostituire il giudizio clinico, ma potrebbero presto diventare partner preziosi al letto del paziente e in sala di refertazione, controllando discretamente il nostro lavoro e ampliando la rete di sicurezza per i pazienti.

Citazione: Sheng, C., Shen, S., Wang, L. et al. Multimodal large language models challenge NEJM image challenge. Sci Rep 16, 8132 (2026). https://doi.org/10.1038/s41598-026-39201-3

Parole chiave: diagnosi medica, intelligenza artificiale, imaging medico, malattie rare, supporto alle decisioni cliniche