Clear Sky Science · it

Un modello ibrido leggero CNN‑transformer per la classificazione delle malattie fogliari delle piante medicinali con AI spiegabile

Perché una cura delle piante più intelligente è importante

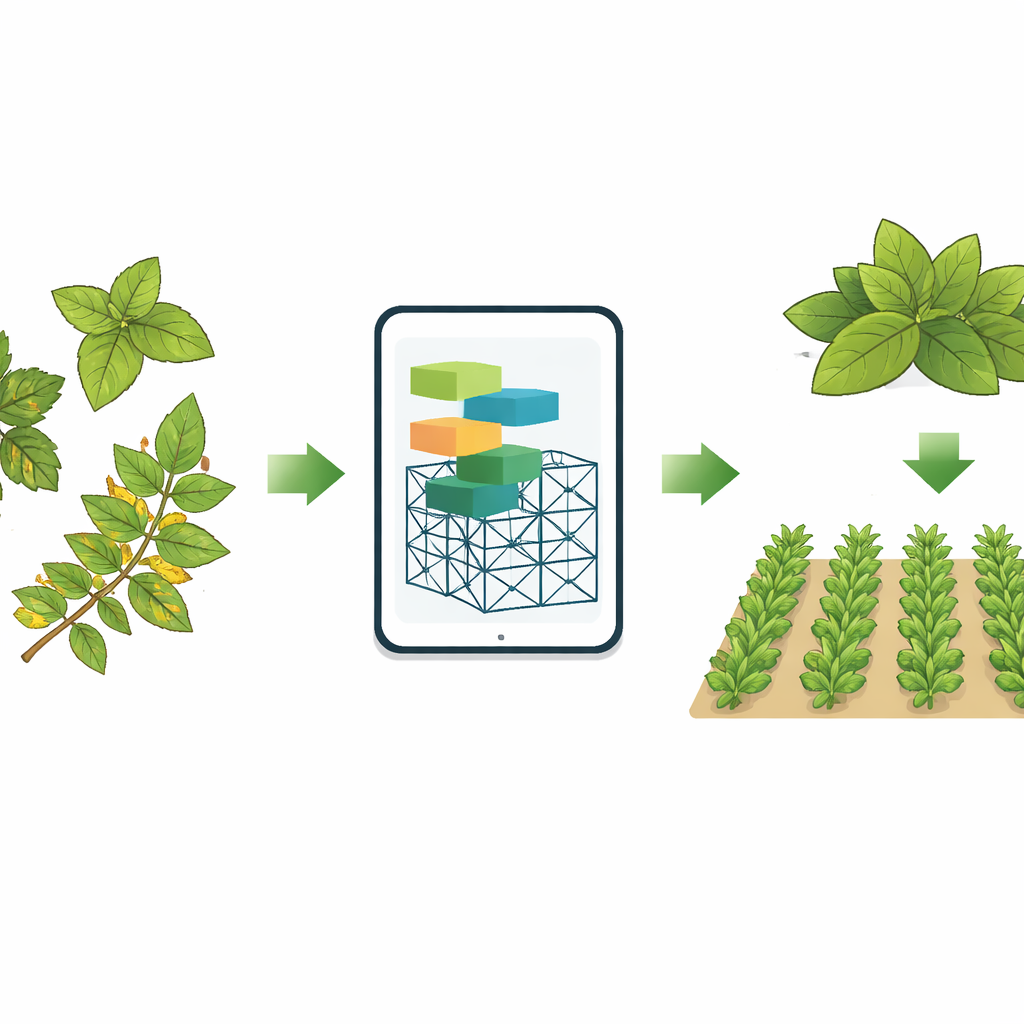

Molte delle erbe usate nei rimedi casalinghi e nei farmaci moderni — come tulsi (basilico sacro), neem e patharkuchi — dipendono da foglie sane per produrre i loro composti terapeutici. Quando le malattie attaccano queste foglie, le piante perdono sia resa sia potenza medicinale. L’articolo presenta un sistema di intelligenza artificiale (AI) compatto in grado di riconoscere diverse malattie fogliari a partire da foto con notevole precisione. Progettato per funzionare su dispositivi a basso costo e per mostrare chiaramente su cosa “si concentra”, questo approccio potrebbe aiutare agricoltori e giardinieri a proteggere in tempo reale le preziose piante medicinali.

Minacce nascoste su foglie familiari

Lo studio si concentra su tre piante medicinali di largo impiego: Kalanchoe pinnata (patharkuchi), Azadirachta indica (neem) e Ocimum tenuiflorum (tulsi). Queste piante offrono proprietà antibatteriche, antinfiammatorie e persino antitumorali, eppure le loro foglie sono vulnerabili a ragnatele fungine, ingiallimento da stress e varie malattie a macchie. La diagnosi tradizionale si basa sugli occhi esperti in campo o su test di laboratorio lenti e con molta strumentazione, entrambe modalità che rendono difficile individuare i problemi precocemente o su vaste aree. Poiché la salute delle piante influisce sia sulla salute pubblica sia sulle economie locali, c’è un forte bisogno di strumenti automatici, accurati e comprensibili che possano segnalare rapidamente le malattie utilizzando niente di più che immagini.

Costruire un occhio intelligente per foglie malate

Per affrontare questa sfida, gli autori hanno creato un nuovo modello chiamato LSeTNet, un ibrido leggero di due idee AI popolari per le immagini: reti convoluzionali, efficaci nel rilevare texture e bordi fini, e strati transformer, che eccellono nell’individuare schemi a lunga distanza nell’immagine. Il sistema ha prima imparato da un set di immagini accuratamente raccolto chiamato MedicinalLeaf‑12, contenente 12 classi che coprono versioni sane e malate delle tre piante. Le foto sono state scattate in condizioni di campo reali con illuminazione, angolazioni e sfondi variabili, quindi pulite e migliorate in modo che le macchie di malattia e le venature delle foglie emergessero più chiaramente. Il team ha anche usato un’ampia augmentazione delle immagini — rotazioni, zoom, variazioni di luminosità e altro — per imitare la caotica varietà presente nelle fattorie reali mantenendo il dataset bilanciato.

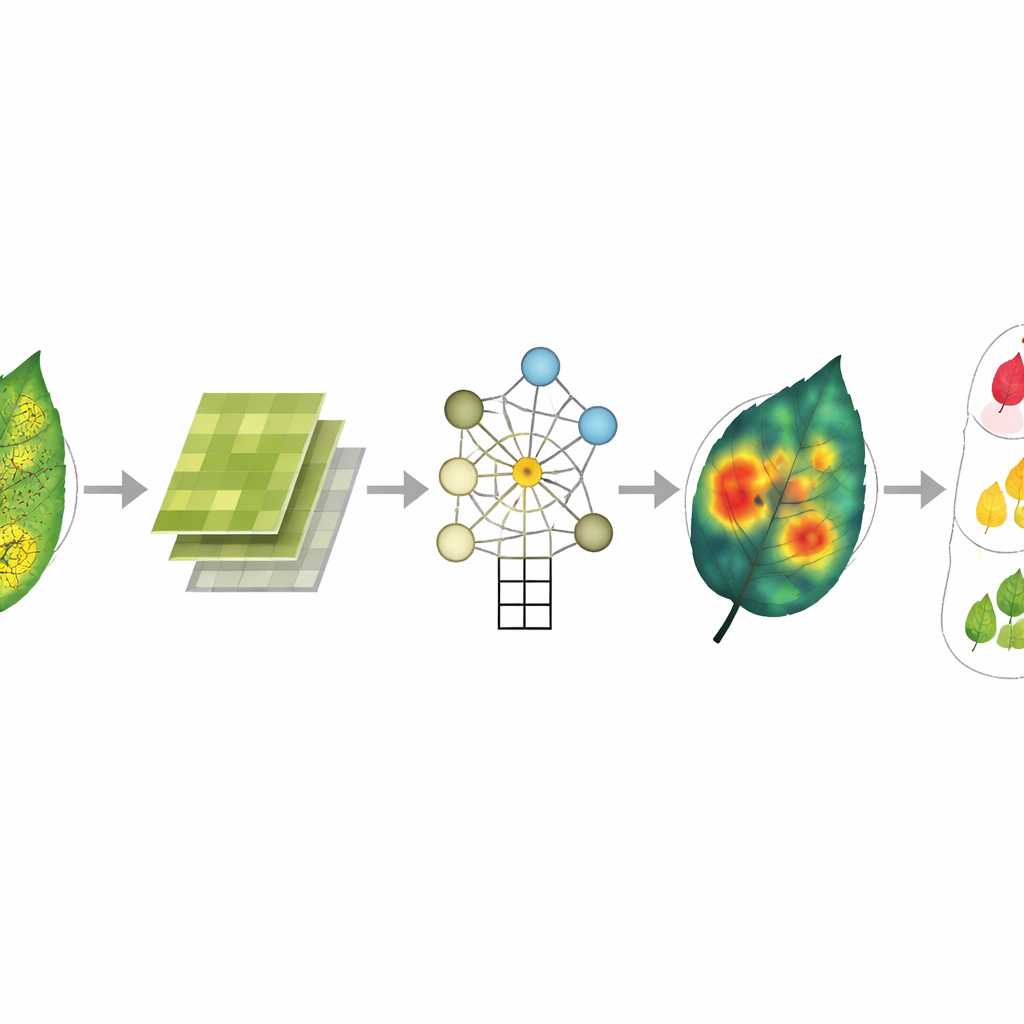

Come il modello interpreta le foglie

LSeTNet elabora ogni immagine di foglia per fasi. Strati convoluzionali leggeri rilevano indizi locali come piccole macchie, ragnatele e la nitidezza dei bordi fogliari. Speciali moduli di “squeeze‑and‑excitation” riallocano quindi il peso di questi segnali, amplificando silenziosamente i canali che contengono informazioni correlate alla malattia e attenuando quelli dominati dallo sfondo. Un blocco transformer segue, collegando regioni distanti della foglia in modo che il modello possa, per esempio, mettere in relazione macchie gialle sparse o pattern che seguono le venature. Infine, un classificatore compatto decide quale delle 12 condizioni corrisponde meglio a ciascuna immagine. Pur utilizzando solo circa 9,4 milioni di parametri e risorse di calcolo modeste, il modello mantiene alta velocità e basso utilizzo di memoria, rendendolo adatto a telefoni, tablet o piccoli computer single‑board.

Guardare dentro la scatola nera

Poiché agricoltori e agronomi devono poter confidare in una diagnosi automatica, gli autori hanno integrato l’esplicabilità nel sistema. Hanno utilizzato strumenti come Grad‑CAM e LIME per creare mappe di calore che mostrano dove il modello “presta attenzione” su ciascuna foglia, e diagrammi t‑SNE per visualizzare come diverse malattie si raggruppano nello spazio delle caratteristiche interne del modello. Queste spiegazioni rivelano che l’AI si concentra coerentemente su lesioni, tessuto scolorito e ragnatele fungine piuttosto che su sfondo neutro o piccioli. Anche nelle rare errate classificazioni — solo cinque errori su 1.800 immagini di test — le regioni evidenziate restano su aree biologicamente rilevanti; la confusione nasce principalmente quando due malattie sembrano molto simili anche all’occhio umano.

Cosa significano i risultati per gli agricoltori

Sul dataset principale, LSeTNet ha classificato correttamente le immagini di foglie con una accuratezza di circa il 99,7% e ha raggiunto prestazioni altrettanto elevate quando è stato testato su un dataset esterno separato di piante medicinali del Bangladesh che non aveva visto prima. Allo stesso tempo, gira rapidamente (intorno a sette millesimi di secondo per immagine su GPU) e occupa un’impronta di memoria ridotta, aprendo la strada ad app economiche e pronte per il campo. In termini pratici, questo lavoro dimostra che un’AI compatta e trasparente può rilevare in modo affidabile i segni precoci di malattia in piante medicinali importanti e mostrare chiaramente agli utenti perché è arrivata a una determinata decisione. Con ulteriori test su più specie e condizioni di campo più difficili, sistemi simili potrebbero aiutare a salvaguardare le filiere dei medicamenti a base di erbe, supportare l’agricoltura di precisione e fornire ai piccoli agricoltori un “secondo parere” accessibile nel loro tascabile.

Citazione: Ahmmed, J., Kabir, M.A., Rehman, A.u. et al. A lightweight hybrid CNN and transformer model for medicinal leaf disease classification with explainable AI. Sci Rep 16, 8243 (2026). https://doi.org/10.1038/s41598-026-39182-3

Parole chiave: piante medicinali, rilevamento delle malattie fogliari, deep learning, AI spiegabile, agricoltura di precisione