Clear Sky Science · it

RFGLNet per la segmentazione semantica domain-generalizzata in condizioni meteorologiche avverse con potenziamento a rango basso in frequenza

Vedere la strada quando il tempo peggiora

Auto autonome e robot per le consegne promettono strade più sicure ed efficienti—ma solo se sono in grado di “vedere” con affidabilità l’ambiente circostante. Pioggia, nebbia, neve e notti buie rendono questa visione estremamente difficile, smorzando i contrasti, aggiungendo puntini di rumore e sfumando i contorni di persone, auto e cordoli. Questo articolo introduce RFGLNet, un nuovo sistema di visione artificiale progettato per mantenere nitida la comprensione della strada da parte delle macchine anche nelle peggiori condizioni meteorologiche.

Perché il maltempo acceca le macchine

I sistemi di guida odierni spesso si basano su un processo chiamato segmentazione semantica, in cui un algoritmo assegna una classe—come strada, auto, pedone o edificio—a ogni pixel di un’immagine. Alla luce del giorno limpida, le reti neurali moderne svolgono questo compito in modo sorprendentemente accurato. Tuttavia, sotto pioggia intensa o fitta nebbia le immagini perdono luminosità, acquisiscono rumore e sviluppano contorni sfocati tra gli oggetti. Raccogliere e annotare enormi dataset per ogni condizione meteorologica avversa è proibitivamente costoso, quindi la maggior parte dei sistemi viene addestrata principalmente su immagini normali e soleggiate. Quando si trovano di fronte a tempeste o nevicate non viste in addestramento, le prestazioni calano drasticamente. Soluzioni precedenti cercavano di ripulire prima le immagini e poi segmentarle, oppure adattavano i modelli a condizioni target specifiche. Entrambi gli approcci tendono a essere fragili, lenti o troppo dipendenti da dati etichettati in condizioni avverse.

Una nuova rete costruita per condizioni difficili

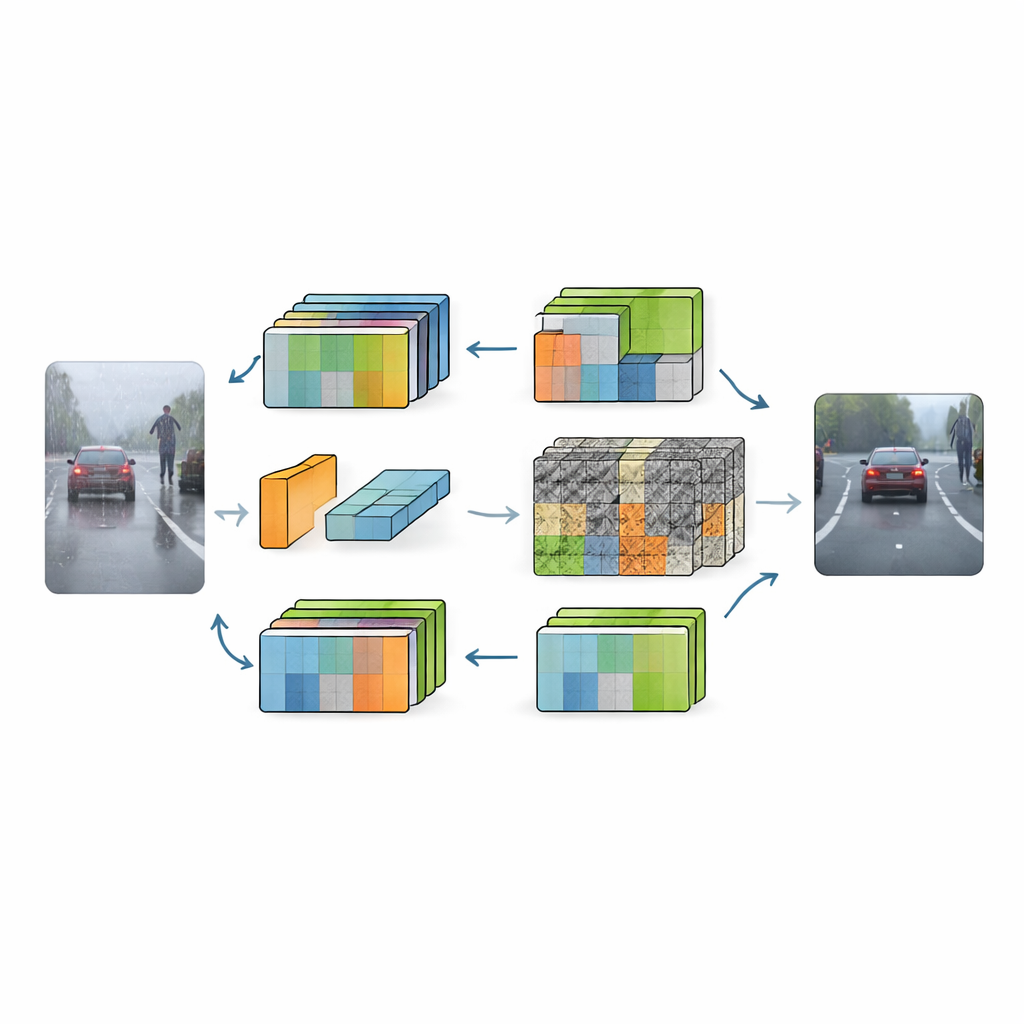

RFGLNet affronta il problema con una strategia diversa: apprende solo da scene cittadine standard diurne, pur riuscendo a generalizzare a un’ampia gamma di condizioni avverse. Gli autori partono da DINOv2, un grande modello visivo pre-addestrato noto per catturare una ricca struttura della scena. Invece di riaddestrare questo backbone pesante da zero, congelano i suoi parametri e aggiungono un set leggero di moduli sopra di esso. Questi moduli funzionano come adattatori intelligenti, rimodellando le rappresentazioni interne del backbone in modo che siano meno confuse dall’ingombro visivo causato da fiocchi di neve, gocce di pioggia o oscurità. Il risultato è un sistema che usa solamente 4,32 milioni di parametri addestrabili—minimo rispetto ai modelli di visione tipici—pur imparando a gestire meteo che non ha mai visto durante l’addestramento.

Come la rete impara a filtrare il maltempo

La prima innovazione di RFGLNet è un modulo a rango basso che si inserisce in ogni livello del backbone congelato. Prima dell’addestramento, questo modulo esegue una procedura matematica nota come decomposizione ai valori singolari su una matrice di feature simulata. Questo gli fornisce un set di componenti compatti che corrispondono grossolanamente alla struttura delle feature interne di DINOv2 fin dall’inizio, invece di partire da rumore casuale. Durante l’addestramento, questi componenti vengono aggiustati, permettendo al modulo di correggere delicatamente le feature del backbone per il nuovo compito senza disturbare la sua conoscenza di base. La rete applica poi un blocco di attention basato sulla trasformata di Fourier che sposta le feature nel dominio delle frequenze. Lì, le strutture ampie e a variazione lenta tendono a rappresentare oggetti significativi, mentre i pattern netti ed erratici spesso corrispondono al rumore meteorologico. Sopprimendo il disturbo ad alta frequenza e amplificando le componenti più morbide, il sistema rafforza la comprensione globale della scena attenuando le interferenze.

Affilare i dettagli senza farsi distrarre

Anche con feature globali più pulite, i piccoli dettagli come le linee della carreggiata, le sbarre di una recinzione e il profilo di un pedone lontano restano vulnerabili alla sfocatura in condizioni avverse. Per affrontare questo problema, gli autori introducono un modulo di attention spaziale raggruppata nella parte decoder della rete. Invece di trattare tutti i canali di feature insieme, li divide in gruppi e apprende mappe di pesi spaziali separate per ciascun gruppo. I canali che portano strutture importanti, come i bordi, possono così essere enfatizzati, mentre i canali dominati dal rumore vengono attenuati. Queste mappe specifiche per gruppo vengono fuse in un peso spaziale globale che migliora i dettagli fini e affila i confini degli oggetti su più risoluzioni. In pratica, RFGLNet impara dove guardare da vicino e dove ignorare puntini di nebbia o gocce di pioggia che distraggono.

Risultati nel mondo reale su scene stradali impegnative

Per testare il loro approccio, i ricercatori hanno addestrato RFGLNet sul noto dataset Cityscapes di scene urbane diurne nitide, quindi lo hanno valutato sul dataset ACDC, incentrato su pioggia, neve, nebbia e guida notturna. Senza aver mai visto le etichette di ACDC durante l’addestramento, RFGLNet ha raggiunto una mIoU (media dell’intersezione su unione) del 78,3 percento—superando diversi metodi di generalizzazione del dominio e di adattamento all’avanguardia, molti dei quali sono più grandi e più esigenti computazionalmente. Si è dimostrato particolarmente efficace nel segmentare classi difficili come muri e recinzioni, i cui bordi si perdono facilmente con il maltempo. Allo stesso tempo, il modello ha funzionato in modo efficiente su una singola GPU consumer, elaborando dozzine di immagini al secondo, requisito chiave per i sistemi di guida in tempo reale.

Visione più chiara per un’autonomia più sicura

Per i non specialisti, la conclusione è che RFGLNet mostra come aggiornare backbone di visione esistenti per un’autonomia più sicura senza dover riaddestrare all’infinito su ogni possibile tempesta. Combinando un adattamento compatto a rango basso, il filtraggio del rumore basato sulla frequenza e l’attention spaziale raggruppata, il sistema impara a mantenere intatta la struttura essenziale della scena mentre spazza via l’ingombro dovuto al meteo. Man mano che questi metodi matureranno e verranno addestrati su raccolte più ampie di condizioni reali, potrebbero aiutare auto e robot a mantenere una consapevolezza situazionale affidabile quando il cielo si fa scuro e la strada davanti è tutt’altro che limpida.

Citazione: Ye, X., Shi, X. & Li, Y. RFGLNet for adverse weather domain-generalized semantic segmentation with frequency low-rank enhancement. Sci Rep 16, 8253 (2026). https://doi.org/10.1038/s41598-026-39052-y

Parole chiave: guida autonoma, percezione in condizioni meteorologiche avverse, segmentazione semantica, robustezza della visione artificiale, generalizzazione del dominio