Clear Sky Science · it

Effetti locali accumulati e reti neurali su grafi per la predizione di collegamenti

Perché capire i collegamenti nascosti è importante

Molti dei sistemi che plasmano la nostra vita—social media, collaborazioni scientifiche, reti cerebrali, persino il web stesso—possono essere descritti come reti di punti connessi. Una domanda chiave è quali nuovi collegamenti è probabile che si formino in futuro, per esempio chi collaborerà con chi o quale articolo citerà quale. Le moderne reti neurali su grafi sono strumenti potenti per questo tipo di “predizione di collegamenti”, ma sono anche scatole nere: funzionano bene, ma è difficile capire perché prendono una determinata decisione. Questo articolo affronta il problema adattando una tecnica generale di spiegazione in modo da poter vedere come la modifica di una singola proprietà di un nodo influisce sulle probabilità che i collegamenti verso di esso compaiano.

Da punteggi semplici a cervelli grafici opachi

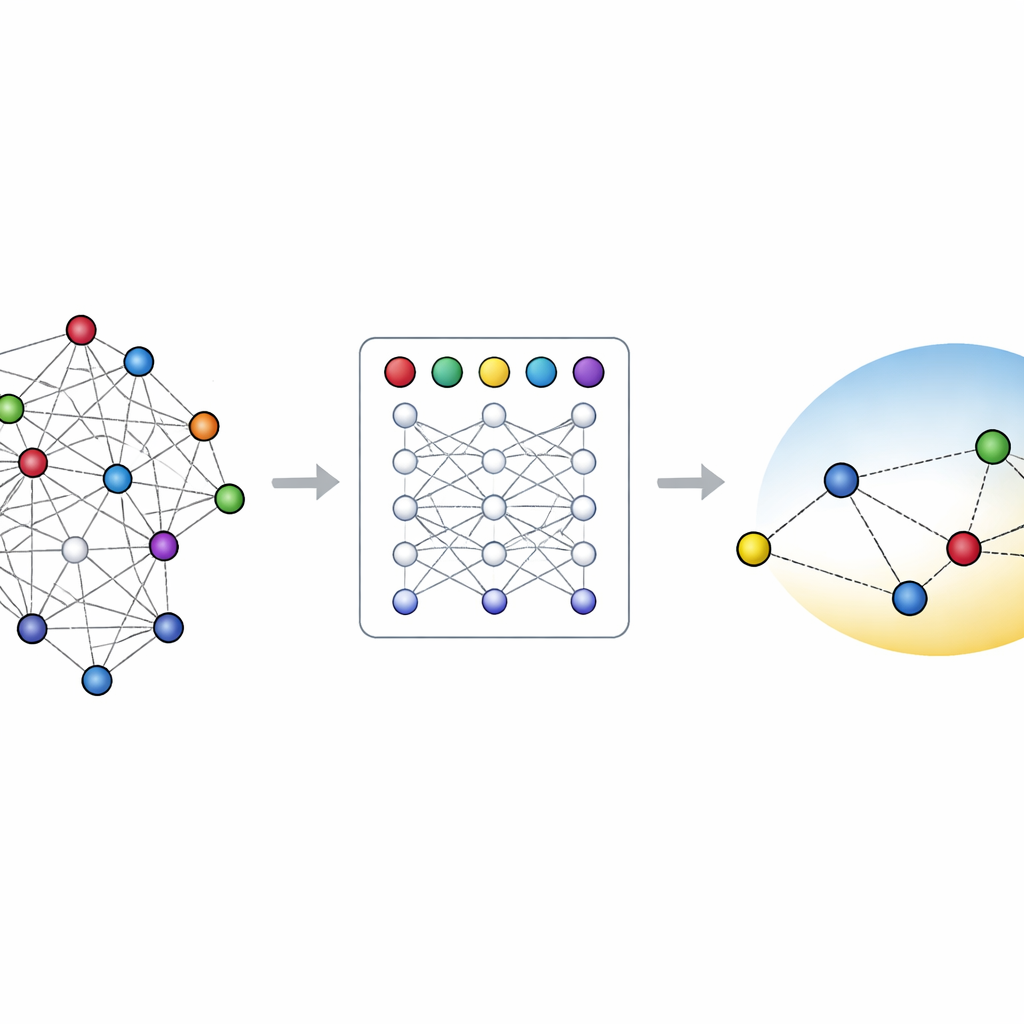

La scienza delle reti agli inizi si affidava a regole semplici per indovinare link mancanti o futuri. Per esempio, due persone con molti amici in comune hanno più probabilità di diventare amiche, e pagine web molto collegate tendono ad attrarre ancora più link. Nell’ultimo decennio, questi punteggi artigianali sono stati superati da metodi che apprendono descrizioni numeriche compatte, o embedding, di ogni nodo. Le reti neurali su grafi vanno oltre: trasmettono ripetutamente messaggi lungo i collegamenti in modo che l’embedding di ciascun nodo raccolga informazioni dai vicini e dai vicini dei vicini. Questo le rende eccellenti nella predizione di collegamenti ma implica anche che il loro funzionamento interno è intricato e difficile da interpretare.

Vedere come una singola caratteristica spinge le previsioni

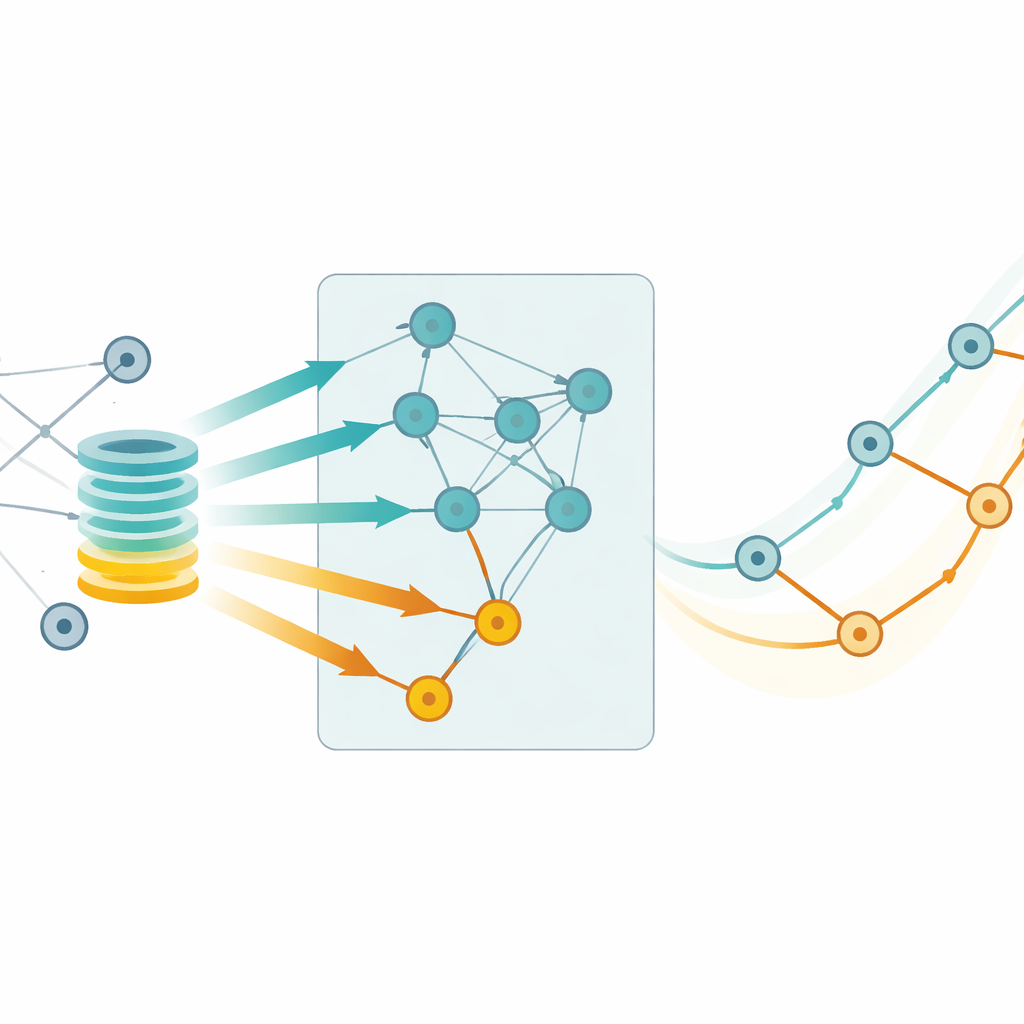

Al di fuori del mondo dei grafi, un modo popolare per interpretare modelli a scatola nera è chiamato Effetti Locali Accumulati (ALE). Invece di limitarsi a dire quali caratteristiche sono importanti, ALE chiede come la previsione del modello cambia quando si modifica una caratteristica verso l’alto o verso il basso lungo i suoi possibili valori, e poi accumula questi cambiamenti locali in una curva liscia. Gli autori adattano ALE alla predizione di collegamenti con reti neurali su grafi modificando la caratteristica di un nodo alla volta e verificando come la probabilità predetta di collegamenti tra quel nodo e molti altri risponde. Questo produce una visualizzazione che mostra, per esempio, come aumentare la quota di autori provenienti dalle “Big Tech” su un articolo o cambiare la posizione verticale di un segmento di vaso nel cervello sposti la probabilità stimata dal modello di una connessione.

Due modi per calcolare gli effetti: esatto e veloce

Le reti neurali su grafi aggiungono una complicazione ad ALE: quando si cambiano molti nodi contemporaneamente, questi possono influenzarsi a vicenda tramite il passaggio di messaggi, potenzialmente distorcendo la spiegazione. Gli autori confrontano quindi due strategie. Nella versione “esatta”, la caratteristica di ogni nodo è modificata in isolamento, così nessun nodo alterato può contaminare l’embedding di un altro—ma questo è computazionalmente costoso. Nella versione “approssimata”, molti nodi sono cambiati contemporaneamente, trattando i dati più come una tabella ordinaria e ignorando queste interazioni; ciò è molto più veloce ma può introdurre un bias. Variando sistematicamente quante unità vengono modificate e contro quanti potenziali partner vengono testate, gli autori misurano come queste scelte influenzano le curve ALE.

Test su grafi sintetici e dati reali

Per sondare la precisione, il team prima costruisce una rete sintetica dove la vera regola che governa la formazione dei collegamenti è nota: gli spigoli sono più probabili quando una particolare caratteristica “segnale” è alta per entrambi gli endpoint. Qui possono confrontare direttamente le curve ALE con la verità di base. Scoprono che, man mano che più nodi vengono modificati contemporaneamente, il metodo approssimato si allontana dalla relazione vera, mentre il metodo esatto rimane fedele. Su grandi dataset del mondo reale—una rete di citazioni di articoli sull’intelligenza artificiale e una mappa 3D dettagliata dei vasi sanguigni del cervello di topo—non è più possibile vedere la regola vera, quindi usano il metodo esatto, aggregato su molte esecuzioni, come spiegazione di riferimento e verificano quanto il metodo approssimato si discosti. Test statistici ed esperimenti di permutazione mostrano che, nella maggior parte delle combinazioni modello–dataset, le differenze tra i due metodi sono modeste, anche se le curve approssimate sono più variabili tra un’esecuzione e l’altra.

Cosa rivelano questi effetti sul mondo

Oltre alla metodologia, le curve ALE offrono scorci su ciò che i modelli hanno effettivamente appreso. Nella rete di citazioni, indicano che gli articoli con una frazione più alta di autori affiliati a grandi aziende tecnologiche hanno maggiori probabilità—secondo il modello—di ricevere citazioni, riecheggiando preoccupazioni sull’influenza crescente dell’industria nella ricerca sull’IA. Nel grafo dei vasi, due diverse architetture di reti neurali su grafi apprendono tendenze opposte su come l’altezza di un vaso nel cervello si relazioni alla sua connettività, sottolineando che ALE espone le credenze del modello, non necessariamente la verità biologica. Tali discrepanze possono segnalare punti in cui l’architettura del modello, i dati di addestramento o la valutazione potrebbero richiedere una revisione.

Spunti per lettori e praticanti

Lo studio mostra che gli Effetti Locali Accumulati possono essere rimodellati per spiegare le predizioni di collegamenti nelle reti neurali su grafi, offrendo curve intuitive che mostrano come la modifica di una caratteristica di un nodo spinga le probabilità di collegamento verso l’alto o verso il basso. Calcolare queste curve in modo esatto è più affidabile ma più lento, mentre un’approssimazione più rapida è spesso sufficiente se si può tollerare un po’ di rumore in più, soprattutto quando si fa la media su molte esecuzioni. Per chi già usa strumenti di spiegazione su modelli di machine learning standard, questo apporta un modo visivo familiare per sbirciare nei sistemi complessi basati su grafi e per mettere in discussione se ciò che il modello ha imparato corrisponde davvero alla nostra comprensione delle reti che ci interessano.

Citazione: Kaczyńska, P., Sienkiewicz, J. & Ślęzak, D. Accumulated local effects and graph neural networks for link prediction. Sci Rep 16, 8574 (2026). https://doi.org/10.1038/s41598-026-39000-w

Parole chiave: reti neurali su grafi, predizione di collegamenti, spiegabilità dei modelli, effetti locali accumulati, scienza delle reti