Clear Sky Science · it

Modelli linguistici di grandi dimensioni fine-tuned con prompt strutturati permettono la costruzione efficiente di grafi di conoscenza sul cancro polmonare

Perché trasformare il testo medico in mappe è importante

Il cancro polmonare è uno dei tumori più letali al mondo, e le informazioni su come diagnosticarlo e trattarlo sono disperse tra articoli di ricerca, note ospedaliere, consulti online e testi della medicina tradizionale. Medici e ricercatori faticano a stare al passo con questo flusso di testi. Questo studio esplora un nuovo modo per convertire automaticamente quella conoscenza frammentata in una singola "mappa" navigabile — un grafo di conoscenza sul cancro polmonare — usando un modello linguistico di grandi dimensioni fine-tuned e prompt attentamente strutturati. L’obiettivo è rendere la conoscenza medica complessa più facile da cercare per i computer e più utilizzabile dagli esperti in strumenti di supporto alle decisioni.

Dalle storie disperse ai fatti connessi

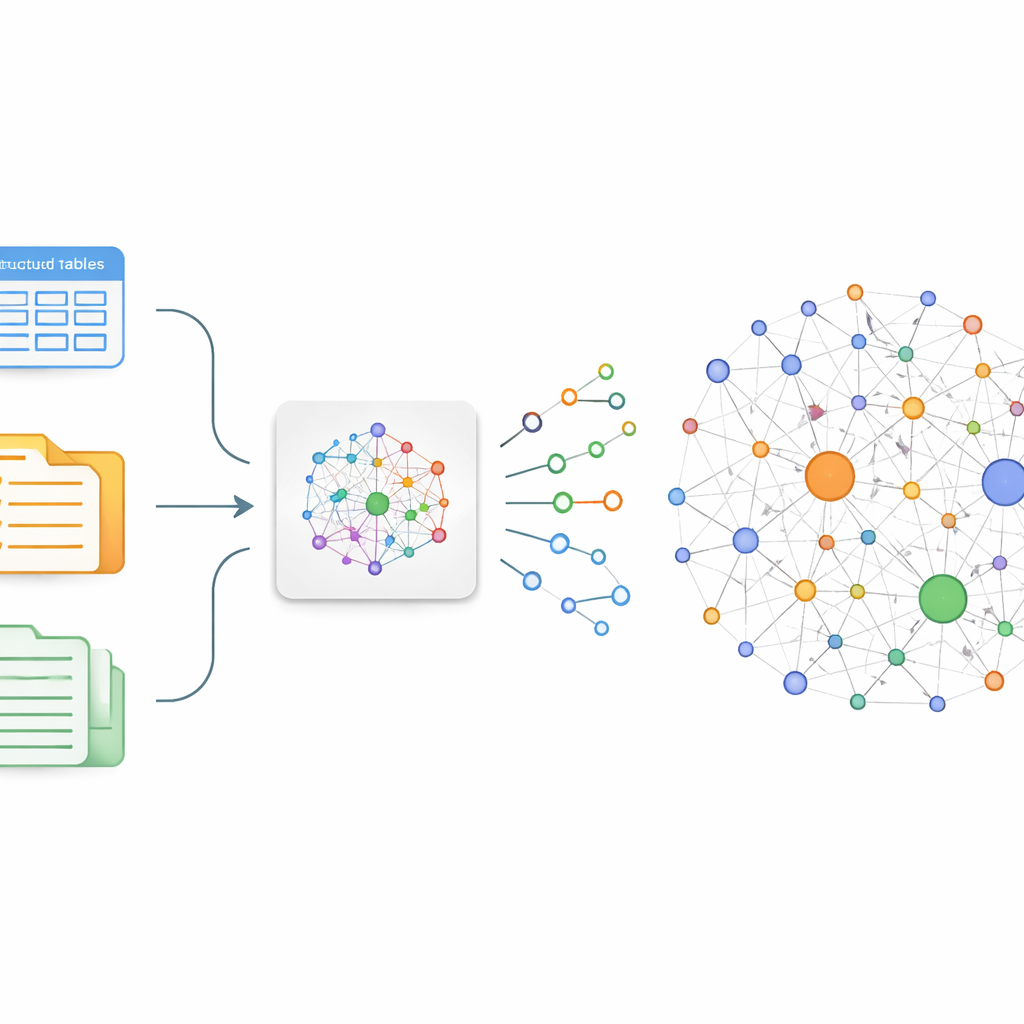

Gli autori si concentrano su un’idea semplice: se si riesce a estrarre in modo affidabile chi-fà-cosa-a-chi dal testo medico, si possono cucire quei fatti in un grafo. In pratica ciò significa convertire frasi in forma libera in piccoli mattoni chiamati triple — coppie di entità collegate da una relazione, per esempio “cancro polmonare – trattato con – chemioterapia.” I metodi tradizionali per costruire tali grafi richiedono eserciti di annotatori o regole fragili che non colgono le sfumature e le nuove scoperte. Per superare questo limite, il gruppo fine-tuna un modello linguistico cinese esistente, ChatGLM-6B, in modo che si specializzi nell’individuare triple mediche significative sul cancro polmonare in una vasta gamma di fonti, dalle chat paziente–medico online ai database strutturati e ai casi della medicina tradizionale cinese.

Insegnare a un’AI a ragionare per unità ordinate

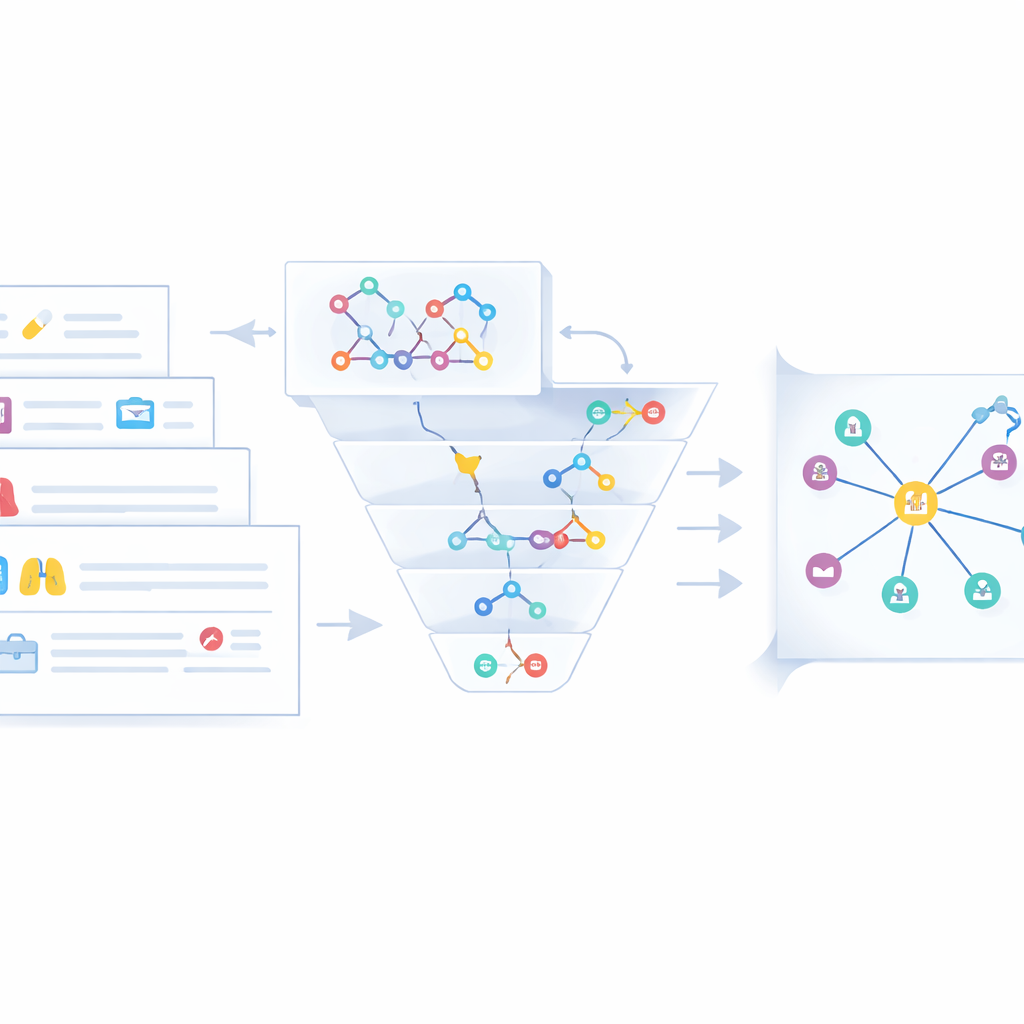

Chiedere semplicemente a un modello linguistico generico di “estrarre informazioni” spesso produce risposte disordinate e prolisse. I ricercatori pertanto progettano uno schema di prompt rigoroso e poi fine-tunano il modello su quasi 50.000 esempi di comportamento corretto. Ogni esempio mostra un’istruzione e l’esatto output in stile triple atteso. Il prompt dice al modello di comportarsi come un esperto professionista nell’estrazione di testo, di produrre solo triple strutturate in un formato leggibile dalla macchina e di “pensare passo dopo passo” quando le frasi contengono dettagli annidati — per esempio un trattamento, il farmaco usato e il dosaggio. Questa combinazione di definizione del ruolo, regole di formato e ragionamento passo-passo trasforma il modello — ora chiamato KGLM — da assistente conversazionale a estrattore disciplinato di fatti pronti per le macchine.

Fondere molte voci in un grafo chiaro

Le triple grezze estratte dal testo sono solo parte della storia. La stessa malattia o lo stesso farmaco spesso compaiono con nomi diversi — per esempio “malattia polmonare ostruttiva cronica” rispetto a “BPCO”. Per evitare disordine e confusione, gli autori progettano una fase di fusione che unisce entità equivalenti attraverso tre flussi di dati: testo web non strutturato, casi clinici semi-strutturati e grafi di conoscenza medica esistenti. Prima, un controllo veloce basato sulla similarità di stringa individua corrispondenze ovvie. Quando questo non è sufficiente, un modello di similarità semantica più profondo (Sentence-BERT) confronta i significati nel contesto. Le entità giudicate duplicati vengono raggruppate in un singolo nodo canonico, preferendo nomi più brevi e conservando le altre forme come alias. Esperti rivedono poi i casi limite e rimuovono affermazioni fuorvianti o di bassa qualità, producendo un grafo di conoscenza sul cancro polmonare più pulito e coerente memorizzato in un database Neo4j.

Quanto funziona questa mappa di conoscenza?

Per valutare le prestazioni, il team confronta KGLM con approcci deep learning standard basati su BERT e reti convoluzionali, oltre che con il modello ChatGLM originale non fine-tuned. Nel compito di estrazione di relazioni — decidere quali entità sono collegate e in che modo — il KGLM fine-tuned e guidato da prompt raggiunge un punteggio F1 di circa 0,82, superando tutti i baseline testati e migliorando di circa il 25 percento rispetto al modello di partenza. I test di ablazione mostrano che ogni componente del prompt è importante: rimuovere il ruolo di esperto, il formato rigido a triple o la guida “pensare passo dopo passo” degrada l’accuratezza, specialmente per frasi complesse con attributi annidati o terminologia della medicina tradizionale cinese. Un panel di esperti clinici e informatici giudica inoltre il grafo risultante più accurato, utilizzabile e rilevante clinicamente rispetto a grafi costruiti senza fine-tuning o prompt strutturati.

Cosa significa per i futuri strumenti medici

In termini semplici, lo studio mostra che con l’addestramento e le istruzioni adeguate, un modello linguistico di grandi dimensioni può convertire in modo efficiente testi reali e disordinati sul cancro polmonare in una rete strutturata e ricercabile di fatti. Questo grafo di conoscenza sul cancro polmonare, pur essendo ancora un prototipo di ricerca e limitato a fonti in lingua cinese e a un’unica area patologica, indica una direzione futura in cui “mappe di conoscenza” costantemente aggiornate potrebbero supportare sistemi di supporto alle decisioni, strumenti educativi e l’esplorazione della ricerca. Gli autori sottolineano che tali grafi devono essere convalidati con cura e aggiornati regolarmente, e non sono pronti a guidare le cure senza supervisione di esperti. Tuttavia, i loro risultati suggeriscono che modelli linguistici fine-tuned insieme a prompt intelligenti possono rendere il compito arduo di organizzare la conoscenza medica più scalabile e tempestivo.

Citazione: Zhou, C., Gong, Q., Luan, H. et al. Fine-tuned large language models with structured prompts enable efficient construction of lung cancer knowledge graphs. Sci Rep 16, 9505 (2026). https://doi.org/10.1038/s41598-026-38959-w

Parole chiave: cancro polmonare, grafo di conoscenza, modello linguistico di grandi dimensioni, estrazione di relazioni, IA medica