Clear Sky Science · it

Ottimizzazione energetica basata su DQN per reti di comunicazione alimentate wireless

Alimentare dispositivi minuscoli attraverso l’aria

Dai lampioni intelligenti agli allarmi antincendio nascosti nelle foreste, innumerevoli piccoli dispositivi costituiscono oggi l’Internet delle cose. Tenere tutti questi dispositivi alimentati è un problema rilevante: le batterie si esauriscono e posare cavi elettrici ovunque è poco pratico. Questo articolo esplora un modo per inviare energia wireless a tali dispositivi e usare l’intelligenza artificiale per distribuire quell’energia in modo intelligente, in modo che i sensori critici rimangano attivi più a lungo e l’intera rete funzioni in modo più regolare.

Perché l’energia wireless richiede un controllo più intelligente

Le reti di comunicazione alimentate wireless trasmettono onde radio che i dispositivi possono convertire in elettricità, usandole al contempo per inviare dati. Nella maggior parte degli studi precedenti, questa conversione di energia è stata trattata come se si comportasse in modo semplice e lineare: più segnale significava sempre proporzionalmente più potenza. In realtà, i circuiti di energy harvesting iniziano a “appiattirsi” quando il segnale in ingresso è forte, sprecando parte dell’energia. Allo stesso tempo, gli ambienti reali sono irregolari: la luce solare per i pannelli fotovoltaici può variare, gli edifici bloccano i segnali e eventi improvvisi come incendi possono creare esigenze di dati urgenti in nodi specifici. Regole statiche che ignorano queste varianti possono lasciare alcuni sensori privi di energia e farne sprecare ad altri, riducendo la durata complessiva della rete.

Un cervello che impara per la rete energetica

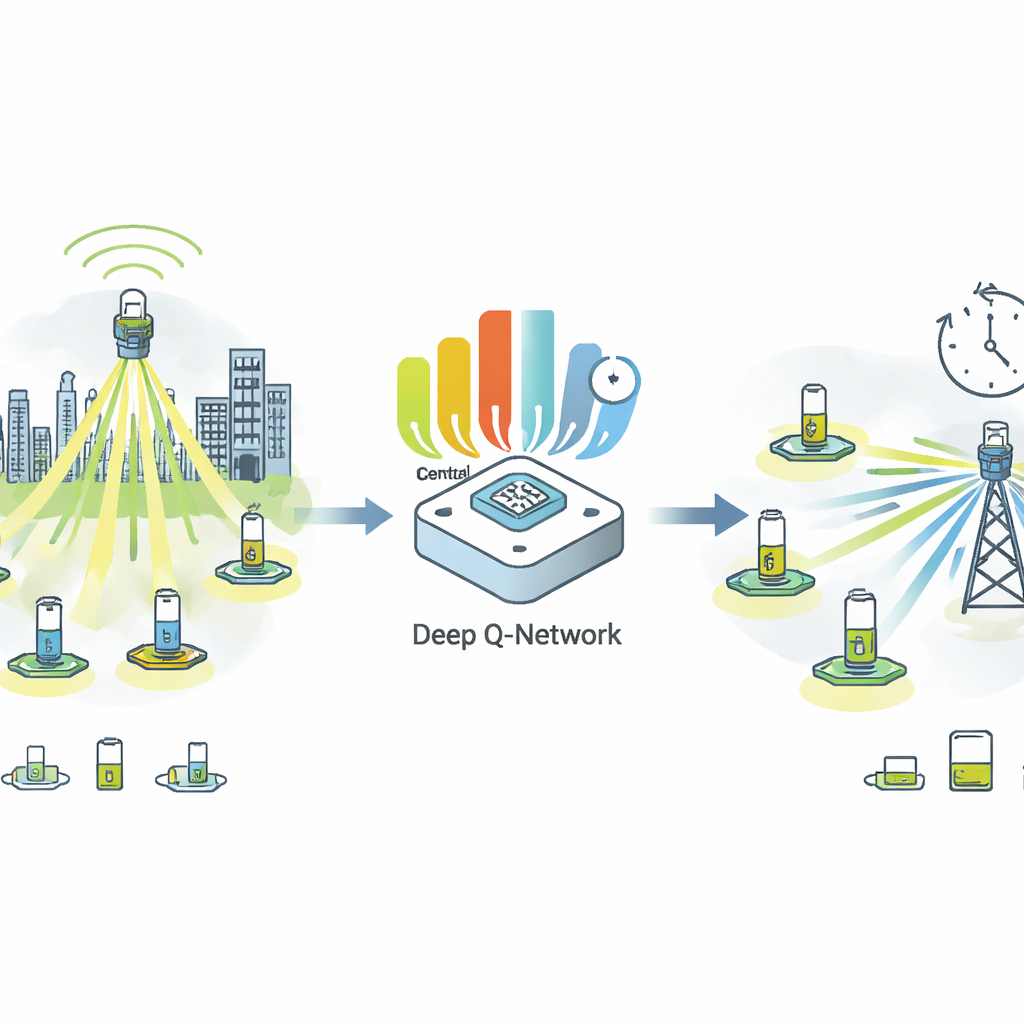

Per affrontare questo problema, gli autori progettano un controllore basato sull’apprendimento costruito su una tecnica chiamata Deep Q-Networks, una forma di apprendimento per rinforzo. Invece di affidarsi a formule matematiche fisse, questo controllore tratta la rete come un gioco giocato nel tempo. In ogni turno osserva l’energia residua in ogni nodo, la qualità dei collegamenti radio e quanto sono urgenti i vari compiti — per esempio il monitoraggio antincendio rispetto ai controlli di temperatura di routine. Sulla base di queste osservazioni decide quanta potenza inviare a ciascun nodo. Dopo ogni decisione riceve un feedback che mescola diversi obiettivi: inviare quanta più informazione utile possibile, ripartire equamente l’energia in modo che nessun dispositivo venga sistematicamente trascurato, ed evitare l’uso sprecone della sorgente di potenza condivisa. Nel corso di molti turni il controllore impara quali schemi di condivisione energetica portano alla migliore prestazione a lungo termine.

Prevedere e bilanciare obiettivi in concorrenza

Un ingrediente chiave del framework è la previsione. Il sistema utilizza un metodo statistico chiamato Gaussian Process Regression per prevedere quanta energia i nodi è probabile che raccolgano nel prossimo futuro, ad esempio al variare delle condizioni di illuminazione. Utilizza inoltre un modello flessibile di come i segnali radio si attenuano e riflettono in ambienti realistici analoghi a quelli urbani. Questi elementi alimentano un processo decisionale che si aggiorna ogni pochi secondi, permettendo al controllore di rispondere rapidamente quando le condizioni di rete cambiano. Il segnale di ricompensa che guida l’apprendimento fonde tre idee semplici: efficienza (quanti bit di informazione vengono consegnati per unità di energia), equità (quanto uniformemente l’energia è distribuita tra i nodi) e priorità (assicurare che i compiti ad alta urgenza ottengano ciò di cui hanno bisogno). Sintonando l’importanza relativa di questi tre ingredienti, gli operatori di rete possono scegliere tra massima durata, equità rigorosa o picchi di throughput dati.

Cosa rivelano le simulazioni

Poiché gli esperimenti nel mondo reale sono ancora in corso, gli autori valutano il loro metodo in simulazioni al computer dettagliate di una rete con 30 dispositivi alimentati wireless, ed esplorano anche scenari fino a 100 nodi. Rispetto a una semplice divisione fissa dell’energia e a un metodo di apprendimento più tradizionale, il nuovo controllore mantiene la rete operativa molto più a lungo — circa la metà in più di turni prima che i nodi si spengano. Mantiene inoltre la dispersione dei livelli energetici tra i dispositivi molto più contenuta, riducendo notevolmente i “punti morti” dove i nodi si guastano precocemente. La strategia appresa si adatta diverse volte più velocemente ai cambiamenti improvvisi, come un calo della qualità del segnale o un aumento dell’urgenza dei compiti, e mantiene un throughput di dati più elevato su un ampio intervallo di condizioni radio. È importante che gli autori considerino dettagli pratici, mostrando che una versione compatta del modello di apprendimento può girare su microcontrollori a basso costo usati in molti dispositivi IoT, con tempi di decisione dell’ordine delle decine di millisecondi.

Dalla simulazione alle reti di sensori reali

Lo studio conclude che abbinare l’energia wireless a un controllore basato sull’apprendimento può estendere in modo significativo la vita e l’affidabilità delle reti di sensori, specialmente quando le condizioni sono imprevedibili e i compiti hanno urgenze diverse. Riconoscendo che i circuiti di harvesting si saturano, che l’ambiente radio fluttua e che alcuni sensori contano più di altri in determinati momenti, l’approccio proposto impara a bilanciare meglio esigenze contrastanti rispetto a regole statiche. Gli autori sono chiari nel sottolineare che i risultati attuali provengono da simulazioni e che i guadagni esatti dovranno essere confermati su hardware reale. Tuttavia, il loro lavoro indica un futuro in cui vaste reti di piccoli dispositivi possono funzionare per lunghi periodi con minima attenzione umana, assaporando in modo intelligente l’energia dall’aria e mantenendo il flusso di dati vitali.

Citazione: Chen, H., Wang, X., Yuan, L. et al. DQN-empowered energy optimization for wireless powered communication networks. Sci Rep 16, 7987 (2026). https://doi.org/10.1038/s41598-026-38904-x

Parole chiave: energia wireless, Internet delle cose, raccoglimento di energia, apprendimento per rinforzo, reti di sensori