Clear Sky Science · it

VolE: Un framework a nuvola di punti per la ricostruzione 3D degli alimenti e la stima del volume

Perché misurare la tua cena è importante

Contare le calorie a partire da una foto sembra magia, ma per medici e dietisti potrebbe essere uno strumento potente. Conoscere con precisione quanto cibo le persone consumano è fondamentale per gestire condizioni come il diabete e l’obesità, eppure pesare ogni pasto su una bilancia da cucina è irrealistico nella vita di tutti i giorni. Questo articolo presenta VolE, un nuovo metodo che consente a un comune smartphone moderno di costruire un modello tridimensionale dettagliato di un singolo alimento e stimarne il volume con sorprendente accuratezza—senza hardware speciale, scheda di riferimento o sensore di profondità.

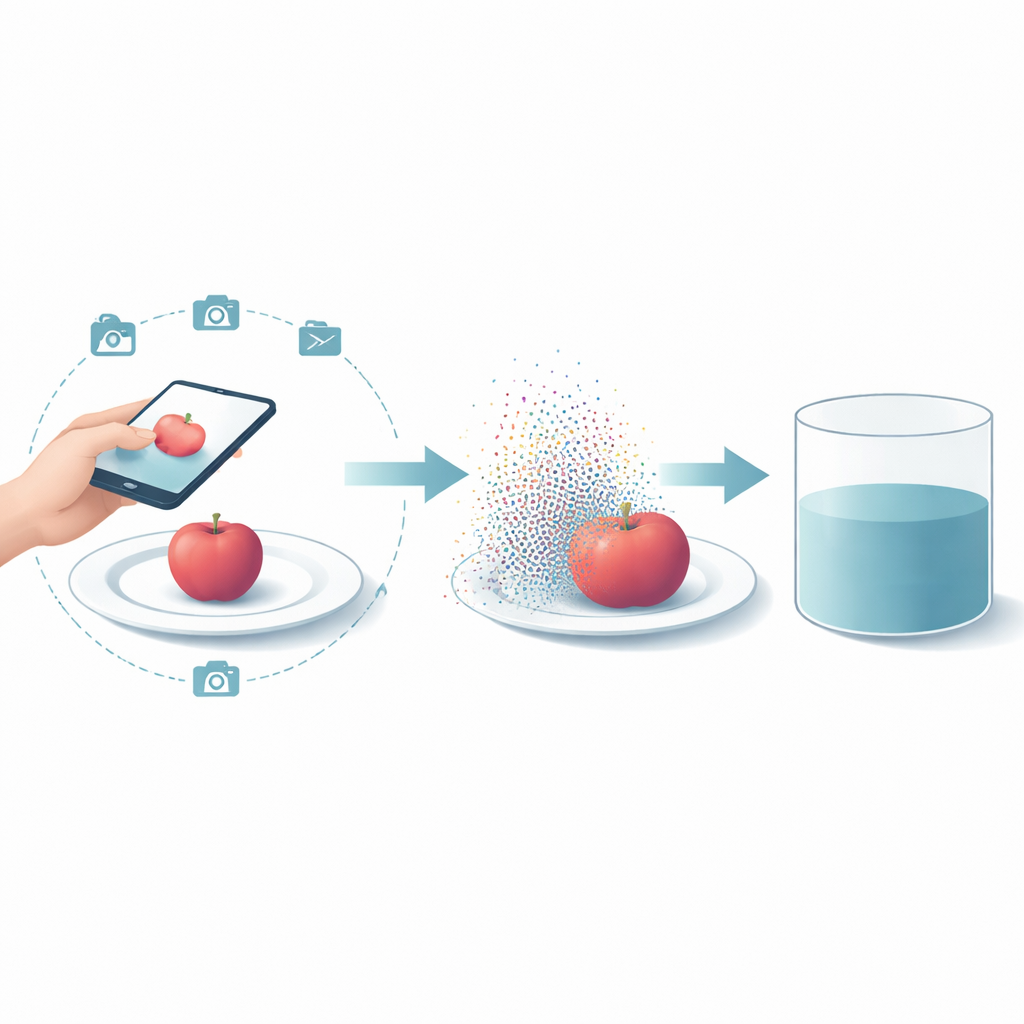

Da semplici foto a forme solide

L’idea di base di VolE è trasformare un breve video informale del tuo pasto in una forma 3D precisa che può essere misurata. Mentre l’utente muove lentamente il telefono intorno al piatto, le funzioni di realtà aumentata integrate nel dispositivo (ARCore su Android o ARKit su iOS) registrano sia le immagini sia la posizione e l’orientamento esatti della fotocamera nello spazio reale. VolE combina questi flussi di immagini e traiettorie della fotocamera per ricostruire una densa “nuvola di punti” del cibo—migliaia di puntini che fluttuano nello spazio tracciando la superficie dell’oggetto. Poiché il sistema AR del telefono già conosce le distanze reali, questo oggetto virtuale viene creato alla scala fisica corretta, risolvendo un problema di lunga data nella ricerca visiva, dove la forma 3D può essere ricavata ma non la sua dimensione reale.

Trovare il cibo e ripulire la scena

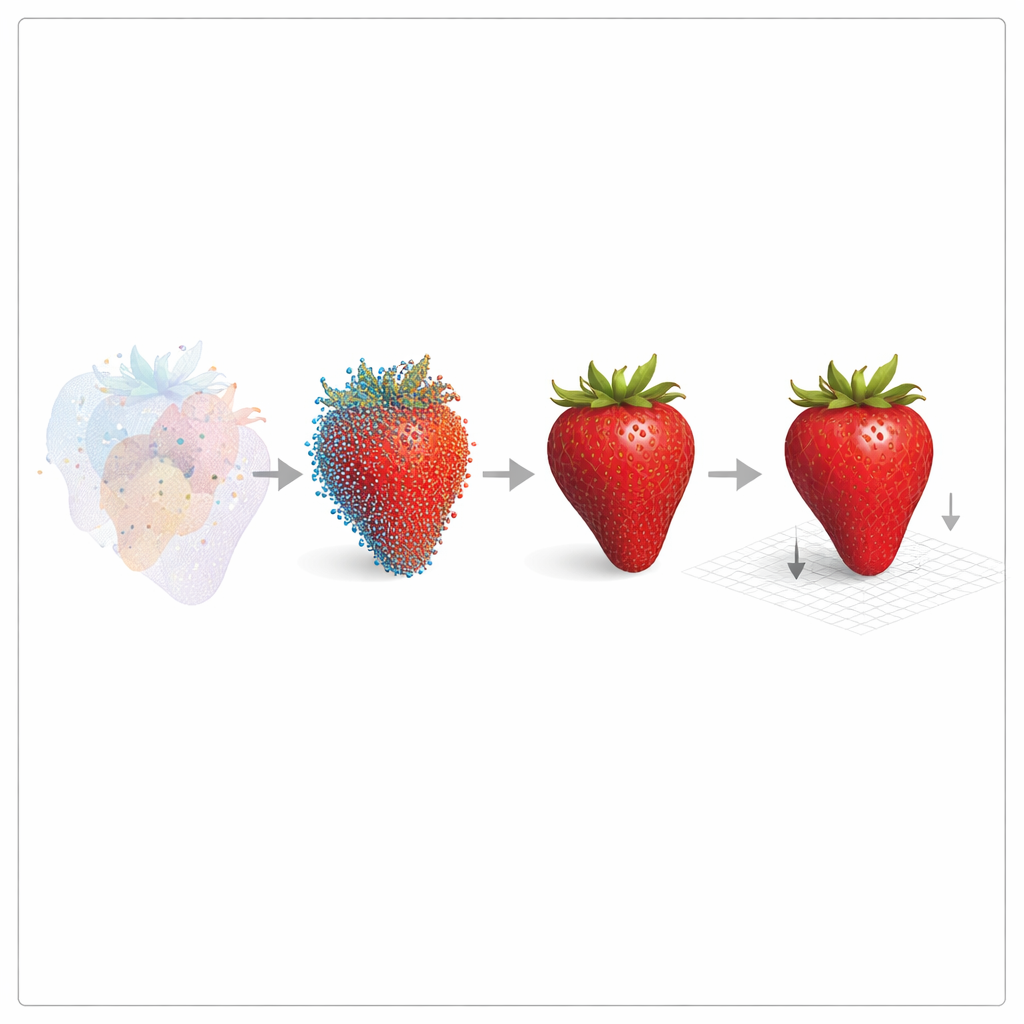

Le foto di cibo sono spesso caotiche: piatti, tavoli e oggetti di sfondo competono per l’attenzione. VolE affronta questo problema con un passaggio automatico di segmentazione video che funziona come delle forbici intelligenti. Un modello chiamato FoodMem identifica quali pixel appartengono al cibo in tutti i fotogrammi del video, anche quando il telefono si muove e il cibo viene parzialmente oscurato. Utilizzando le posizioni della fotocamera raffinate, VolE proietta i punti 3D in ciascuna immagine segmentata e mantiene solo quelli che ricadono in modo consistente sul cibo in ogni vista. Il risultato è una nuvola di punti pulita e isolata, appartenente soltanto all’elemento target, mentre la maggior parte dei punti di sfondo e gli errori di segmentazione vengono filtrati via.

Da punti a un oggetto misurabile

Le nuvole di punti da sole sono difficili da misurare, quindi VolE le converte in una superficie digitale continua chiamata mesh. Software 3D specializzato unisce punti vicini in minustri triangoli che avvolgono il cibo come una pelle aderente, colmando piccole lacune e rendendo l’oggetto “a tenuta stagna”. La mesh viene poi raffinata mediante passaggi di lisciamento, denoising e ottimizzazione che rimuovono irregolarità e buchi senza alterare in modo significativo la dimensione reale. Infine, si ricorre a un trucco matematico noto come teorema della divergenza: la superficie viene suddivisa in molti piccoli pezzi, ciascuno trattato come una piccola piramide ancorata all’origine. Sommando i volumi firmati di tutti questi pezzi si ottiene il volume totale del cibo in centimetri cubi, pronto per essere convertito in peso e calorie tramite Tabelle di densità standard.

Test su cibi reali e benchmark impegnativi

Per valutare l’efficacia di VolE, gli autori hanno costruito un nuovo dataset “Foodkit” di 21 alimenti reali—dalle mele e banane a wrap e pasticceria—catturati con 700–1200 immagini ciascuno. Hanno misurato il volume reale mediante spostamento d’acqua e la massa con una bilancia da laboratorio, poi hanno confrontato questi valori con le stime di VolE. Su tutti gli elementi, l’errore medio di volume è stato di circa l’1–2%, corrispondente a circa il 99% di accuratezza, e si è mantenuto stabile su ripetute esecuzioni nonostante l’albero di casualità interno al software di ricostruzione. VolE è stato inoltre valutato su dataset pubblici sfidanti usati in competizioni internazionali, superando o eguagliando i migliori metodi esistenti per la stima del volume degli alimenti, pur non richiedendo tavole di calibrazione, sensori di profondità o strutture con fotocamere fisse.

Cosa significa questo per la salute di tutti i giorni

In termini semplici, questo lavoro dimostra che un telefono che possiedi già può, con gli algoritmi giusti, misurare il tuo cibo quasi quanto strumenti da laboratorio. Trasformando video involontari in modelli 3D accurati, VolE elimina la necessità di bilance, scanner specializzati o foto accuratamente allestite con oggetti di riferimento. Sebbene al momento funzioni meglio per un singolo elemento principale sul piatto e venga eseguito su un computer potente piuttosto che direttamente sul telefono, il metodo indica un futuro prossimo in cui le app di monitoraggio alimentare potranno stimare automaticamente e in modo affidabile le porzioni. Questo potrebbe rendere il monitoraggio nutrizionale a lungo termine più oggettivo, meno gravoso e molto più accessibile a chi gestisce la propria salute nella vita quotidiana.

Citazione: Haroon, U., AlMughrabi, A., Zoumpekas, T. et al. VolE: A point-cloud framework for food 3D reconstruction and volume estimation. Sci Rep 16, 8648 (2026). https://doi.org/10.1038/s41598-026-38756-5

Parole chiave: stima del volume degli alimenti, ricostruzione 3D, salute mobile, realtà aumentata, valutazione dietetica