Clear Sky Science · it

Riconoscimento delle espressioni facciali tramite inferenza variazionale

Leggere i sentimenti dal volto

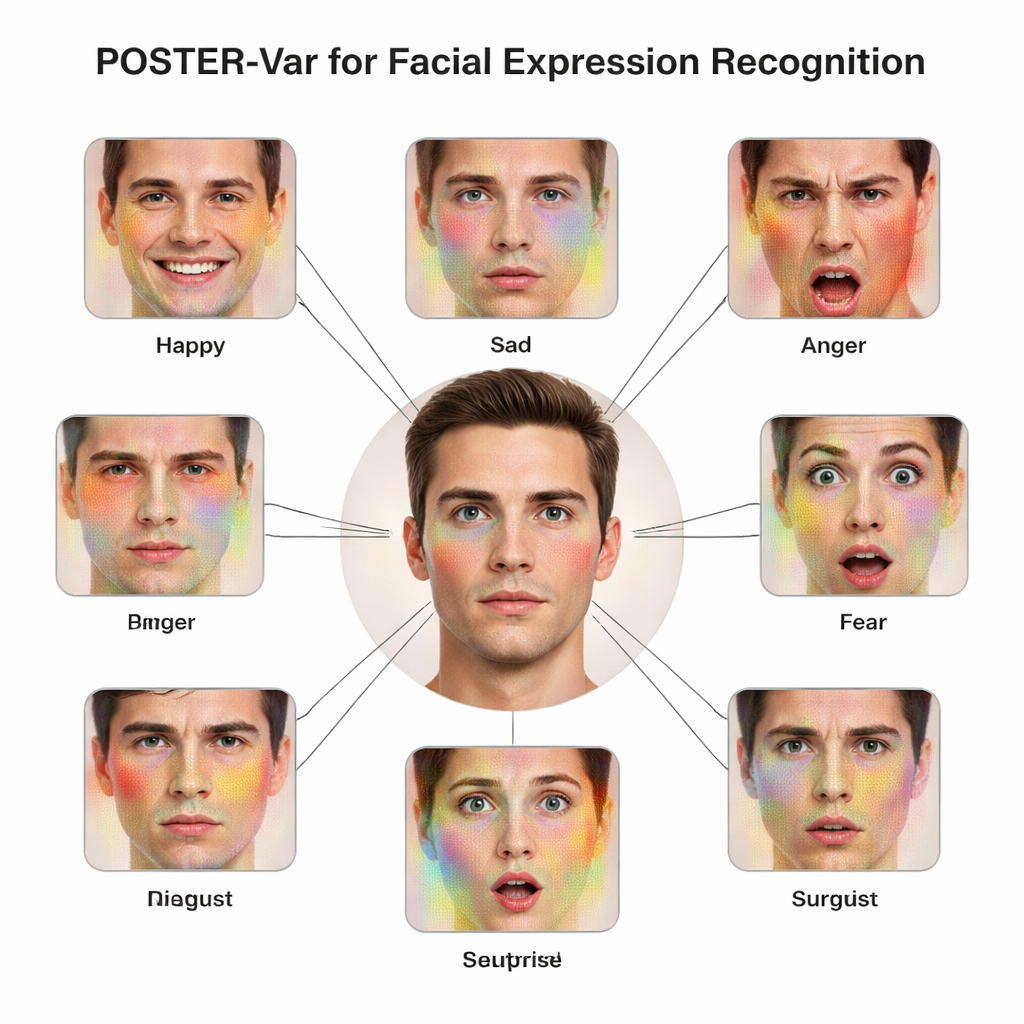

I nostri volti trasmettono costantemente come ci sentiamo, ma quei segnali raramente sono semplici. Un sorriso può nascondere nervosismo e uno sguardo “neutro” può mescolare noia e irritazione. Questo studio presenta POSTER-Var, un nuovo sistema di intelligenza artificiale (IA) che mira a leggere emozioni sottili e miste in modo più accurato rispetto agli strumenti attuali per le espressioni facciali, con possibili benefici che vanno dall’interazione uomo–computer al monitoraggio della salute mentale.

Perché le emozioni non sono solo accese o spente

La maggior parte dei sistemi esistenti per il riconoscimento delle espressioni facciali tratta le emozioni come caselle separate e nette: felice, triste, arrabbiato e così via. In realtà, la psicologia mostra che le espressioni sono miscele di emozioni di base, con diverse intensità che possono coesistere in un singolo volto. I modelli tradizionali di IA spesso costringono ciascuna immagine in un’unica etichetta rigida, ignorando l’incertezza e la natura continua e graduata dei sentimenti. Questo li rende fragili in contesti reali disordinati, dove illuminazione, posa e persino etichette umane incoerenti introducono rumore. Gli autori sostengono che i sistemi futuri devono riconoscere che un volto può suggerire più emozioni con intensità diverse e che i computer dovrebbero ragionare in termini di probabilità piuttosto che con decisioni sì-o-no.

Lasciare che il modello abbracci l’incertezza

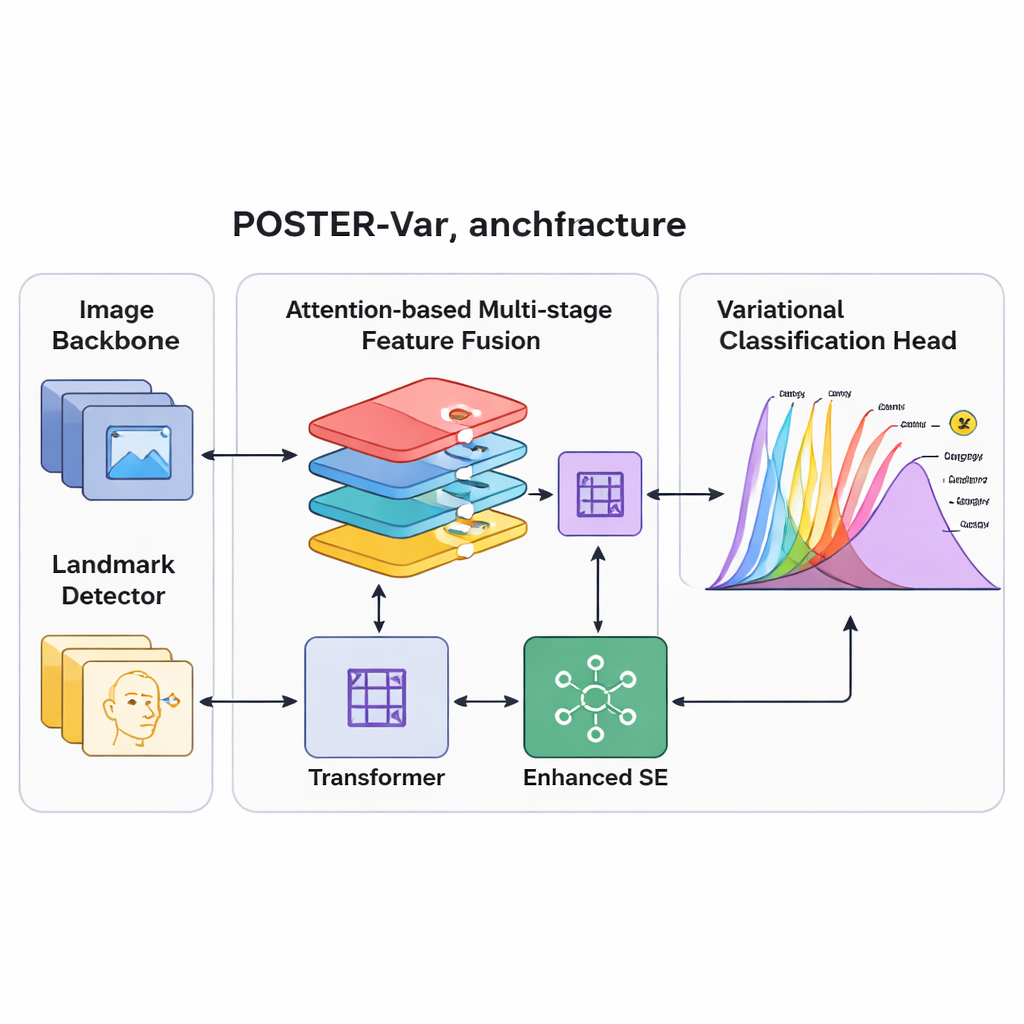

Per adattarsi meglio a questa realtà confusa, il team si basa su una tecnica della modellazione probabilistica moderna chiamata inferenza variazionale. Invece di produrre un unico punteggio fisso per ciascuna emozione, il sistema POSTER-Var mappa le caratteristiche facciali in uno “spazio latente” dove ogni emozione è rappresentata da una distribuzione di probabilità, tipicamente a campana. Durante l’addestramento, il sistema estrae campioni da queste distribuzioni apprese, incoraggiandolo a esplorare una gamma di possibili interpretazioni di ogni volto. In fase di test, però, usa semplicemente i centri di queste distribuzioni per fornire previsioni stabili. Fondamentalmente, POSTER-Var elimina i decoder supplementari e gli strati completamente connessi impiegati in precedenti progetti variazionali, trattando la rappresentazione probabilistica stessa come segnale decisionale finale. Questo snello “Variational Inference-based Classification Head”, o VICH, permette al modello di quantificare l’incertezza restando efficiente e accurato.

Osservare il volto a più scale

Riconoscere le espressioni richiede anche di guardare a diverse parti del volto e a diversi livelli di dettaglio: la curva della bocca, la forma degli occhi e la configurazione complessiva contano tutti. POSTER-Var estende un solido sistema precedente (POSTER++) migliorando il modo in cui queste caratteristiche multi-scala vengono combinate. Usa diversi meccanismi di attenzione per fondere informazioni da un backbone di immagine standard e da un rilevatore di punti di riferimento facciali, che traccia punti chiave come gli angoli degli occhi e i contorni della bocca. Un “layer embedding” contrassegna ciascuna mappa di caratteristiche con la sua posizione e il suo livello semantico nella piramide di elaborazione, aiutando la rete a capire da dove provengono i dettagli. Trasformazioni non lineari e un blocco di attenzione sui canali potenziato riequilibrano poi queste caratteristiche, valorizzando quelle più informative per le espressioni e sopprimendo distrazioni come il rumore di sfondo o particolarità legate all’identità.

Mettere il sistema alla prova

I ricercatori hanno valutato POSTER-Var su tre dataset ampiamente usati e rappresentativi del mondo reale: RAF-DB, AffectNet e FER+. Queste collezioni includono centinaia di migliaia di volti catturati in condizioni non controllate, ciascuno etichettato con una delle diverse emozioni di base. Su tutti i benchmark, POSTER-Var ha eguagliato o superato i metodi attuali allo stato dell’arte. Per esempio, ha raggiunto circa il 93% di accuratezza su RAF-DB e approssimativamente il 92% su FER+, con lievi miglioramenti sui set AffectNet a 7 e 8 classi. Esperimenti di ablazione, in cui componenti individuali venivano rimossi, hanno mostrato che sia il layer embedding sia la testa variazionale hanno contribuito in modo significativo alle prestazioni, con il componente variazionale particolarmente utile su dataset più difficili e sbilanciati. Visualizzazioni delle mappe di attenzione hanno rivelato che POSTER-Var si concentra su regioni facciali più ampie e significative rispetto alla baseline, e i grafici delle distribuzioni emotive apprese mostrano come separi meglio, per esempio, il “triste” dal “neutrale” nei casi ambigui.

Cosa significa per le applicazioni nel mondo reale

In termini semplici, POSTER-Var insegna alle macchine a trattare le espressioni facciali non tanto come semafori quanto come previsioni meteo: può esserci un’umore principale “soleggiato” con accenti “nuvolosi” sparsi, e la previsione dovrebbe riconoscere l’incertezza. Modellando intere distribuzioni sulle emozioni invece di un’unica ipotesi, il sistema diventa più robusto rispetto ad etichette rumorose ed espressioni sottili e miste. Lo studio suggerisce che tali approcci probabilistici potrebbero essere alla base della prossima generazione di tecnologie sensibili agli affetti, rendendo assistenti virtuali, robot sociali e strumenti di ricerca comportamentale più sintonizzati sulla complessa vita emotiva che i nostri volti rivelano solo in modo imperfetto.

Citazione: Lv, G., Zhang, J. & Tsoi, C. Facial expression recognition via variational inference. Sci Rep 16, 7323 (2026). https://doi.org/10.1038/s41598-026-38734-x

Parole chiave: riconoscimento delle espressioni facciali, IA delle emozioni, modellazione probabilistica, inferenza variazionale, visione artificiale