Clear Sky Science · it

Predizione del carico basata su attenzione e allocazione dinamica delle risorse per ambienti di calcolo eterogenei

Perché computer più intelligenti contano per tutti

Dietro ogni film che guardi in streaming, ogni mappa che apri o ogni assistente AI con cui parli, enormi magazzini di computer lavorano silenziosamente 24 ore su 24. Con l’aumento delle capacità dell’intelligenza artificiale, questi data center vengono spinti fino ai loro limiti: devono gestire molti tipi di lavori su molte classi di macchine mantenendo sotto controllo costi, velocità e consumo energetico. Questo articolo presenta un nuovo metodo per prevedere ciò di cui quei computer avranno bisogno nel prossimo futuro e per distribuire il lavoro tra diversi tipi di hardware in modo che i servizi restino veloci e affidabili consumando meno elettricità.

Molti lavori, molte macchine

I data center moderni non si affidano più a un unico tipo di server. Al contrario, combinano processori tradizionali con potenti unità grafiche, schede AI specializzate e circuiti riprogrammabili. Compiti diversi di AI — come addestrare un grande modello linguistico, servire raccomandazioni in tempo reale o analizzare immagini — si adattano a queste macchine in modi molto diversi. Oggi gli operatori spesso assegnano risorse usando regole fisse o previsioni semplici basate sull’uso di ieri. Quando la domanda improvvisamente schizza, questo può causare risposte lente o violazioni degli accordi di servizio; quando la domanda cala, hardware costoso può restare inattivo, consumando energia ma svolgendo poco lavoro.

Imparare a guardare dove conta

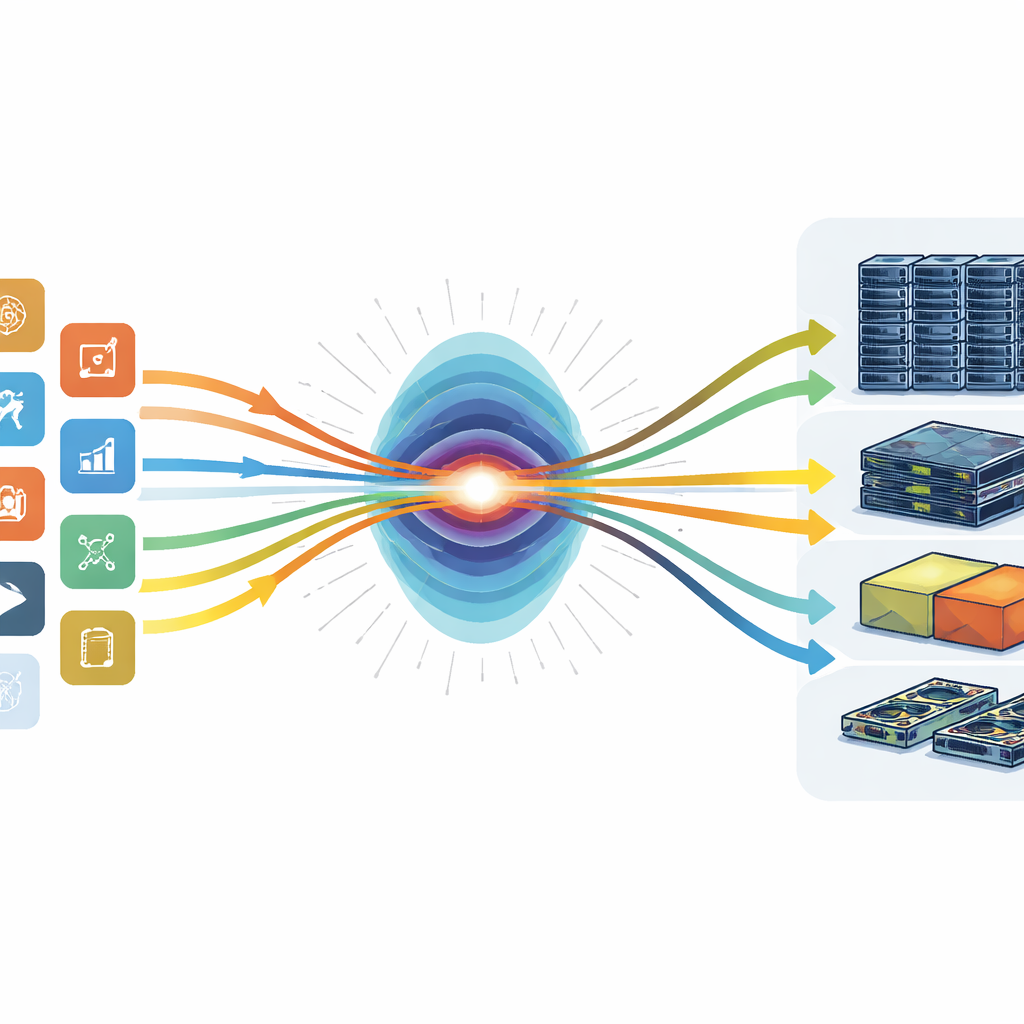

Gli autori prendono in prestito un concetto dai modelli AI all’avanguardia chiamato “attenzione” e lo applicano alla gestione dei data center. Invece di trattare tutti i dati storici allo stesso modo, il loro sistema apprende quali momenti nel tempo e quali tipi di carichi sono più utili per indovinare cosa accadrà dopo. Una parte del modello si concentra su come ogni workload — come un job di addestramento o un servizio online — cambia nel tempo. Un’altra parte guarda lateralmente attraverso i diversi workload attivi nello stesso istante per scoprire connessioni nascoste, ad esempio uno schema in cui il completamento di un lotto di job di addestramento spesso provoca un picco nelle query online correlate. Sovrapponendo queste due viste, il sistema può prevedere le richieste future di processori, memoria e acceleratori con maggiore precisione rispetto ai metodi precedenti.

Trasformare le previsioni in decisioni migliori

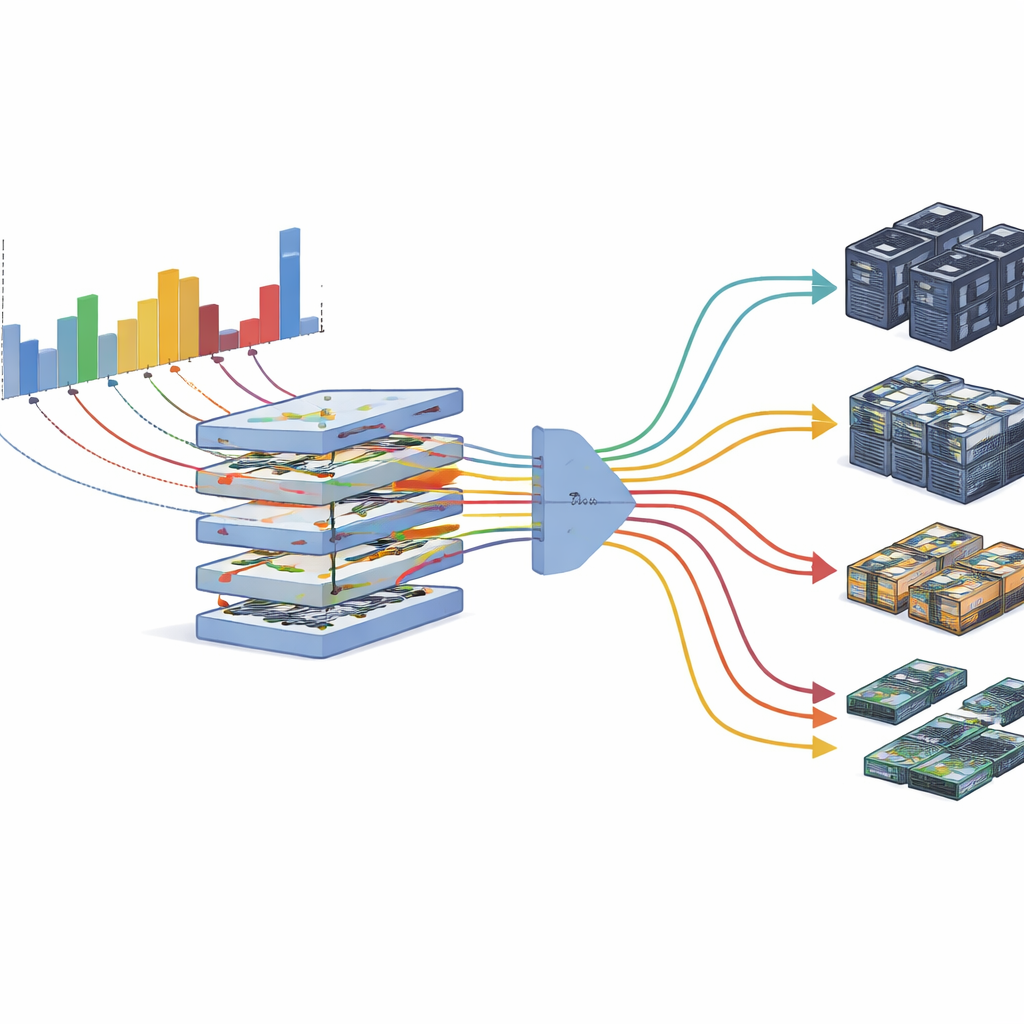

La sola previsione non basta; il data center deve agire di conseguenza. La seconda metà del framework trasforma queste previsioni in decisioni concrete su dove eseguire ogni job. Gli autori trattano questo come un equilibrio tra tre obiettivi: completare i lavori rapidamente, consumare quanta meno energia possibile e mantenere le macchine occupate anziché inattive. Il loro scheduler rappresenta il data center come una rete di dispositivi diversi e usa una procedura di ottimizzazione per scegliere collocamenti che bilanciano questi obiettivi secondo le preferenze dell’operatore. Poiché le previsioni non sono mai perfette, il sistema stima anche la propria incertezza e lascia margini di sicurezza quando necessario, quindi monitora la realtà in tempo reale per adattarsi mettendo in pausa lavori a bassa priorità o spostandoli quando l’utilizzo si discosta dalle aspettative.

Mettere il sistema alla prova

Per verificare come funziona questo approccio nella pratica, i ricercatori hanno costruito un cluster di test con una mescolanza realistica di processori, GPU e hardware AI specializzato, e vi hanno fornito registrazioni dettagliate dell’attività provenienti da data center reali di Google, Alibaba e da un laboratorio accademico. Hanno confrontato il loro metodo con strumenti di previsione e strategie di scheduling popolari, incluse tecniche usate in sistemi di produzione e controllori basati su reinforcement learning. Il predittore basato sull’attenzione ha fornito costantemente stime più accurate, specialmente per le impennate brusche che spesso si verificano nei carichi AI. Accoppiato con il loro allocatore dinamico, il sistema ha aumentato l’utilizzo complessivo dell’hardware fino a circa quattro quinti della capacità, ridotto il tempo medio di completamento dei job di circa un quarto e diminuito il consumo energetico di circa il 15 percento, mantenendo al contempo le violazioni di servizio a livelli molto bassi.

Cosa significa per gli utenti di tutti i giorni

Per i non specialisti, il messaggio principale è che una coordinazione più intelligente all’interno dei data center può rendere i servizi AI più veloci, meno costosi e più ecologici senza richiedere nuovi chip o edifici. Imparando dove “prestare attenzione” nel flusso di dati sull’utilizzo, questo framework aiuta l’hardware esistente a svolgere più lavoro utile e a restare inattivo meno spesso. Ciò significa che le aziende possono offrire app più reattive e strumenti AI più potenti contenendo bollette elettriche e impronta di carbonio. Man mano che sistemi simili di previsione e allocazione si diffonderanno e matureranno, la macchina invisibile di internet potrà diventare non solo più capace ma anche più sostenibile.

Citazione: Shao, S., Ding, X., Zhao, B. et al. Attention-based workload prediction and dynamic resource allocation for heterogeneous computing environments. Sci Rep 16, 8571 (2026). https://doi.org/10.1038/s41598-026-38622-4

Parole chiave: schedulazione nei data center, predizione dei carichi AI, calcolo eterogeneo, calcolo a basso consumo energetico, allocazione delle risorse